spark默认读取的是hdfs上的文件。

如果读取本地文件,则需要加file:///usr/local/spark/README.md。 (测试时候发现,本地文件必须在spark的安装路径内部或者平行)

读取hdfs文件, 可以这样指定路径 hdfs://ns1/tmp/test.txt。

如果不指定任何前缀,则使用hdfs的默认路径/user/data/

启动spark-shell:

由于已经在spark-defaults.conf中指定了spark.master,所以启动时默认以standalone模式加载

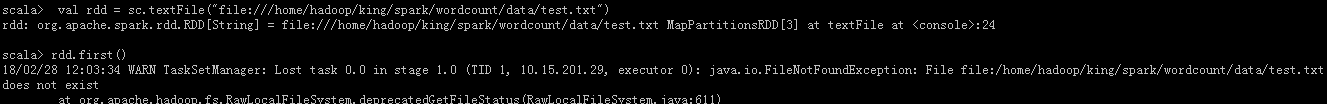

1. 读取本地文件:

spark安装路径下/usr/local/spark/README.md

然鹅使用其他路径 /home/hadoop/king/spark/wordcount/data/test.txt

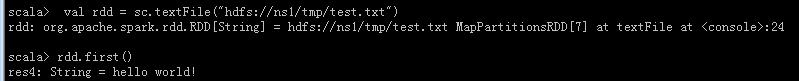

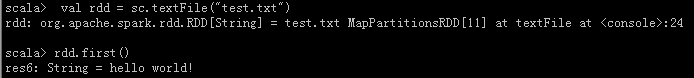

2. 读取hdfs文件

hdfs://ns1/tmp/test.txt

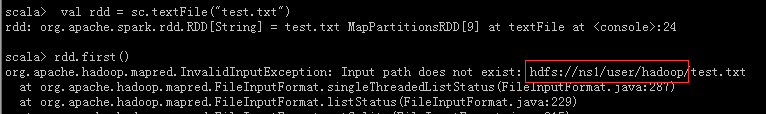

3. 不加任何前缀

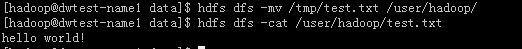

默认识别的hadoop用户的目录,将刚才的test.txt拷贝到目录:hdfs://ns1/user/hadoop/

再次读取:

在实际的使用中推荐使用第二种方式处理数据。