课程安排

MapReduce原理*** MapReduce执行过程** 数据类型与格式*** Writable接口与序列化机制*** ---------------------------加深拓展---------------------- MapReduce的执行过程源码分析

问题:怎样解决海量数据的计算?

MapReduce概述

Mapreduce原理

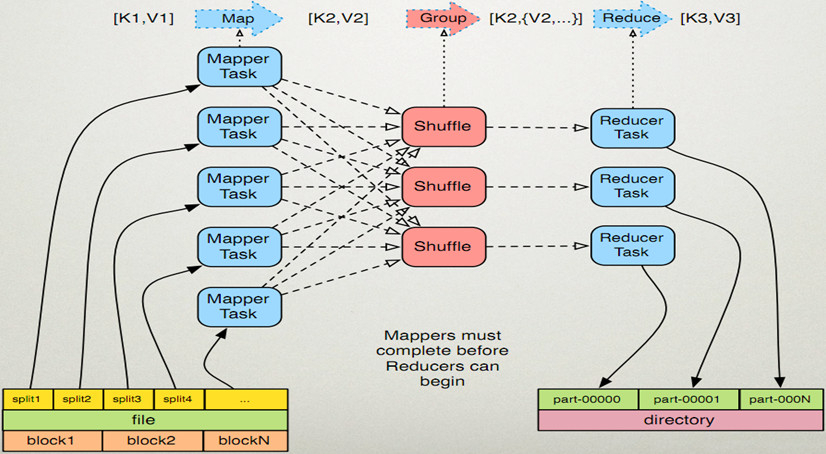

◆执行步骤:

1. map任务处理

1.1 读取输入文件内容,解析成key、value对。对输入文件的每一行,解析成key、value对。每一个键值对调用一次map函数。

1.2 写自己的逻辑,对输入的key、value处理,转换成新的key、value输出。

2.reduce任务处理

2.1写reduce函数自己的逻辑,对输入的key、value处理,转换成新的key、value输出。

2.2把reduce的输出保存到文件中。

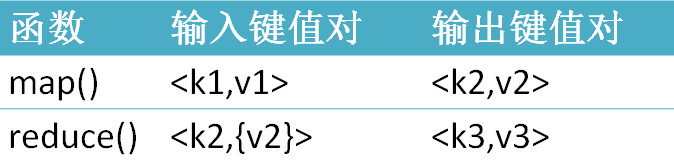

map、reduce键值对格式

WordCountApp的驱动代码

Configuration conf = new Configuration(); //加载配置文件 Job job = new Job(conf); //创建一个job,供JobTracker使用 job.setJarByClass(WordCountApp.class); job.setMapperClass(WordCountMapper.class); job.setReducerClass(WordCountReducer.class); FileInputFormat.setInputPaths(job, new Path("hdfs://192.168.1.10:9000/input")); FileOutputFormat.setOutputPath(job, new Path("hdfs://192.168.1.10:9000/output")); job.setOutputKeyClass(Text.class); job.setOutputValueClass(IntWritable.class); job.waitForCompletion(true); }

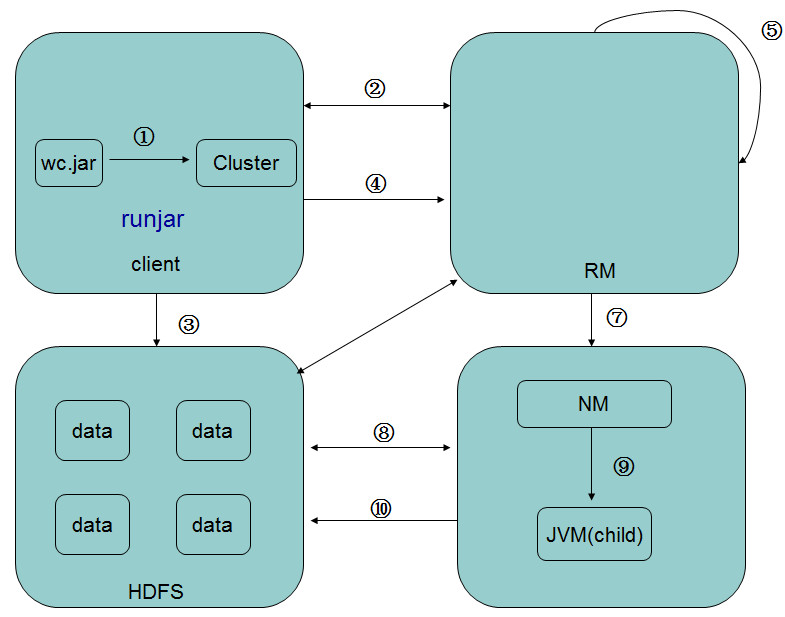

MR流程

MR过程各个角色的作用

作业提交

任务分配

JobTracker

TaskTracker

JobClient

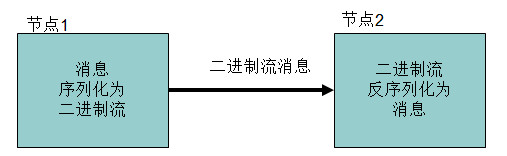

序列化概念

Hadoop序列化的特点

l序列化格式特点:

Hadoop的序列化格式:Writable

Java序列化的不足:

1.不精简。附加信息多。不大适合随机访问。

2.存储空间大。递归地输出类的超类描述直到不再有超类。序列化图对象,反序列化时为每个对象新建一个实例。相反。Writable对象可以重用。

3.扩展性差。而Writable方便用户自定义

Hadoop序列化的作用

l序列化在分布式环境的两大作用:进程间通信,永久存储。

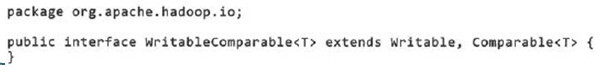

Writable接口

•MR的任意key必须实现WritableComparable接口

常用的Writable实现类

Text一般认为它等价于java.lang.String的Writable。针对UTF-8序列。

例:

Text test = new Text("test");

IntWritable one = new IntWritable(1);

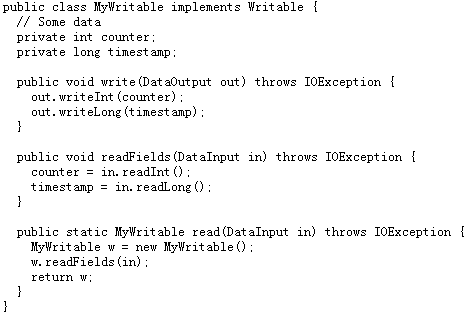

自定义Writable类

Writable

MapReduce输入的处理类

FileInputFormat是所有以文件作为数据源的InputFormat实现的基类,FileInputFormat保存作为job输入的所有文件,并实现了对输入文件计算splits的方法。至于获得记录的方法是有不同的子类——TextInputFormat进行实现的。

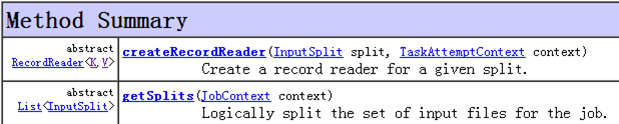

InputFormat

InputFormat 负责处理MR的输入部分.

InputSplit

◆ 在执行mapreduce之前,原始数据被分割成若干split,每个split作为一个map任务的输入,在map执行过程中split会被分解成一个个记录(key-value对),map会依次处理每一个记录。

◆ FileInputFormat只划分比HDFS block大的文件,所以FileInputFormat划分的结果是这个文件或者是这个文件中的一部分.

◆ 如果一个文件的大小比block小,将不会被划分,这也是Hadoop处理大文件的效率要比处理很多小文件的效率高的原因。

◆ 当Hadoop处理很多小文件(文件大小小于hdfs block大小)的时候,由于FileInputFormat不会对小文件进行划分,所以每一个小文件都会被当做一个split并分配一个map任务,导致效率底下。

例如:一个1G的文件,会被划分成16个64MB的split,并分配16个map任务处理,而10000个100kb的文件会被10000个map任务处理。

TextInputFormat

◆ TextInputformat是默认的处理类,处理普通文本文件。

◆ 文件中每一行作为一个记录,他将每一行在文件中的起始偏移量作为key,每一行的内容作为value。

◆ 默认以 或回车键作为一行记录。

◆ TextInputFormat继承了FileInputFormat。

InputFormat类的层次结构

其他输入类

◆ CombineFileInputFormat

相对于大量的小文件来说,hadoop更合适处理少量的大文件。

CombineFileInputFormat可以缓解这个问题,它是针对小文件而设计的。

◆ KeyValueTextInputFormat

当输入数据的每一行是两列,并用tab分离的形式的时候,KeyValueTextInputformat处理这种格式的文件非常适合。

◆ NLineInputformat

NLineInputformat可以控制在每个split中数据的行数。

◆ SequenceFileInputformat

当输入文件格式是sequencefile的时候,要使用SequenceFileInputformat作为输入。

自定义输入格式

1)继承FileInputFormat基类。

2)重写里面的getSplits(JobContext context)方法。

3)重写createRecordReader(InputSplit split, TaskAttemptContext context)方法。

(讲解源代码)

Hadoop的输出

◆ TextOutputformat

默认的输出格式,key和value中间值用tab隔开的。

◆ SequenceFileOutputformat

将key和value以sequencefile格式输出。

◆ SequenceFileAsOutputFormat

将key和value以原始二进制的格式输出。

◆ MapFileOutputFormat

将key和value写入MapFile中。由于MapFile中的key是有序的,所以写入的时候必须保证记录是按key值顺序写入的。

◆ MultipleOutputFormat

默认情况下一个reducer会产生一个输出,但是有些时候我们想一个reducer产生多个输出,MultipleOutputFormat和MultipleOutputs可以实现这个功能。

思考题