K-近邻算法又称KNN算法,最早是由Cover和Hart提出的一种分类算法,其原理非常简单,主要是根据计算两个样本之间的距离从而对样本进行预测分类,常用的距离计算公式有欧氏距离:

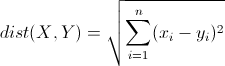

根据未知样本与已知样本的欧式距离,计算出距离最近的样本,则其为预测样本的类别

在Python的sklearn中使用KNN算法的API:

sklearn.neighbors.KNeighborsClassifier(n_neighbors=5,algorithm='auto')

n_neighbors:int,可选(默认= 5),k_neighbors查询默认使用的邻居数

algorithm:{'auto','ball_tree','kd_tree','brute'},可选用于计算最近邻居的算法

'ball_tree': 将会使用BallTree,'kd_tree'将使用KDTree;

'auto': 将尝试根据传递给fit方法的值来决定最合适的算法;(不同实现方式影响效率)

使用示例:Facebook V: Predicting Check Ins

数据集来源:https://www.kaggle.com/c/facebook-v-predicting-check-ins/data

注意:下载数据需激活账户(激活账户需fan qiang)

示例来源:

Facebook和Kaggle2016年推出的机器学习工程竞赛题目:

本次比赛的目的是预测一个人想要签到的地方。为了本次比赛的目的,Facebook创建了一个人工世界,其中包括10平方公里的100,000多个地方。对于给定的坐标集,您的任务是返回最可能位置的排名列表。数据被制作成类似于来自移动设备的位置信号,让您了解如何处理由不准确和嘈杂的值导致的实际数据。不一致和错误的位置数据可能会破坏Facebook Check In等服务的体验。

部分数据示例:

数据介绍:

train.csv,test.csv

row_id:登记事件的ID

xy:坐标

准确性:定位准确性

时间:时间戳

place_id:业务的ID,这是您预测的目标

分析

对于数据做一些基本处理(这里所做的一些处理不一定达到很好的效果,只是简单尝试,有些特征可以根据一些特征选择的方式去做处理)

1、缩小数据集范围 DataFrame.query()

data = data.query("x > 1.0 & x < 1.25 & y > 2.5 & y < 2.75")

2、处理日期数据 pd.to_datetime pd.DatetimeIndex

time_value = pd.to_datetime(data['time'], unit='s')

3、增加分割的日期数据

time_value = pd.DatetimeIndex(time_value)

data['day'] = time_value.day

data['weekday'] = time_value.weekday

data['hour'] = time_value.hour

4、删除没用的数据 DataFrame.drop

data = data.drop(['time'], axis=1)

# 删除入住次数少于三次位置

place_count = data.groupby('place_id').count()

tf = place_count[place_count.row_id > 3].reset_index()

data = data[data['place_id'].isin(tf.place_id)]

5、将签到位置少于n个用户的删除

place_count = data.groupby('place_id').count()

tf = place_count[place_count.row_id > 3].reset_index()

data = data[data['place_id'].isin(tf.place_id)]

6、模型参数设置

knn = KNeighborsClassifier(n_neighbors=1)

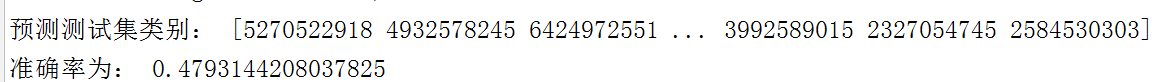

n_neighbors即KNN算法中的K值:算法传入参数不定的值,当值设置为1时,结果如下:

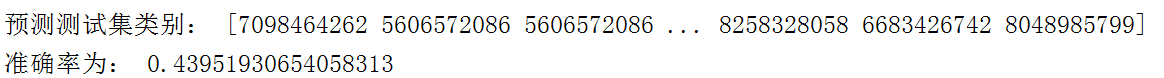

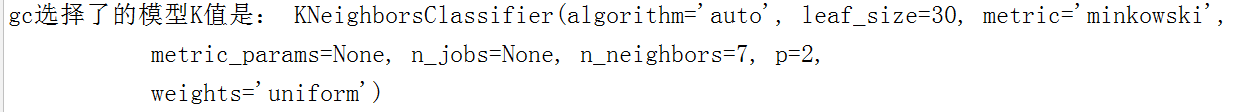

由于K的值直接影响到预测的准确率,通过调整k的值可以优化准确率,使用sklearn提供的超参数搜索-网格搜索(Grid Search),采用交叉验证来进行评估,最后选出最优参数组合建立模型:

knn = KNeighborsClassifier()

param = {"n_neighbors": list(range(1, 10))}

gc = GridSearchCV(knn, param_grid=param, cv=2)

gc.fit(x_train, y_train)

# 交叉验证获取最佳模型参数

print("gc选择了的模型K值是:", gc.best_estimator_)

best_k = gc.best_estimator_.__dict__.get("n_neighbors")

调参结果:

完整代码:

import pandas as pd

from sklearn.neighbors import KNeighborsClassifier

from sklearn.model_selection import train_test_split

from sklearn.preprocessing import StandardScaler

from sklearn.model_selection import GridSearchCV

def knncls():

"""

K近邻算法预测入住位置类别

:return:

"""

# 一、处理数据以及特征工程

# 1、读取收,缩小数据的范围

data = pd.read_csv("./train.csv")

# 数据逻辑筛选操作 df.query()

data = data.query("x > 1.0 & x < 1.25 & y > 2.5 & y < 2.75")

# 2、处理时间戳日期

time_value = pd.to_datetime(data['time'], unit='s')

time_value = pd.DatetimeIndex(time_value)

# 加入时间的其它的特征

data['day'] = time_value.day

data['weekday'] = time_value.weekday

data['hour'] = time_value.hour

# 删除time这一列特征

data = data.drop(['time'], axis=1)

# 删除入住次数少于三次位置

place_count = data.groupby('place_id').count()

tf = place_count[place_count.row_id > 3].reset_index()

data = data[data['place_id'].isin(tf.place_id)]

# 3、取出特征值和目标值

y = data['place_id']

x = data.drop(['place_id', 'row_id'], axis=1)

# 4、数据分割与特征工程?

# (1)、数据分割

x_train, x_test, y_train, y_test = train_test_split(x, y, test_size=0.3)

# (2)、标准化

std = StandardScaler()

# 对训练集进行标准化操作

x_train = std.fit_transform(x_train)

# 进行测试集的标准化操作

x_test = std.fit_transform(x_test)

# 二、算法的输入训练预测

# K值:算法传入参数不定的值 理论上:k = 根号(样本数)

# 交叉验证调参 使用网格搜索和交叉验证找到合适的参数

knn = KNeighborsClassifier()

param = {"n_neighbors": list(range(1, 10))}

gc = GridSearchCV(knn, param_grid=param, cv=2)

gc.fit(x_train, y_train)

# 交叉验证获取最佳模型参数

print("gc选择了的模型K值是:", gc.best_estimator_)

best_k = gc.best_estimator_.__dict__.get("n_neighbors")

knn = KNeighborsClassifier(n_neighbors=best_k)

# 调用fit()

knn.fit(x_train, y_train)

# 预测测试数据集,得出准确率

y_predict = knn.predict(x_test)

print("预测测试集类别:", y_predict)

print("准确率为:", knn.score(x_test, y_test))

return None

knncls()

结果: