Pointer Networks (https://arxiv.org/pdf/1506.03134.pdf) NIPS15的论文,通过改进RNN用来解决一些传统cs问题,比如凸包,三角剖分,甚至是TSP,最神奇的地方在于这玩意效果竟然还不错,甚至比一些近似算法效果好。OI/ACM党出身的我表示三观都被毁了……

Synthesizing Dynamic Textures and Sounds by Spatial-Temporal Generative ConvNet (http://arxiv.org/pdf/1606.00972v1.pdf),似乎是投NIPS16的,来自Ying Nian Wu和SongChun Zhu组,用CNN来合成视频纹理以及声音,效果炸裂。也许哪一天做Graphics的那帮人就可以退休回家吃饭了也说不准233。

Neural Programmer-Interpreters (https://arxiv.org/pdf/1511.06279.pdf), ICLR16的best paper, 用LSTM来实现task-specific的自动化编程。这个应用ICLR15就有,不过这篇文章效果比之前的做法好不少:)

Learning to learn by gradient descent by gradient descent (https://arxiv.org/pdf/1606.04474v1.pdf ) DeepMind的神奇工作,光看名字就很神奇了不是么=,=.用LSTM学出来optimization algorithm……DL从此可以bootstrap了……也许几十年以后人类会思考,究竟是Optimization先出来还是DL算法先出来呢,古称:优化生深度,深度生优化问题。

Latent Predictor Networks for Code Generation

使用双向LSTM神经网络 + 注意力机制,根据炉石卡片的说明,生成代码。

虽然效果还达不到直接能用的程度,但这个idea本身也算是很奇崛了。

使用双向LSTM神经网络 + 注意力机制,根据炉石卡片的说明,生成代码。

虽然效果还达不到直接能用的程度,但这个idea本身也算是很奇崛了。

前面回答者介绍了Neural Art,,利用学习到的特征使其他的图片带上梵高画上的风格,推而广之,其实类似的将多种Style融合在一起形成新内容的Generative Model最近好像很多,打算研究一下

Image Synthesis

不同风格的图像合成

和Neural Art相似,比如这一篇文章:

Combining Markov Random Fields and Convolutional Neural Networks for Image Synthesis

http://arxiv.org/pdf/1601.04589v1.pdf

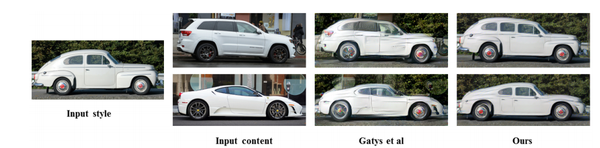

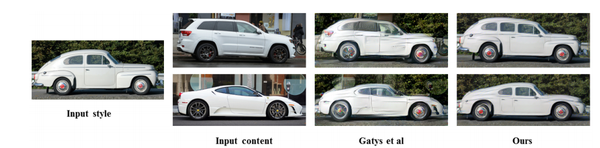

将老爷车的风格融入现代汽车中,设计出的新款型,非常有意思

将老爷车的风格融入现代汽车中,设计出的新款型,非常有意思

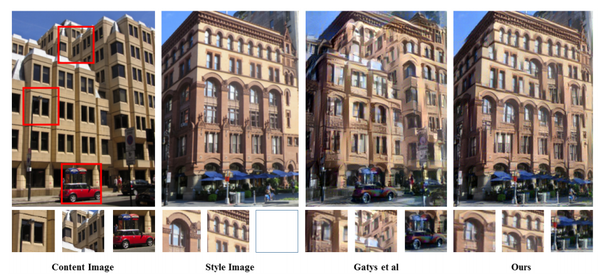

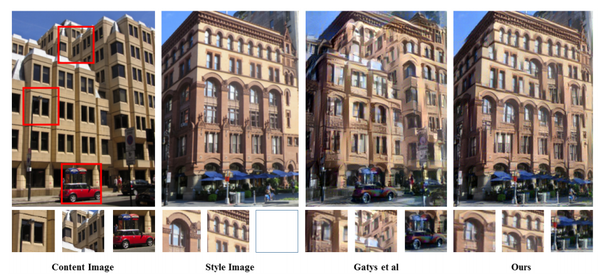

建筑风格的的合成也是如此,尽管看上去有点别扭

建筑风格的的合成也是如此,尽管看上去有点别扭

Deep Dream

让机器做梦!

人类的做梦时,大脑中会产生随机的噪声信号,而进入梦中的随机信号可看成是一种建构、整合的过程,大脑唤醒记忆中的表象来与脑干激活所产生的信息资料相匹配,试图理解这种随机的信号。

Google的工作,去年就发表出来了,给定一幅图像(这里以一副天空的图像和一副太空的图像为例),极大化某一神经元的激活度。对于low-level的feature,也就是浅层神经元,生成的图像会最大化相应滤波器的激活度,抑制其他滤波器的激活度,重新生成的图片如下:

激活high-level的神经元,图像上就现实出了很多high-level的feature了

激活high-level的神经元,图像上就现实出了很多high-level的feature了

看上去有点鬼畜。。

看上去有点鬼畜。。

这里有一个在线的网站可以玩玩 http://deepdreamgenerator.com/

2月底的时候,谷歌在美国对生成这些抽象画办了一个画展,这些画还卖到了差不多10万美金,去资助一下这些年轻的艺术家们,让他们进行创作。

音效合成

Visually Indicated Sounds

项目主页在这里:http://vis.csail.mit.edu/

大意就是根据视频内发生的敲打、摩擦等动作,合成出对应的声音,比如用木棍蹭水泥地的时候就播放出呲呲声

http://vis.csail.mit.edu/site-videos/header-vid3.mp4

视频预测

这里能扩展的工作就很多了,貌似也有一个工作是做光流预测的

这里能扩展的工作就很多了,貌似也有一个工作是做光流预测的

Image restoration/inpainting

参见CVPR2016的这篇文章:

Context Encoders: Feature Learning by Inpainting

http://www.cv-foundation.org/openaccess/content_cvpr_2016/papers/Pathak_Context_Encoders_Feature_CVPR_2016_paper.pdf

直接把图片中的一块挖掉,用其余部分的信息来恢复破损的区域

还有ICML2016这篇也做了类似的工作:

Pixel Recurrent Neural Networks

http://arxiv.org/pdf/1601.06759v2.pdf

更多关于Generative Model可以参看

Generative Adversarial Nets

http://arxiv.org/pdf/1406.2661v1.pdf

对抗式的训练方法,这种网络训练了两个Model,一个生成式model,一个判别式model,联合优化,生成时model尽量学习到能表达和训练集同分布的样例,判别式model尽量去区分真实的训练样例和生成式model表达出的样例,二者对抗式的优化,最后可以使得生成式model能生成和训练结合同分布的样例,从而使得网络可以预测分布中未见的样本

以及OpenAI最新的工作,从图片集中生成图片

Generative Models

Image Synthesis

不同风格的图像合成

和Neural Art相似,比如这一篇文章:

Combining Markov Random Fields and Convolutional Neural Networks for Image Synthesis

http://arxiv.org/pdf/1601.04589v1.pdf

将老爷车的风格融入现代汽车中,设计出的新款型,非常有意思

将老爷车的风格融入现代汽车中,设计出的新款型,非常有意思 建筑风格的的合成也是如此,尽管看上去有点别扭

建筑风格的的合成也是如此,尽管看上去有点别扭Deep Dream

让机器做梦!

人类的做梦时,大脑中会产生随机的噪声信号,而进入梦中的随机信号可看成是一种建构、整合的过程,大脑唤醒记忆中的表象来与脑干激活所产生的信息资料相匹配,试图理解这种随机的信号。

Google的工作,去年就发表出来了,给定一幅图像(这里以一副天空的图像和一副太空的图像为例),极大化某一神经元的激活度。对于low-level的feature,也就是浅层神经元,生成的图像会最大化相应滤波器的激活度,抑制其他滤波器的激活度,重新生成的图片如下:

激活high-level的神经元,图像上就现实出了很多high-level的feature了

激活high-level的神经元,图像上就现实出了很多high-level的feature了

看上去有点鬼畜。。

看上去有点鬼畜。。这里有一个在线的网站可以玩玩 http://deepdreamgenerator.com/

2月底的时候,谷歌在美国对生成这些抽象画办了一个画展,这些画还卖到了差不多10万美金,去资助一下这些年轻的艺术家们,让他们进行创作。

音效合成

Visually Indicated Sounds

项目主页在这里:http://vis.csail.mit.edu/

大意就是根据视频内发生的敲打、摩擦等动作,合成出对应的声音,比如用木棍蹭水泥地的时候就播放出呲呲声

http://vis.csail.mit.edu/site-videos/header-vid3.mp4

视频预测

Deep Predictive Coding Networks for Video Prediction and Unsupervised Learning

用视频中前面几帧的信息来预测后面几帧,效果还挺好的,这也就可以理解我们打乒乓球的时候,明明不能计算出球的落点却能准确击球的机理了

这里能扩展的工作就很多了,貌似也有一个工作是做光流预测的

这里能扩展的工作就很多了,貌似也有一个工作是做光流预测的Image restoration/inpainting

参见CVPR2016的这篇文章:

Context Encoders: Feature Learning by Inpainting

http://www.cv-foundation.org/openaccess/content_cvpr_2016/papers/Pathak_Context_Encoders_Feature_CVPR_2016_paper.pdf

直接把图片中的一块挖掉,用其余部分的信息来恢复破损的区域

还有ICML2016这篇也做了类似的工作:

Pixel Recurrent Neural Networks

http://arxiv.org/pdf/1601.06759v2.pdf

更多关于Generative Model可以参看

Generative Adversarial Nets

http://arxiv.org/pdf/1406.2661v1.pdf

对抗式的训练方法,这种网络训练了两个Model,一个生成式model,一个判别式model,联合优化,生成时model尽量学习到能表达和训练集同分布的样例,判别式model尽量去区分真实的训练样例和生成式model表达出的样例,二者对抗式的优化,最后可以使得生成式model能生成和训练结合同分布的样例,从而使得网络可以预测分布中未见的样本

以及OpenAI最新的工作,从图片集中生成图片

Generative Models

看到过一个利用深度学习改变图片的艺术风格的

Github:https://github.com/fzliu/style-transfer

来自微博:http://m.weibo.cn/1402400261/3982309310926836?moduleID=feed&uicode=10000002&mid=3982316391582790&luicode=10000198&_status_id=3982309310926836&lfid=1076031837287505_-_WEIBO_SECOND_PROFILE_WEIBO&lcardid=1076031837287505_-_WEIBO_SECOND_PROFILE_WEIBO_-_3982316391582790

我想的很简单,是不是可以利用深度学习来给照片加滤镜=_=

Github:https://github.com/fzliu/style-transfer

来自微博:http://m.weibo.cn/1402400261/3982309310926836?moduleID=feed&uicode=10000002&mid=3982316391582790&luicode=10000198&_status_id=3982309310926836&lfid=1076031837287505_-_WEIBO_SECOND_PROFILE_WEIBO&lcardid=1076031837287505_-_WEIBO_SECOND_PROFILE_WEIBO_-_3982316391582790

我想的很简单,是不是可以利用深度学习来给照片加滤镜=_=

匿名用户

大家好像都很感兴趣的样子阿,有成果了(< 1%)发github.

-----------------------------------------------------------------------------------------------------------

前段时间和同学吹逼,谈到了DL可以做的图像增强。然后突发奇想,这个东西是不是可以用来做AV去码。

-----------------------------------------------------------------------------------------------------------

前段时间和同学吹逼,谈到了DL可以做的图像增强。然后突发奇想,这个东西是不是可以用来做AV去码。