第 5 章 Kafka producer 拦截器(interceptor)

5.1 拦截器原理

Producer 拦截器(interceptor)是在 Kafka 0.10 版本被引入的,主要用于实现 clients 端的定

制化控制逻辑。

对于 producer 而言,interceptor 使得用户在消息发送前以及 producer 回调逻辑前有机会

对消息做一些定制化需求,比如修改消息等。同时,producer 允许用户指定多个 interceptor

按序作用于同一条消息从而形成一个拦截链(interceptor chain)。Intercetpor 的实现接口是

org.apache.kafka.clients.producer.ProducerInterceptor,其定义的方法包括:

(1)configure(configs)

获取配置信息和初始化数据时调用。

(2)onSend(ProducerRecord):

该方法封装进 KafkaProducer.send 方法中,即它运行在用户主线程中。Producer 确保在

消息被序列化以及计算分区前调用该方法。用户可以在该方法中对消息做任何操作,但最好

保证不要修改消息所属的 topic 和分区,否则会影响目标分区的计算

(3)onAcknowledgement(RecordMetadata, Exception):

该方法会在消息被应答或消息发送失败时调用,并且通常都是在 producer 回调逻辑触

发之前。onAcknowledgement 运行在 producer 的 IO 线程中,因此不要在该方法中放入很重

的逻辑,否则会拖慢 producer 的消息发送效率

(4)close:

关闭 interceptor,主要用于执行一些资源清理工作

如前所述,interceptor 可能被运行在多个线程中,因此在具体实现时用户需要自行确保

线程安全。另外倘若指定了多个 interceptor,则 producer 将按照指定顺序调用它们,并仅仅

是捕获每个 interceptor 可能抛出的异常记录到错误日志中而非在向上传递。这在使用过程中

要特别留意。

5.2 拦截器案例

1)需求:

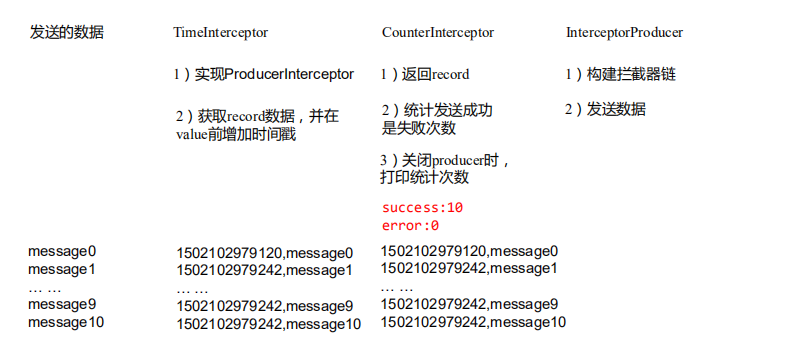

实现一个简单的双 interceptor 组成的拦截链。第一个 interceptor 会在消息发送前将时间

戳信息加到消息 value 的最前部;第二个 interceptor 会在消息发送后更新成功发送消息数或

失败发送消息数。

Kafka拦截器

2)案例实操

(1)增加时间戳拦截器

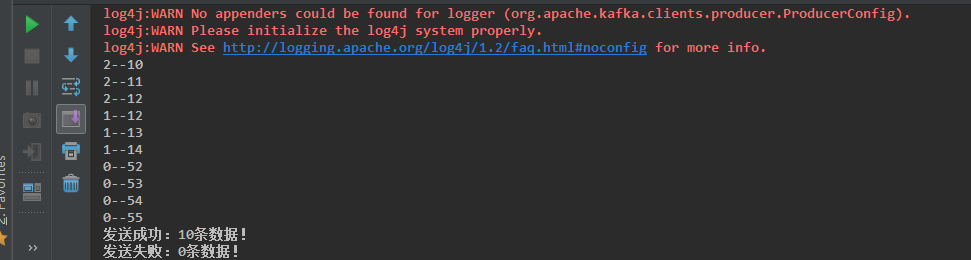

package com.atlxl.producer; import org.apache.kafka.clients.Metadata; import org.apache.kafka.clients.producer.*; import java.util.ArrayList; import java.util.Properties; public class CustomerProducer { public static void main(String[] args) { //配置信息 Properties props = new Properties(); // Kafka 服务端的主机名和端口号 props.put("bootstrap.servers", "hadoop102:9092"); // 等待所有副本节点的应答 props.put(ProducerConfig.ACKS_CONFIG, "all"); // 消息发送最大尝试次数(应答级别 ) props.put("retries", 0); // 一批消息处理大小 props.put("batch.size", 16384); // 请求延时 props.put("linger.ms", 1); // 发送缓存区内存大小 props.put("buffer.memory", 33554432); // key 序列化 props.put("key.serializer", "org.apache.kafka.common.serialization.StringSerializer"); // value 序列化 props.put("value.serializer", "org.apache.kafka.common.serialization.StringSerializer"); ArrayList<String> list = new ArrayList<>(); list.add("com.atlxl.intercetor.TimeIntercetor"); list.add("com.atlxl.intercetor.CountIntercetor"); props.put(ProducerConfig.INTERCEPTOR_CLASSES_CONFIG, list); // props.put("partitioner.class", "com.atlxl.producer.CustomerPartitioner"); KafkaProducer<String, String> producer = new KafkaProducer(props); for (int i = 0; i < 10; i++) { producer.send(new ProducerRecord<String, String>("second", String.valueOf(i)), new Callback() { public void onCompletion(RecordMetadata recordMetadata, Exception e) { if (e == null) { System.out.println(recordMetadata.partition() + "--" + recordMetadata.offset()); }else { System.out.println("发送失败!"); } } }); } //关闭资源 producer.close(); } }

package com.atlxl.intercetor; import org.apache.kafka.clients.producer.ProducerInterceptor; import org.apache.kafka.clients.producer.ProducerRecord; import org.apache.kafka.clients.producer.RecordMetadata; import java.util.Map; public class TimeIntercetor implements ProducerInterceptor<String,String> { @Override public ProducerRecord<String, String> onSend(ProducerRecord<String, String> record) { return new ProducerRecord<>(record.topic(),record.key(),System.currentTimeMillis() + "," + record.value()); } @Override public void onAcknowledgement(RecordMetadata metadata, Exception exception) { } @Override public void close() { } @Override public void configure(Map<String, ?> configs) { } }

package com.atlxl.intercetor; import org.apache.kafka.clients.producer.ProducerInterceptor; import org.apache.kafka.clients.producer.ProducerRecord; import org.apache.kafka.clients.producer.RecordMetadata; import java.util.Map; public class CountIntercetor implements ProducerInterceptor<String,String> { private int successCount = 0; private int errorCount = 0; @Override public ProducerRecord<String, String> onSend(ProducerRecord<String, String> record) { return record; } @Override public void onAcknowledgement(RecordMetadata metadata, Exception exception) { if (exception==null) { successCount++; } else { errorCount++; } } @Override public void close() { System.out.println("发送成功:" + successCount + "条数据!"); System.out.println("发送失败:" + errorCount + "条数据!"); } @Override public void configure(Map<String, ?> configs) { } }

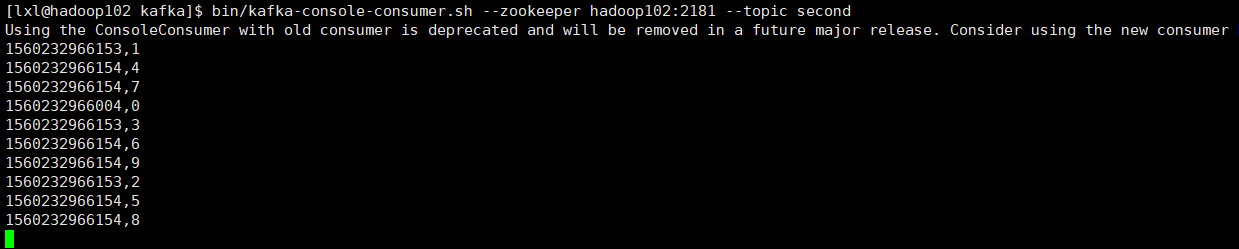

[lxl@hadoop102 kafka]$ bin/kafka-console-consumer.sh --zookeeper hadoop102:2181 --topic second