Local 模式:

1.概述:

Local模式就是运行在一台计算机上的模式,通常就是用于在本机上练手和测试。

它可以通过以下集中方式设置Master。

local: 所有计算都运行在一个线程当中,没有任何并行计算,通常我们在本机执行

一些测试代码,或者练手,就用这种模式;

local[K]: 指定使用几个线程来运行计算,比如local[4]就是运行4个Worker线程。通

常我们的Cpu有几个Core,就指定几个线程,最大化利用Cpu的计算能力;

local[*]: 这种模式直接帮你按照Cpu最多Cores来设置线程数了。

官方求 PI 案例:

[lxl@hadoop102 spark]$ bin/spark-submit --class org.apache.spark.examples.SparkPi --executor-memory 1G --total-executor-cores 2 ./examples/jars/spark-examples_2.11-2.1.1.jar

100

(1)基本语法

bin/spark-submit --class --master --deploy-mode --conf = ... # other options [application-arguments]

(2)参数说明:

--master 指定 Master 的地址,默认为 Local --class: 你的应用的启动类 (如 org.apache.spark.examples.SparkPi) --deploy-mode: 是否发布你的驱动到 worker 节点(cluster) 或者作为一个本地客户端 (client) (default: client)* --conf: 任意的 Spark 配置属性, 格式 key=value. 如果值包含空格,可以加引号 “key=value” application-jar: 打包好的应用 jar,包含依赖. 这个URL 在集群中全局可见。 比如hdfs:// 共享存储系统, 如果是 file:// path, 那么所有的节点的path 都包含同样的 jar application-arguments: 传给 main()方法的参数 --executor-memory 1G 指定每个 executor 可用内存为 1G --total-executor-cores 2 指定每个 executor 使用的 cup 核数为 2 个

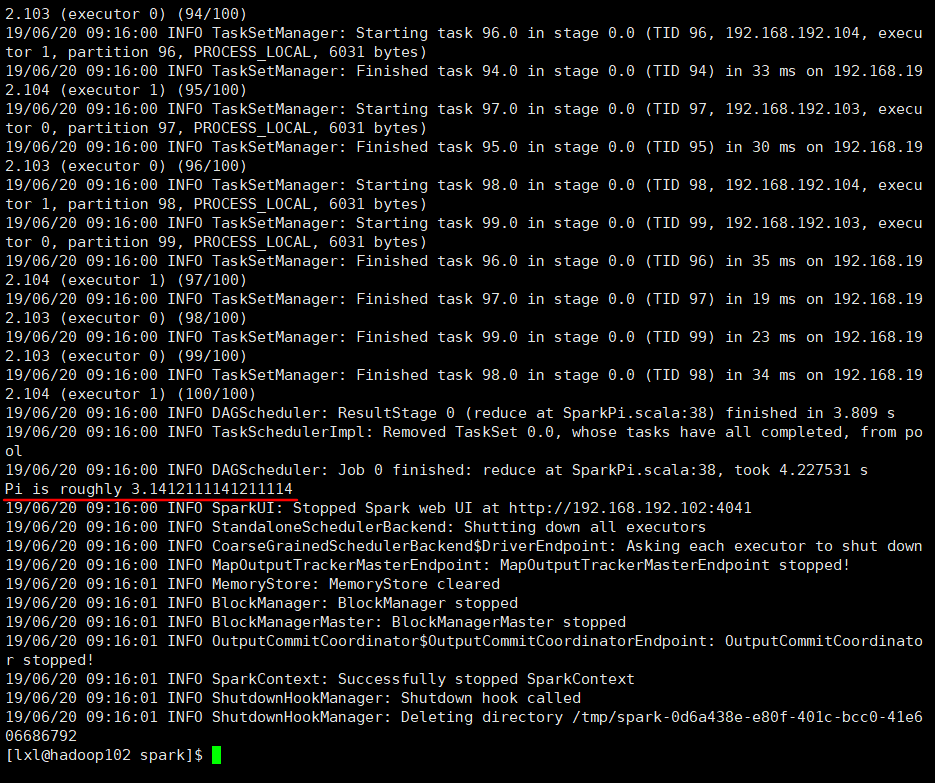

3) 结果展示

该算法是利用蒙特·卡罗算法求PI

4)准备文件

[lxl@hadoop102 spark]$ mkdir input

在 input 下创建 2 个文件 1.txt 和 2.txt,并输入以下内容

hello atguigu

hello spark

5)启动 spark-shell

[lxl@hadoop102 spark]$ bin/spark-shell

开启另一个 CRD 窗口

[lxl@hadoop102 ~]$ jps

Worker

SparkSubmit

CoarseGrainedExecutorBackend

Master

Jps

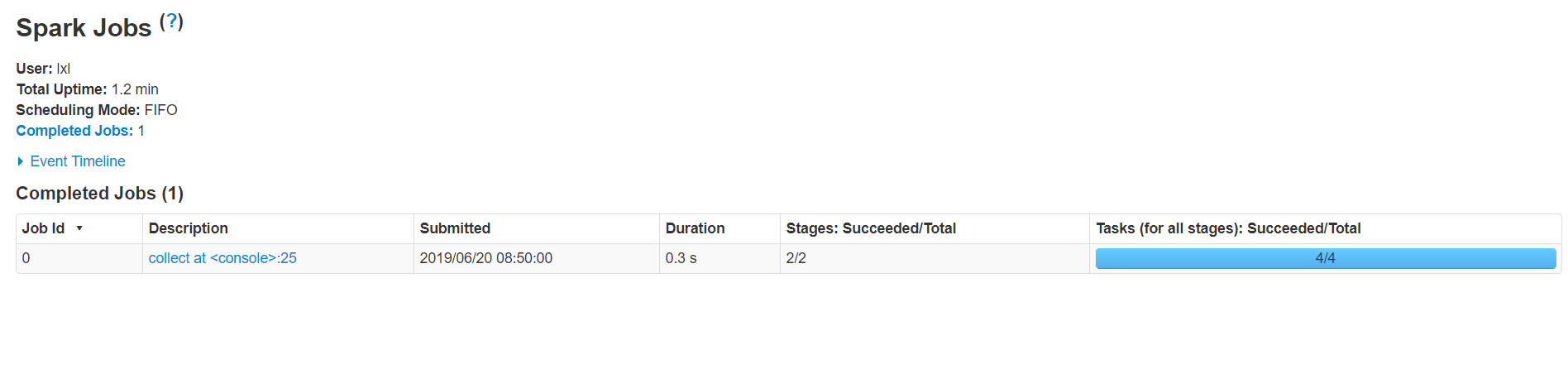

可登录 hadoop102:4040 查看程序运行:

6)运行 WordCount 程序

scala>sc.textFile("input").flatMap(_.split(" ")).map((_,1)).reduceByKey(_+_).collect res0: Array[(String, Int)] = Array((hello,4), (atguigu,2), (spark,2))

可登录 hadoop102:4040 查看程序运行

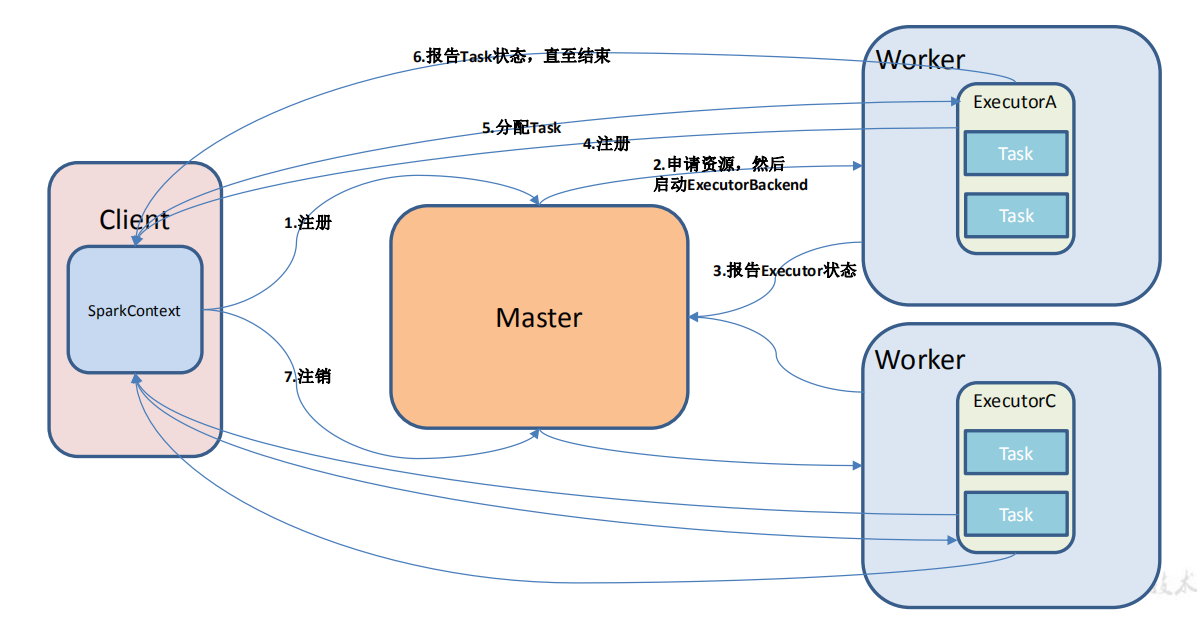

2.提交流程

1)提交任务分析:

Spark通用运行简易流程 :

重要角色:

Driver(驱动器)

Spark 的驱动器是执行开发程序中的 main 方法的进程。它负责开发人员编写的用来创

建 SparkContext、创建 RDD,以及进行 RDD 的转化操作和行动操作代码的执行。如果你

是用 spark shell,那么当你启动 Spark shell 的时候,系统后台自启了一个 Spark 驱动器程

序,就是在 Spark shell 中预加载的一个叫作 sc 的 SparkContext 对象。如果驱动器程序终

止,那么 Spark 应用也就结束了。主要负责:

1)把用户程序转为任务

2)跟踪 Executor 的运行状况

3)为执行器节点调度任务

4)UI 展示应用运行状况

Executor(执行器)

Spark Executor 是一个工作进程,负责在 Spark 作业中运行任务,任务间相互独立。

Spark 应用启动时,Executor 节点被同时启动,并且始终伴随着整个 Spark 应用的生命周

期而存在。如果有 Executor 节点发生了故障或崩溃,Spark 应用也可以继续执行,会将出

错节点上的任务调度到其他 Executor 节点上继续运行。主要负责:

1)负责运行组成 Spark 应用的任务,并将结果返回给驱动器进程;

2)通过自身的块管理器(Block Manager)为用户程序中要求缓存的 RDD 提供内存式

存储。RDD 是直接缓存在 Executor 进程内的,因此任务可以在运行时充分利用缓存数据加

速运算。

3.数据流程

textFile("input"):读取本地文件 input 文件夹数据;

flatMap(_.split(" ")):压平操作,按照空格分割符将一行数据映射成一个个单词;

map((_,1)):对每一个元素操作,将单词映射为元组;

reduceByKey(_+_):按照 key 将值进行聚合,相加;

collect:将数据收集到 Driver 端展示。

WordCount案例分析:

Standalone 模式

1.概述

构建一个由 Master+Slave 构成的 Spark 集群,Spark 运行在集群中。

Standalone运行模式介绍

2.安装使用

1)进入 spark 安装目录下的 conf 文件夹

[lxl@hadoop102 module]$ cd spark/conf/

2)修改配置文件名称

[lxl@hadoop102 conf]$ mv slaves.template slaves [lxl@hadoop102 conf]$ mv spark-env.sh.template spark-env.sh

3)修改 slave 文件,添加 work 节点:

[lxl@hadoop102 conf]$ vim slaves

hadoop102

hadoop103

hadoop104

4)修改 spark-env.sh 文件,添加如下配置:

[lxl@hadoop102 conf]$ vim spark-env.sh SPARK_MASTER_HOST=hadoop102 SPARK_MASTER_PORT=7077

5)配置JAVA_HOME

[lxl@hadoop102 sbin]$ vi spark-config.sh

export JAVA_HOME=/opt/module/jdk1.8.0_144

6)分发 spark 包

[lxl@hadoop102 module]$ xsync spark/

7)启动

[lxl@hadoop102 spark]$ sbin/start-all.sh [lxl@hadoop102 spark]$ util.sh ================lxl@hadoop102================ 3330 Jps 3238 Worker 3163 Master ================lxl@hadoop103================ 2966 Jps 2908 Worker ================lxl@hadoop104================ 2978 Worker 3036 Jps

7)官方求 PI 案例

[lxl@hadoop102 spark]$ bin/spark-submit --class org.apache.spark.examples.SparkPi --master spark://hadoop102:7077 --executor-memory 1G --total-executor-cores 2 ./examples/jars/spark-examples_2.11-2.1.1.jar 100

8)启动 spark shell

/opt/module/spark/bin/spark-shell --master spark://hadoop102:7077 --executor-memory 1g --total-executor-cores 2

参数:--master spark://hadoop102:7077 指定要连接的集群的 master

执行 WordCount 程序

scala> sc.textFile("./RELEASE").flatMap(_.split(" ")).map((_,1)).reduceByKey(_+_).collect res10: Array[(String, Int)] = Array((-Psparkr,1), (Build,1), (built,1), (2.1.1,1), (-Phive-thriftserver,1), (-Pmesos,1), (2.7.3,1), (-Phadoop-2.7,1), (Spark,1), (-Pyarn,1), (-DzincPort=3036,1), (flags:,1), (for,1), (-Phive,1), (Hadoop,1))

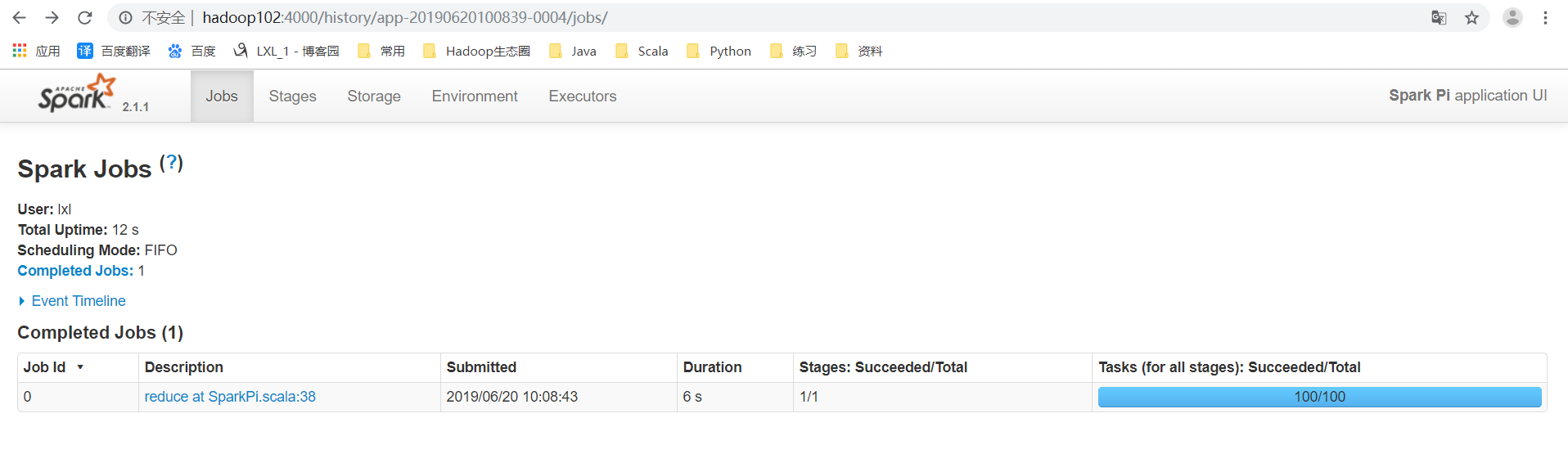

3.JobHistoryServer 配置

1)修改 spark-default.conf.template 名称

[lxl@hadoop102 conf]$ mv spark-defaults.conf.template spark-defaults.conf

2)修改 spark-default.conf 文件,开启 Log:

[lxl@hadoop102 conf]$ vi spark-defaults.conf spark.eventLog.enabled true spark.eventLog.dir hdfs://hadoop102:9000/directory

注意:HDFS 上的目录需要提前存在。

启动HDFS:

[lxl@hadoop102 conf]$ start-dfs.sh

创建 directory 目录:

[lxl@hadoop102 spark]$ hadoop fs -mkdir /directory

3)修改 spark-env.sh 文件,添加如下配置:

[lxl@hadoop102 conf]$ vi spark-env.sh

export SPARK_HISTORY_OPTS="-Dspark.history.ui.port=4000 -Dspark.history.retainedApplications=30 -Dspark.history.fs.logDirectory=hdfs://hadoop102:9000/directory"

参数描述:

spark.eventLog.dir:Application 在运行过程中所有的信息均记录在该属性指定的路径下

spark.history.ui.port=4000 WEBUI 访问的端口号为 4000

spark.history.fs.logDirectory=hdfs://hadoop102:9000/directory 配置了该属性后,在 start

history-server.sh 时就无需再显式的指定路径,Spark History Server 页面只展示该指定路径

下的信息

spark.history.retainedApplications=30 指定保存 Application 历史记录的个数,如果超过

这个值,旧的应用程序信息将被删除,这个是内存中的应用数,而不是页面上显示的应用

数。

4)分发配置文件

[lxl@hadoop102 conf]$ xsync spark-defaults.conf [lxl@hadoop102 conf]$ xsync spark-env.sh

5)启动历史服务

[lxl@hadoop102 spark]$ sbin/start-history-server.sh

6)执行任务

[lxl@hadoop102 spark]$ bin/spark-submit --class org.apache.spark.examples.SparkPi --master spark://hadoop102:7077 --executor-memory 1G --total-executor-cores 2 ./examples/jars/spark-examples_2.11-2.1.1.jar 100

7)查看历史服务

hadoop102:4000

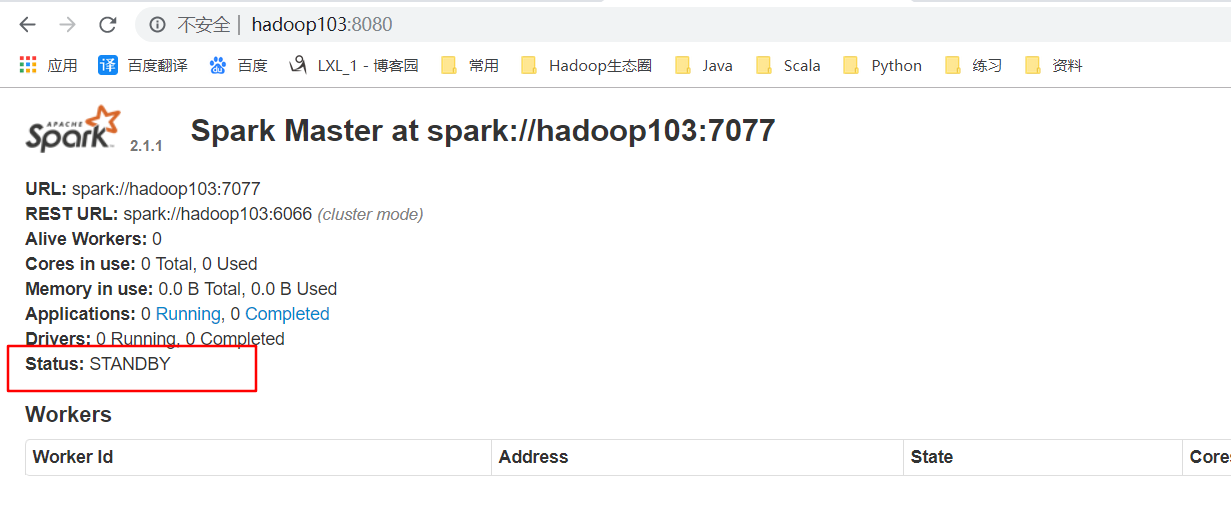

HA 配置

1)zookeeper 正常安装并启动

[lxl@hadoop102 spark]$ zkstart.sh

最好查看以下是否启动成功(服务器出现 leader 或者 follower 即可)

[lxl@hadoop102 spark]$ ../zookeeper-3.4.10/bin/zkServer.sh status ZooKeeper JMX enabled by default Using config: /opt/module/zookeeper-3.4.10/bin/../conf/zoo.cfg Mode: follower

2)修改 spark-env.sh 文件添加如下配置:

[lxl@hadoop102 conf]$ vi spark-env.sh 注释掉如下内容: #SPARK_MASTER_HOST=hadoop102 #SPARK_MASTER_PORT=7077 添加上如下内容: export SPARK_DAEMON_JAVA_OPTS="-Dspark.deploy.recoveryMode=ZOOKEEPER -Dspark.deploy.zookeeper.url=hadoop102,hadoop103,hadoop104 -Dspark.deploy.zookeeper.dir=/spark"

3)分发配置文件

[lxl@hadoop102 conf]$ xsync spark-env.sh

4)重新在 hadoop102 上启动全部节点

[lxl@hadoop102 spark]$ sbin/stop-all.sh

[lxl@hadoop102 spark]$ sbin/start-all.sh

5)在 hadoop103 上单独启动 master 节点

[lxl@hadoop103 spark]$ sbin/start-master.sh

6)spark HA 集群访问

/opt/module/spark/bin/spark-shell --master spark://hadoop102:7077,hadoop103:7077 --executor-memory 2g --total-executor-cores 2

[lxl@hadoop102 spark]$ util.sh ================ lxl@hadoop102 ================ 5363 Worker 5273 Master 4569 HistoryServer 5562 Jps 4956 QuorumPeerMain 4125 NameNode ================ lxl@hadoop103 ================ 3554 Master 3398 Worker 2953 DataNode 3245 QuorumPeerMain 3631 Jps ================ lxl@hadoop104 ================ 3042 SecondaryNameNode 3685 Jps 3560 Worker 2952 DataNode 3391 QuorumPeerMain

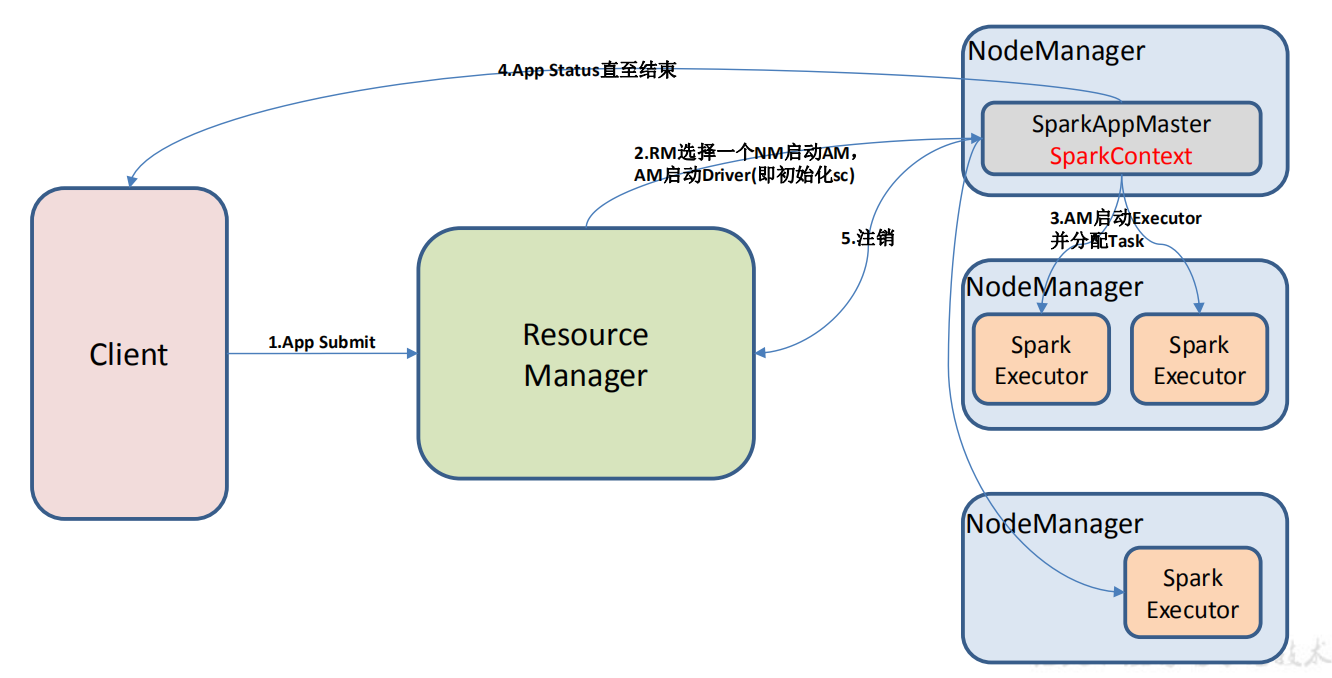

Yarn 模式

1 概述

Spark 客户端直接连接 Yarn,不需要额外构建 Spark 集群。有 yarn

client 和 yarn-cluster 两种模式,主要区别在于:Driver 程序的运行节点。

yarn-client:Driver 程序运行在客户端,适用于交互、调试,希望立即看到 app 的输出

yarn-cluster:Driver 程序运行在由 RM(ResourceManager)启动的 AP(APPMaster)

适用于生产环境。

Yarn运行模式介绍

2 安装使用

1)修改 hadoop 配置文件 yarn-site.xml,添加如下内容:

<!--是否启动一个线程检查每个任务正使用的物理内存量,如果任务超出分配值,则直接将其杀掉,默认是 true --> <property> <name>yarn.nodemanager.pmem-check-enabled</name> <value>false</value> </property> <!--是否启动一个线程检查每个任务正使用的虚拟内存量,如果任务超出分配值,则直接将其杀掉,默认是 true --> <property> <name>yarn.nodemanager.vmem-check-enabled</name> <value>false</value> </property>

2)修改 spark-env.sh,添加如下配置:

[lxl@hadoop102 conf]$ vi spark-env.sh YARN_CONF_DIR=/opt/module/hadoop-2.7.2/etc/hadoop HADOOP_CONF_DIR=/opt/module/hadoop-2.7.2/etc/hadoop #默认采用hdfs文件系统

3)分发配置文件

[lxl@hadoop102 conf]$ xsync /opt/module/hadoop-2.7.2/etc/hadoop/yarn-site.xml [lxl@hadoop102 conf]$ xsync spark-env.sh

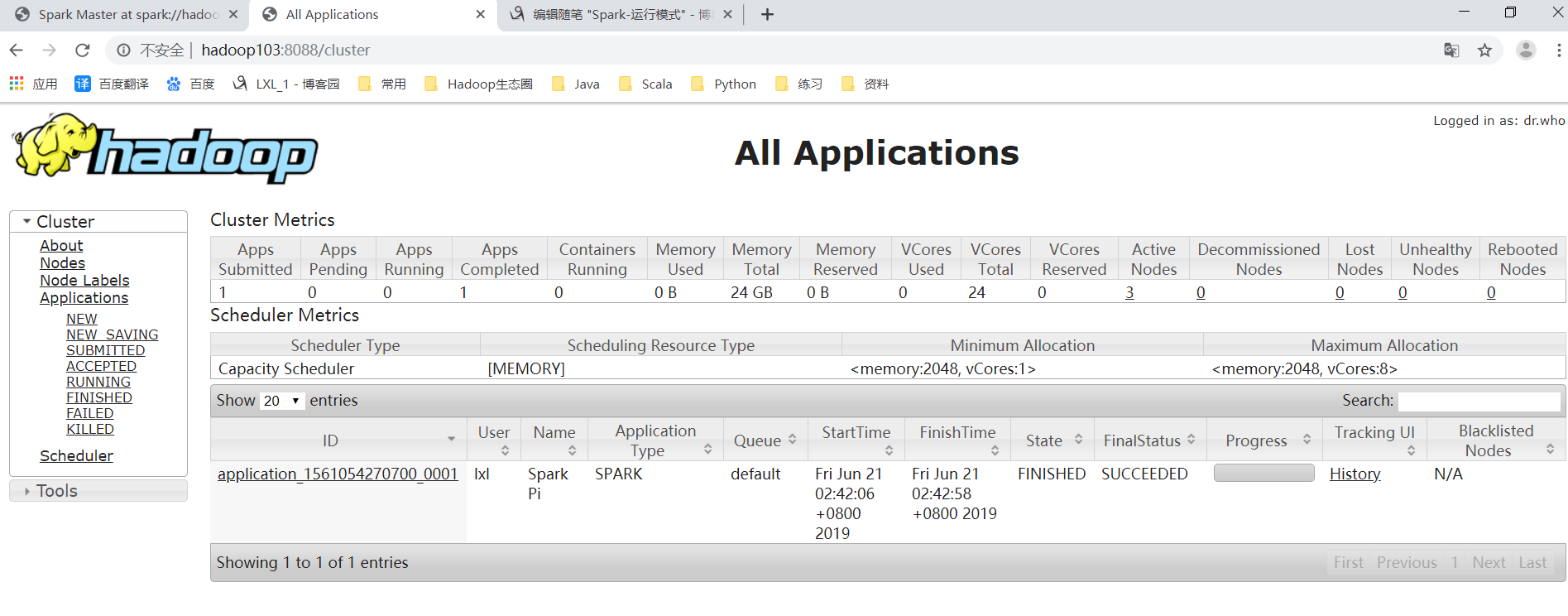

4)先启动 Yarn:执行一个程序

[lxl@hadoop102 spark]$ bin/spark-submit --class org.apache.spark.examples.SparkPi --master yarn --deploy-mode client ./examples/jars/spark-examples_2.11-2.1.1.jar 100

注意:在提交任务之前需启动 HDFS 以及 YARN 集群。

4)Web 页面查看日志

Mesos 模式

Spark 客户端直接连接 Mesos;不需要额外构建 Spark 集群。国内应用比较少,更多的

是运用 yarn 调度。

几种模式对比