codec实现了一种压缩-解压缩算法,在Hadoop中,一个对CompressionCodec接口的实现代表一个codec

CompressionCodec接口包含两个函数

如果要对写入输出数据流的数据进行压缩,可用createOutputStream(OutputStream out)方法在底层的数据流中对需要以压缩格式写入的数据新建一个CompressionOutputStream对象

对输入数据流中读取的数据进行解压缩的时候,则调用createInputStream(InputStream in)获取CompressionInputStream,可通过该方法从底层数据

流读取解压后的数据

程序如下:

package com.lcy.hadoop.examples;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.io.IOUtils;

import org.apache.hadoop.io.compress.CompressionCodec;

import org.apache.hadoop.io.compress.CompressionOutputStream;

import org.apache.hadoop.util.ReflectionUtils;

public class StreamCompressor {

public static void main(String[] args) throws Exception{

// TODO Auto-generated method stub

String codecClassname=args[0];

Class<?> codecClass=Class.forName(codecClassname);

Configuration conf=new Configuration();

CompressionCodec codec=(CompressionCodec)ReflectionUtils.newInstance(codecClass, conf);

CompressionOutputStream out=codec.createOutputStream(System.out);

IOUtils.copyBytes(System.in, out, 4096,false);

out.finish();

}

}

使用ReflectionUtils新建一个codec实例,并由此获得在System.out上支持压缩的一个包裹方法。

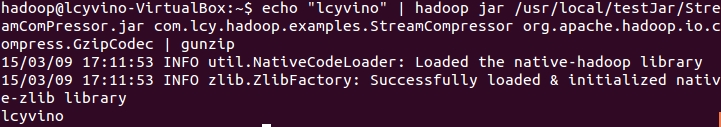

运行程序,输入如下命令:

hadoop@lcyvino-VirtualBox:~$ echo "lcyvino" | hadoop jar /usr/local/testJar/StreamComPressor.jar com.lcy.hadoop.examples.StreamCompressor org.apache.hadoop.io.compress.GzipCodec | gunzip

运行结果: