201116西瓜书机器学习系列---11、特征选择

一、总结

一句话总结:

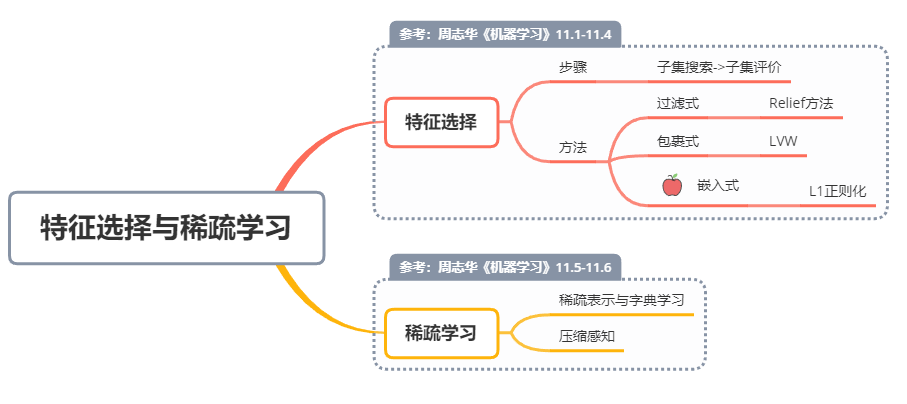

特征选择的【步骤】,特征选择的【方法】

1、稀疏学习?

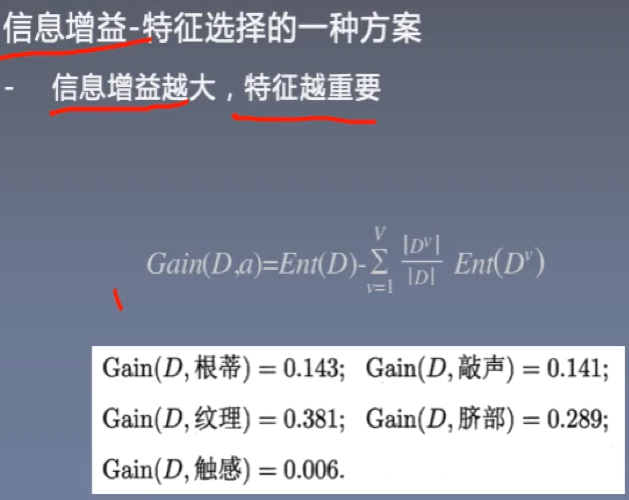

2、信息增益如何做特征选择?

【信息增益越大,特征越重要】

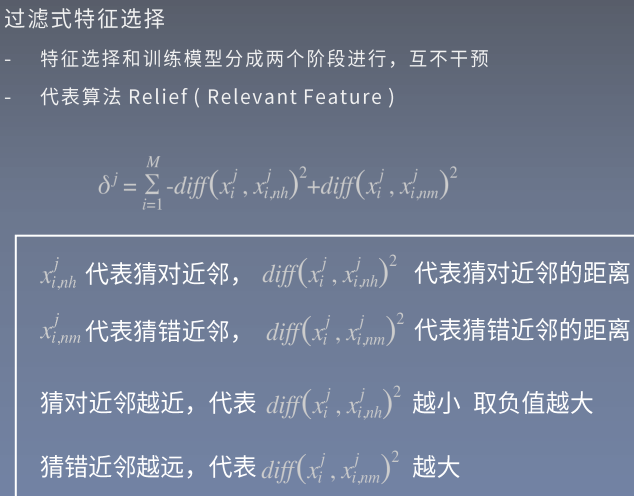

3、过滤式特征选择:代表算法Relief(Relevant Feature)?

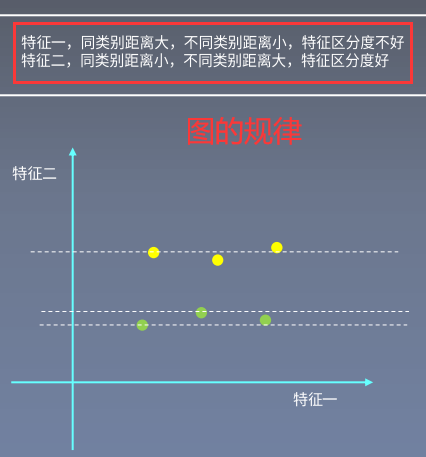

Relief原理:【能区分开目标的特征挑出来,区分不开目标的特征给它去掉】

$$delta ^ { j } = sum _ { i = 1 } ^ { M } - operatorname { diff } ( x _ { i } ^ { j } , x _ { i , n h } ^ { j } ) ^ { 2 } + operatorname { diff } ( x _ { i } ^ { j } , x _ { i , n i n } ^ { j } ) ^ { 2 }$$

4、L1正则化?

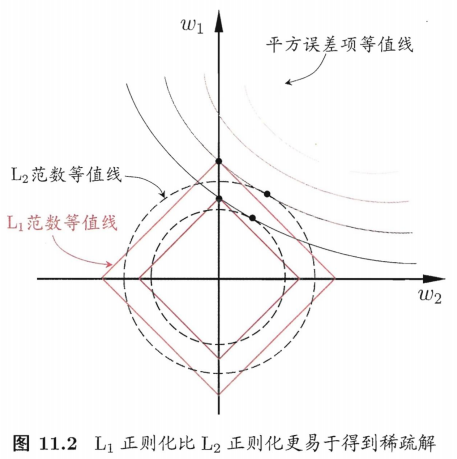

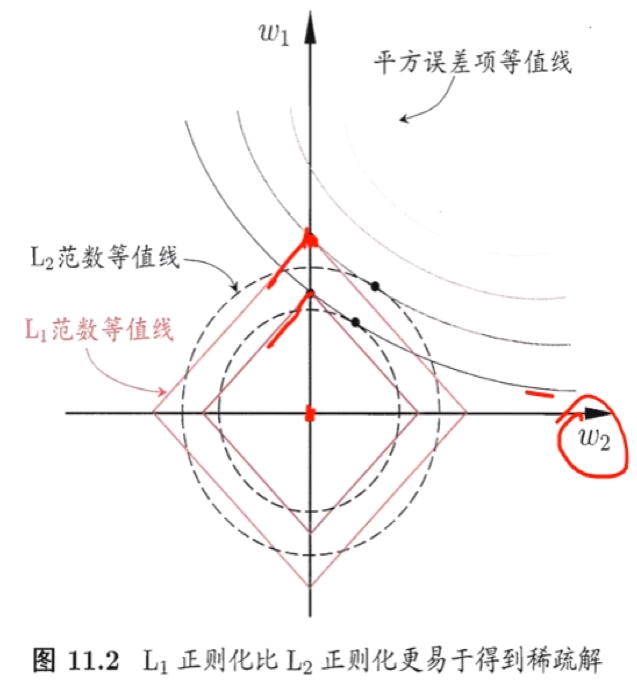

L1正则化使得W变的【稀疏】,L2正则化【使得W变的比较小】

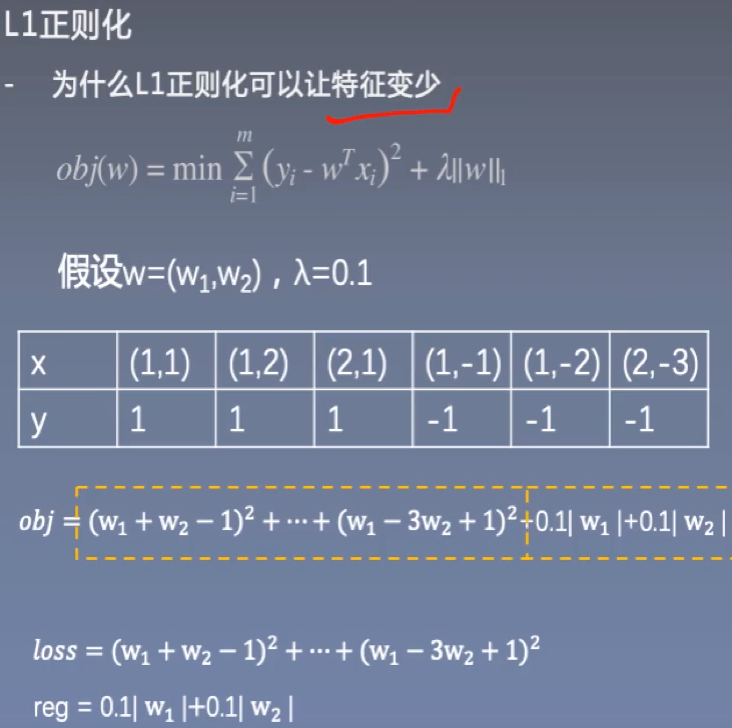

5、为什么L1正则化可以让特征变少(为什么L1正则化使得W变的稀疏)?

$$operatorname { obj } ( w ) = min sum _ { i = 1 } ^ { m } ( y _ { i } - w ^ { T } x _ { i } ) ^ { 2 } + lambda | w | _ { 1 }$$

【L1正则化交点常在坐标轴上】,这样【某个特征值就会为0】,表示这个特征没影响,而【L2正则化的交点常不在坐标轴上】,看图非常好理解

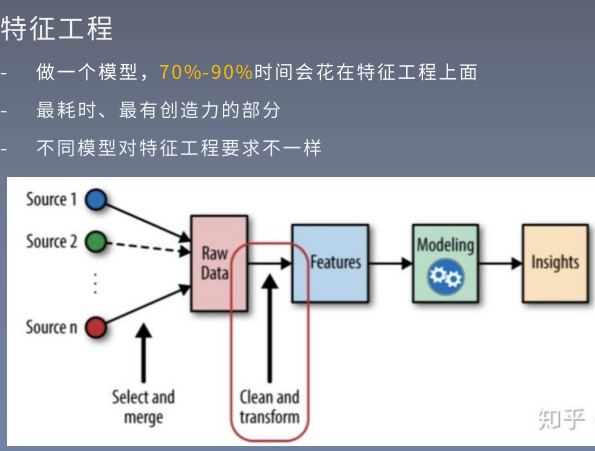

6、特征工程?

做一个模型,【70%-90%时间】会花在特征工程上面;【最耗时、最有创造力】的部分;【不同模型】对特征工程【要求不一样】;【cnn、dnn对特征工程要求较低】

二、特征选择

博客对应课程的视频位置: