CVPR2016

神经网络学习非线性关系的灵活性对于处理SR问题很合适。

1.文章想要解决的问题

如果在在网络之前通过插值的方法将LR图像上采样有两个缺点:一是计算复杂度;二是插值算法通常不会引入用于解决不适定重建问题的额外信息。而转置卷积进行上采样不过是插值方法的特殊情况。

2.解决的方法

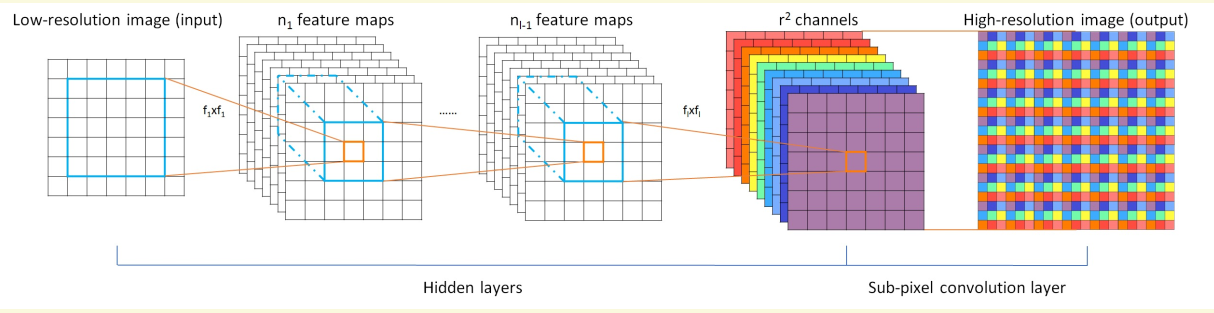

通过在最后一层引入efficient sub-pixel convolution layer来进行upscaling操作。这样做有两个好处:1.降低计算复杂度;2.以可学习的filter取代固定插值filter,而且这有利于更明确地从LR图像中学习。

1.这篇论文的主要假设是什么?(在什么情况下是有效的),这假设在现实中有多容易成立

LR图像是HR图像经过模糊(低通滤波器),下采样,加噪处理后的图像。

多数的高频信息是冗余的,因此可以通过低频部分准确地重建

2.在这些假设下,这篇论文有什么好处

1.由于输入神经网络的是LR图像,因此各层在LR空间进行。计算复杂度得到了大幅优化

2.可以学得的多个放大滤波器,而不是仅仅一个。重建精读更高。

3.这些好处主要表现在哪些公式的哪些项目的简化上。

将计算复杂度公式中的$S_{HR}$简化为$S_{LR}$

4.这一派的主要缺点有哪些