Motivation

实现快速和准确地抽取出视频中的语义片段

Proposed Method

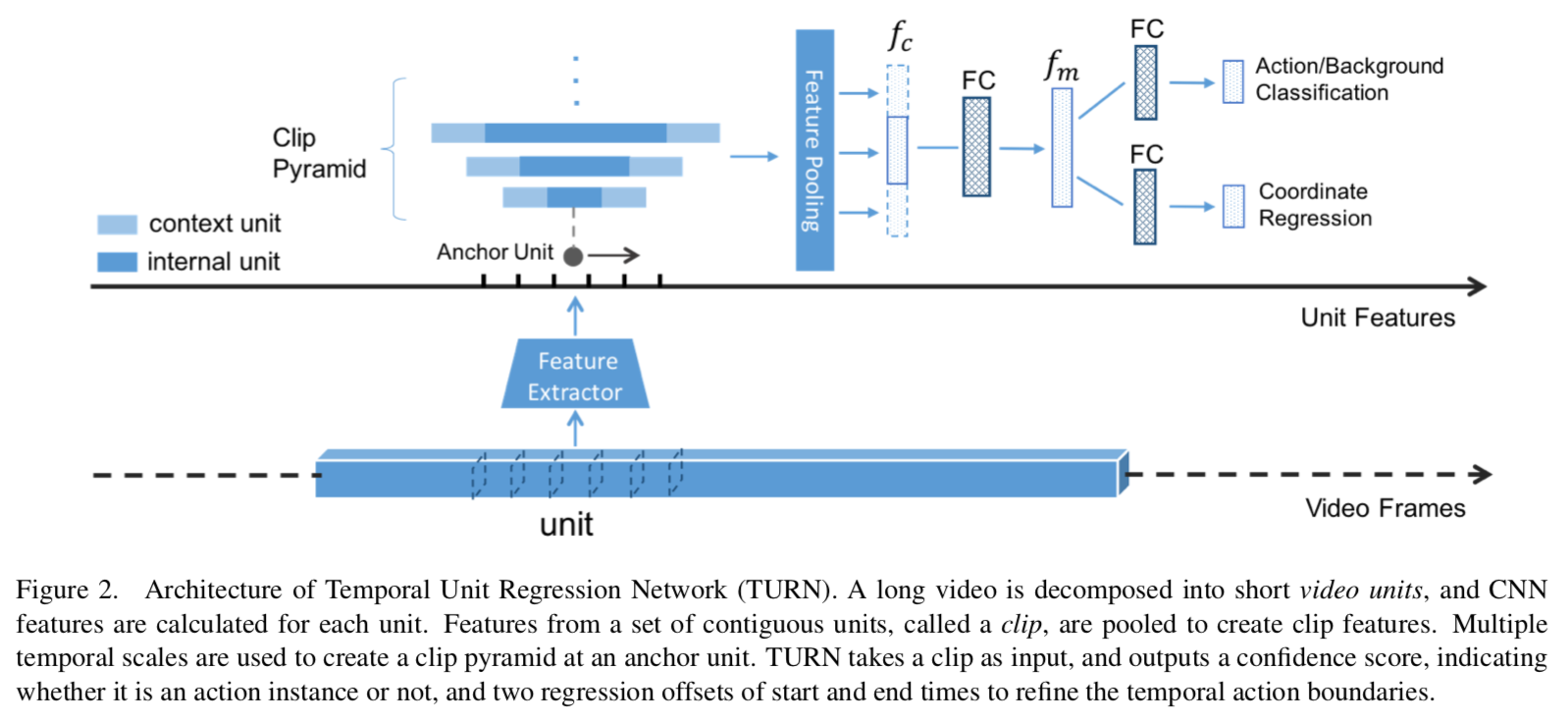

-提出了TURN模型预测proposal并用temporal coordinate regression来校正proposal的边界

-通过复用unit feature来实现快速计算

主要步骤如下:

-

Video Unit Processing:

将输入的视频平均分为多个video units,每一个unit包含16帧,源码给的feature是30fps的帧率。将每一个unit送入visual encoder(C3D)中,提取unit-level的特征。 -

Clip Pyramid Modeling:

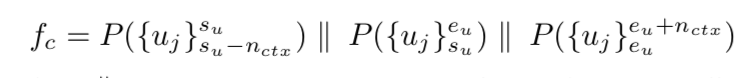

以每一个unit为anchor unit,构造一个clip pyramid。首先,每一个temporal window pyramid(深蓝色部分)由{1,2,4,…}个unit构成,然后在每个temporal window的前后加上一定数量的context unit(浅蓝色部分)构成clip。将每一个clip送入Feature Pooling,最终的feature由下面的公式表示:

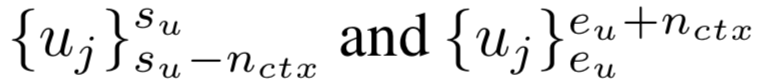

其中

为internal units,

为context units,P为Mean Pooling。

为context units,P为Mean Pooling。 - Unit-level Temporal Coordinate Regression:

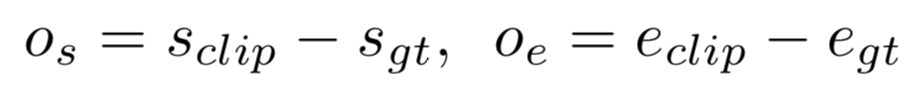

网络包含两个输出:第一个输出confidence score判断clip中是否包含action,第二个输出temporal coordinate regression offsets。回归偏移量由下式表达:

s和e分别表示起始unit和终止unit的位置 - Loss function:

正样本定义为:(1)与GT的tIoU最大的样本(2)与GT的tIoU大于0.5的样本

负样本定义为:与GT的tIoU为0的样本

Multi-task Loss:

第一项Lcls为分类Loss,用于对action/background做分类。

λ为trade-off系数

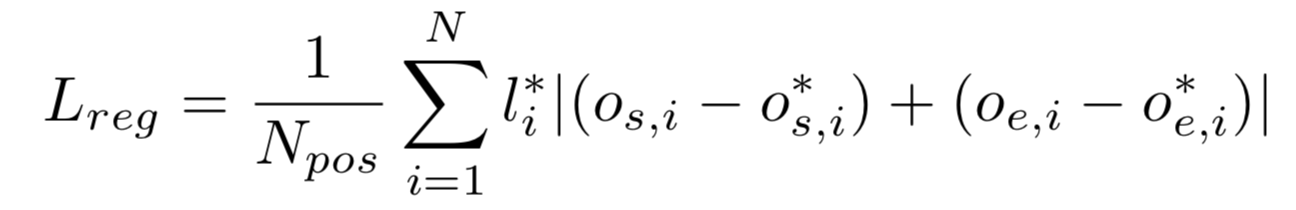

第二项为回归Loss,用于校正proposal的位置

- New metric:

本文提出了一种新的度量Aerage Recall vs. Frequency of retreived proposals (AR-F),F代表对从视频中提取proposal的频率(个/秒)

1 ## outputs[0:2] 判断是否为动作,outputs[2:4] 回归偏移 2 reg_end=clip_end+outputs[3]*unit_size 3 reg_start=clip_start+outputs[2]*unit_size 4 5 softmax_score=softmax(outputs[0:2]) 6 action_score=softmax_score[1]

Experiment Setup on THUMOS-14

context unit的数量为4,中间层fm的维度为1000,λ为2.0,temporal window pyramids的unit数为{1,2,4,8,16,32}。实验还测试了不同的unit size, u∈{16,32}。针对不同的unit feature也做了对比实验:C3D, optical flow based CNN feature, RGB CNN feature。在evaluation中,NMS的阈值比tIoU小0.1。

本文设计了3个实验:

1、对比不同的evaluation metrics并比较了各metrics与mAP的相关性

结论:

(1)AR-N不能够很好地反映TAP的表现

(2)AR-AN不能再不同的数据集进行性能比较

(3)AR-F则不存在上述问题

2、对比了不同visual feature对TURN性能的影响

(1)C3Dfeature,模型用Sports1m数据集预训练,将连续的16帧(一个unit)送入C3D,并提取fc6特征

(2)RGB CNN特征,从一个unit中均匀采8帧,提取ResNet中的Flatten_673特征(用Activity v1.3预训练),然后计算这8个feature的平均值作为这个unit的特征。

(3)dense flow CNN,在unit中间取连续的6帧并计算对应的光流,将flow送入BN-Inception(用Activity v1.3预训练)中,取global_pool特征

2、对比TURN和其他TAP方法的性能

对比方法包括:DAPs,SCNN-prop,Sparse-prop,sliding window,random proposals

3、对比不同的TAP方法在localization task中的性能(相同的classifier/localizer),即将生成的proposal送到classifier中,并得到21个类别的的confidence scores(20类action和1类background)

实验用到了SVM classifier和SCNN-Localizaer

Experiment Setup on ActivityNet

context unit的数量为4,λ为2.0,temporal window pyramids的unit数为{2,4,8,16,32,64,128}。实验还测试了不同的unit size, nu∈{16,32}。在evaluation中,NMS的阈值比tIoU小0.1。实验中的temporal action localizer用的是SVM,通过sports和works子集数据的two-stream CNN features 进行训练。

1、评估了TURN的泛化能力

(1)在v1.2数据集中,用了ActivityNet,ActivityNet⋂THUMOS14,ActivityNet<1024frames三种训练数据,对比了DAPs和TURN的泛化能力

(2)在v1.3数据集中,有两种训练策略:

- 在一个subset训练,在另外三个subsets测试

- 在四个subsets上训练,然后在每个subset中逐个测试

2、评估了TURN在temporal action localization task上的表现

在实验中用了ActivityNet v1.1的Works和Sports子集。本文选择TURN-FL-16(用dense flow feature训练得到)来生成proposals。先用two-stream CNN feature训练一个SVM,接着将TURN-FL-16生成的proposals送到SVM中进行分类

转自:AIvin2AI