1.什么是Celery

Celery是一个简单、灵活且可靠的,处理大量消息的分布式系统

专注于实时处理的异步任务队列

同时也支持任务调度

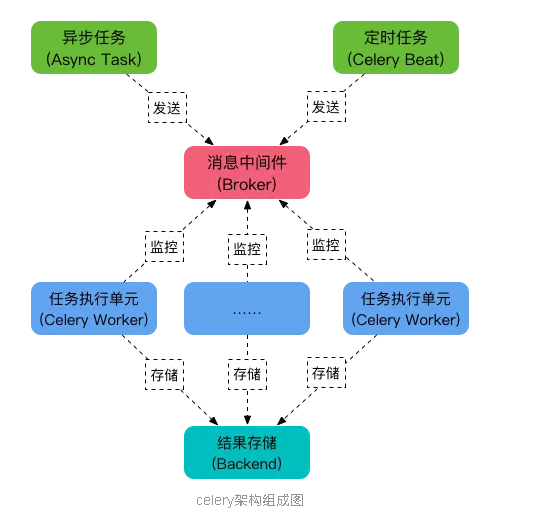

Celery架构

https://www.jianshu.com/p/86e11219ea7d

Celery的架构由三部分组成,消息中间件(message broker),任务执行单元(worker)和任务执行结果存储(task result store)组成。

消息中间件

Celery本身不提供消息服务,但是可以方便的和第三方提供的消息中间件集成。包括,RabbitMQ, Redis等等

任务执行单元

Worker是Celery提供的任务执行的单元,worker并发的运行在分布式的系统节点中。

任务结果存储

Task result store用来存储Worker执行的任务的结果,Celery支持以不同方式存储任务的结果,包括AMQP, redis等

版本支持情况

Celery version 4.0 runs on

Python ❨2.7, 3.4, 3.5❩

PyPy ❨5.4, 5.5❩

This is the last version to support Python 2.7, and from the next version (Celery 5.x) Python 3.5 or newer is required.

If you’re running an older version of Python, you need to be running an older version of Celery:

Python 2.6: Celery series 3.1 or earlier.

Python 2.5: Celery series 3.0 or earlier.

Python 2.4 was Celery series 2.2 or earlier.

Celery is a project with minimal funding, so we don’t support Microsoft Windows. Please don’t open any issues related to that platform.

2.使用场景

异步任务:将耗时操作任务提交给Celery去异步执行,比如发送短信/邮件、消息推送、音视频处理等等

定时任务:定时执行某件事情,比如每天数据统计

3.Celery的安装配置

pip install celery

消息中间件:RabbitMQ/Redis

app=Celery('任务名',backend='xxx',broker='xxx')

4.Celery执行异步任务

基本使用

创建项目celerytest

创建py文件:celery_app_task.py

import celery

import time

# broker='redis://127.0.0.1:6379/2' 不加密码

backend='redis://:123456@127.0.0.1:6379/1'

broker='redis://:123456@127.0.0.1:6379/2'

cel=celery.Celery('test',backend=backend,broker=broker)

创建py文件:add_task.py,添加任务

from celery_app_task import add

result = add.delay(4,5)# result不是函数执行返回的结果,它是一个对象

print(result.id)

创建py文件:run.py,执行任务,或者使用命令执行:celery worker -A celery_app_task -l info

注:windows下:celery worker -A celery_app_task -l info -P eventlet

from celery_app_task import cel

if __name__ == '__main__':

cel.worker_main()

# cel.worker_main(argv=['--loglevel=info')

创建py文件:result.py,查看任务执行结果

from celery.result import AsyncResult

from celery_app_task import cel

async = AsyncResult(id="e919d97d-2938-4d0f-9265-fd8237dc2aa3", app=cel)

if async.successful():

result = async.get()

print(result)

# result.forget() # 将结果删除

elif async.failed():

print('执行失败')

elif async.status == 'PENDING':

print('任务等待中被执行')

elif async.status == 'RETRY':

print('任务异常后正在重试')

elif async.status == 'STARTED':

print('任务已经开始被执行')

执行 add_task.py,添加任务,并获取任务ID

执行 run.py ,或者执行命令:celery worker -A celery_app_task -l info

执行 result.py,检查任务状态并获取结果

多任务结构

pro_cel

├── celery_task# celery相关文件夹

│ ├── celery.py # celery连接和配置相关文件,必须叫这个名字

│ └── tasks1.py # 所有任务函数

│ └── tasks2.py # 所有任务函数

├── check_result.py # 检查结果

└── send_task.py # 触发任务

celery.py

from celery import Celery

cel = Celery('celery_demo',

broker='redis://127.0.0.1:6379/1',

backend='redis://127.0.0.1:6379/2',

# 包含以下两个任务文件,去相应的py文件中找任务,对多个任务做分类

include=['celery_task.tasks1',

'celery_task.tasks2'

])

# 时区

cel.conf.timezone = 'Asia/Shanghai'

# 是否使用UTC

cel.conf.enable_utc = False

tasks1.py

import time

from celery_task.celery import cel

res1=os.popen('phddns reset')

print(res1)

res2 = os.popen('phddns restart')

print(res2)

return "test_celery11任务结果:%s,%s"%(res1,res2)

tasks2.py

import time

from celery_task.celery import cel

check_result.py

from celery.result import AsyncResult

from celery_task.celery import cel

async = AsyncResult(id="08eb2778-24e1-44e4-a54b-56990b3519ef", app=cel)

if async.successful():

result = async.get()

print(result)

# result.forget() # 将结果删除,执行完成,结果不会自动删除

# async.revoke(terminate=True) # 无论现在是什么时候,都要终止

# async.revoke(terminate=False) # 如果任务还没有开始执行呢,那么就可以终止。

elif async.failed():

print('执行失败')

elif async.status == 'PENDING':

print('任务等待中被执行')

elif async.status == 'RETRY':

print('任务异常后正在重试')

elif async.status == 'STARTED':

print('任务已经开始被执行')

send_task.py

from celery_task.tasks1 import test_celery

from celery_task.tasks2 import test_celery2

# 立即告知celery去执行test_celery任务,并传入一个参数

result = test_celery.delay('第一个的执行')

print(result.id)

result = test_celery2.delay('第二个的执行')

print(result.id)

添加任务(执行send_task.py),开启work:celery worker -A celery_task -l info -P eventlet,检查任务执行结果(执行check_result.py)

5.Celery执行定时任务

设定时间让celery执行一个任务

add_task.py

from celery_app_task import add

from datetime import datetime

# result=add(2,3)

# print(result)

# result不是函数执行返回的结果,它是一个对象

# result = add.delay(2, 3)

# print(result.id)

# 执行延迟任务

# 时间转换 方式一

# v1 = datetime(2019, 2, 13, 18, 19, 56) # 通过这个方式拿到一个时间对象,就是参数传的事件

# print(v1)

# v2 = datetime.utcfromtimestamp(v1.timestamp()) # 把当地时间转成utc

# print(v2)

# result = add.apply_async(args=[1, 3], eta=v2)

# print(result.id)

# 时间转换 方式二

ctime = datetime.now() # 取到当前时间

# 默认用utc时间 # 转成utc时间

utc_ctime = datetime.utcfromtimestamp(ctime.timestamp())

from datetime import timedelta

time_delay = timedelta(seconds=10) # 取一个10秒之后的事件

task_time = utc_ctime + time_delay #这个时间是当前时间往后推10s

# 使用apply_async并设定时间

result = add.apply_async(args=[4, 3], eta=task_time)

print(result.id)

类似于contab的定时任务

多任务结构中celery.py修改如下

from datetime import timedelta

from celery import Celery

from celery.schedules import crontab

cel = Celery('tasks', broker='redis://127.0.0.1:6379/1', backend='redis://127.0.0.1:6379/2', include=[

'celery_task.tasks1',

'celery_task.tasks2',

])

cel.conf.timezone = 'Asia/Shanghai'

cel.conf.enable_utc = False

cel.conf.beat_schedule = {

# 名字随意命名

'add-every-10-seconds': {

# 执行tasks1下的test_celery函数

'task': 'celery_task.tasks1.test_celery',

# 每隔2秒执行一次

# 'schedule': 1.0,

# 'schedule': crontab(minute="*/1"),

'schedule': timedelta(seconds=2),

# 传递参数

'args': ('test',)

},

# 'add-every-12-seconds': {

# 'task': 'celery_task.tasks1.test_celery',

# 每年4月11号,8点42分执行

# 'schedule': crontab(minute=42, hour=8, day_of_month=11, month_of_year=4),

# 'schedule': crontab(minute=42, hour=8, day_of_month=11, month_of_year=4),

# 'args': (16, 16)

# },

}

启动一个beat:celery beat -A celery_task -l info

启动work执行:celery worker -A celery_task -l info -P eventlet

6.Django中使用Celery

安装包

celery==3.1.25

django-celery==3.1.20

在项目目录下创建celeryconfig.py

import djcelery

djcelery.setup_loader()

CELERY_IMPORTS=(

'app01.tasks',

)

#有些情况可以防止死锁

CELERYD_FORCE_EXECV=True

# 设置并发worker数量

CELERYD_CONCURRENCY=4

#允许重试

CELERY_ACKS_LATE=True

# 每个worker最多执行100个任务被销毁,可以防止内存泄漏

CELERYD_MAX_TASKS_PER_CHILD=100

# 超时时间

CELERYD_TASK_TIME_LIMIT=12*30

在app01目录下创建tasks.py

from celery import task

视图函数views.py

from django.shortcuts import render,HttpResponse

from app01.tasks import add

from datetime import datetime

def test(request):

# result=add.delay(2,3)

ctime = datetime.now()

# 默认用utc时间

utc_ctime = datetime.utcfromtimestamp(ctime.timestamp())

from datetime import timedelta

time_delay = timedelta(seconds=5)

task_time = utc_ctime + time_delay

result = add.apply_async(args=[4, 3], eta=task_time)

print(result.id)

return HttpResponse('ok')

settings.py

INSTALLED_APPS = [

...

'djcelery',

'app01'

]

...

from djagocele import celeryconfig

BROKER_BACKEND='redis'

BOOKER_URL='redis://127.0.0.1:6379/1'

CELERY_RESULT_BACKEND='redis://127.0.0.1:6379/2'

crontab

添加任务

crontab -e 0 */1 * * * command 0 */2 * * * command

查询任务是否加了:

crontab -l -u root #查看root用户 0 */1 * * * command 0 */2 * * * comma

* * * * * command

分 时 日 月 周 命令

第2列表示小时1~23(0表示0点)

第3列表示日期1~31

第4列表示月份1~12

第5列标识号星期0~6(0表示星期天)

第6列要运行的命令

上面的例子表示每晚的21:30重启apache。

上面的例子表示每月1、10、22日的4 : 45重启apache。

上面的例子表示每周六、周日的1 : 10重启apache。

上面的例子表示在每天18 : 00至23 : 00之间每隔30分钟重启apache。

上面的例子表示每星期六的11 : 00 pm重启apache。

每一小时重启apache

晚上11点到早上7点之间,每隔一小时重启apache

每月的4号与每周一到周三的11点重启apache

一月一号的4点重启apache