集成学习方法是机器学习领域中用来提升分类算法准确率的技术,主要包括Bagging和Boosting即装袋和提升。

我们这主要讲述Boosting中代表性算法AdaBoost元算法

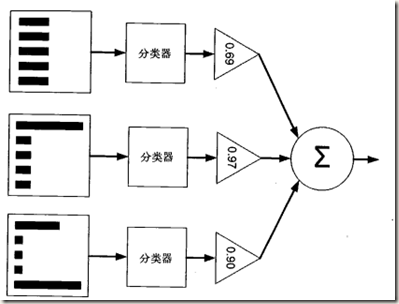

基于数据集多重抽样的分类器

前面介绍了K近邻算法、决策树算法、朴素贝叶斯算法、逻辑回归以及支持向量机

这些算法各有优缺点,我们自然可以将不同的分类器组合起来,这种组合的结果就被称为集成方法,有时也叫元算法。

集成也分几种:

1、不同算法的集成

2、同一种算法在不同设置下的集成

3、数据集的不同部分分配给不同分类器之后的集成。

本文主要关心一个最流行的版本AdaBoost

这个算法的主要思路:

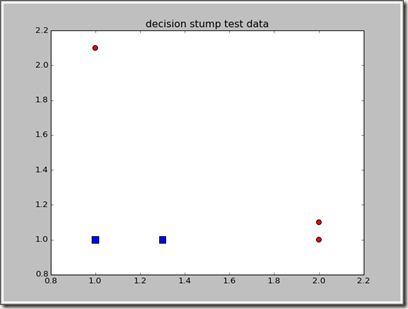

训练数据集中的每一个样本,并给每个样本赋予一个权重,权重初始化成相等值,这些权重形成向量D

首先在训练数据上训练出一个弱分类器并计算该分类器的错误率。

然后在同一个数据集上再次训练分类器,在这次训练过程中调整每个样本的权重,将第一次分对的样本的权重降低,第一次分错的样本权重提高。

最后给每一个分类器分配了一个权重值alpha,这些alpha值是基于每个弱分类器的错误率进行计算的。

我们一开始训练出一个弱分类器时,我们计算一下这个分类器的错误率。

错误率的计算就是未正确分类的样本数目除以所有样本数目

alpha = 0.5*ln((1-错误率)/错误率)

计算流程如下:

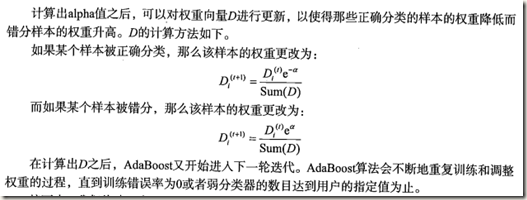

下面给出一个弱分类器单层决策树,通过这个单层决策树构建弱分类器。

导入数据:

from numpy import *

def loadSimpData():

datMat = matrix([[ 1. , 2.1],

[ 2. , 1.1],

[ 1.3, 1. ],

[ 1. , 1. ],

[ 2. , 1. ]])

classLabels = [1.0, 1.0, -1.0, -1.0, 1.0]

return datMat,classLabels

def showData():

import matplotlib

import matplotlib.pyplot as plt

xcord0 = []

ycord0 = []

xcord1 = []

ycord1 = []

markers =[]

colors =[]

datMat,classLabels = loadSimpData()

for i in range(len(classLabels)):

if (classLabels[i] ==1.0):

xcord1.append(datMat[i,0])

ycord1.append(datMat[i,1])

else:

xcord0.append(datMat[i,0])

ycord0.append(datMat[i,1])

fig = plt.figure()

ax = fig.add_subplot(111)

ax.scatter(xcord0,ycord0, marker='s', s=90)

ax.scatter(xcord1,ycord1, marker='o', s=50, c='red')

plt.title('decision stump test data')

plt.show()

运行:

>>> import adaBoost >>> adaBoost.showData()

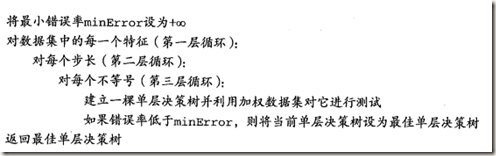

先构建一个训练一个简单的单层决策树

具体伪代码如下:

下面就是代码实现

def stumpClassify(dataMatrix,dimen,threshVal,threshIneq):#just classify the data retArray = ones((shape(dataMatrix)[0],1)) if threshIneq == 'lt': retArray[dataMatrix[:,dimen] <= threshVal] = -1.0 else: retArray[dataMatrix[:,dimen] > threshVal] = -1.0 return retArray def buildStump(dataArr,classLabels,D): dataMatrix = mat(dataArr); labelMat = mat(classLabels).T m,n = shape(dataMatrix)#5,2 numSteps = 10.0; bestStump = {}; bestClasEst = mat(zeros((m,1))) minError = inf #init error sum, to +infinity for i in range(n):#loop over all dimensions rangeMin = dataMatrix[:,i].min(); rangeMax = dataMatrix[:,i].max(); stepSize = (rangeMax-rangeMin)/numSteps print range(-1,int(numSteps)+1) for j in range(-1,int(numSteps)+1):#loop over all range in current dimension for inequal in ['lt', 'gt']: #go over less than and greater than threshVal = (rangeMin + float(j) * stepSize) predictedVals = stumpClassify(dataMatrix,i,threshVal,inequal)#call stump classify with i, j, lessThan errArr = mat(ones((m,1))) errArr[predictedVals == labelMat] = 0 weightedError = D.T*errArr #calc total error multiplied by D print "split: dim %d, thresh %.2f, thresh ineqal: %s, the weighted error is %.3f" % (i, threshVal, inequal, weightedError) if weightedError < minError: minError = weightedError bestClasEst = predictedVals.copy() bestStump['dim'] = i bestStump['thresh'] = threshVal bestStump['ineq'] = inequal return bestStump,minError,bestClasEst

这边有点问题,没有太看懂,下面这个AdaBoost算法还好,根据上面的思路整个过程是可以理解的,构建这个单层决策树有点问题。

下面给出AdaBoost算法:

def adaBoostTrainDS(dataArr,classLabels,numIt=40):

weakClassArr = []

m = shape(dataArr)[0]

D = mat(ones((m,1))/m) #init D to all equal

aggClassEst = mat(zeros((m,1)))

for i in range(numIt):

bestStump,error,classEst = buildStump(dataArr,classLabels,D)#build Stump

#print "D:",D.T

alpha = float(0.5*log((1.0-error)/max(error,1e-16)))#calc alpha, throw in max(error,eps) to account for error=0

bestStump['alpha'] = alpha

weakClassArr.append(bestStump) #store Stump Params in Array

#print "classEst: ",classEst.T

expon = multiply(-1*alpha*mat(classLabels).T,classEst) #exponent for D calc, getting messy

D = multiply(D,exp(expon)) #Calc New D for next iteration

D = D/D.sum()

#calc training error of all classifiers, if this is 0 quit for loop early (use break)

aggClassEst += alpha*classEst

#print "aggClassEst: ",aggClassEst.T

aggErrors = multiply(sign(aggClassEst) != mat(classLabels).T,ones((m,1)))

errorRate = aggErrors.sum()/m

print "total error: ",errorRate

if errorRate == 0.0: break

return weakClassArr,aggClassEst

这个算法就先放着,下面还有分类器的测试以及给出一个示例。

后续再好好理解,没有人讨论,遇到问题的时候刚开始还想着去解决,时间长了,慢慢的就没有这个精力,就想放着先不管。

目前也就先这样,把后续的算法可以理解的学习的先学习了,不好理解的,到状态好的时候一并解决。目前学习就先这个思路。下面看线性回归。