Zookeeper集群部署

Kafka集群部署

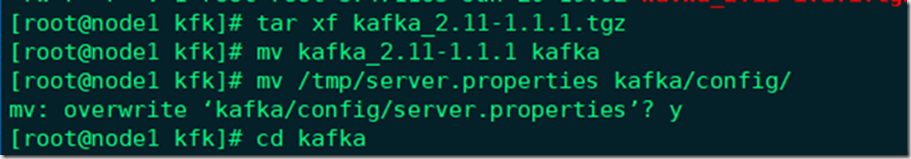

官网下载Kafka 安装包,解压安装:

http://kafka.apache.org/downloads.html

tar zxvf kafka_2.11-0.8.2.2.tgz mv kafka_2.11-0.8.2.2 kafka cd kafka

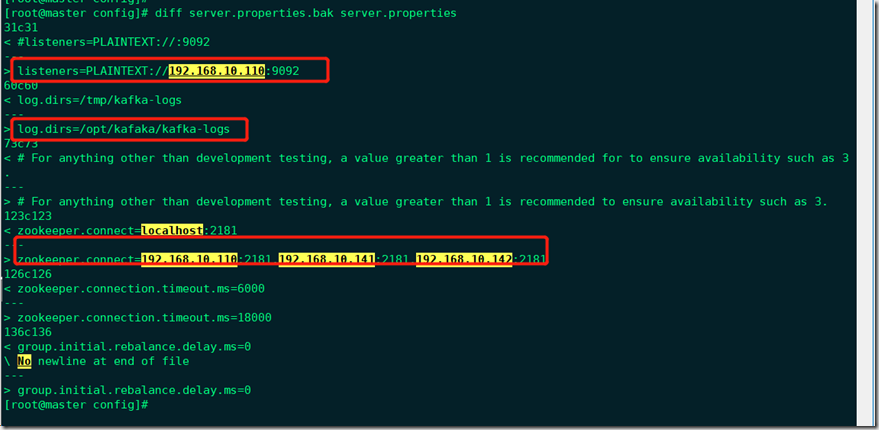

编辑配置文件

vim ./config/server.properties broker.id=1 # 确保集群中唯一即可 log.dirs=/opt/kafaka/kafka-log listeners=PLAINTEXT://192.168.10.110:9092 # 填写本机IP zookeeper.connect=192.168.10.110:2181,192.168.10.141:2181,192.168.10.142:2181 # zk信息

#将kafka文件夹复制到另外两台节点下

注意修改每个节点对应的server.properties文件的broker.id和listenrs

配置说明: broker.id:每个broker在集群中的唯一标识,正整数。当该服务器的ip地址发生变更,但broker.id未变,则不会影响consumers的消费情况 listeners:kafka的监听地址与端口,在实际测试中如果写0.0.0.0会报错。 num.network.threads:kafka用于处理网络请求的线程数 num.io.threads:kafka用于处理磁盘io的线程数 socket.send.buffer.bytes:发送数据的缓冲区 socket.receive.buffer.bytes:接收数据的缓冲区 socket.request.max.bytes:允许接收的最大数据包的大小(防止数据包过大导致OOM) log.dirs:kakfa用于保存数据的目录,所有的消息都会存储在该目录当中。可以通过逗号来指定多个路径,kafka会根据最少被使用的原则选择目录分配新的partition。需要说明的是,kafka在分配partition的时候选择的原则不是按照磁盘空间大小来定的,而是根据分配的partition的个数多少而定 num.partitions:设置新创建的topic的默认分区数 number.recovery.threads.per.data.dir:用于恢复每个数据目录时启动的线程数 log.retention.hours:配置kafka中消息保存的时间,还支持log.retention.minutes和log.retention.ms。如果多个同时设置会选择时间最短的配置,默认为7天。 log.retention.check.interval.ms:用于检测数据过期的周期 log.segment.bytes:配置partition中每个segment数据文件的大小。默认为1GB。超出该大小后,会自动创建一个新的segment文件。 zookeeper.connect:指定连接的zk的地址,zk中存储了broker的元数据信息。可以通过逗号来设置多个值。格式为:hostname:port/path。hostname为zk的主机名或ip,port为zk监听的端口。/path表示kafka的元数据存储到zk上的目录,如果不设置,默认为根目录 zookeeper.connection.timeout:kafka连接zk的超时时间 group.initial.rebalance.delay.ms:在实际环境当中,当将多个consumer加入到一个空的consumer group中时,每加入一个consumer就会触发一次对partition消费的重平衡,如果加入100个,就得重平衡100次,这个过程就会变得非常耗时。通过设置该参数,可以延迟重平衡的时间,比如有100个consumer会在10s内全部加入到一个consumer group中,就可以将该值设置为10s,10s之后,只需要做一次重平衡即可。默认为0则代表不开启该特性。 auto.create.topics.enable:当有producer向一个不存在的topic中写入消息时,是否自动创建该topic delete.topics.enable:kafka提供了删除topic的功能,但默认并不会直接将topic数据物理删除。如果要从物理上删除(删除topic后,数据文件也一并删除),则需要将此项设置为true

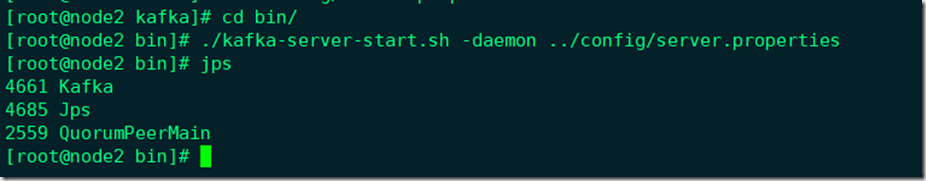

启动kafka

[root@node2 kafka]# cd bin/ [root@node2 bin]# ./kafka-server-start.sh -daemon ../config/server.properties

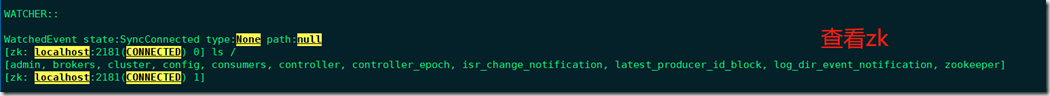

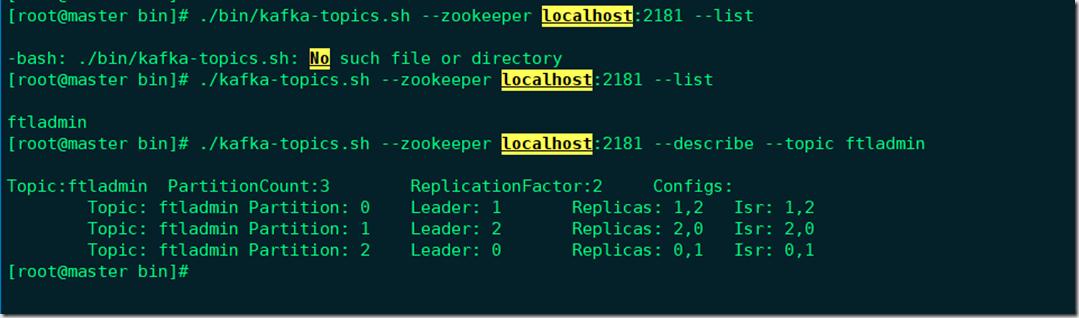

# 登录zk查看kafka的topic信息 cd /opt/zk/apache-zookeeper-3.7.0-bin/bin ./zkCli.sh

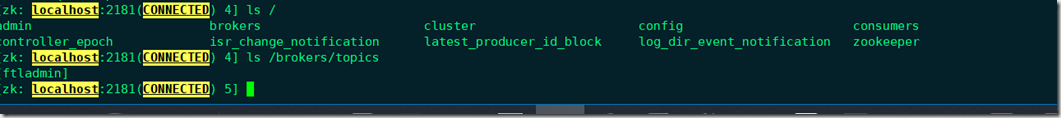

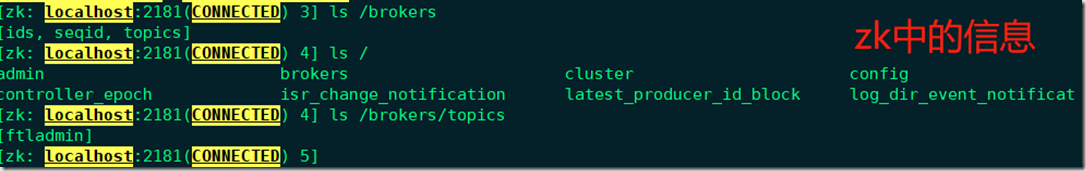

[zk: localhost:2181(CONNECTED) 0] ls /

[admin, brokers, cluster, config, consumers, controller, controller_epoch, isr_change_notification, latest_producer_id_block, log_dir_event_notification, zookeeper][zk: localhost:2181(CONNECTED) 0] ls /brokers

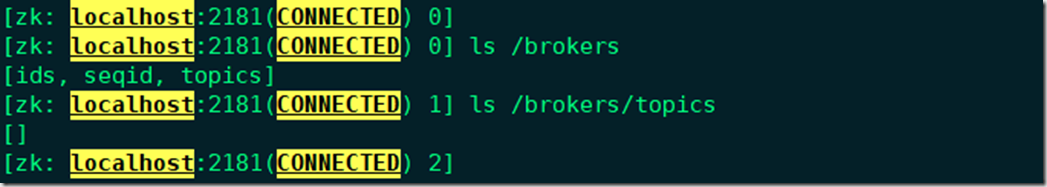

[ids, seqid, topics][zk: localhost:2181(CONNECTED) 1] ls /brokers/topics

[]

(查看/brokers/topics,目前为空,说明还没有创建任何的topic)