Ba, Jimmy, et al. "Using Fast Weights to Attend to the Recent Past." Advances In Neural Information Processing Systems. 2016.

![]()

![]()

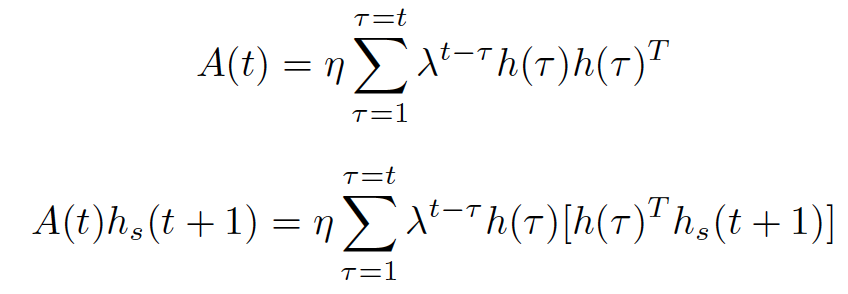

感觉就是引入了memory的机制,多了一个矩阵A,用来储存一定的信息。矩阵A在每次输入新的训练数据的时候会发生一定的变化。在两次数据输入期间,memory并不会变化,但是神经网络的隐藏输出会不断迭代变化。感觉这和人晚上睡觉一样,没有接受新的输入,但是大脑依然是活跃的,比如做梦。感觉像是一种时序的Attention机制,因为最后一个公式就好像是把以前所有的隐藏状态按照时间衰减和一定的attention进行了融合。该工作仍然值得深入分析。

有两个repo实现了这个算法:https://github.com/ajarai/fast-weights 和 https://github.com/jiamings/fast-weights