Bayes定理的理解

先验概率和后验概率(prior probability & posterior probability)

想要更好的理解贝叶斯公式,必须要搞懂几个概念:

先验概率和后验概率(也叫正向概率和逆向概率)

先验概率就是不加条件(信息)的判断某一变量的概率,可以理解为你直观上判断某一事件发生的概率。

举个例子,判断一个人是不是很聪明的概率。

后验概率是在附加了某条件后判断某一变量的概率(是一种条件概率),也可以理解为获取到了某些信息下判断某一事件的概率。

举个例子,这个人考上了大学,判断这个人是不是很聪明的概率。

二者区别可以认为是,先验概率是指缺乏某个事实的情况下描述一个变量; 而后验概率是在考虑了一个事实之后的条件概率。条件概率涉及的两个事件不是独立的。一个事件的发生必然影响另一个事件发生的概率。

条件概率(conditional probability)

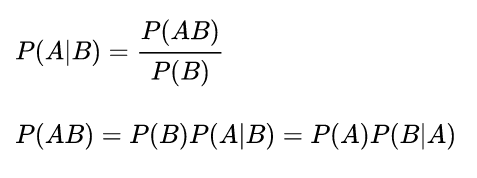

条件概率公式:

B事件是条件,我们已经观察到B的发生,所以在B发生的条件下A发生的概率,就是A和B都发生的概率,除以B发生的概率。

这是简单条件概率的理解,而贝叶斯公式就是用来求条件概率的。

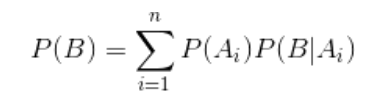

全概率公式(total probability)

(后面会用到)

公式表示若事件A1,A2,…,An构成一个完备事件组且都有正概率,则对任意一个事件B都有公式成立。

Bayes定理

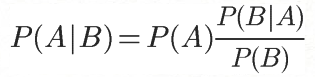

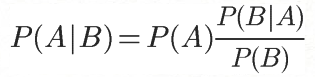

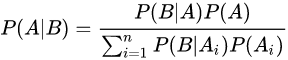

贝叶斯公式:

这里通过一个例子来理解这个公式:

-

问题:

小鹿说,他的女神每次看到他的时候都冲他笑,他想知道女神是不是喜欢他呢? -

建模:

分析给定的已知信息和未知信息:

1)未知条件:女神喜欢你,记为A事件,P(A) :表示A事件发生的概率。

2)已知条件:女神经常冲你笑,记为B事件,P(B) :表示B事件发生的概率。

3)要解决的问题:P(A|B) 表示女神经常冲你笑这个事件(B)发生后,女神喜欢你(A)的概率。

那么再回到公式,我们可以知道以下信息:

1)先验概率

在这个问题当中,P(A)就是先验概率,就是不知道B或者其它信息的情况下,对A发生的一个判断。也就是说,你不知道任何情况的前提下,女神喜欢你的概率,假设是50%,也就是说可能喜欢你,也可能不喜欢。

2)后验概率

P(A|B)称为"后验概率"(Posterior probability),即在B事件发生之后,我们对A事件概率的重新评估。这个例子里就是在女神冲你笑后,对女神喜欢你的概率重新预测。

3)可能性函数(Likelyhood)

我们观察公式,除去 P(A)、P(A|B)还剩下一部分: P(B|A)/P(B) ,我们可以理解为这是一个调整因子,即对新信息事件B的发生后做出的调整,作用是使得先验概率更接近真实概率。

可以理解为,你一开始有了个推断P(A),女神有50%的可能性喜欢你,但是后来你知道了P(B),女神经常冲你笑的概率,那么这时候你就需要对之前的推断做出调整,而这个“可能性函数(Likelyhood)”就是这个作用。

如果"可能性函数"P(B|A)/P(B)>1,意味着"先验概率"被增强,事件A的发生的可能性变大;

如果"可能性函数"P(B|A)/P(B)=1,意味着B事件无助于判断事件A的可能性;

如果"可能性函数"P(B|A)/P(B)<1,意味着"先验概率"被削弱,事件A的可能性变小。

在这里,假如这个可能性函数是1.5(可以理解为,女神平常比较高冷,但是经常只对你笑,意味着喜欢你的可能性变大)

我们将数据代入公式:P(A|B)=P(A) × P(B|A)/P(B)= 50%×1.5 =75%

说明在女神经常对你笑的情况下,喜欢你的概率是75%哦

深入理解贝叶斯公式

先根据以往的经验预估一个"先验概率"P(A),然后加入新的信息(实验结果B),这样有了新的信息后,我们对事件A的预测就更加准确。

因此,贝叶斯定理可以理解成下面的式子:

后验概率(新信息出现后A发生的概率) = 先验概率(A发生的概率) x 可能性函数(新信息带出现来的调整)

即:

P(A|B) = P(A) × (P(B|A)/P(B))

贝叶斯的底层思想就是:

如果我能掌握一个事情的全部信息,我当然能计算出一个客观概率(古典概率、正向概率)。

可是生活中绝大多数决策面临的信息都是不全的,我们手中只有有限的信息。既然无法得到全面的信息,我们就在信息有限的情况下,尽可能做出一个好的预测。也就是,在主观判断的基础上,可以先估计一个值(先验概率),然后根据观察的新信息不断修正(可能性函数)。

结合全概率公式

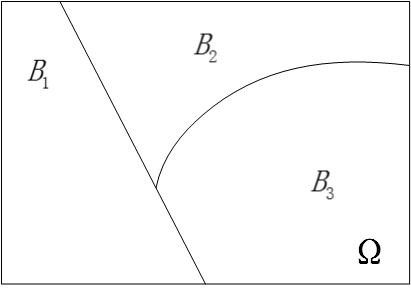

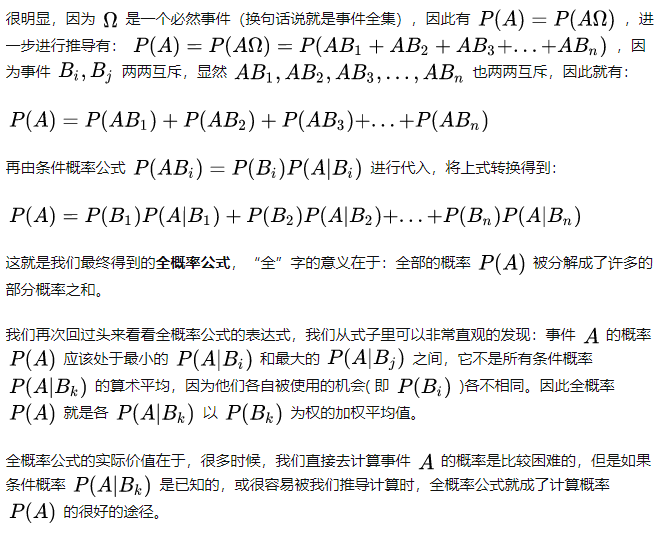

前面全概率的公式没有做过多的解释,这里来解释一下。

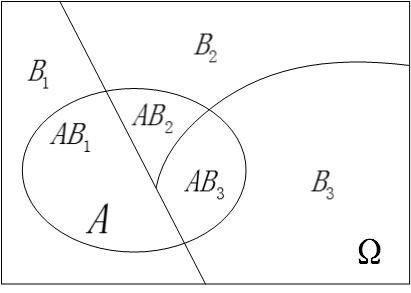

首先假设B1,B2,B3,B4...Bn 为有限个或者无限可数个事件,它们两两之间互斥。

引入一个新的事件A,如图:

贝叶斯公式再思考————由果溯源

贝叶斯公式是一个结合了全概率公式、条件概率的公式。

其主要的内涵是:在观察到结果事件P(B)已经发生的情况下,推断结果事件P(B)是由原因P(A)造成的概率的大小,也就是说是由因到果。

(P(A))是先验概率,指的是没有别的前提下的概率值,(P(A|B))是后验概率,代表了在获得了B信息之后,A事件出现的概率,也可以说后验概率是先验概率在获得了一些信息之后的一些修正。

链接

https://www.zhihu.com/question/27462939

https://zhuanlan.zhihu.com/p/37768413