作业的要求来自于:https://edu.cnblogs.com/campus/gzcc/GZCC-16SE2/homework/2941

1.从新闻url获取新闻详情: 字典,anews

import requests from bs4 import BeautifulSoup from datetime import datetime import re def click(url): id = re.findall('(d{1,5})',url)[-1]#返回所有匹配的字符串的字符串列表的最后一个 clickUrl = 'http://oa.gzcc.cn/api.php?op=count&id={}&modelid=80'.format(id) resClick = requests.get(clickUrl) newsClick = int(resClick.text.split('.html')[-1].lstrip("('").rstrip("');")) return newsClick #时间 def newsdt(showinfo): newsDate = showinfo.split()[0].split(':')[1] newsTime = showinfo.split()[1] newsDT = newsDate+' '+newsTime dt = datetime.strptime(newsDT,'%Y-%m-%d %H:%M:%S')#转换成datetime类型 return dt #内容 def anews(url): newsDetail = {} res = requests.get(url) res.encoding = 'utf-8' soup = BeautifulSoup(res.text,'html.parser') newsDetail['newsTitle'] = soup.select('.show-title')[0].text#题目 showinfo = soup.select('.show-info')[0].text newsDetail['newsDT'] = newsdt(showinfo)#时间 newsDetail['newsClick'] = click(newsUrl)#点击次数 return newsDetail newsUrl = 'http://news.gzcc.cn/html/2019/xiaoyuanxinwen_0404/11155.html' print(anews(newsUrl))

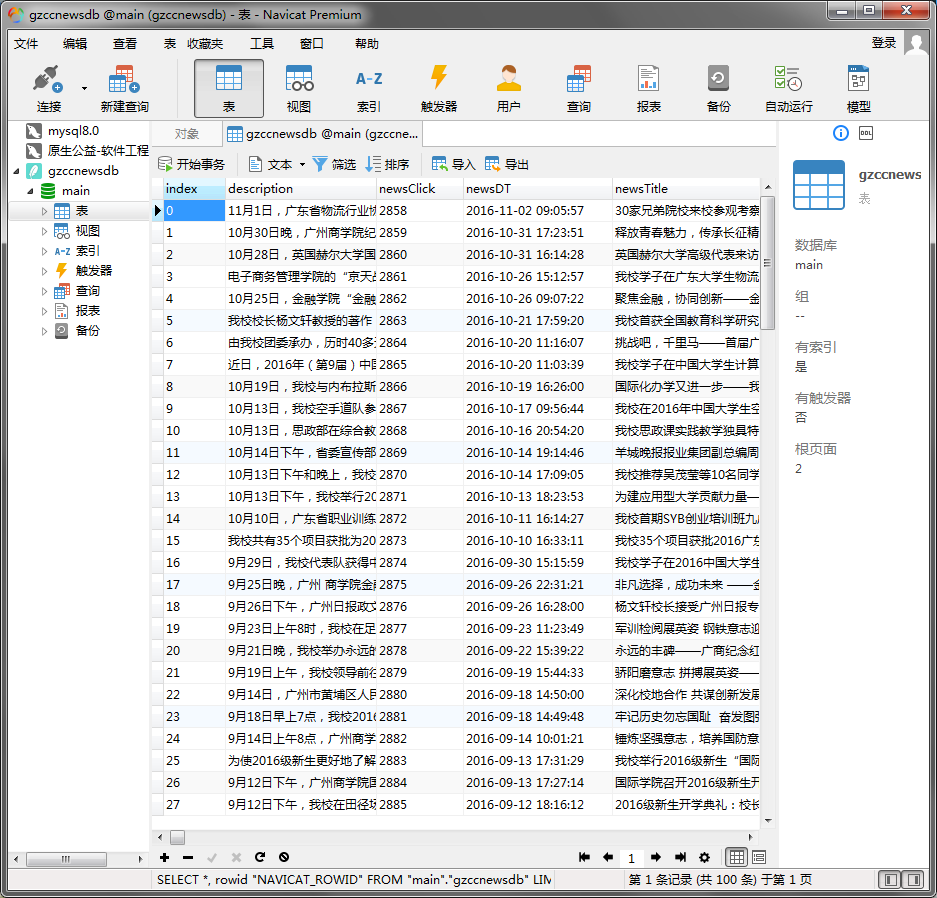

效果如图所示:

2.从列表页的url获取新闻url:列表append(字典) alist

上述代码+ def alist(url): res = requests.get(listUrl) res.encoding = 'utf-8' soup = BeautifulSoup(res.text, 'html.parser') newsList = [] for news in soup.select('li'):#获取li元素 if len(news.select('.news-list-title'))>0:#如果存在新闻题目 newsUrl = news.select('a')[0]['href']#获取新闻的链接 newsDesc = news.select('.news-list-description')[0].text#获取摘要文本 newsDict = anews(newsUrl)#通过链接获取题目时间点击数 newsDict['description'] = newsDesc newsList.append(newsDict)#把每个新闻的信息放进字典扩展到列表里 return newsList listUrl = 'http://news.gzcc.cn/html/xiaoyuanxinwen/' print(alist(listUrl))

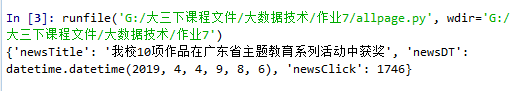

效果如图所示:

3.生成所页列表页的url并获取全部新闻 :列表extend(列表) allnews

*每个同学爬学号尾数开始的10个列表页

allnews = [] for i in range(59,69): listUrl = 'http://news.gzcc.cn/html/xiaoyuanxinwen/{}.html'.format(i) allnews.extend(alist(listUrl)) print(len(allnews)) print(allnews)

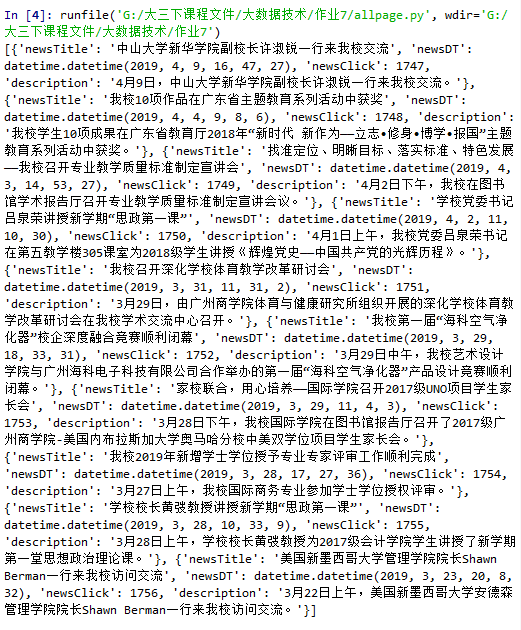

效果如图所示:

4.设置合理的爬取间隔

import time

import random

time.sleep(random.random()*3)

for i in range(5): print(i) time.sleep(random.random()*3)

5.用pandas做简单的数据处理并保存

保存到csv或excel文件

newsdf.to_csv(r'F:duym爬虫gzccnews.csv')

保存到数据库

import sqlite3

with sqlite3.connect('gzccnewsdb.sqlite') as db:

newsdf.to_sql('gzccnewsdb',db)

newsdf.to_csv('123.csv') #在本地项目下生成一个表格存储爬取新闻内容 with sqlite3.connect('gzccnewsdb.sqlite') as db: newsdf.to_sql('gzccnewsdb',db) #在本地项目下生成一个数据库存储爬取新闻内容

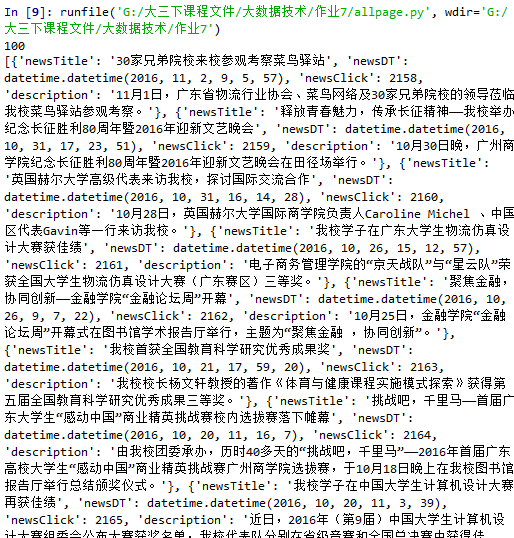

运行效果如图所示:

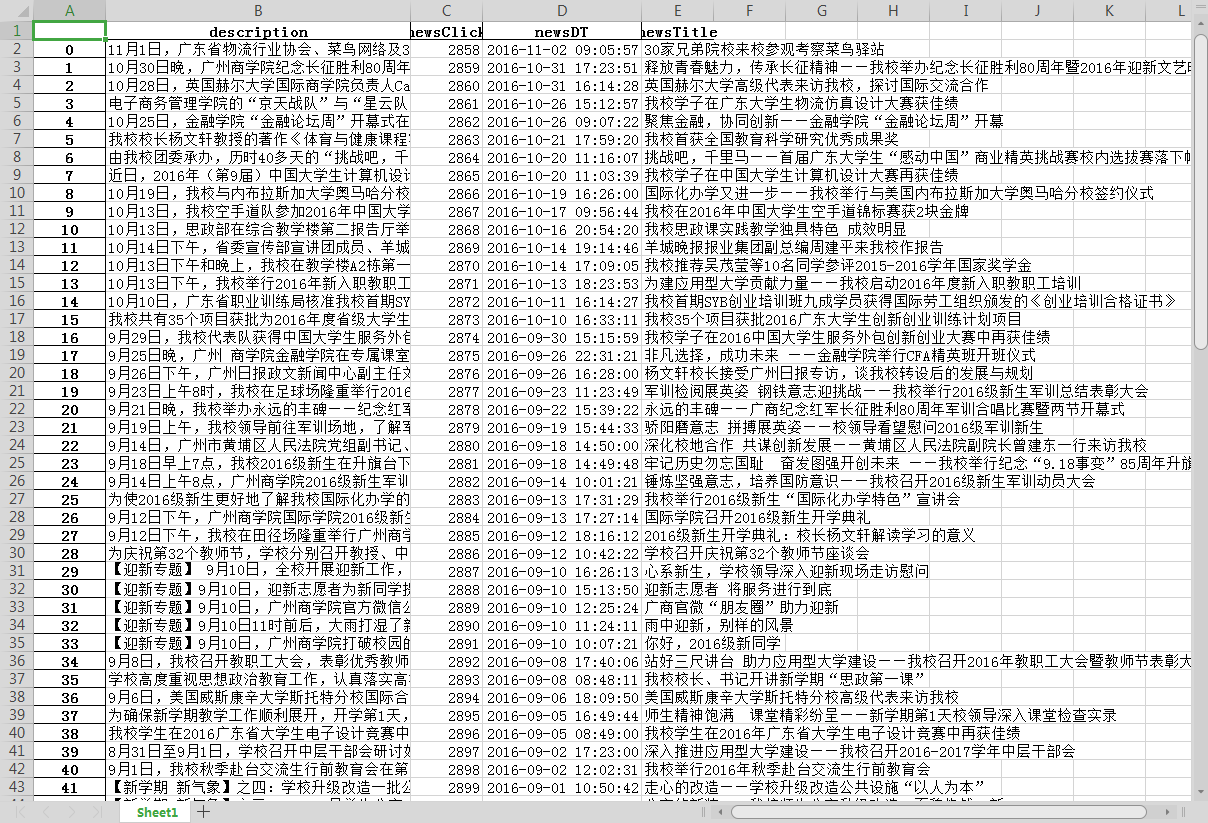

csv文件内容如下:

sqlite文件内容如下: