什么叫大数据,“大”,说的并不仅是数据的“多”!不能用数据到了多少TB ,多少PB 来说。

对于大数据,可以用四个词来表示:大量,多样,实时,不确定。

也就是数据的量庞大,数据的种类繁杂多样话,数据的变化飞快,数据的真假存疑。

大量:这个大家都知道,想百度,淘宝,腾讯,Facebook,Twitter等网站上的一些信息,这肯定算是大数据了,都要存储下来。

多样:数据的多样性,是说数据可能是结构型的数据,也可能是非结构行的文本,图片,视频,语音,日志,邮件等。

实时:大数据需要快速的,实时的进行处理。如果说对时间要求低,那弄几个机器,对小数据进行处理,等个十天半月的出来结果,这样也没有什么意义了。

不确定: 数据是存在真伪的,各种各样的数据,有的有用,有的没用。很难辨析。

根据以上的特点,我们需要一个东西,来:

1.存储大量数据

2.快速的处理大量数据

3.从大量数据中进行分析

于是就有了这样一个模型hadoop。

一.什么是hadoop?

1.Hadoop是Apache旗下的一套开源软件平台,是用来分析和处理大数据的软件平台。

2.Hadoop提供的功能:利用服务器集群,根据用户的自定义业务逻辑, 对海量数据进行分布式处理。

3.Hadoop的核心组件:由底层往上分别是 HDFS、Yarn、MapReduce。

4.广义上来说,Hadoop通常指的是指一个更广泛的概念->Hadoop生态 圈。

5.云计算是分布式计算、并行计算、网格计算、多核计算、网络存储、虚 拟化、负载均衡等传统计算机技术和互联网技术融合发展的产物。借助 IaaS(基础设施即服务)、PaaS(平台即服务)、SaaS(软件即服务)等业 务模式,把强大的计算能力提供给终端用户。

6.现阶段,云计算的两大底层支撑技术为虚拟化和大数据技术。

7.HADOOP则是云计算的PaaS层的解决方案之一,并不等同于PaaS,更不等同于云计算本身。

8.HADOOP应用于数据服务基础平台建设。

9.HADOOP用于用户画像。

10.HADOOP用于网站点击流日志数据挖掘

二.Hadoop的生态圈和核心组件

这就相当于一个生态系统,或者可以看成一个操作系统XP,win7,win10

HDFS和MapReduce为操作系统的核心,Hive,Pig,Mathout,Zookeeper,Flume,Sqoop,HBase等,都是操作系统上的一些软件,或应用。

核心组件:HDFS(分布式文件系统)、YARN(集群资源管理系统)、MapReduce(分布式计算框架)

1.HDFS: 分布式文件存储系统(Hadoop Distributed File System)

HDFS是块级别的分布式文件存储系统。是hadoop中数据存储管理的基础,具有高度容错性,能检测和应对硬件故障。

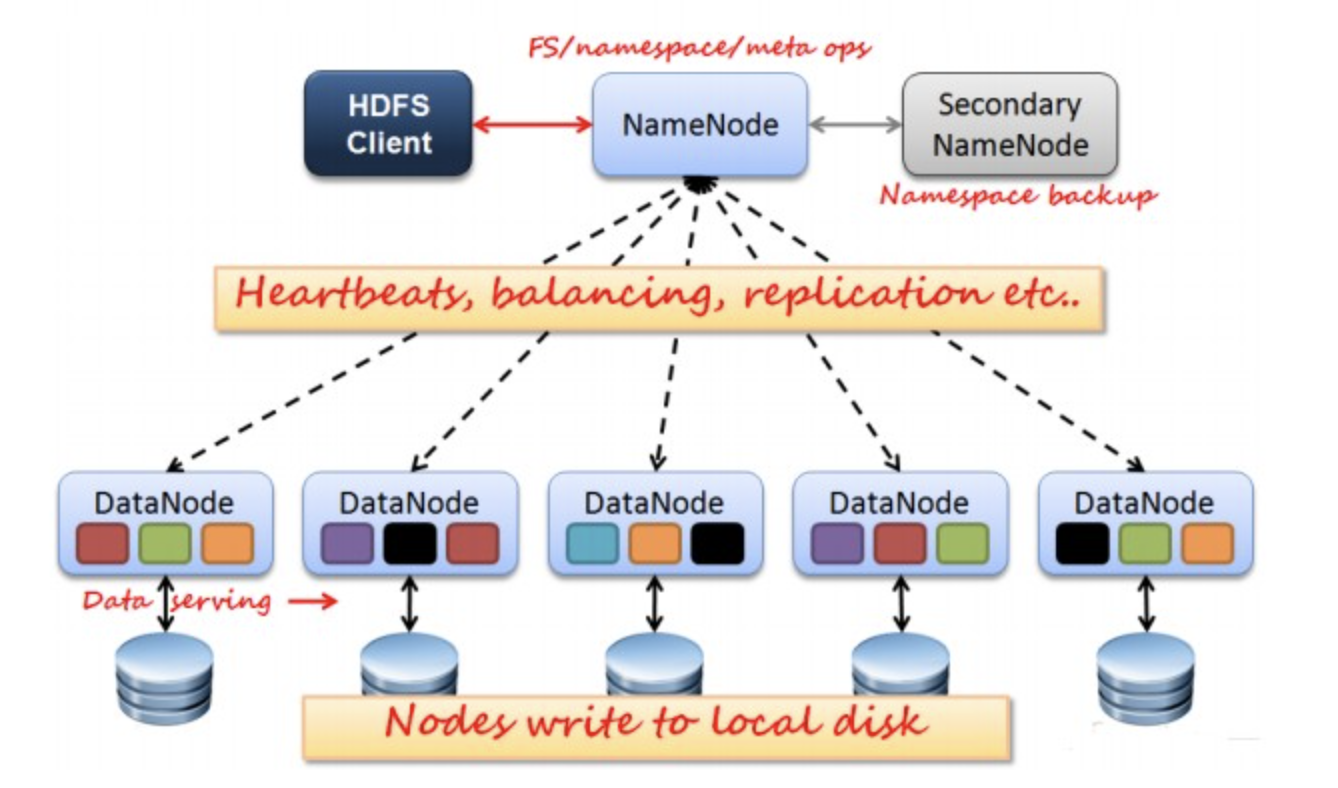

包含四个部分:HDFS Client、NameCode(nn)、DataNode(dn)、Secondary NameCode(2nn)

1、提供一些命令来管理、访问 HDFS,比如启动或者关闭HDFS。

2、与 DataNode 交互,读取或者写入数据;读取时,要与 NameNode 交互,获取文件的位置信息;写入 HDFS 的时候,Client 将文件切分成 一个一个的Block,然后进行存储。

NameNode(nn):元数据节点,存储文件的元数据。如文件名、文件目录结构,文件属性(生成时间、副本数、文件权限),以及每个文件的块列表和块所在得到DataNode等;管理HDFS的名称空间和数据块映射信息,配置副本策略,处理客户端请求;

它是描述数据的数据,相当于图书馆的检索系统。

DataNode(dn):数据节点,在本地文件系统存储文件块数据,以及块数据的校验和。

存储实际的数据,汇报存储信息给namenode,相当于书柜。

Secondary NameNode(2nn):用来监控HDFS状态的辅助后台程序,每隔一段时间获取HDFS元数据的快照。辅助namenode,分担其工作量:定期合并fsimage和fsedits,推送给namenode。

从图上来看,HDFS的简单原理。

Rack1,Rack2,Rack3是三个机架;

1,2,3,4,5,6,7,8,9,10,11,12 是机架上的十二台服务器。

Block A, Block B, Block C为三个信息块,也就是要存的数据。

从整体布局上来看,信息块被分配到机架上。看似很均匀。这样分配的目的,就是备份,防止某一个机器宕机后,单点故障的发生。

HDFS有很多特点:

① 保存多个副本,且提供容错机制,副本丢失或宕机自动恢复。默认存3份。

② 运行在廉价的机器上。

③ 适合大数据的处理。多大?多小?HDFS默认会将文件分割成block,64M为1个block。然后将block按键值对存储在HDFS上,并将键值对的映射存到内存中。如果小文件太多,那内存的负担会很重。(从2.7.3版本开始,官方关于Data Blocks 的说明中,block size由64 MB变成了128 MB的。)

如上图所示,HDFS也是按照Master和Slave的结构。分NameNode、SecondaryNameNode、DataNode这几个角色。

HDFS Client:就是客户端。

1、提供一些命令来管理、访问 HDFS,比如启动或者关闭HDFS。

2、与 DataNode 交互,读取或者写入数据;读取时,要与NameNode 交互,获取文件的位置信息;写入 HDFS 的时候,Client 将文件切分成 一个一个的Block,然后进行存储。

NameNode:是Master节点,是大领导。管理数据块映射;处理客户端的读写请求;配置副本策略;管理HDFS的名称空间;

SecondaryNameNode:是一个小弟,分担大哥namenode的工作量;是NameNode的冷备份;合并fsimage和fsedits然后再发给namenode。

DataNode:Slave节点,奴隶,干活的。负责存储client发来的数据块block;执行数据块的读写操作。

热备份:b是a的热备份,如果a坏掉。那么b马上运行代替a的工作。

冷备份:b是a的冷备份,如果a坏掉。那么b不能马上代替a工作。但是b上存储a的一些信息,减少a坏掉之后的损失。

fsimage:元数据镜像文件(文件系统的目录树。)

edits:元数据的操作日志(针对文件系统做的修改操作记录)

namenode内存中存储的是=fsimage+edits。

SecondaryNameNode负责定时默认1小时,从namenode上,获取fsimage和edits来进行合并,然后再发送给namenode。减少namenode的工作量。

HDFS工作原理:

写操作

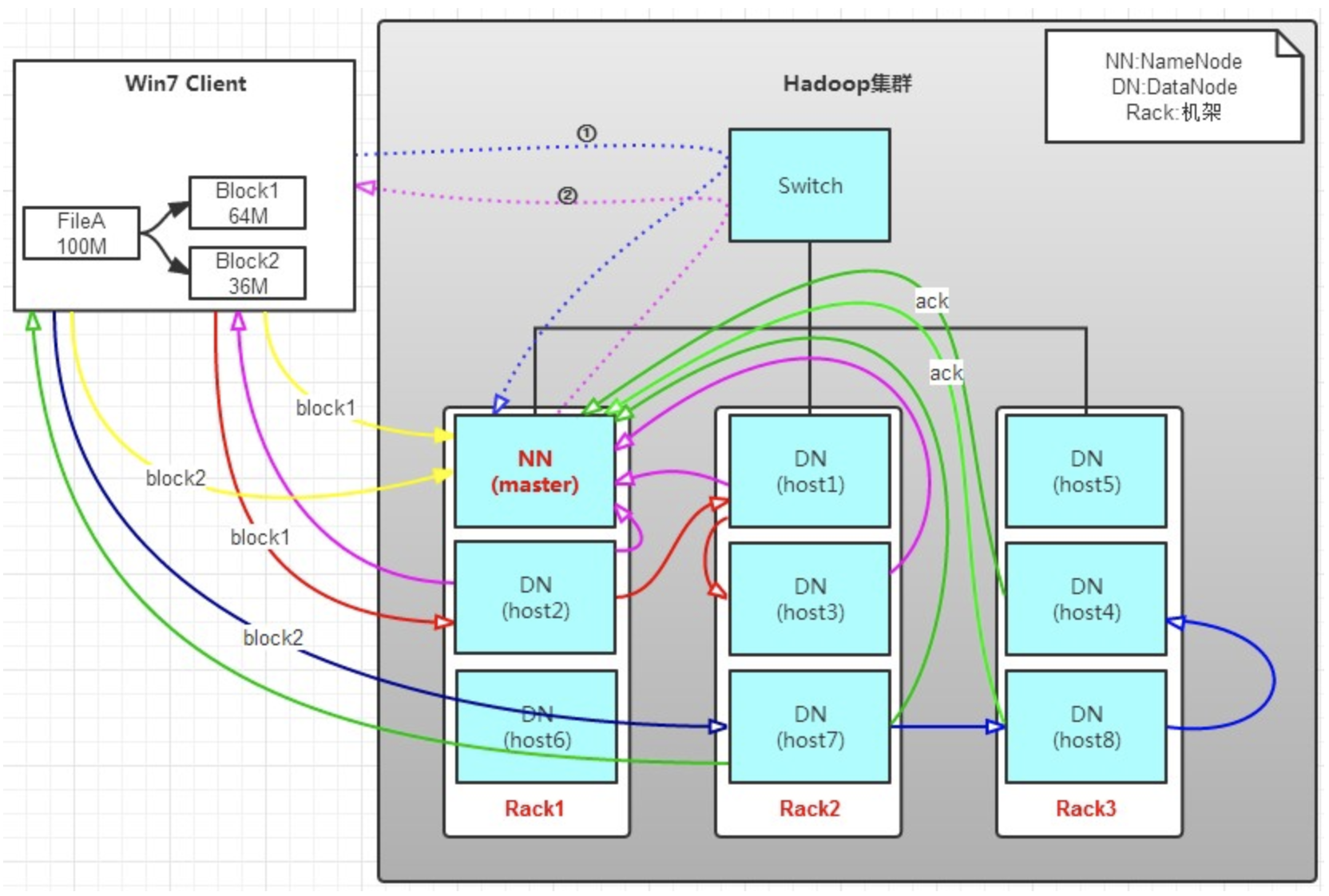

有一个文件FileA,100M大小。Client将FileA写入到HDFS上。

HDFS按默认配置。

HDFS分布在三个机架上Rack1,Rack2,Rack3。

a. Client将FileA按64M分块。分成两块,block1和Block2;

b. Client向nameNode发送写数据请求,如图蓝色虚线①------>。

c. NameNode节点,记录block信息。并返回可用的DataNode,如粉色虚线②--------->。

Block1: host2,host1,host3

Block2: host7,host8,host4

原理:

NameNode具有RackAware机架感知功能,这个可以配置。

若client为DataNode节点,那存储block时,规则为:副本1,同client的节点上;副本2,不同机架节点上;副本3,同第二个副本机架的另一个节点上;其他副本随机挑选。

若client不为DataNode节点,那存储block时,规则为:副本1,随机选择一个节点上;副本2,不同副本1,机架上;副本3,同副本2相同的另一个节点上;其他副本随机挑选。

d. client向DataNode发送block1;发送过程是以流式写入。

流式写入过程,

1>将64M的block1按64k的package划分;

2>然后将第一个package发送给host2;

3>host2接收完后,将第一个package发送给host1,同时client想host2发送第二个package;

4>host1接收完第一个package后,发送给host3,同时接收host2发来的第二个package。

5>以此类推,如图红线实线所示,直到将block1发送完毕。

6>host2,host1,host3向NameNode,host2向Client发送通知,说“消息发送完了”。如图粉红颜色实线所示。

7>client收到host2发来的消息后,向namenode发送消息,说我写完了。这样就真完成了。如图黄色粗实线

8>发送完block1后,再向host7,host8,host4发送block2,如图蓝色实线所示。

9>发送完block2后,host7,host8,host4向NameNode,host7向Client发送通知,如图浅绿色实线所示。

10>client向NameNode发送消息,说我写完了,如图黄色粗实线。。。这样就完毕了。

分析,通过写过程,我们可以了解到:

①写1T文件,我们需要3T的存储,3T的网络流量贷款。

②在执行读或写的过程中,NameNode和DataNode通过HeartBeat进行保存通信,确定DataNode活着。如果发现DataNode死掉了,就将死掉的DataNode上的数据,放到其他节点去。读取时,要读其他节点去。

③挂掉一个节点,没关系,还有其他节点可以备份;甚至,挂掉某一个机架,也没关系;其他机架上,也有备份。

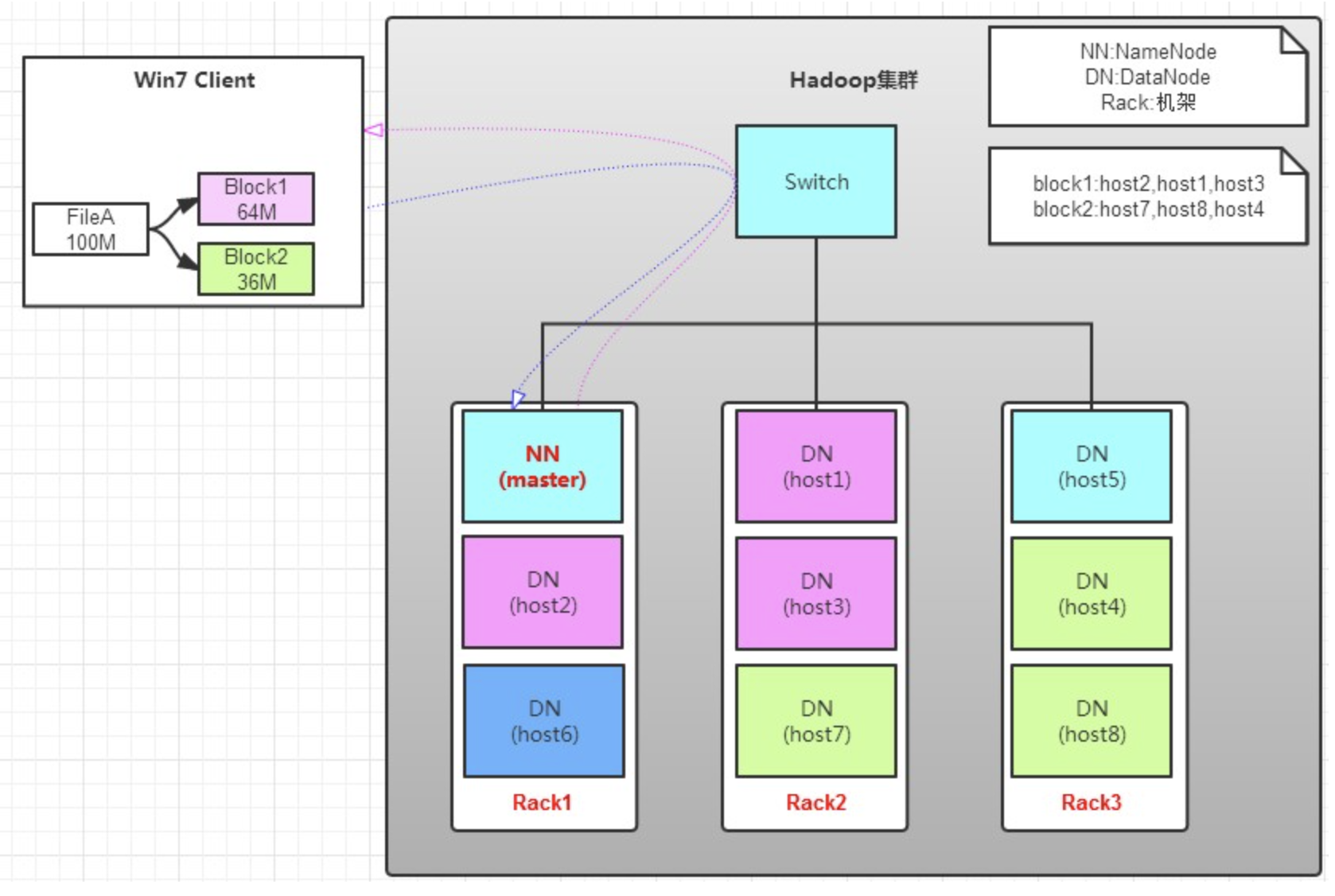

读操作

读操作就简单一些了,如图所示,client要从datanode上,读取FileA。而FileA由block1和block2组成。

那么,读操作流程为:

a. client向namenode发送读请求。

b. namenode查看Metadata信息,返回fileA的block的位置。

block1:host2,host1,host3

block2:host7,host8,host4

c. block的位置是有先后顺序的,先读block1,再读block2。而且block1去host2上读取;然后block2,去host7上读取;

上面例子中,client位于机架外,那么如果client位于机架内某个DataNode上,例如,client是host6。那么读取的时候,遵循的规律是:

优选读取本机架上的数据。

2. Yarn:分布式资源管理器 (Yet Another Resource Negotiator,另一种资源协调者)

Yarn顾名思义 管理资源的 那么具有足够的通用性,可以支持其他的分布式计算模式。

Yarn还能很方便的管理诸如Hive、Hbase、Pig、Spark/Shark等应用。

Yarn可以使各种应用互不干扰的运行在同一个Hadoop系统中,实现整个集群资源的共享。

包含两个进程:Nodemanager,ResourceManager

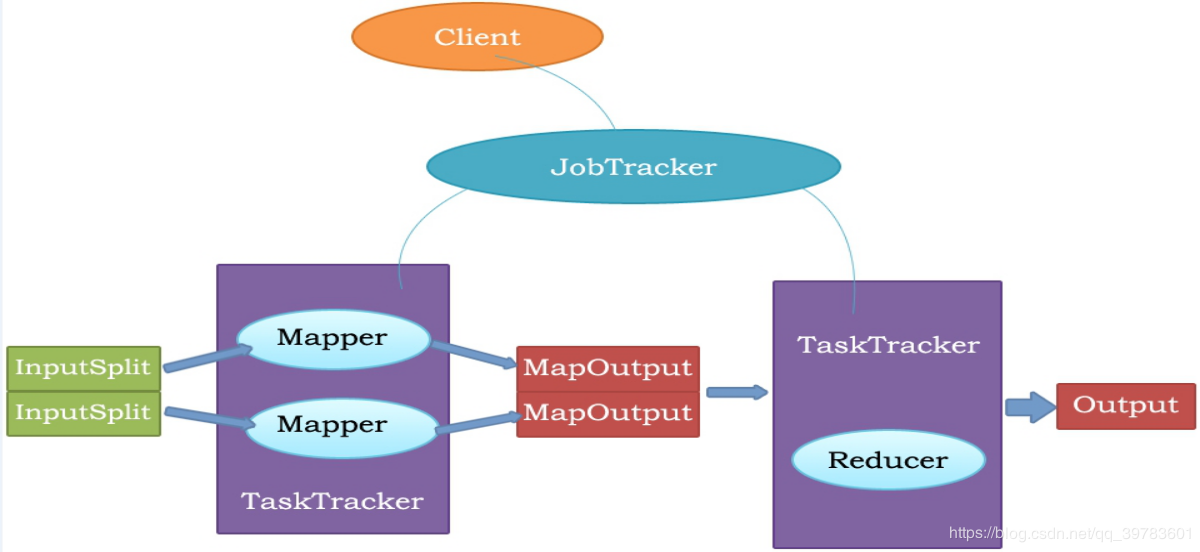

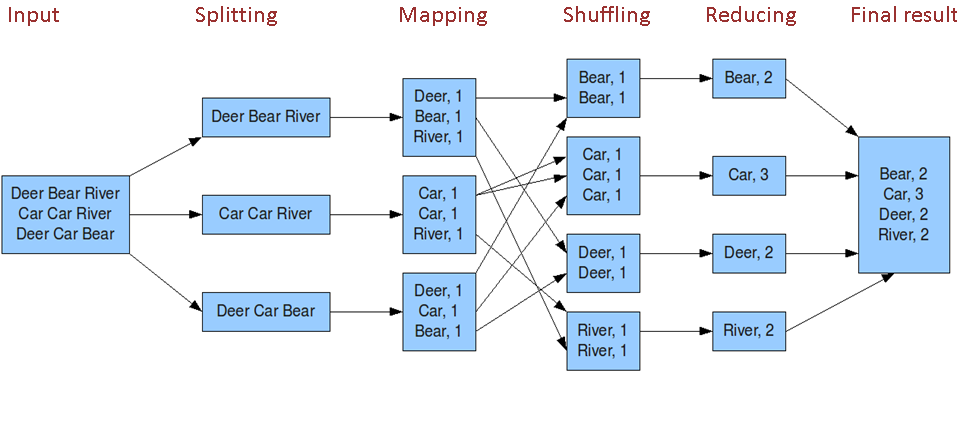

3. MapReduce:分布式计算框架

mapreduce是一种采用分而治之的分布式计算框架,用于处理数据量大的计算。

如一复杂的计算任务,单台服务器无法胜任时,可将此大任务切分成一个个小的任务,小任务分别在不同的服务器上并行的执行;最终再汇总每个小任务的结果

MapReduce由两个阶段组成:

Map阶段(切分成一个个小的任务)

Reduce阶段(汇总小任务的结果)

用户只需实现map()和reduce()两个函数,即可实现分布式计算

执行流程图如下:

jobtracker

master节点,只有一个,管理所有作业,任务/作业的监控,错误处理等,将任务分解成一系列任务,并分派给tasktracker。

tacktracker

slave节点,运行 map task和reducetask;并与jobtracker交互,汇报任务状态。

map task

解析每条数据记录,传递给用户编写的map()并执行,将输出结果写入到本地磁盘(如果为map—only作业,则直接写入HDFS)。

reduce task

从map 它深刻地执行结果中,远程读取输入数据,对数据进行排序,将数据分组传递给用户编写的reduce函数执行

原理图如下:

总体来说:是个总分总的结构,先分解成多个小任务,在map阶段处理完成后,汇总成少数个小任务server在Reduce阶段处理进行排序 分组等操作。

Map阶段解说:先把一个大任务分解split成多个小任务

(1) 读取HDFS中的文件。每一行解析成一个<k,v>。每一个键值对调用一次map函数。<0,hello you> <1,hello me>

(2)覆盖map(),接收(1)产生的<k,v>,进行处理,转换为新的<k,v>输出。 <hello,1> <you,1> <hello,1> <me,1>

(3)对(2)输出的<k,v>进行分区。默认分为一个区。

(4)对不同分区中的数据进行排序(按照k)、分组。分组指的是相同key的value放到一个集合中。 排序后:<hello,1> <hello,1> <me,1> <you,1> 分组后:<hello,{1,1}><me,{1}><you,{1}>

(5)(可选)对分组后的数据进行归约。

Rduce阶段解说:把map阶段的结果进行汇总

(1)多个map任务的输出,按照不同的分区,通过网络copy到不同的reduce节点上。

(2)对多个map的输出进行合并、排序。覆盖reduce函数,接收的是分组后的数据,实现自己的业务逻辑,<hello,2> <me,1> <you,1> 处理后,产生新的<k,v>输出。

(3)对reduce输出的<k,v>写到HDFS中。

参考文献:

https://www.cnblogs.com/laov/p/3434917.html

https://www.jianshu.com/p/f1e785fffd4d,

https://blog.csdn.net/qq_39783601/article/details/104928348,

https://blog.csdn.net/zcb_data/article/details/80402411,

https://www.cnblogs.com/ahu-lichang/p/6645074.html.