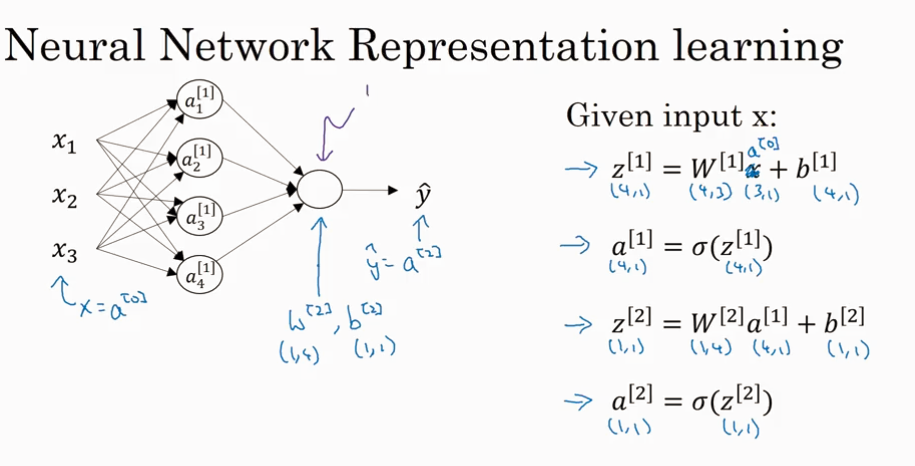

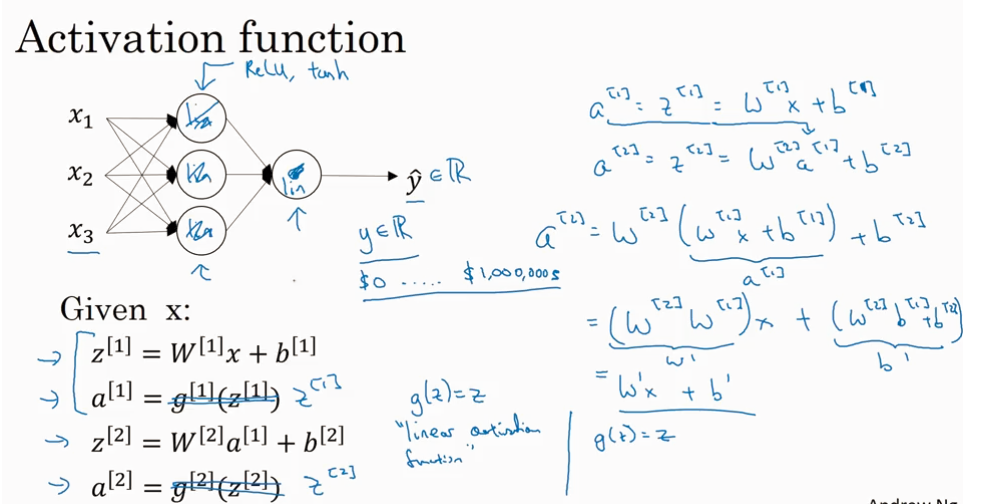

NN representation

这一课主要是讲3层神经网络

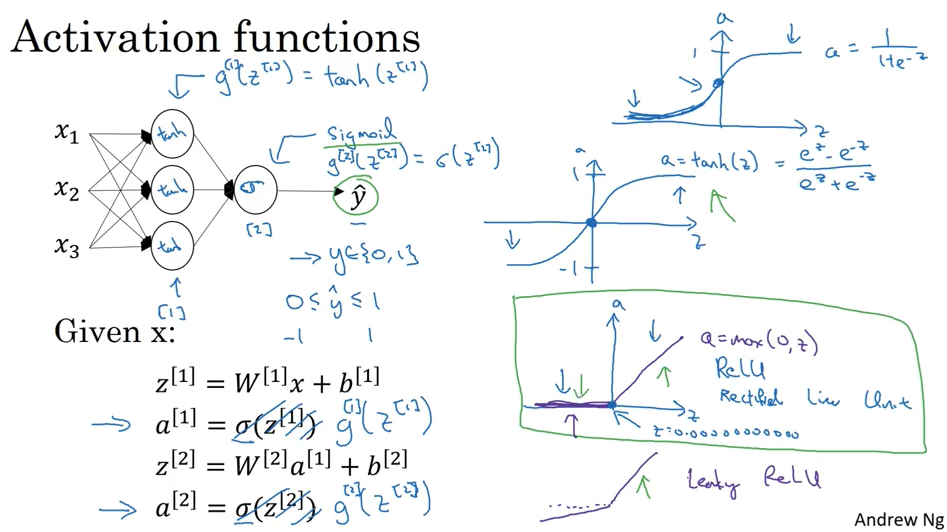

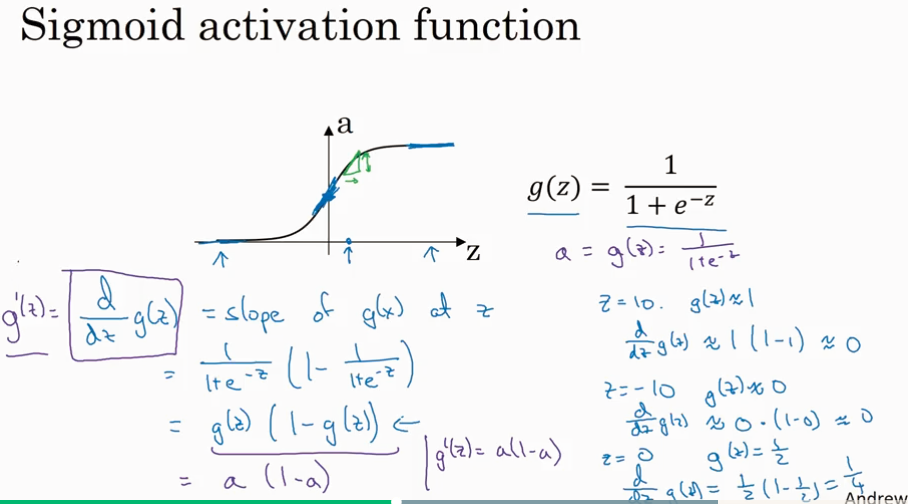

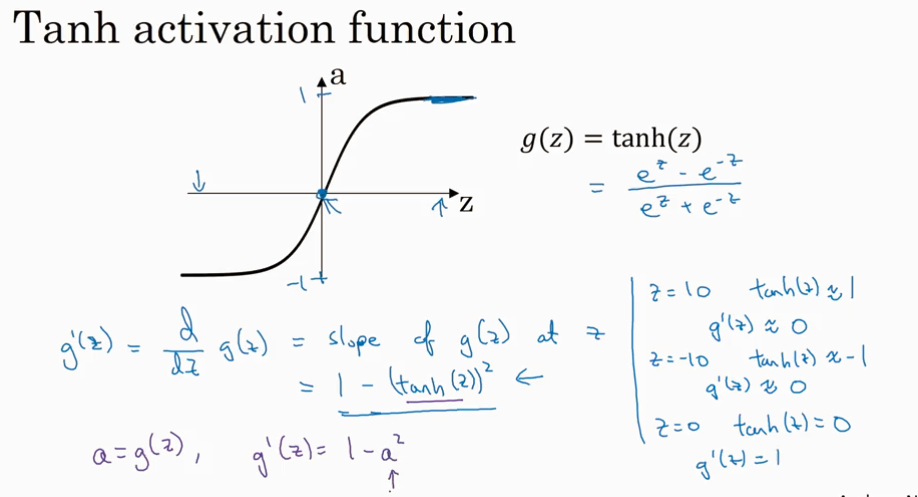

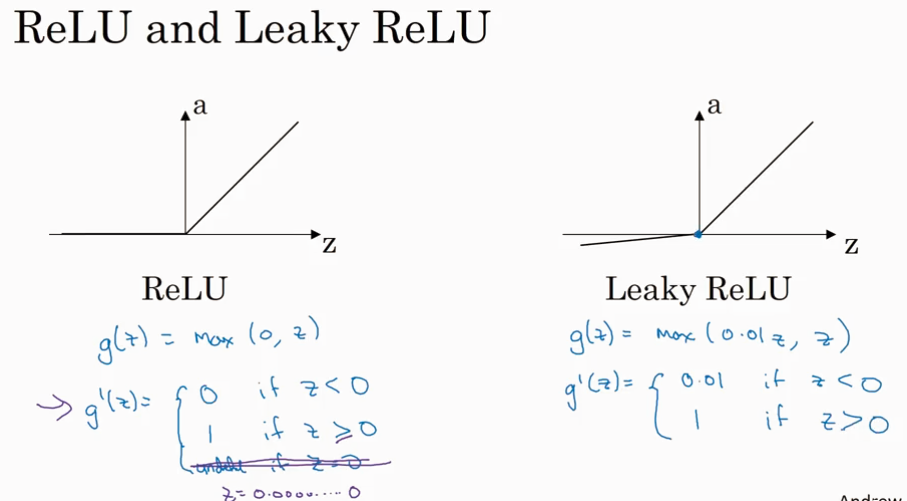

下面是常见的 activation 函数.sigmoid, tanh, ReLU, leaky ReLU.

Sigmoid 只用在输出0/1 时候的output layer, 其他情况基本不用,因为tanh 总是比sigmoid 好.

两种 ReLU 使用起来总是要比sigmoid 和 tanh 快。ReLU 是最常用的 activation.

为什么Activation function 要是non-linear的?因为如下图所示如果activation 是linear的,那么最终output 只是 input 的线性函数.

Gradient of activation function

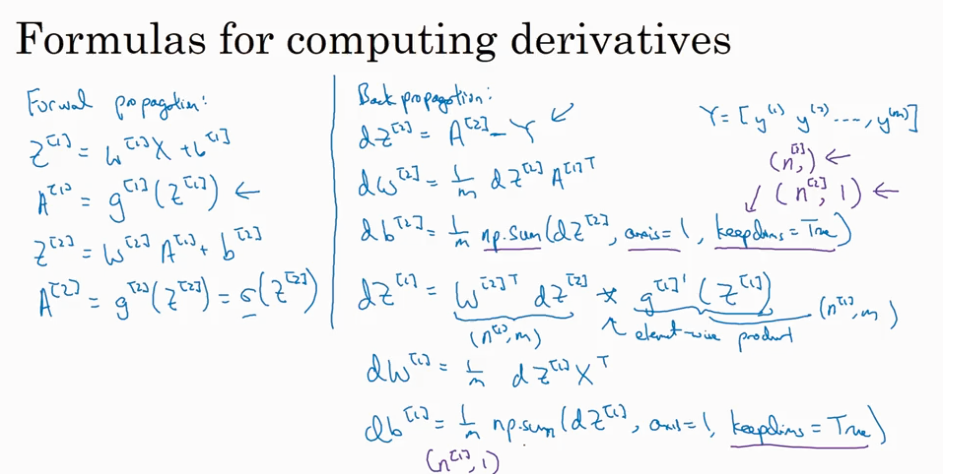

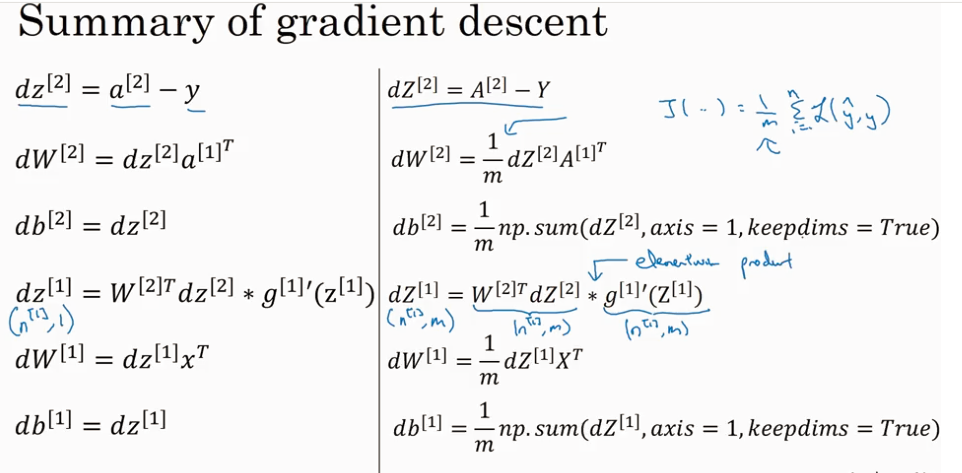

Gredient of 2 layer NN.