在吴恩达老师的神经网络和深度学习_04中介绍了逻辑回归函数如链接https://www.cnblogs.com/mengmengxia/p/10537579.html

-

逻辑回归的代价函数(Logistic Regression Cost Function)

逻辑回归的代价函数又称为成本函数。为了训练逻辑回归模型的参数 w 和参数 b。需要一个代价函数,通过训练代价函数来得到参数w和参数b。先看一下逻辑回归的输出函数: ![]()

给予一个训练集有m个样本,可以通过训练集的学习得到参数w和参数b。对于训练集的预测值 ,我们希望它会接近于训练集中的y值。训练样本i所对应的预测值是

,我们希望它会接近于训练集中的y值。训练样本i所对应的预测值是  是用训练样本的

是用训练样本的  通过sigmoid函数得到的。

通过sigmoid函数得到的。

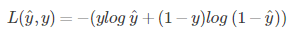

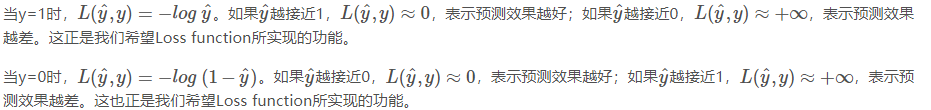

损失函数又叫误差函数,用来衡量算法的运行情况 。损失函数用来衡量预测输出值和实际值有多接近。那么在逻辑回归中用到的损失函数是:

。损失函数用来衡量预测输出值和实际值有多接近。那么在逻辑回归中用到的损失函数是:

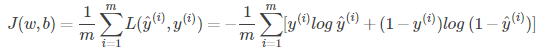

损失函数是在单个训练样本中定义的,它衡量的是算法在单个训练样本中表现如何,为了衡量算法在全部训练样本上的表现如何,我们需要定义一个算法的代价函数,算法的代价函数是对m个样本的损失函数求和然后除以m:

用于像这样的单个训练样本,而代价函数是参数的总代价,所以在训练逻辑回归模型时候,我们需要找到合适的w和b,来让代价函数J 的总代价降到最低。

不知道是怎么搞的,博客园写数学公式显示不出来,只能这样弄了!希望见谅!共同进步!