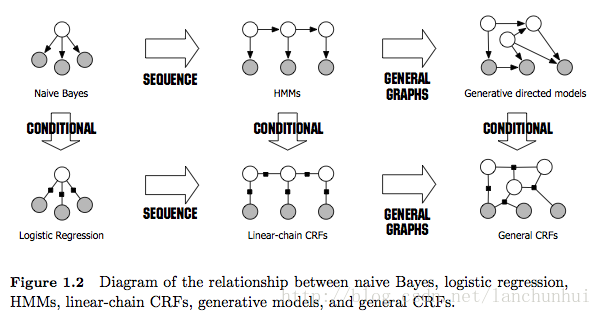

0. 模型间的内在关系

- 逻辑回归是朴素贝叶斯的条件化( conditional)的版本;

- HMMs 是朴素贝叶斯的序列化(sequence)的版本;

1. 机器学习

降维:(

x⃗ i∈Rp,z⃗ i∈Rq,p>q )- 线性变换,

z⃗ i=Aq×px⃗ i ,要求 A 满秩(列正交)ATA=I - 非线性变换:

z⃗ i=f(x⃗ i)

- 线性变换,

Gradient-Based Learning

2. softmax function

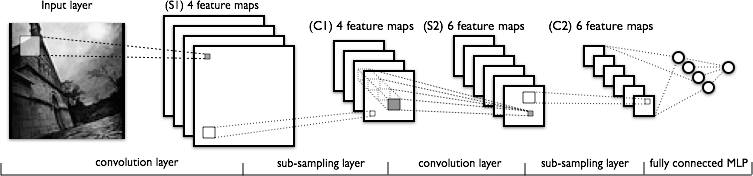

3. LeNet

- 较低的网络层(lower-layers)交替地执行卷积和池化;

- 较高的网络层(higher-layers)通过一次全连接到达一个 MLP(Hidden layer+logistic regression)