首先,糗事百科大家都听说过吧?糗友们发的搞笑的段子一抓一大把,这次我们尝试一下用爬虫把他们抓取下来。

友情提示

糗事百科在前一段时间进行了改版,导致之前的代码没法用了,会导致无法输出和CPU占用过高的情况,是因为正则表达式没有匹配到的缘故。

现在,博主已经对程序进行了重新修改,代码亲测可用,包括截图和说明,之前一直在忙所以没有及时更新,望大家海涵!

更新时间:2015/8/2

糗事百科又又又又改版了,博主已经没心再去一次次匹配它了,如果大家遇到长时间运行不出结果也不报错的情况,请大家参考最新的评论,热心小伙伴提供的正则来修改下吧~

更新时间:2016/3/27

本篇目标

1.抓取糗事百科热门段子

2.过滤带有图片的段子

3.实现每按一次回车显示一个段子的发布时间,发布人,段子内容,点赞数。

糗事百科是不需要登录的,所以也没必要用到Cookie,另外糗事百科有的段子是附图的,我们把图抓下来图片不便于显示,那么我们就尝试过滤掉有图的段子吧。

好,现在我们尝试抓取一下糗事百科的热门段子吧,每按下一次回车我们显示一个段子。

1.确定URL并抓取页面代码

首先我们确定好页面的URL是 http://www.qiushibaike.com/hot/page/1,其中最后一个数字1代表页数,我们可以传入不同的值来获得某一页的段子内容。

我们初步构建如下的代码来打印页面代码内容试试看,先构造最基本的页面抓取方式,看看会不会成功

1 # -*- coding:utf-8 -*- 2 import urllib 3 import urllib2 4 5 6 page = 1 7 url = 'http://www.qiushibaike.com/hot/page/' + str(page) 8 try: 9 request = urllib2.Request(url) 10 response = urllib2.urlopen(request) 11 print response.read() 12 except urllib2.URLError, e: 13 if hasattr(e,"code"): 14 print e.code 15 if hasattr(e,"reason"): 16 print e.reason

运行程序,哦不,它竟然报错了,真是时运不济,命途多舛啊

line 373, in _read_status raise BadStatusLine(line) httplib.BadStatusLine: ''

好吧,应该是headers验证的问题,我们加上一个headers验证试试看吧,将代码修改如下

1 # -*- coding:utf-8 -*- 2 import urllib 3 import urllib2 4 5 6 page = 1 7 url = 'http://www.qiushibaike.com/hot/page/' + str(page) 8 #url = 'http://www.qiushibaike.com/hot/' 9 user_agent = 'Mozilla/4.0 (compatible; MSIE 5.5; Windows NT)' 10 headers = { 'User-Agent' : user_agent} 11 try: 12 request = urllib2.Request(url,headers = headers) 13 response = urllib2.urlopen(request) 14 print response.read() 15 except urllib2.URLError, e: 16 if hasattr(e,"code"): 17 print e.code 18 if hasattr(e,"reason"): 19 print e.reason

嘿嘿,这次运行终于正常了,打印出了第一页的HTML代码,大家可以运行下代码试试看。在这里运行结果太长就不贴了。

2.提取某一页的所有段子

好,获取了HTML代码之后,我们开始分析怎样获取某一页的所有段子。

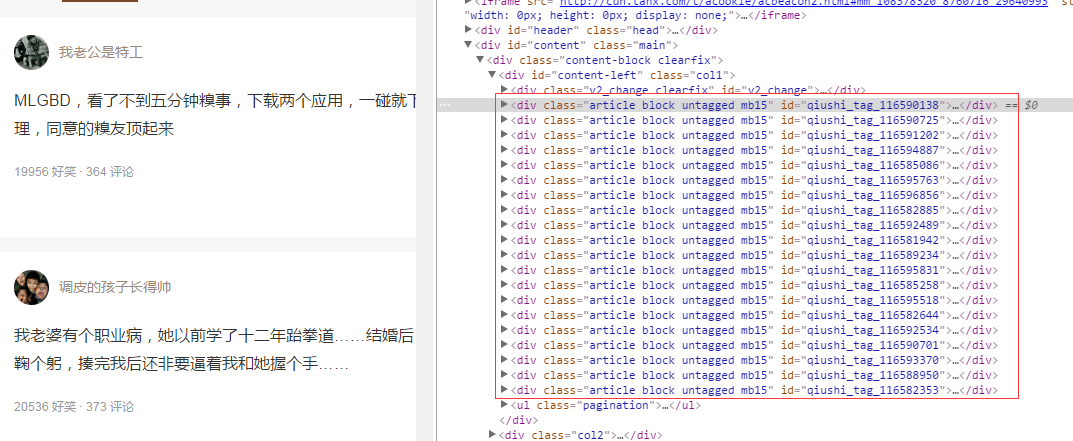

首先我们审查元素看一下,按浏览器的F12,截图如下

我们可以看到,每一个段子都是<div class=”article block untagged mb15″ id=”…”>…</div>包裹的内容。

现在我们想获取发布人,发布日期,段子内容,以及点赞的个数。不过另外注意的是,段子有些是带图片的,如果我们想在控制台显示图片是不现实的,所以我们直接把带有图片的段子给它剔除掉,只保存仅含文本的段子。

所以我们加入如下正则表达式来匹配一下,用到的方法是 re.findall 是找寻所有匹配的内容。方法的用法详情可以看前面说的正则表达式的介绍。

好,我们的正则表达式匹配语句书写如下,在原来的基础上追加如下代码

content = response.read().decode('utf-8') pattern = re.compile('h2>(.*?)</h2.*?content">(.*?)</.*?number">(.*?)</',re.S) items = re.findall(pattern,content) for item in items: print item[0],item[1],item[2]

现在正则表达式在这里稍作说明

1).*? 是一个固定的搭配,.和*代表可以匹配任意无限多个字符,加上?表示使用非贪婪模式进行匹配,也就是我们会尽可能短地做匹配,以后我们还会大量用到 .*? 的搭配。

2)(.*?)代表一个分组,在这个正则表达式中我们匹配了五个分组,在后面的遍历item中,item[0]就代表第一个(.*?)所指代的内容,item[1]就代表第二个(.*?)所指代的内容,以此类推。

3)re.S 标志代表在匹配时为点任意匹配模式,点 . 也可以代表换行符。

这样我们就获取了发布人,发布时间,发布内容,附加图片以及点赞数。

在这里注意一下,我们要获取的内容如果是带有图片,直接输出出来比较繁琐,所以这里我们只获取不带图片的段子就好了。

所以,在这里我们就需要对带图片的段子进行过滤。

我们可以发现,带有图片的段子会带有类似下面的代码,而不带图片的则没有,所以,我们的正则表达式的匹配的时候不去匹配这些就行了

<div class="thumb"> <a href="/article/112061287?list=hot&s=4794990" target="_blank"> <img src="http://pic.qiushibaike.com/system/pictures/11206/112061287/medium/app112061287.jpg" alt="但他们依然乐观"> </a> </div>

现在,整体的代码如下

1 # -*- coding:utf-8 -*- 2 import urllib 3 import urllib2 4 import re 5 import sys # 1 6 7 reload(sys) # 2 8 sys.setdefaultencoding('utf-8') # 3 9 page = 2 10 url = 'http://www.qiushibaike.com/hot/page/' + str(page) 11 user_agent = 'Mozilla/4.0 (compatible; MSIE 5.5; Windows NT)' 12 headers = { 'User-Agent' : user_agent } 13 try: 14 request = urllib2.Request(url,headers = headers) 15 response = urllib2.urlopen(request) 16 content = response.read().decode('utf-8') 17 #pattern = re.compile('<div.*?author clearfix">.*?<h2>(.*?)</h2>.*?<div class="content">(.*?)</div>.*?' + 18 # '<div.*?stats-vote.*?number>(.*?)</i>.*?<span class="stats-comments.*?number">(.*?)</i>.*?</div>',re.S) 19 pattern = re.compile('h2>(.*?)</h2.*?content">(.*?)</.*?number">(.*?)</',re.S) 20 #pattern = re.compile('<div.*?author clearfix">.*?<a.*?<img.*?>(.*?)</a>.*?<div.*?'+ 21 # 'content">(.*?)<!--(.*?)-->.*?</div>(.*?)<div class="stats.*?class="number">(.*?)</i>',re.S) 22 items = re.findall(pattern,content) 23 for item in items: 24 print item[0],item[1],item[2] 25 except urllib2.URLError, e: 26 if hasattr(e,"code"): 27 print e.code 28 if hasattr(e,"reason"): 29 print e.reason

运行一下看下效果

1 逆风飞翔11 2 3 哥们的老婆分娩在即,问我哥们:“如果我要生了,你应该送我去哪里?”<br/><br/>“医院!”他毫不犹豫地说。<br/><br/>“医院的哪个地方?”他老婆担心他到时惊慌失措,又问道。<br/><br/>哥们儿想了想,肯定地说:“解剖室!” 4 5 6270 6 日啦啦啦啦 7 8 以前只在图片上看过,这次见到实物了 9 10 336 11 听说名字长才能娶 12 13 小时候调皮,玩的时候一不小心用脚踩死了一只鸡仔,被爸爸追着打,边追边问:你怎么踩死的,你怎么踩死的啊!我一边哭一边拿着一个鸡仔放在脚底踩了下去说:就是这样踩死的。那顿打,简直就是昏天黑地 14 15 7452 16 医然为你 17 18 儿子看动画片,熊出没。<br/><br/>我:儿子!你要当熊大还是熊二?<br/><br/>儿子:我要当光头强!!<br/><br/>我:为什么?<br/><br/>儿子:因为他是人。。<br/><br/>我:……… 19 20 4324 21 你慢慢笑 22 23 几个人吵架,吵得正凶,有一大汉正要开始动手,对方猛叫“大哥,别介呀,吵得好好的,干嘛要动手呢” 24 25 9336 26 你昵称有我的随便 27 28 楼主一苦逼橱柜安装工,最近太忙想招一学徒。把招聘信息发到各大群里,没有一人咨询。于是我又在后面加了一条:“因要经常与单身女客户独处,故要求学徒不能太色!”呵呵,现在我手机响个不停了。 29 30 4691 31 狱锁狂龙魔 32 33 今天旷课去打游戏,8点才回家看来要被打了,一听有客人,太好了进去一看原来是班主任,这下完了。 34 35 5019 36 李木手杖 37 38 人没钱不如鬼,汤没盐不如水,你会慢慢发现,一颗好心,永远比不上一张好嘴。这句话是多么的现实。会做的不如会说的。 39 40 9438 41 挖鼻孔的老虎 42 43 现在的小孩真让人哭笑不得。<br/>刚刚,三个小屁孩在小区里玩。一个女孩跟一男孩说:“我来演妈妈,你演爸爸。”然后,她指着另一个男孩说:“你演隔壁老王。” 44 45 10044 46 迷恋你的小裤衩 47 48 男:你猜猜我是谁?<br/>女:一巴掌呼了过去。<br/>男:你为什么打我呀?<br/>女:人家让猜我是谁都是捂眼睛的,你TM捂着我的胸是几个意思? 49 50 5232

3.完善交互,设计面向对象模式

好啦,现在最核心的部分我们已经完成啦,剩下的就是修一下边边角角的东西,我们想达到的目的是:

按下回车,读取一个段子,显示出段子的发布人,发布日期,内容以及点赞个数。

另外我们需要设计面向对象模式,引入类和方法,将代码做一下优化和封装,最后,我们的代码如下所示

1 # -*- coding:utf-8 -*- 2 import urllib 3 import urllib2 4 import re 5 import sys # 1 6 import thread 7 import time 8 9 #糗事百科爬虫类 10 class QSBK(object): 11 """docstring for QSBK""" 12 def __init__(self): 13 reload(sys) # 2 14 sys.setdefaultencoding('utf-8') # 3 15 self.pageIndex = 1 16 self.user_agent = 'Mozilla/4.0 (compatible; MSIE 5.5; Windows NT)' 17 #初始化headers 18 self.headers = { 'User-Agent' : self.user_agent } 19 #存放段子的变量,每一个元素是每一页的段子们 20 self.stories = [] 21 #存放程序是否继续运行的变量 22 self.enable = False 23 24 #加载并提取页面的内容,加入到列表中 25 def loadPage(self): 26 #如果当前未看的页数少于2页,则加载新一页 27 if self.enable == True: 28 if len(self.stories) < 2: 29 #获取新一页 30 pageStories = self.getPageItems(self.pageIndex) 31 #将该页的段子存放到全局list中 32 if pageStories: 33 self.stories.append(pageStories) 34 #获取完之后页码索引加一,表示下次读取下一页 35 self.pageIndex += 1 36 37 def getPage(self,pageIndex): 38 try: 39 url = 'http://www.qiushibaike.com/hot/page/' + str(pageIndex) 40 request = urllib2.Request(url,headers=self.headers) 41 response = urllib2.urlopen(request) 42 pageCode = response.read().decode('utf-8') 43 return pageCode 44 except urllib2.URLError, e: 45 if hasattr(e,"code"): 46 print e.code 47 if hasattr(e,"reason"): 48 print e.reason 49 return None 50 51 #传入某一页代码,返回本页不带图片的段子列表 52 def getPageItems(self,pageIndex): 53 pageCode = self.getPage(pageIndex) 54 if not pageCode: 55 print "页面加载失败...." 56 return None 57 pattern = re.compile('h2>(.*?)</h2.*?content">(.*?)</.*?number">(.*?)</',re.S) 58 items = re.findall(pattern,pageCode) 59 #用来存储每页的段子们 60 pageStories = [] 61 #遍历正则表达式匹配的信息 62 for item in items: 63 replaceBR = re.compile('<br/>') 64 text = re.sub(replaceBR," ",item[1]) 65 #item[0]是一个段子的发布者,item[1]是内容,item[2]是点赞数 66 pageStories.append([item[0].strip(),text.strip(),item[2].strip()]) 67 return pageStories 68 69 def getOneStory(self,pageStories,page): 70 for story in pageStories: 71 input = raw_input() 72 self.loadPage() 73 if input == "Q": 74 self.enable = False 75 return 76 print u"第%d页 发布人:%s 赞:%s %s" %(page,story[0],story[2],story[1]) 77 78 def start(self): 79 print u"正在读取糗事百科,按回车查看新段子,Q退出" 80 #使变量为True,程序可以正常运行 81 self.enable = True 82 #先加载一页内容 83 self.loadPage() 84 #局部变量,控制当前读到了第几页 85 nowPage = 0 86 while self.enable: 87 if len(self.stories)>0: 88 #从全局list中获取一页的段子 89 pageStories = self.stories[0] 90 #当前读到的页数加一 91 nowPage += 1 92 #将全局list中第一个元素删除,因为已经取出 93 del self.stories[0] 94 #输出该页的段子 95 self.getOneStory(pageStories,nowPage) 96 97 if __name__ == '__main__': 98 spider = QSBK() 99 spider.start()

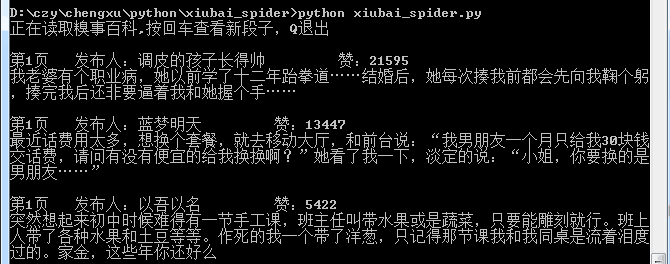

运行效果:

好啦,大家来测试一下吧,点一下回车会输出一个段子,包括发布人,发布时间,段子内容以及点赞数,是不是感觉爽爆了!