一、模型假设

传统多元线性回归模型

最重要的假设的原理为:

1. 自变量和因变量之间存在多元线性关系,因变量y能够被x1,x2….x{k}完全地线性解释;2.不能被解释的部分则为纯粹的无法观测到的误差

其它假设主要为:

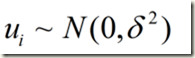

1.模型线性,设定正确; 2.无多重共线性; 3.无内生性; 4.随机误差项具有条件零均值、同方差、以及无自相关; 5.随机误差项正态分布

具体见另一篇文章:回归模型的基本假设

二、估计方法

目标:估计出多元回归模型的参数

注:下文皆为矩阵表述,X为自变量矩阵(n*k维),y为因变量向量(n*1维)

OLS(普通最小二乘估计)

思想:多元回归模型的参数应当能够使得, 因变量y的样本向量 在 由自变量X的样本所构成的线性空间G(x)的投影(即y’= xb)为向量y在 线性空间G(x)上的正交投影。直白一点说,就是要使得(y-y’)’(y-y’)最小化,从而能够使y的预测值与y的真实值之间的差距最小。

使用凸优化方法,可以求得参数的估计值为:b = (x’x)^(-1)x’y

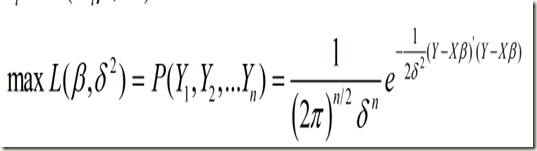

最大似然估计

既然已经在假设中假设了随机误差项的分布为正态分布,

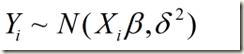

那么自变量y的分布也可以由线性模型推算出来(其分布的具体函数包括参数b在内)。

进一步的既然已经抽取到了y的样本,那么使得y的样本出现概率(联合概率密度)最大的参数即为所求

最终结果与OLS估计的结果是一致的

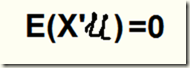

矩估计

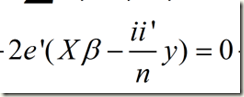

思想:通过寻找总体矩条件(模型设定时已经有的假设,即无内生性),在总体矩条件中有参数的存在,然后用样本矩形条件来进行推导未知参数的解。

在多元回归中有外生性假设:

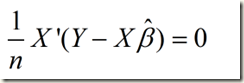

对应的样本矩为:

最终估计结果与OLS方法也是一样的。

三、模型检验

1.拟合优度检验

(1)因变量y是随机变量,而估计出来的y’却不是随机变量;

(2)拟合优度表示的是模型的估计值y’能够在多大程度上解释因变量样本y的变动。

(3)y’的变动解释y的变动能力越强,则说明模型拟合的越好y-y’就越接近与假设的随机误差

(4)而因变量的变动是由其方差来描述的。

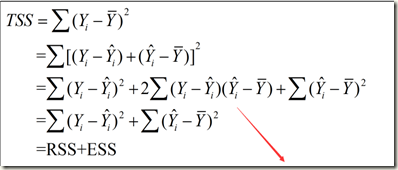

所以定义3个变动:y’的变动,y的变动,以及随机误差u的变动。y的变动是由y’的变动和u的变动所构成的。

TSS:总回归平方和,代表y的变动

RSS:残差平方和,代表y’没有观测到的变动,这部分越大,说明拟合效果越差

ESS:回归平方和,代表y’观测到的变动,这部分越大,说明拟合效果越好。

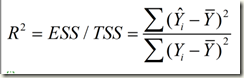

进一步地,得出了拟合系数

需要注意的是,拟合系数并非越大越好,过度拟合的模型是难以进行外推的。

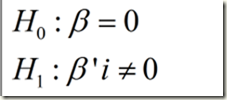

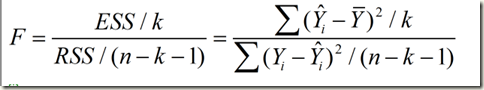

2.总体线性的检验

思想:若是所有参数的系数都为0,那么y的变动纯粹是由随机项的变动决定的,ESS模型解释的变动范围即为随机项的变动范围,由于随机项服从正态分布,那么ESS则服从卡方分布,又RSS为随机项的变动,本身就服从卡方分布。因此可以构造F统计量

若F值过大,则原假设成立的可能性就很小了。

3.变量显著性的检验

变量显著性的检验思想非常简单:由于b = (x’x)^(-1)x’y,再加上随机项正态分布的假设,便可以得出b的正态分布结论,同时由于随机项的方差是未知的,所以我们便用余差平方和对方差进行估计,从而能够构造T统计量。