神经网络简介

介绍

在过去的十年中,性能最佳的人工智能系统(例如智能手机上的语音识别器或Google最新的自动翻译器)源自“深度学习”技术。实际上,深度学习是一种称为神经网络的人工智能方法的新名称,这种方法已经流行了70多年。神经网络由沃伦·麦卡洛(Warren McCullough)和沃尔特·皮茨(Walter Pitts)于1944年首次提出,这是两位芝加哥大学的研究人员,他们于1952年移居麻省理工学院,有时是第一个认知科学系的创始成员。

神经网络是一组算法,以人脑为基础进行松散建模,旨在识别模式并分层构建。他们通过一种机器感知,标记或聚集原始输入来解释感官数据。常用的神经网络类型包括卷积神经网络和递归神经网络。

架构

下图描述了有关神经网络架构的词汇:

激活功能

在隐藏单元的末尾使用激活函数将非线性复杂性引入模型。这是最常见的:

交叉熵损失

在神经网络的上下文中,交叉熵损失L(z,y)是常用的,定义如下:

学习率

学习率(通常记为α或有时为η)表示权重以什么速度更新。这可以是固定的或自适应地更改的。当前最流行的方法称为Adam,这是一种适应学习率的方法。

反向传播

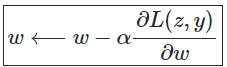

反向传播是一种通过考虑实际输出和所需输出来更新神经网络中权重的方法。关于权重w的导数是使用链规则计算的,其形式如下:

结果,权重更新如下:

更新权重

在神经网络中,权重更新如下:

- 步骤1:获取一批训练数据。

- 步骤2:执行前向传播以获得相应的损耗。

- 步骤3:反向传播损耗以获得梯度。

- 步骤4:使用梯度来更新网络的权重。

Dropout

Dropout是一种旨在通过丢弃神经网络中的单元来防止训练数据过度拟合的技术。在实践中,神经元要么以概率p掉落,要么以概率1-p保持。

著名的数据集

- MNIST: 那里是最受欢迎的深度学习数据集之一

- MS-COCO: 大型且丰富的对象检测,分割和字幕数据集

- ImageNet

- Open Images Dataset

- VisualQA

- The Street View House Numbers (SVHN)

- CIFAR-10

- Fashion-MNIST

资料来源

- https://pathmind.com/wiki/neural-network

- https://www.analyticsvidhya.com/blog/2018/03/comprehensive-collection-deep-learning-datasets/

- https://stanford.edu/~shervine/teaching/cs-229/cheatsheet-deep-learning

- http://news.mit.edu/2017/explained-neural-networks-deep-learning-0414

教程索引

#1:神经网络简介

#2:神经网络模型,应用程序,优化器和示例代码

翻译自Kaggle