微软的那个臭屁的JOEL(就是写《JOEL说软件》的那个牛人)曾说:“每一位软件开发人员必须、绝对要至少具备UNICODE与字符集知识(没有任何例外)”,我也常常困扰于字符集的转换等很多问题,所以这次下决心要把他搞个清楚。

有关字符编码的学习,在这篇blog中,就从两个程序开始:

class TestDataGenerator { public static void CreateNewTestDataFile(string FileName, int record_length) { using(FileStream fs = File.Create(FileName)) { StringBuilder sb = new StringBuilder(); for (int i = 0; i < record_length; i++ ) { sb.Append('的'); }//for byte[] content = Encoding.Unicode.GetBytes(sb.ToString()); fs.Write(content, 0, content.Length); }//using }//CreateNewTestDataFile() }

在上面的代码中:

Encoding.Unicode.GetBytes(sb.ToString());

这句话的意思就是把string编码成UTF-16的字节流。

调用该函数生成包含100个字符的测试文件:

TestDataGenerator.CreateNewTestDataFile("test.txt", 100);

可以看到文件大小为200字节。原因是UTF-16使用2个字节来存储包括汉字和ASCII码在内的字符

读取Unicode字符串:

FileStream fs = new System.IO.FileStream("test.txt", FileMode.Open, FileAccess.Read);

byte[] blob = new byte[100];

fs.Read(blob, 0, 100);

fs.Flush();

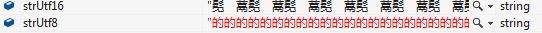

string strUtf16 = Encoding.Unicode.GetString(blob);

string strUtf8 = Encoding.UTF8.GetString(blob);

从Watch窗口可见, 将字符串强转为UTF-8形式会出现乱码,这是因为UTF-8标准使用3个字节来存储汉字等字符,而不是UTF-16的2个字节。

下面使用UTF-8编码存储字符:

byte[] content = Encoding.UTF8.GetBytes(sb.ToString()); fs.Write(content, 0, content.Length);

然后就能看到文件的大小为300个字节:

同理用UTF-16的编码方式去读取UTF-8编码方式存储的文件也是不行的。

对上面的代码解释几个概念:

C#的类Encoding的Encoding.Unicode属性:获取使用Little-Endian字节顺序的UTF-16格式的编码。

C#的类Encoding的Encoding.ASCII属性:获取ASCII(7位)字符集的编码。

C#的类Encoding的Encoding.UTF8属性:获取UTF-8格式的编码。

看完了程序部分,下面看一下理论的东西:

一、 ASCII码

我们知道,在计算机内部,所有的信息最终都表示为一个二进制的字符串。每一个二进制位(bit)有0和1两种状态,因此八个二进制位就可以组合出256种状态,这被称为一个字节(byte)。也就是说,一个字节一共可以用来表示256种不同的状态,每一个状态对应一个符号,就是256个符号,从00000000到11111111。

上个世纪60年代,美国制定了一套字符编码,对英语字符与二进制位之间的关系,做了统一规定。这被称为ASCII码,一直沿用至今。ASCII码一共规定了128个字符的编码,比如空格“SPACE”是32(二进制00100000),大写的字母A是65(二进制01000001)。这128个符号(包括32个不能打印出来的控制符号),只占用了一个字节的后面7位,最前面的1位统一规定为0。

在C#中如果你想看看某个字母的ASCII码是多少,可以使用表示字符编码的类Encoding ,代码如下:

string s = "a";

byte[] ascii = Encoding.ASCII.GetBytes(s);

我们通过调试器可以看到ascii中为97,也就是说a的ASCII码为97(1100001)

二、非ASCII编码

英语用128个符号编码就够了,但是用来表示其他语言,128个符号是不够的。比如,在法语中,字母上方有注音符号,它就无法用ASCII码表示。于是,一些欧洲国家就决定,利用字节中闲置的最高位编入新的符号。比如,法语中的é的编码为130(二进制10000010)。这样一来,这些欧洲国家使用的编码体系,可以表示最多256个符号。

但是,这里又出现了新的问题。不同的国家有不同的字母,因此,哪怕它们都使用256个符号的编码方式,代表的字母却不一样。比如,130在法语编码中代表了é,在希伯来语编码中却代表了字母Gimel ,在俄语编码中又会代表另一个符号。但是不管怎样,所有这些编码方式中,0—127表示的符号是一样的,不一样的只是128—255的这一段。

至于亚洲国家的文字,使用的符号就更多了,汉字就多达10万左右。一个字节只能表示256种符号,肯定是不够的,就必须使用多个字节表达这些符号。比如,简体中文常见的编码方式是GB2312,使用两个字节表示一个汉字,所以理论上最多可以表示256x256=65536个符号。在C#中如果你想看看某个汉字的GB2312编码可以使用如下代码:

string s = "梁";

System.Text.Encoding GB2312 = System.Text.Encoding.GetEncoding("GB2312");

byte[] gb = GB2312.GetBytes(s);

这时gb中有两个数字193(11000001),186(10111010)

三、Unicode

正如上边所说,世界上存在着多种编码方式,同一个二进制数字可以被解释成不同的符号。因此,要想打开一个文本文件,就必须知道它的编码方式,否则用错误的编码方式解读,就会出现乱码。为什么电子邮件常常出现乱码?就是因为发信人和收信人使用的编码方式不一样。

可以想象,如果有一种编码,将世界上所有的符号都纳入其中。每一个符号都给予一个独一无二的编码,那么乱码问题就会消失。这就是Unicode,就像它的名字都表示的,这是一种所有符号的编码。

Unicode当然是一个很大的集合,现在的规模可以容纳100多万个符号。每个符号的编码都不一样。C#中如果你想看看某个汉字的Unicode编码可以使用如下代码:

string s = "梁"; byte[] unicode = Encoding.Unicode.GetBytes(s);

这时unicode中有两个数字129(10000001),104(1101000)

四、Unicode的问题

需要注意的是,Unicode只是一个符号集,它只规定了符号的二进制代码,却没有规定这个二进制代码应该如何存储,UTF-8和UTF-16都是Unicode的存储方式。。

比如,汉字“梁”的unicode是(110100010000001),也就是说这个符号的表示至少需要2个字节。表示其他更大的符号,可能需要3个字节或者4个字节,甚至更多。

这里就有两个严重的问题,第一个问题是,如何才能区别unicode和ascii?计算机怎么知道三个字节表示一个符号,而不是分别表示三个符号呢?第二个问题是,我们已经知道,英文字母只用一个字节表示就够了,如果unicode统一规定,每个符号用三个或四个字节表示,那么每个英文字母前都必然有二到三个字节是0,这对于存储来说是极大的浪费,文本文件的大小会因此大出二三倍,这是无法接受的。

它们造成的结果是:

1)出现了unicode的多种存储方式,也就是说有许多种不同的二进制格式,可以用来表示unicode。

2)unicode在很长一段时间内无法推广,直到互联网的出现。

五、UTF-8

互联网的普及,强烈要求出现一种统一的编码方式。UTF-8就是在互联网上使用最广的一种unicode的实现方式。其他实现方式还包括UTF-16和UTF-32,不过在互联网上基本不用。重复一遍,这里的关系是,UTF-8是Unicode的实现方式之一。

UTF-8最大的一个特点,就是它是一种变长的编码方式。它可以使用1~4个字节表示一个符号,根据不同的符号而变化字节长度。

UTF-8的编码规则很简单,只有二条:

1)对于单字节的符号,字节的第一位设为0,后面7位为这个符号的unicode码。因此对于英语字母,UTF-8编码和ASCII码是相同的。

2)对于n字节的符号(n>1),第一个字节的前n位都设为1,第n+1位设为0,后面字节的前两位一律设为10。剩下的没有提及的二进制位,全部为这个符号的unicode码。

举一个例子:

string s = "梁"; byte[] unicode = Encoding.Unicode.GetBytes(s); byte[] utf8 =Encoding.UTF8.GetBytes(s);

调试运行,可以看到:

这里在内存中的数据是由高到低排列的,104十六进制为68,129十六进制为81,也就是说"梁"的unicode是十六进制为6881,二进制为110100010000001,我们从上边的表中可以查到,6881应该属于地三行(800-FFFF),因此"梁"的UTF-8编码需要三个字节即格式是“1110xxxx 10xxxxxx 10xxxxxx”。然后,从“梁”的最后一个二进制位开始,依次从后向前填入格式中的x,多出的位补0。这样就得到了,“梁”的UTF-8编码是“11100110 10100010 10000001”,按没8位转换成十进制就是230,162,129。正好和上图中utf8中的值一样。

七、UTF8优点

UTF-8是世界通用的语言编码,如果在其他语言的操作系统下访问gb2312编码的网站,需要下载语言包,所以为了网站的通用性起见,用UTF8编码是更好的选择,但是相比较而言gb2312要比UTF-8得到的数据量少一些。

八、乱码问题:

如果在内存、文件或电子邮件中有一个字符串,那么应该知道它是使用什么编码方案,否则就不能将它正确的解释或显示给用户。如果在试图使用的编码方案中没有相应的编码值得等价内容,那么通常会显示一个小问号“?”,或者显示一个方框。NET中内存中的字符串都是Unicode,而asp.net程序默认是UTF-8编码,我们在使用某些字符串时出现了乱码,我们首先要判断是不是我们解释用的编码方式出错了。