下载网站:www.SyncNavigator.CN

客服QQ1793040

----------------------------------------------------------

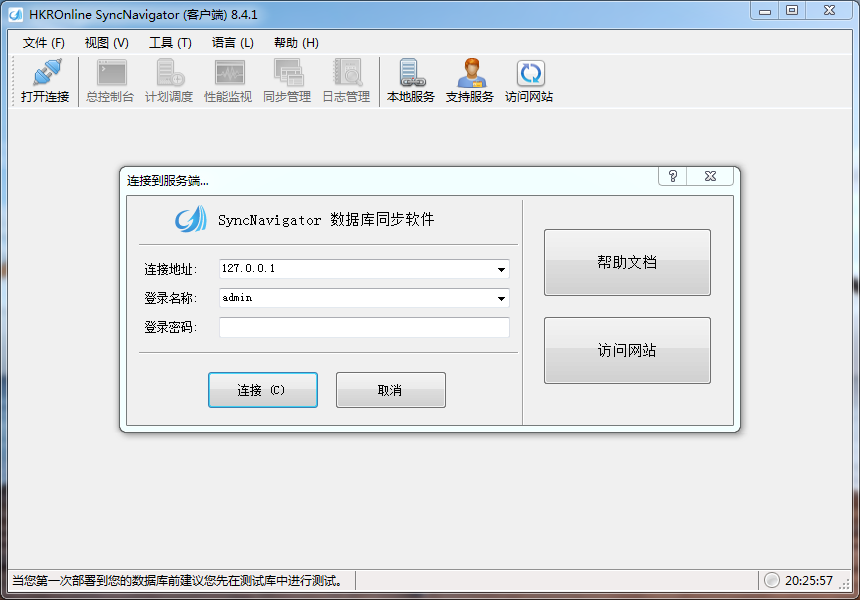

关于HKROnline SyncNavigator 注册机价格的问题

HKROnline SyncNavigator 8.4.1 非破解版 注册机 授权激活教程

最近一直在研究数据库同步的问题,在网上查了很多资料,也请教了很多人,找到了一种通过快照复制的方法。研究了一番后发现之前就是用的这个方法,效果不是很好,果断放弃。经过了一番寻觅和他人指点,最后从一位热心网友那里得知一款很好用的软件—— SyncNavigator。

好东西就要拿出来跟大家分享,所以今天向大家介绍一下这款软件,及其一些使用方法。下面先看看它有什么强大的功能吧!

SyncNavigator的基本功能:

自动同步数据/定时同步数据

无论是实时同步/24小时不间断同步,还是根据计划任务(每小时/每日/每周/等)定时自动同步都能完全胜任。

完整支持 Microsoft SQL Server

完整支持 Microsoft SQL Server 2000 2005 2008 数据库类型。并能在不同数据库版本之间相互同步数据。

数据集成(Data Integration)产品提供数据同步服务,有向导模式和脚本模式两种方式。向导模式更简单,脚本模式更灵活。

本章介绍如何将Table Store中的增量数据通过数据集成的脚本模式同步到OpenSearch中。

途径

数据集成脚本模式

- Reader:OTSStreamReader

- Writer:OSSWriter

配置Table Store

无需配置。

配置OSS

无需配置。

配置数据集成

- 创建Table Store数据源。

说明

- 如果已经创建了Table Store的数据源,可以跳过这一步。

- 如果您不希望创建数据源,也可以在后续的配置页面中配置相应的endpoint、instanceName、AccessKeyID和AccessKeySecret。

创建数据源的具体步骤,请参见创建Table Store数据源。

- 创建OSS数据源。

本操作与上一个步骤类似,只是选择OSS作为数据源。说明 配置OSS数据源的参数时,注意Endpoint不包括bucketName。

- 创建同步任务。

- 登录数据集成控制台。

- 在同步任务页面,选择脚本模式。

- 在弹出的导入模板对话框中,来源类型选择OTS Stream,目标类型选择OSS。

- 单击确认,进入配置页面。

- 完善配置项。

- 在配置界面,已经提前嵌入了OTSStreamReader和OSSWriter的模板,请参考以下解释完成配置。

{ "type": "job", "version": "1.0", "configuration": { "setting": { "errorLimit": { "record": "0" # 允许出错的个数,当错误超过这个数目的时候同步任务会失败。 }, "speed": { "mbps": "1", # 每次同步任务的最大流量。 "concurrent": "1" # 每次同步任务的并发度。 } }, "reader": { "plugin": "otsstream", # Reader插件的名称。 "parameter": { "datasource": "", # Table Store的数据源名称,如果有此项则不再需要配置endpoint,accessId,accessKey和instanceName。 "dataTable": "", # TableStore中的表名。 "statusTable": "TableStoreStreamReaderStatusTable", # 存储TableStore Stream状态的表,一般不需要修改。 "startTimestampMillis": "", # 开始导出的时间点,由于是增量导出,需要循环启动此任务,则这里每次启动的时候的时间都不一样,这里需要设置一个变量,比如${start_time}。 "endTimestampMillis": "", # 结束导出的时间点。这里也需要设置一个变量,比如${end_time}。 "date": "yyyyMMdd", # 导出哪一天的数据,功能和startTimestampMillis、endTimestampMillis重复,这一项需要删除。 "mode": "single_version_and_update_only", # TableStore Stream导出数据的格式,目前需要设置成:single_version_and_update_only。如果配置模板中没有则需要增加。 "column":[ # 需要导出TableStore中的哪些列到OSS中去,如果配置模板中没有则需要增加,具体配置个数由用户自定义设置 { "name": "uid" # 列名,这个是Table Store中的主键 }, { "name": "name" # 列名,这个是Table Store中的属性列。 }, ], "isExportSequenceInfo": false, # single_version_and_update_only 模式下只能是false。 "maxRetries": 30 # 最大重试次数。

- 在配置界面,已经提前嵌入了OTSStreamReader和OSSWriter的模板,请参考以下解释完成配置。