Person reID

2020-05-28 17:16:57

Updated on GitHub: https://github.com/wangxiao5791509/Cloth_Change_Person_reID_Paper_List

Paper-list:

https://github.com/wangxiao5791509/Cloth_Change_Person_reID_Paper_List

Survey papers on person re-identification

Ye, Mang, et al. "Deep Learning for Person Re-identification: A Survey and Outlook." arXiv preprint arXiv:2001.04193 (2020). [Paper]

Benchmark Datasets

- COCAS dataset, cvpr-2020, [Paper]

- LTCC dataset, arXiv-2020, [Paper]

- Celebrities-ReID, IJCNN-2019, [Paper]

- Celeb-reID, T-CSVT 2019, [Paper]

- VC-Clothes && Real28, arXiv-2020, [Paper]

- PRCC dataset, T-PAMI, 2019, [Paper]

Paper List

Year 2020

Wan, Fangbin, et al. "When Person Re-identification Meets Changing Clothes." arXiv preprint arXiv:2003.04070 (2020). [Paper] [Project] [Dataset]

Yu, Shijie, et al. "COCAS: A Large-Scale Clothes Changing Person Dataset for Re-identification." arXiv preprint arXiv:2005.07862 (2020). [Paper] [Dataset]

Li, Yu-Jhe, et al. "Learning Shape Representations for Clothing Variations in Person Re-Identification." arXiv preprint arXiv:2003.07340 (2020). [Paper]

Qian, Xuelin, et al. "Long-Term Cloth-Changing Person Re-identification." arXiv preprint arXiv:2005.12633 (2020). [Paper] [Project]

Year 2019

Huang, Yan, et al. "Celebrities-ReID: A Benchmark for Clothes Variation in Long-Term Person Re-Identification." 2019 International Joint Conference on Neural Networks (IJCNN). IEEE, 2019. [Paper]

Yang, Qize, Ancong Wu, and Wei-Shi Zheng. "Person Re-identification by Contour Sketch under Moderate Clothing Change." IEEE Transactions on Pattern Analysis and Machine Intelligence (2019). [Paper] [Dataset]

Huang, Yan, et al. "Beyond Scalar Neuron: Adopting Vector-Neuron Capsules for Long-Term Person Re-Identification." IEEE Transactions on Circuits and Systems for Video Technology (2019). [Paper] [Project]

Year 2018 and Before

Zhang, Peng, et al. "Long-term person re-identification using true motion from videos." 2018 IEEE Winter Conference on Applications of Computer Vision (WACV). IEEE, 2018. [Paper]

RGB-D for Cloth-change reID

Barbosa, Igor Barros, et al. "Re-identification with rgb-d sensors." European Conference on Computer Vision. Springer, Berlin, Heidelberg, 2012. [Paper]

Munaro, Matteo, et al. "3D reconstruction of freely moving persons for re-identification with a depth sensor." 2014 IEEE International Conference on Robotics and Automation (ICRA). IEEE, 2014. [Paper]

Haque, Albert, Alexandre Alahi, and Li Fei-Fei. "Recurrent attention models for depth-based person identification." Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2016. [Paper]

==== 算法简介:

1. Huang, Yan, et al. "Celebrities-ReID: A Benchmark for Clothes Variation in Long-Term Person Re-Identification." 2019 International Joint Conference on Neural Networks (IJCNN). IEEE, 2019. [Paper]

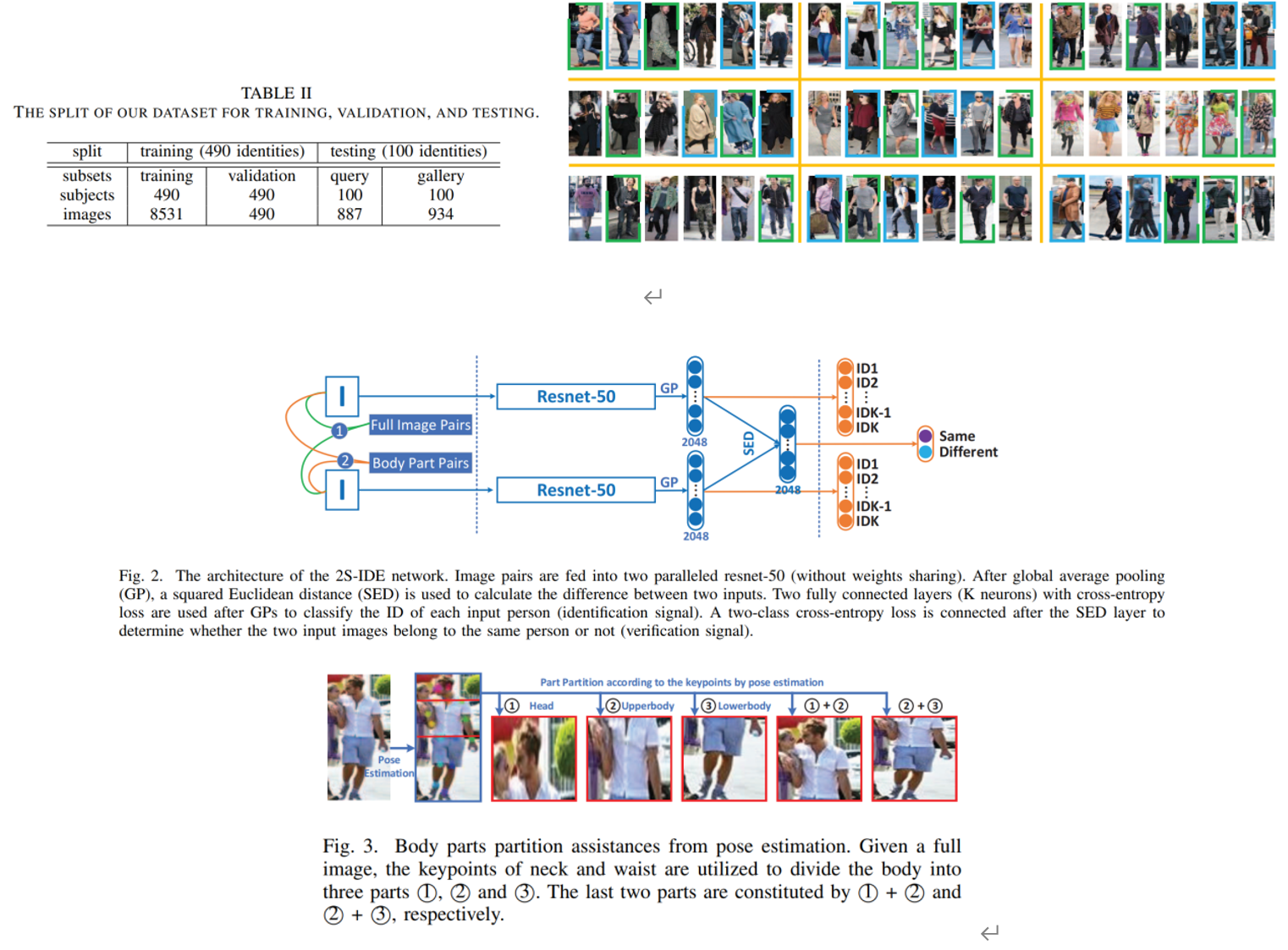

这个算法提出一种结合局部和全局图像块进行特征学习的baseline方法。分为两个阶段进行训练:

第一个阶段,利用全身的图像进行学习;第二个阶段,利用骨骼定位算法(姿态估计)得到18个关键点,然后推理出身体的大致几个躯干,抠出来计算对应的欧氏距离,作为最终相似度。

另外就是提出一个换衣服的数据集 Celebrities-reID:

2. Huang, Yan, et al. "Beyond Scalar Neuron: Adopting Vector-Neuron Capsules for Long-Term Person Re-Identification." IEEE Transactions on Circuits and Systems for Video Technology (2019). [Paper] [Project] Celeb-reID

在上一个数据集的基础上,作者进行了拓展。提出了更大的数据集和新的baseline方法。

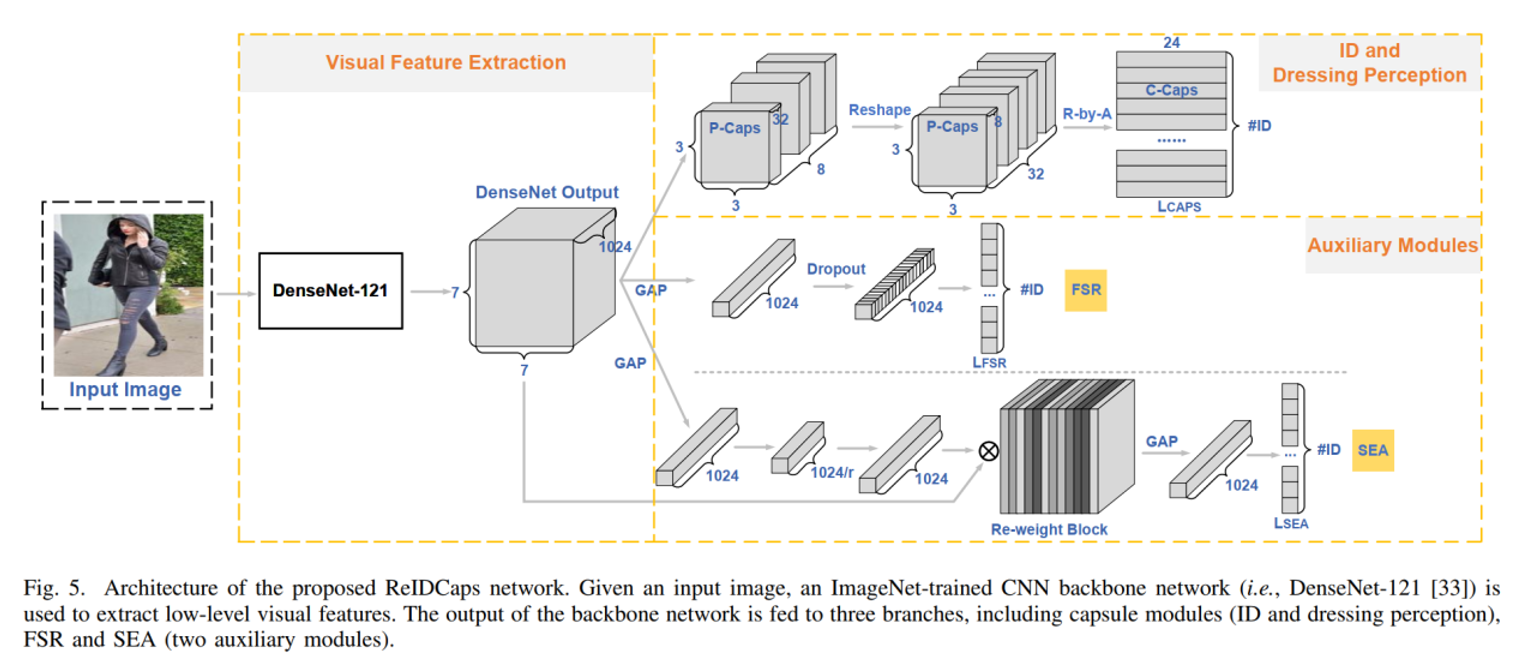

如上图所示,本文将胶囊网络引入 reID 领域,胶囊网络对每一个ID输出的不再是常规 FC 的一个值,而是一个向量,其中向量的长度表达该示例是否存在(存在的行人ID的似然性), 第二个维度用来建模该示例的属性(同一个ID,但是不同衣服)。具体来说,作者首先用一个 DenseNet-121来提取给定图像的视觉特征,然后将该输出分别输入到三个不同的分支中。第一个是胶囊网络分支,其实也就是常规的进行分类,这里采用的 loss 为 margin loss。另外两个分支分别是 FSR 和 SEA机制。FSR是常规的fc分类,加了dropout来防止过拟合。SEA引入了Squeezeand-Excitation (SE) block 来得到更加具有判别性的特征。

3. Yu, Shijie, et al. "COCAS: A Large-Scale Clothes Changing Person Dataset for Re-identification." arXiv preprint arXiv:2005.07862 (2020). [Paper] [Dataset]

本文提出一种新的行人在识别,并且是换衣服的再识别任务:给定 prob 和 衣服模板,到 gallery 中去匹配。

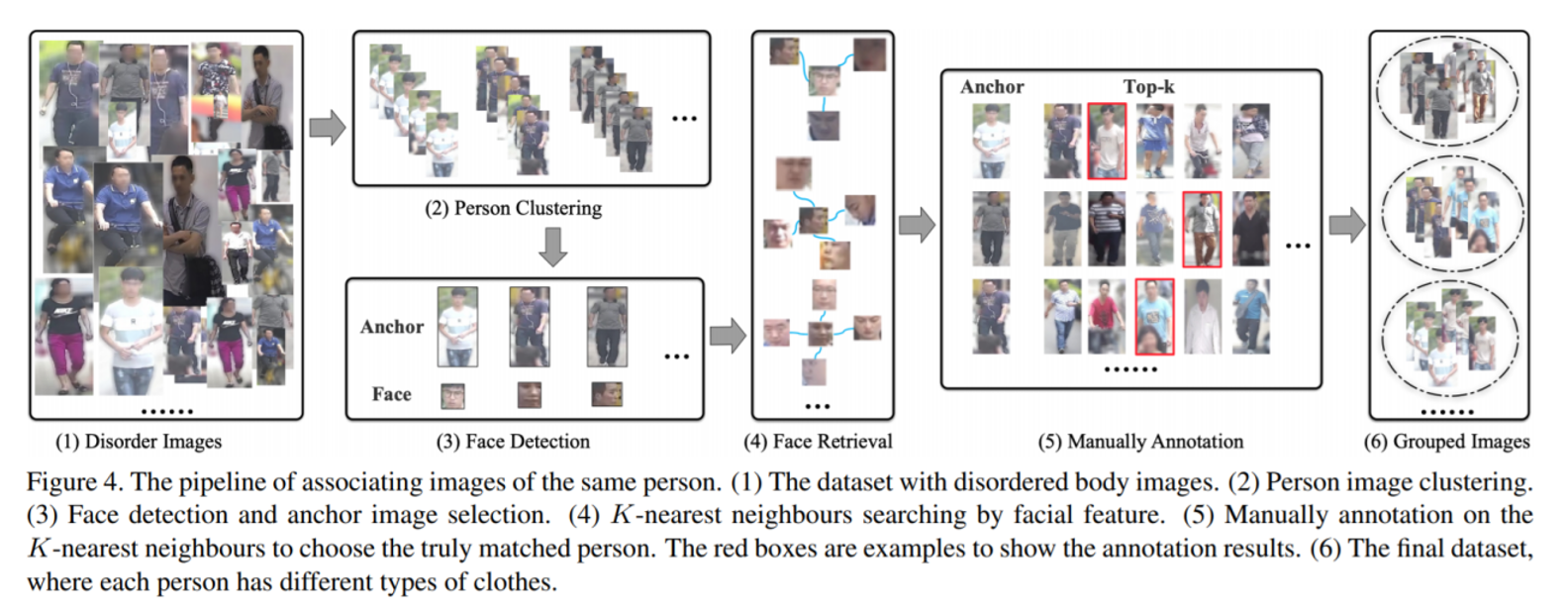

此外,作者设计了一个 baseline 方法来结合衣服的特征 和 行人的生物特征,联合起来进行再识别。为了完成这个任务,作者提出了一个新的行人换衣服的数据集,数据处理方法如下所示:

大致可以总结为如下几个步骤:

1). Person Clustering: 利用 reid 算法进行聚类,然后手工扔掉 outlinear 的图像;

2). Face Detection:选择一张作为 anchor image,然后对其进行人脸检测;

3). Face Retrieval:利用 FaceNet 抽取人脸特征,选择 top-k 近邻的图像;

4). Manual Annotation:手动选择真正匹配的行人图像。

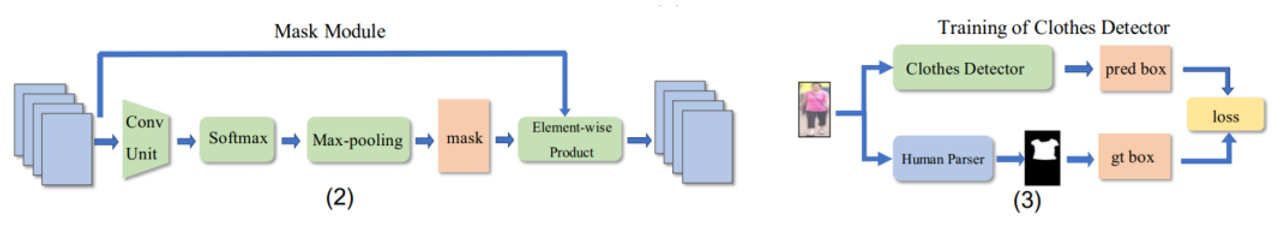

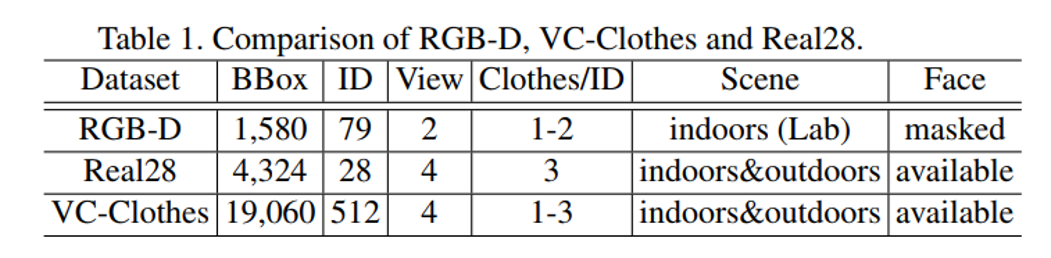

作者对行人选择 2-3 个衣服,然后每一个衣服包含 2-5 张图像。有了上述图像,作者设计了如下的网络结构来学习行人生物特征 和 衣服的特征,进行检索。该模块包含两个部分:

如上图所示,一个是对行人提取生物特征,一个是学习衣服的特征。

作者提到,在 BC-Net 中,衣服检测器 和 特征提取器是分别进行训练的。

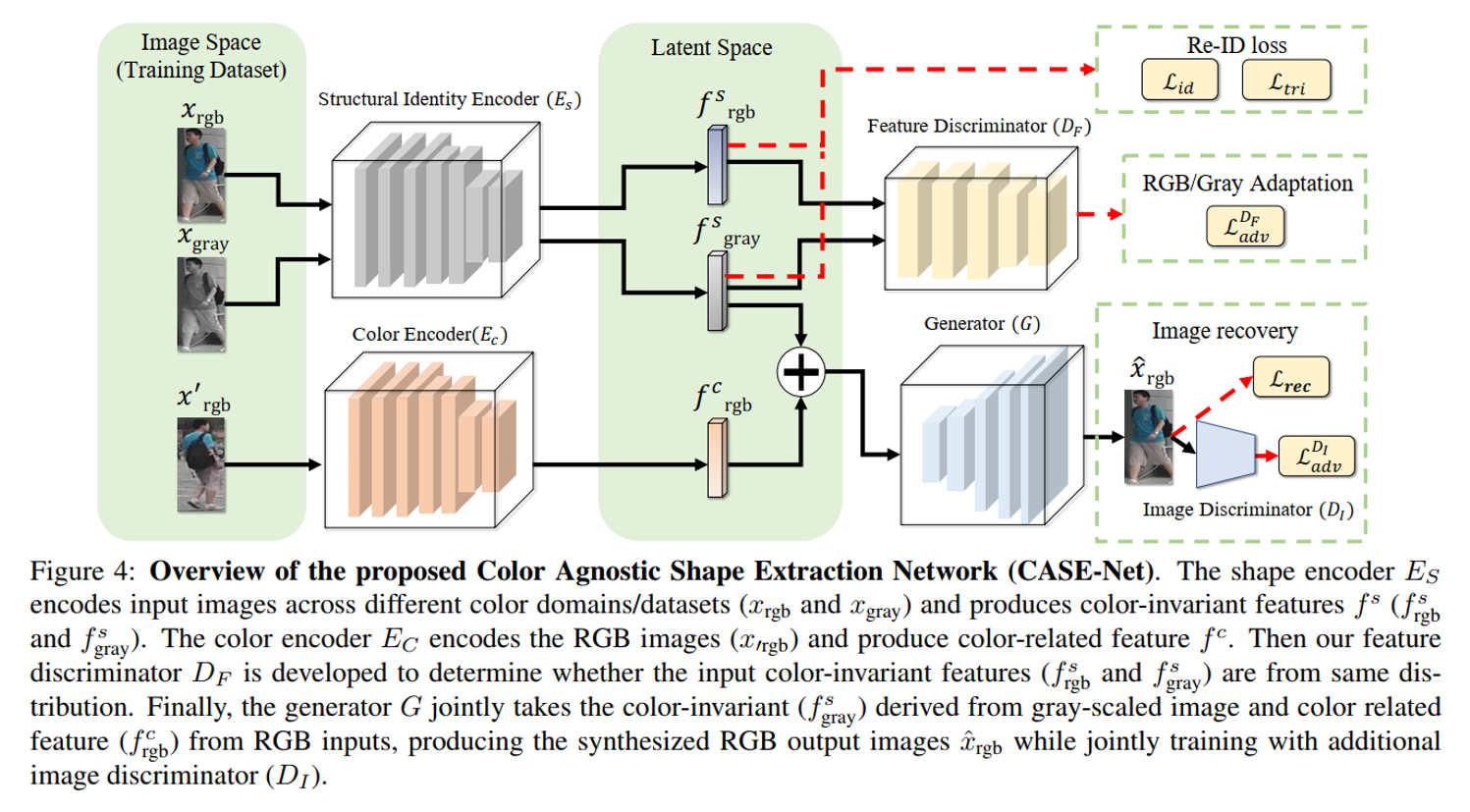

4. Li, Yu-Jhe, et al. "Learning Shape Representations for Clothing Variations in Person Re-Identification." arXiv preprint arXiv:2003.07340 (2020). [Project] [Paper] [Code] [Dataset]

5. Wan, Fangbin, et al. "When Person Re-identification Meets Changing Clothes." arXiv preprint arXiv:2003.04070 (2020). [Paper] [Project] [Dataset]

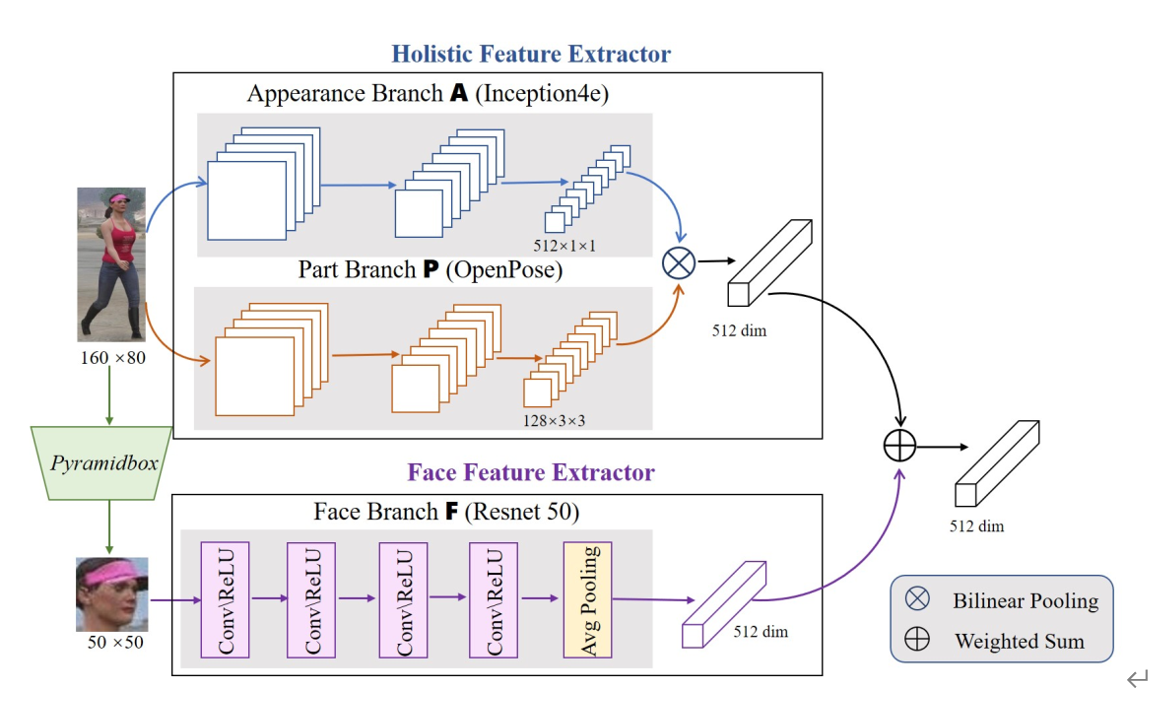

本文提出两个数据集,一个是真实数据集,另外一个是虚拟数据。但是量都不是很大:

另外就是提出一种基准方法,是将常规的 reid 算法(ECCV 2018的一个算法,可以同时提取整体和局部特征的reID算法)和人脸检测相结合,如上图所示。作者做了一些实验,说明了人脸信息对最终reID效果提升明显。

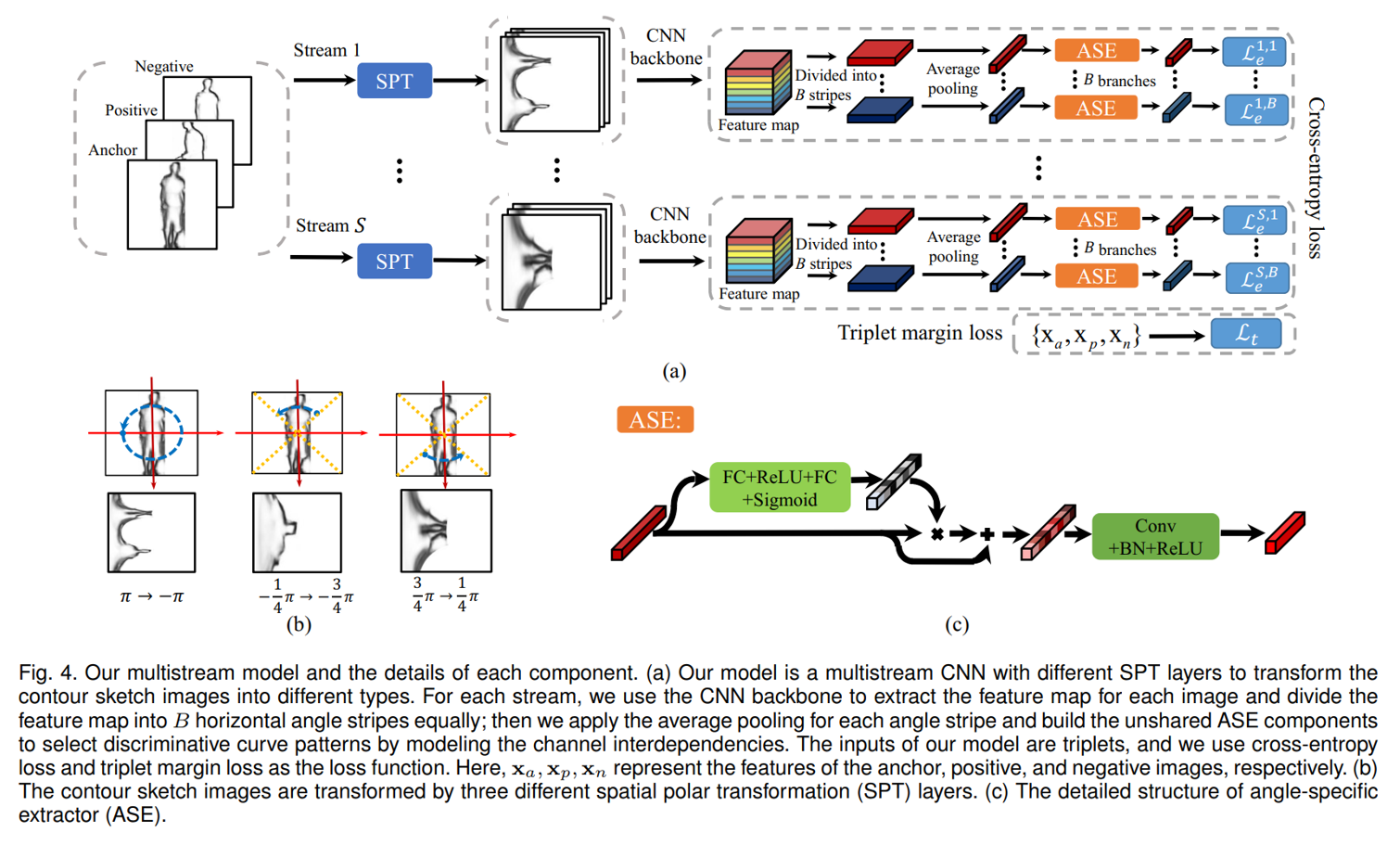

6. Yang, Qize, Ancong Wu, and Wei-Shi Zheng. "Person Re-identification by Contour Sketch under Moderate Clothing Change." IEEE Transactions on Pattern Analysis and Machine Intelligence (2019). [Paper] [Dataset]

中山大学郑老师的工作,从行人的轮廓信息来进行换衣服的行人再识别。他们首先用轮廓提取算法得到行人的轮廓图,然后用提出的SPT算法对这些轮廓图进行转换。这里的SPT算法是将笛卡尔坐标系转换为空间极坐标系,然后利用CNN来提取这些新的图像。再进行分类,结合了交叉熵损失函数和三元组损失函数。此外,作者也提出一个新的换衣服数据集,包含221个个体,总共33698张图。

7. Zhang, Peng, et al. "Long-term person re-identification using true motion from videos." 2018 IEEE Winter Conference on Applications of Computer Vision (WACV). IEEE, 2018. [Paper]

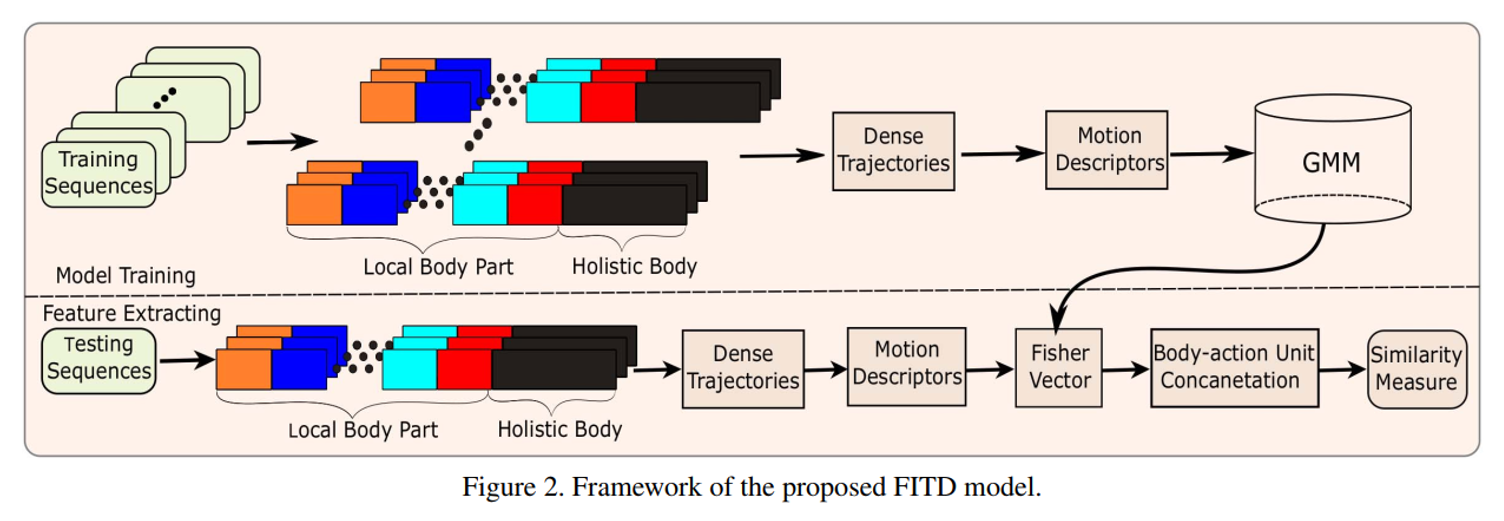

本文提出利用运动信息来协助长期的行人再识别。如上图所示,模型训练部分来学习包含判别性运动的码本,特征提取模块来编码运动类型来产生统一的特征向量。特别的,每一个阶段都是基于轨迹对齐的运动统计来对应不同级别的运动基本动作。

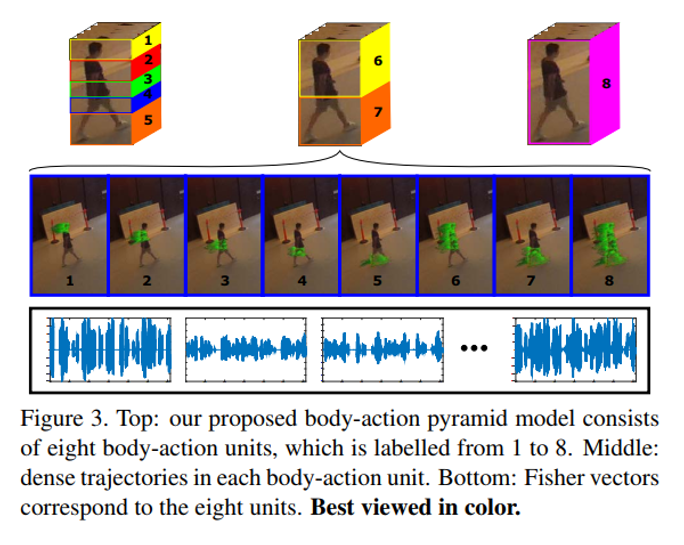

作者认为不同的身体部位的运行模式是不同的。所以,作者认为仅仅从全局的角度来看待人体的运行是不足的。作者将整个人体分为三个级别,每一个都包含特定数量的图像块,对应为 head,上肢,下肢,上腿部分和下腿部分。将这几种模式组合起来,大致有8个肢体-运动单元,如下图所示:

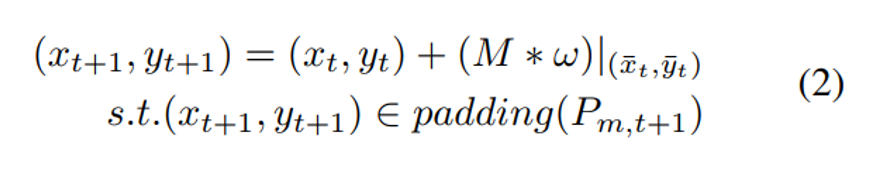

为了捕获一个行人的运动模式,作者提取对每一个body-action unit的稠密轨迹。通过计算稠密光流信息,来跟踪采样的特征点:

作者采用两种流行的行为特征来建模目标物体的运动,一个是相对运动Motion Boundary Histogram (MBH),一个是绝对运动Histograms of Optical Flow (HOF)。然后用高斯模型来学习轨迹对齐的描述符。通过这种方式来学习局部和全局的运动统计信息,将这些特征进行组合,得到最终联合的表达 FITD。