感知机

损失函数的一个自然选择是误分类点的总数。

算法 2.1 (感知机学习算法的原始形式)

输入:训练数据集T;学习率

输出:w,b;感知机模型。

(1)选取初值w0,b0;

(2)在训练集中选取数据(xi,yi);

(3)如果yi(w*xi+b)<=0...

(4)转至(2),直至训练集中没有误分类点。

2.3.2 算法的收敛性

将偏置b并入权重向量w,同样也将输入向量加以扩充,加进常数1。

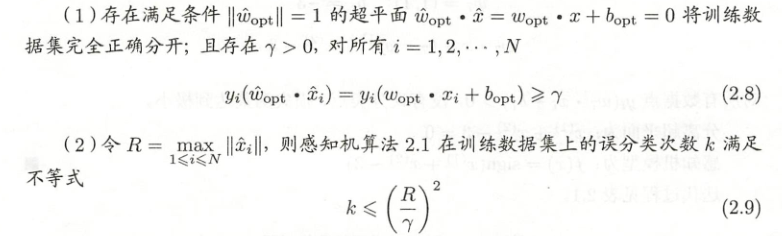

定理 2.5 设数据集T是线性可分的,则

2.3.3 感知机学习算法的对偶形式

本章概要

1.感知机是根据输入实例的特征向量x对其进行二类分类的线性分类模型:

f(x) = sign (w*x + b)

感知机模型对应于输入空间(特征空间)中的分离超平面w*x + b -= 0 。

2. 感知机学习的策略是极小化损失函数。

损失函数对应于误分类点到分离超平面的总距离。

3. 感知机学习算法是基于随机梯度下降法的对损失函数的最优化算法,有原始形式和对偶形式。

4.当训练数据集线性可分时,感知机学习算法是收敛的。感知机算法在训练数据集上的误分类次数k满足不等式:

k<=(R/r)^2

当训练数据集线性可分时,感知机学习算法存在无穷多个解,其解由于不同的初值或不同的迭代顺序而可能有所不同。