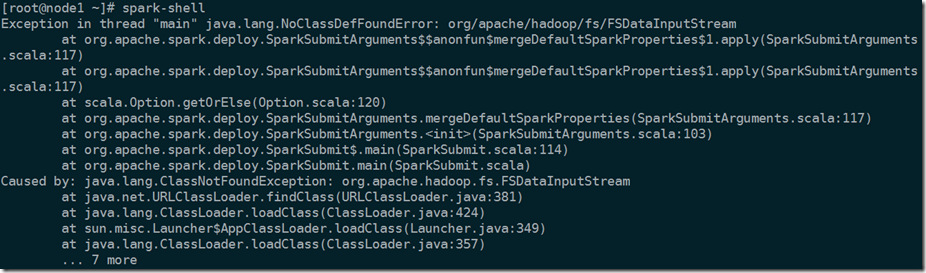

CDH5.8中使用spark-shell时报错:

原因是CDH版的Spark从1.4版本以后,Spark编译时都没有将hadoop的classpath编译进去,所以必须在spark-env.sh中指定hadoop中的所有jar包。

设置,所有节点都要改:

在spark-env.sh中添加一条配置信息,将hadoop的classpath引入, ${HADOOP_HOME}根据自己的情况而定,直接写绝对路径也行;

export export SPARK_DIST_CLASSPATH=$(${HADOOP_HOME}/bin/hadoop classpath)我的设置完就可以了;

如果还报错,可以去查看日志,看具体原因; 集群中安装好scala;