kafka

1.kafka基础架构

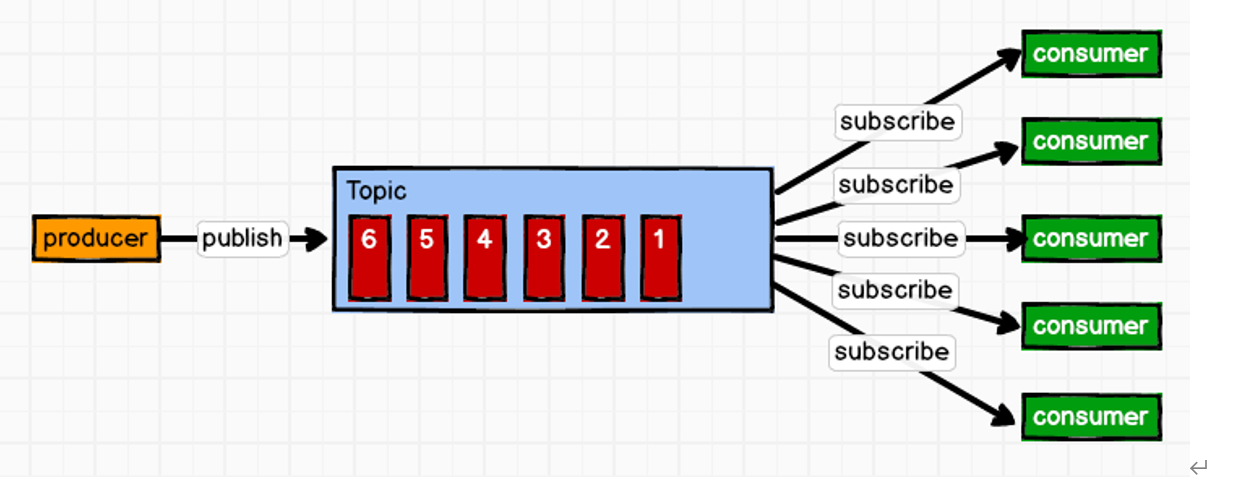

Kafka是一个分布式的基于发布/订阅模式的消息队列,主要应用于大数据实时处理领域。

消息生产者(发布)将消息发布到topic中,同时有多个消息消费者(订阅)消费该消息。和点对点方式不同,发布到topic的消息会被所有订阅者消费。

(1)Producer :消息生产者,就是向kafka broker发消息的客户端;

(2)Consumer :消息消费者,向kafka broker取消息的客户端;

(3)Consumer Group (CG):消费者组,由多个consumer组成。消费者组内每个消费者负责消费不同分区的数据,一个分区只能由一个消费者消费;消费者组之间互不影响。所有的消费者都属于某个消费者组,即消费者组是逻辑上的一个订阅者。

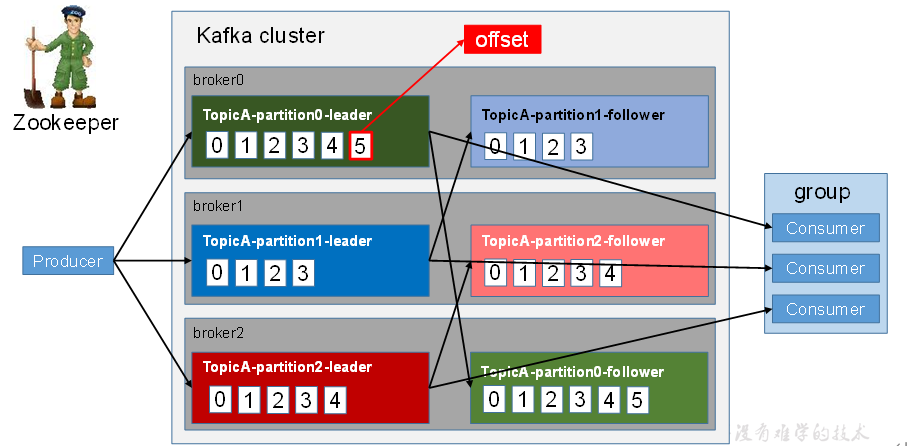

(4)Broker :一台kafka服务器就是一个broker。一个集群由多个broker组成。一个broker可以容纳多个topic。

(5)Topic :可以理解为一个队列,生产者和消费者面向的都是一个topic;

(6)Partition:为了实现扩展性,一个非常大的topic可以分布到多个broker(即服务器)上,一个topic可以分为多个partition,每个partition是一个有序的队列;

(7)Replica:副本,为保证集群中的某个节点发生故障时,该节点上的partition数据不丢失,且kafka仍然能够继续工作,kafka提供了副本机制,一个topic的每个分区都有若干个副本,一个leader和若干个follower。

(8)leader:每个分区多个副本的“主”,生产者发送数据的对象,以及消费者消费数据的对象都是leader。

(9)follower:每个分区多个副本中的“从”,实时从leader中同步数据,保持和leader数据的同步。leader发生故障时,某个follower会成为新的leader。

2.kafka安装

1)解压安装包 tar -zxvf kafka_2.11-2.4.1.tgz -C /opt/module/

2)修改解压后的文件名称 mv kafka_2.11-2.4.1/ kafka

3)在/opt/module/kafka目录下创建logs文件夹 mkdir logs

4)配置环境变量 sudo vi /etc/profile.d/my_env.sh

#KAFKA_HOME

export KAFKA_HOME=/opt/module/kafka

export PATH=$PATH:$KAFKA_HOME/bin

5)修改配置文件 vim $KAFKA_HOME/config/server.properties

broker的全局唯一编号,不能重复

broker.id=0

#kafka运行日志存放的路径 刚才新建目录下

log.dirs=/opt/module/kafka/logs

#配置连接Zookeeper集群地址

zookeeper.connect=hadoop102:2181,hadoop103:2181,hadoop104:2181/kafka

6)分发文件 环境变量 server.properties

记得修改server.properties中的broke.id 不能重复

7)启动集群

kafka-server-start.sh -daemon $KAFKA_HOME/config/server.properties

kafka-server-start.sh -daemon $KAFKA_HOME/config/server.properties

kafka-server-start.sh -daemon $KAFKA_HOME/config/server.properties

8)关闭集群

kafka-server-stop.sh

9)配置群起群停的脚本

#!/bin/bash

case $1 in

start)

for host in hadoop102 hadoop103 hadoop104

do

echo "===============start $host kafka==================="

ssh $host /opt/module/kafka/bin/kafka-server-start.sh -daemon /opt/module/kafka/config/server.properties

done

;;

stop)

for host in hadoop102 hadoop103 hadoop104

do

echo "===============stop $host kafka==================="

ssh $host /opt/module/kafka/bin/kafka-server-stop.sh

done

;;

esac

10)kafka命令行操作

1.查看当前服务器中的所有topic

kafka-topics.sh --list --bootstrap-server hadoop102:9092

2.创建topic

kafka-topics.sh --create --bootstrap-server hadoop102:9092 --topic first --partitions 2 --replication-factor 2

选项说明:

--topic 定义topic名

--replication-factor 定义副本数

--partitions 定义分区数

3.删除topic

kafka-topics.sh --bootstrap-server hadoop102:9092 --delete --topic first

4.发送消息

kafka-console-producer.sh --broker-list hadoop102:9092 --topic first

>hello world

5.消费消息

消费所有消息:kafka-console-consumer.sh --bootstrap-server hadoop102:9092 (--from-beginning) --topic first

--from-beginning:会把主题中以往所有的数据都读取出来

6.查看某个Topic的详情

kafka-topics.sh --bootstrap-server hadoop102:9092 --describe --topic first

7.修改分区数

kafka-topics.sh --bootstrap-server hadoop102:9092 --alter --topic first --partitions 6

修改分区时 只能从少分区修改为多分区,反之会报错

3.kafka的架构深入

3.1Kafka工作流程及文件存储机制

Kafka中消息是以topic进行分类的,生产者生产消息,消费者消费消息,都是面向topic的。topic是逻辑上的概念,而partition是物理上的概念,

每个partition对应于一个log文件,该log文件中存储的就是producer生产的数据。Producer生产的数据会被不断追加到该log文件末端,且每条数据都有自己的offset。

消费者组中的每个消费者,都会实时记录自己消费到了哪个offset,以便出错恢复时,从上次的位置继续消费

kafka如何保存数据

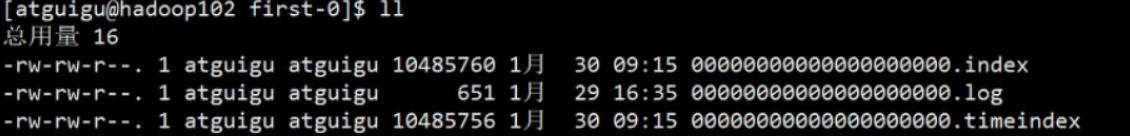

由于生产者生产的消息会不断追加到log文件末尾,为防止log文件过大导致数据定位效率低下,Kafka采取了分片和索引机制,将每个partition分为多个segment。

(默认文件容量每个segment log.segment.bytes 1GB log.retention.hours 默认 168小时 也就是一星期 数据过期 删除 )

每个segment对应两个文件——“.index”文件和“.log”文件。这些文件位于一个文件夹下,该文件夹的命名规则为:topic名称+分区序号。

例如,first这个topic有三个分区,则其对应的文件夹为first-0,first-1,first-2。 (cd $KAFKA_HOME/logs 可以看到分区的名字),每一个分区里面有多个segement 如下图所示

kafka如何通过文件名字查找数据信息:

总结一句话 就是 对于一个分区来说,先看文件名字,确定在哪一个segement ,然后找到 上图中的index 找到对应的数据

3.2kafka生产者 (kafka的分区是在 producer阶段完成的)

3.2.1分区策略

1)分区的原因

(1)方便在集群中扩展,每个Partition可以通过调整以适应它所在的机器,而一个topic又可以有多个Partition组成,因此整个集群就可以适应任意大小的数据了;

(2)可以提高并发,因为可以以Partition为单位读写了。

2)分区的原则

(1)指明 partition 的情况下,直接将指明的值直接作为 partiton 值;

(2)没有指明 partition 值但有 key 的情况下,将 key 的 hash 值与 topic 的 partition 数进行取余得到 partition 值;

(3)既没有 partition 值又没有 key 值的情况下,所有发往指定话题的records,会积攒成一个batch(达到一定大小(默认16kb)或者两条消息间隔过长)一起发送到一个分区 。当形成新的batch,我们会随机选择一个新的分区发送。

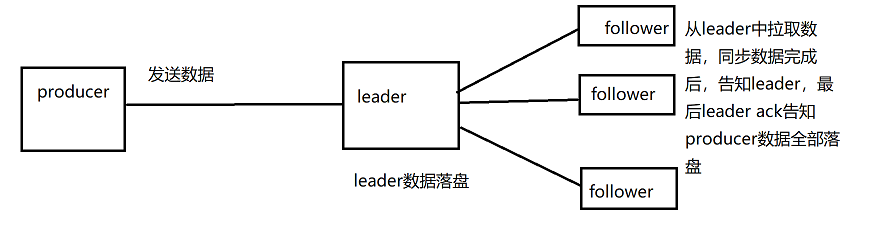

3.2.2 数据可靠性保证

为保证producer发送的数据,能可靠的发送到指定的topic,topic的每个partition收到producer发送的数据后,都需要向producer发送ack(acknowledgement确认收到)

如果producer收到ack,就会进行下一轮的发送,否则重新发送数据。

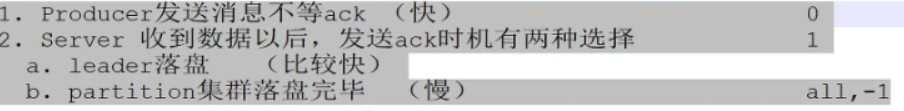

1. ack应答机制

对于某些不太重要的数据,对数据的可靠性要求不是很高,能够容忍数据的少量丢失,所以没必要等ISR中的follower全部接收成功。

所以Kafka为用户提供了三种可靠性级别,用户根据对可靠性和延迟的要求进行权衡,选择以下的配置。

acks参数配置:

acks:

0:producer不等待broker的ack,这一操作提供了一个最低的延迟,broker一接收到还没有写入磁盘就已经返回,当broker故障时有可能丢失数据;

1:producer等待broker的ack,partition的leader落盘成功后返回ack,如果在follower同步成功之前leader故障,那么将会丢失数据;

-1(all):producer等待broker的ack,partition的leader和follower全部落盘成功后才返回ack。但是如果在follower同步完成后,broker发送ack之前,leader发生故障,那么会造成数据重复

ack 分为三个 0 1 -1/all 如下图

partition集群落盘 :leader 和所有follower

kafka如果要确保数据的可靠性一般选择最后一种 partition集群落盘 leader等follower同步完成之后将ack返回给producer 但会耗费时间 发送效率较低

如果对数据完整性要求不高的话,可以选择其他两个

2. ISR (In sync replicas) 同步副本

采用第二种方案之后即ack=-1,设想以下情景:leader收到数据,所有follower都开始同步数据,但有一个follower,因为某种故障,

迟迟不能与leader进行同步,那leader就要一直等下去,直到它完成同步,才能发送ack。这个

问题怎么解决呢?

Leader维护了一个动态的in-sync replica set (ISR),意为和leader保持同步的follower集合。当ISR中的follower完成数据的同步之后,leader就会给producer发送ack。

如果follower长时间未向leader同步数据,则该follower将被踢出ISR,该时间阈值由replica.lag.time.max.ms参数设定。Leader发生故障之后,就会从ISR中选举新的leader。

isr有min.insync.replicas 最小同步副本数,如果设置两个,就算有个follower没给回执,也不能剔除

3.isr故障处理细节

(1)follower故障

follower发生故障后会被临时踢出ISR,待该follower恢复后,follower会读取本地磁盘记录的上次的HW,并将log文件高于HW的部分截取掉,从HW开始向leader进行同步。等该follower的LEO大于等于该Partition

的HW,即follower追上leader之后,就可以重新加入ISR了。

(2)leader故障

leader发生故障之后,会从ISR中选出一个新的leader,之后,为保证多个副本之间的数据一致性,其余的follower会先将各自的log文件高于HW的部分截掉,然后从新的leader同步数据。

注意:这只能保证副本之间的数据一致性,并不能保证数据不丢失或者不重复。

LEO:每个副本装了多少消息

HW:所有副本中最少装了多少消息 即:最小的的LEO 完全同步的数据

4.Exactly Once语义

为了保证数据是不重复的,在数据完整性的基础上我们要启用幂等性,只需要将Producer的参数中enable.idompotence设置为true即可。

Kafka的幂等性实现其实就是将原来下游需要做的去重放在了数据上游。开启幂等性的Producer在初始化的时候会被分配一个PID,发往同一Partition的消息会附带Sequence Number。

而Broker端会对<PID, Partition, SeqNumber>做缓存,当具有相同主键的消息提交时,Broker只会持久化一条。

但是PID重启就会变化,同时不同的Partition也具有不同主键,所以幂等性无法保证跨分区跨会话的Exactly Once。

3.2kafka消费者

3.3.1 消费方式

consumer采用pull(拉)模式从broker中读取数据。

push(推)模式很难适应消费速率不同的消费者,因为消息发送速率是由broker决定的。它的目标是尽可能以最快速度传递消息,但是这样很容易造成consumer来不及处理消息,典型的表现就是拒绝服务以及网络拥塞。而

pull模式则可以根据consumer的消费能力以适当的速率消费消息。

pull模式不足之处是,如果kafka没有数据,消费者可能会陷入循环中,一直返回空数据。针对这一点,Kafka的消费者在消费数据时会传入一个时长参数timeout,如果当前没有数据可供消费,consumer会等待一段时间之后再返回,这段时长即为timeout。

3.3.2 分区分配策略

一个consumer group中有多个consumer,一个 topic有多个partition,所以必然会涉及到partition的分配问题,即确定那个partition由哪个consumer来消费。

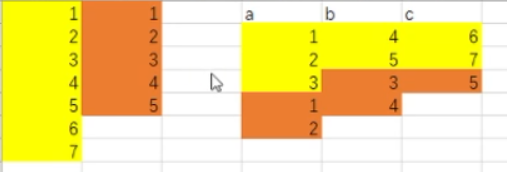

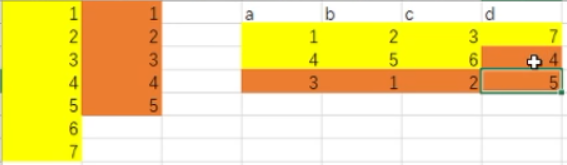

Kafka有三种分配策略,一是roundrobin,一是range,一是sticky

1.range (kafka的默认分区分配策略)如下图 易造成数据倾斜 负载不均衡 (黄色代表一个topic有7个分区,棕色代表一个topic有5个分区 abc分别代表三个消费者)

2.roundrobin 解决了负载不均衡的问题 依次分发 但是当加入新的消费者时,重新分配,每个消费者的分区会发生大的改变,性能消耗比较大

3.sticky 在roundrobin的基础上尽量的让之前消费者上的分区还在之前的位置,挪动少量的分区即可

3.3.3 offset的维护

由于consumer在消费过程中可能会出现断电宕机等故障,consumer恢复后,需要从故障前的位置的继续消费,所以consumer需要实时记录自己消费到了哪个offset,以便故障恢复后继续消费。

Kafka 0.9版本之前,consumer默认将offset保存在Zookeeper中,从0.9版本开始,consumer默认将offset保存在Kafka一个内置的topic中,该topic为__consumer_offsets。

因为kafka的吞吐量进一步提升就会限制在zookeeper上,zookkerper进行大量频繁的操作效率不高

3.4 Kafka事务

3.4.1 Producer事务 依赖kafka内部话题Transaction stat

为了实现跨分区跨会话的事务,需要引入一个全局唯一的Transaction ID,并将Producer获得的PID和Transaction ID绑定。这样当Producer重启后就可以通过正在进行的Transaction ID获得原来的PID。

为了管理Transaction,Kafka引入了一个新的组件Transaction Coordinator。Producer就是通过和Transaction Coordinator交互获得Transaction ID对应的任务状态。

Transaction Coordinator还负责将事务所有写入Kafka的一个内部Topic,这样即使整个服务重启,由于事务状态得到保存,进行中的事务状态可以得到恢复,从而继续进行。还可以数据回滚

数据回滚的话就是把partition上面的数据删除,但是kafka已经做了数据持久化,不能删除,所以kafka就将partition末尾的那些数据标记为consumer不可见,即不能消费

3.4.1 Consumer事务(精准一次性消费)基本上没有

3.5 Kafka高效读写数据 (高吞吐量原因)

3.5.1 顺序写磁盘

Kafka的producer生产数据,要写入到log文件中,写的过程是一直追加到文件末端,为顺序写。官网有数据表明,同样的磁盘,顺序写能到到600M/s,而随机写只有100k/s。

这与磁盘的机械机构有关,顺序写之所以快,是因为其省去了大量磁头寻址的时间。

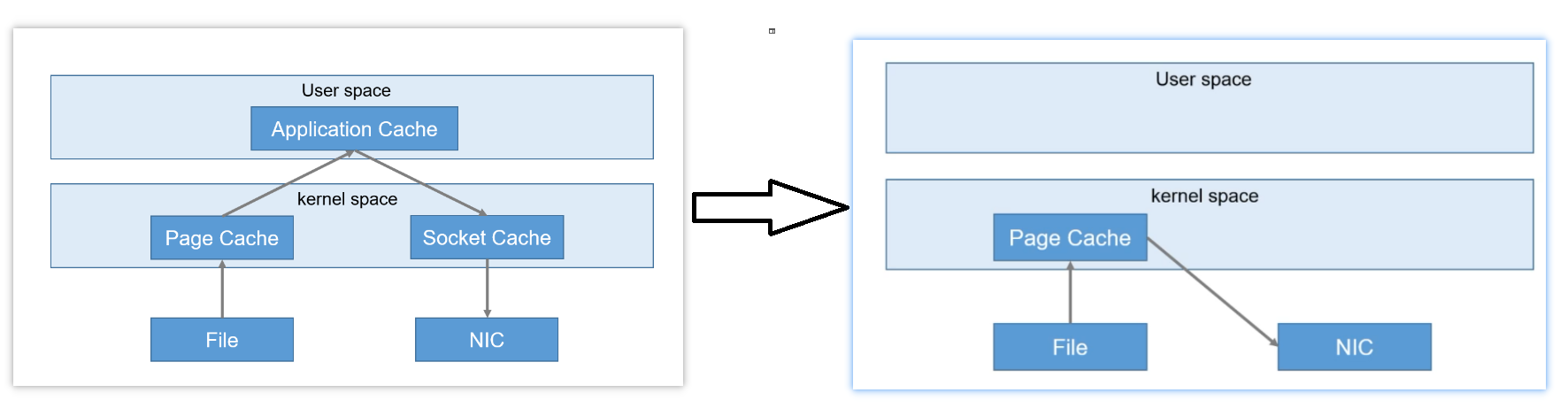

3.5.2 应用Pagecache (页面缓存)

Pagecache其实就是操作系统中用来缓存读写的一块内存

1.I/O Scheduler 会将连续的小块写组装成大块的物理写从而提高性能

2.I/O Scheduler 会尝试将一些写操作重新按顺序排好,从而减少磁盘头的移动时间

3.充分利用所有空闲内存(非 JVM 内存 即Pagecache)。如果使用应用层 Cache(即 JVM 堆内存),会增加 GC 负担

4.读操作可直接在 Page Cache 内进行。如果消费和生产速度相当,甚至不需要通过物理磁盘(直接通过 Page Cache)交换数据

5.如果进程重启,JVM 内的 Cache 会失效,但 Page Cache 仍然可用

尽管持久化到Pagecache上可能会造成宕机丢失数据的情况,但这可以被Kafka的Replication机制解决。

如果为了保证这种情况下数据不丢失而强制将 Page Cache 中的数据 Flush 到磁盘,反而会降低性能。

3.5.3 零复制技术

kafak端不需要对数据进行修改就可以用零复制技术,不修改就不需要把数据读进来。

应用层只是调用了操作系统提供的零拷贝接口,把文件从A拷到B 首先少了两段内存拷贝,速度会提升不少,延迟会低很多

缺点是应用层并不知道拷贝了什么数据,因为数据根本就没有进应用层,而kafka不需要自己知道自己拷贝什么数据,只是起到了传输的作用。

3.6 kafka controller的理解

在Kafka集群中会有一个或者多个broker,其中有一个broker会被选举为控制器(Kafka Controller),它负责管理集群broker的上下线,所有topic的分区副本分配和leader选举等工作。当某个分区的leader副本出现故障时,由控制器负责为该分区选举新的leader副本。当检测到某个分区的ISR集合发生变化时,由控制器负责通知所有broker更新其元数据信息。当使用kafka-topics.sh脚本为某个topic增加分区数量时,同样还是由控制器负责分区的重新分配。