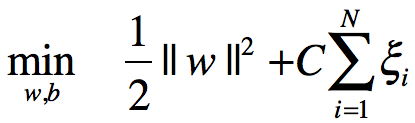

对于线性支持向量机学习来说,模型为分离超平面w*x+b*=0及决策函数f(x)=sign(w*x+b*),其学习策略为软间隔最大化,学习算法为凸二次规划。线性支持向量机学习还有另外一种解释,也就是最小化如下目标函数:

![]()

第一项是经验损失,函数:

![]()

称为合页损失函数,下标+表示以下取正值的函数:

![]()

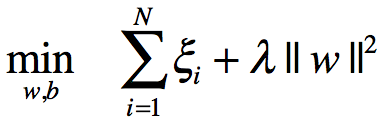

那么以上部分也可以转化为,当样本点(xi,yi)被正确分类且函数间隔yi(wxi+b)大于1时,损失为0,否则损失是1-yi(wxi+b).

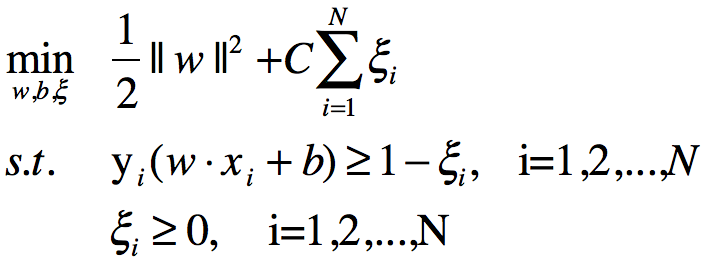

这时候线性支持向量机原始最优化问题:

等价于最优化问题:

证明过程如下:

设![]() ,则ξi≥0,当

,则ξi≥0,当![]() 时,则有

时,则有![]() ,当

,当![]() 时,ξi=0,因而有

时,ξi=0,因而有![]() ,因而上述最优化问题可以转化为:

,因而上述最优化问题可以转化为:

且隐含支持向量机原始最优化问题的约束条件,取![]() ,则有:

,则有:

等价于