MIT研究员警告:深度学习已经接近计算极限

我们正在接近深度学习的计算极限。

根据麻省理工学院,MIT-IBM Watson AI实验室,Underwood国际学院和巴西利亚大学的研究人员的说法,他们在最近的一项研究中发现,深度学习的进展“非常依赖”计算能力的增长。但他们指出,持续不断的进步将需要通过改变现有技术或通过尚未发现的新方法来“戏剧性地”更有效地使用深度学习方法。

“我们表明,深度学习不是偶然的计算代价,而是设计的代价。共同的灵活性使它能够出色地建模各种现象,并且性能优于专家模型,这也使其在计算上的成本大大提高。”合著者写道。“尽管如此,我们发现深度学习模型的实际计算负担比(理论上的)下界更快地扩展,这表明可能有实质性的改进。”

深度学习是机器学习的子领域,涉及受大脑结构和功能启发的算法。这些算法(称为人工神经网络)由功能(神经元)组成,这些功能按层排列,将信号传输到其他神经元。信号是输入到网络中的输入数据的产物,它们从一层到另一层传播并缓慢地“调谐”网络,实际上是在调整每个连接的突触强度(权重)。网络最终通过从数据集中提取特征并识别交叉样本趋势来学习进行预测。

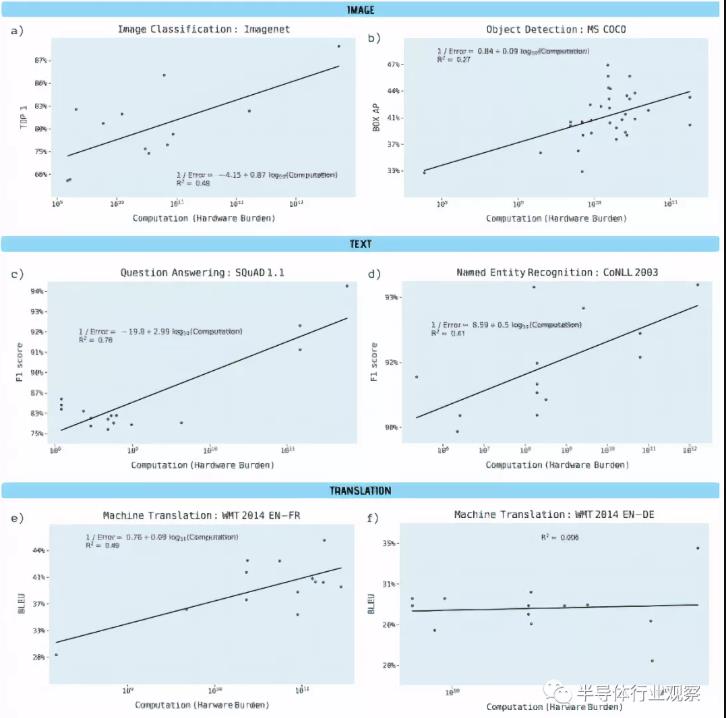

研究人员分析了Arxiv.org以及其他基准测试来源的1,058篇论文,以了解深度学习性能与计算之间的联系,并特别注意以下领域:图像分类,对象检测,问题解答,命名实体识别和机器翻译。他们对计算需求进行了两次单独的分析,反映了可用的两种信息:

在给定的深度学习模型中,每个网络遍历的计算,或单遍遍(即权重调整)所需的浮点运算数。

硬件负担,或用于训练模型的硬件的计算能力,计算方式为处理器数量乘以计算速率和时间。(研究人员承认,尽管这是一种不精确的计算方法,但在他们分析的论文中,它的报告比其他基准要广泛。)

合著者报告说,除从英语到德语的机器翻译(使用的计算能力几乎没有变化)外,所有基准均具有“统计学上显着性”的斜率和“强大的解释能力”。对象检测,命名实体识别和机器翻译尤其显示出硬件负担的大幅增加,而结果的改善却相对较小,在流行的开源ImageNet基准测试中,计算能力可以解释图像分类准确度的43%差异。

研究人员估计,三年的算法改进相当于计算能力提高了10倍。他们写道:“总体而言,我们的结果表明,在深度学习的许多领域中,训练模型的进步取决于所使用的计算能力的大幅度提高。”, “另一种可能性是,要改善算法本身可能需要互补地提高计算能力。”

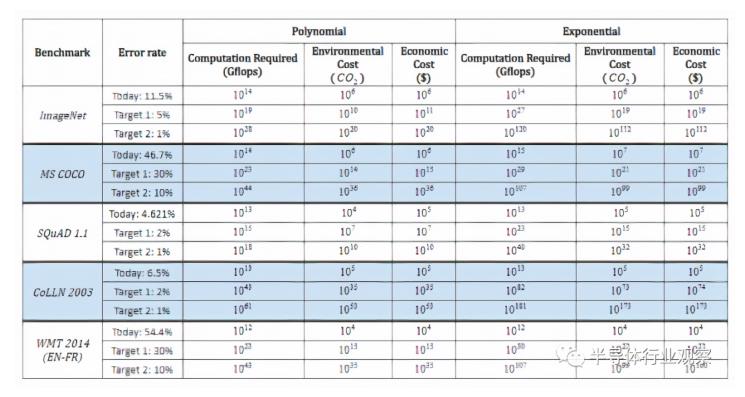

在研究过程中,研究人员还对预测进行了推断,以了解达到各种理论基准所需的计算能力以及相关的经济和环境成本。即使是最乐观的计算,要降低ImageNet上的图像分类错误率,也需要进行10的 五次方以上的计算。

一份Synced报告也估计,华盛顿大学的Grover假新闻检测模型在大约两周时间内的训练费用为25,000美元。据报道,OpenAI花费了高达1200万美元来训练其GPT-3 语言模型,而Google估计花费了6,912美元来训练 BERT,这是一种双向转换器模型,可为11种自然语言处理任务重新定义最先进的技术。

在去年6月的马萨诸塞州大学阿默斯特分校的另一份报告中,得出的结论是,训练和搜索某种模型所需的电量大约排放了626,000磅的二氧化碳。这相当于美国普通汽车寿命排放的近五倍。

研究人员写道:“我们预计目标所隐含的计算需求……硬件,环境和金钱成本将无法承受。” “以一种经济的方式实现这一目标将需要更高效的硬件,更高效的算法或其他改进措施,以使净影响如此之大。”

研究人员指出,在算法级别进行深度学习改进已有历史先例。他们指出了硬件加速器的出现,例如Google的张量处理单元,现场可编程门阵列(FPGA)和专用集成电路(ASIC),并试图通过网络压缩和加速技术来降低计算复杂性。他们还引用了神经体系结构搜索和元学习,它们使用优化来查找在一类问题上保持良好性能的体系结构,以此作为计算上有效的改进方法的途径。

确实,一项OpenAI 研究表明,自2012年以来,每16个月将AI模型训练到ImageNet图像分类中相同性能所需的计算量就减少了2倍。Google的Transformer架构超越了以前的seq2seq(也是由Google开发的模型),在seq2seq推出三年后,计算量减少了61倍。DeepMind的AlphaZero这个系统从零开始教自己如何掌握国际象棋,将棋和围棋游戏,而一年后,该系统所需的计算量就减少了八倍,以匹配该系统的前身AlphaGoZero的改进版本。

“用于深度学习模型的计算能力的爆炸式增长已经结束了“人工智能冬天”,并为各种任务的计算机性能树立了新的基准。但是,深度学习对计算能力的巨大需求限制了它可以以目前的形式提高性能的程度,特别是在硬件性能的提高放缓的时代。” “这些计算限制的可能影响迫使……机器学习转向比深度学习更高效的技术。”