参考论文:ImageNet Classification with Deep Convolutional Neural Networks

1.特点

1.1 ReLU Nonlinearity的提出

- ReLU是非饱和非线性函数,f(x) = max(0, x),收敛速度比饱和激活函数快。

优缺点:

- ReLU部分解决了sigmoid的饱和性,缺点是在小于0的地方会出现神经单元死亡,并且不能复活的情况。所以,有关于ReLU的改进方法的提出(leaky ReLU, parameterized ReLU, random ReLU)

- 计算简单。

- 收敛速度快。

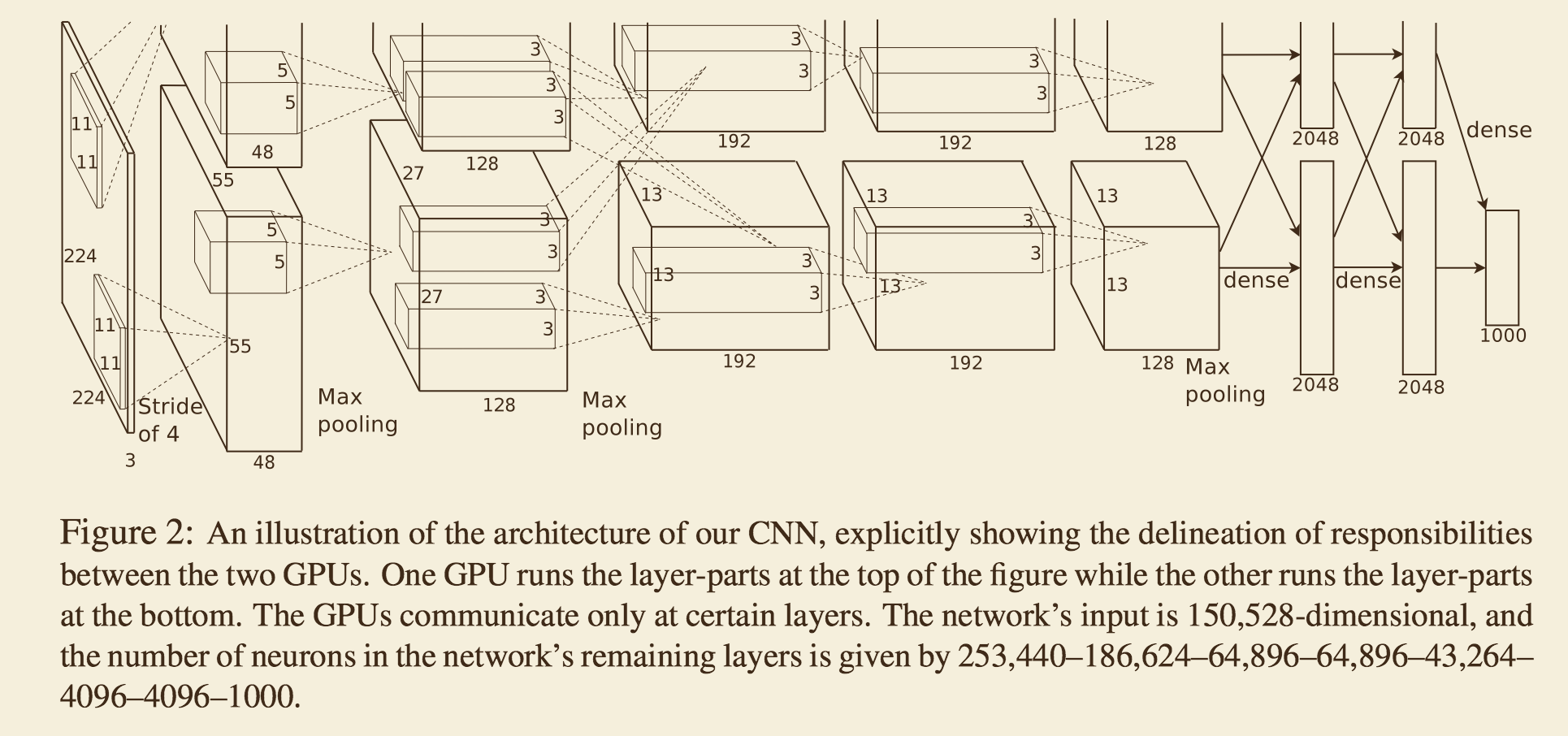

1.2 多GPU训练

-

并行化的方法是将kernel matrix划分为两部分各自放在不同的GPU上。

-

GPU之间的通信只发生在部分层。

-

5个卷积层,3个全连接层。

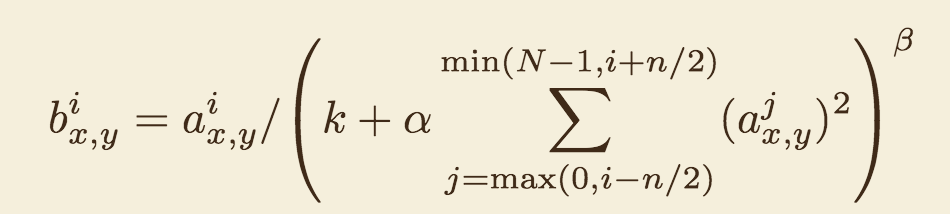

1.3 Local Response Normalization

- ai是原激活值,bi是抑制后的激活值。

-

侧面抑制。也就是当前单元激活值,除以两边单元激活值。也就是说,如果一个单元激活值两边的值比它大一些的话,它自己将受到抑制,值会变小。

-

这也是一种正则化的方法。(brightness normalization)

1.4 Overlapping Pooling

- stride < kernei_size 那么就会出现重叠池化现象,有利于防止过拟合。

2.防止过拟合的方法

2.1 Data Augmentation

- 截取图的不同位置图,以及镜像变换。

- 利用PCA,add multiples of the found principal components.

2.2 Dropout

- 训练的时候让这一层部分神经单元输出为0,且不参与反向传播。

- 测试的时候让这一层利用上所有的神经单元,但是他们的输出值乘上0.5。

- 解释是,输出乘0.5用来近似指数级dropout网络的几何均值。