上一篇博文如何在Eclipse下搭建Hadoop开发环境,今天给大家介绍一下如何分别分别在Eclipse和Hadoop集群上运行我们的MapReduce程序!

1. 在Eclipse环境下运行MapReduce程序(WordCount程序)

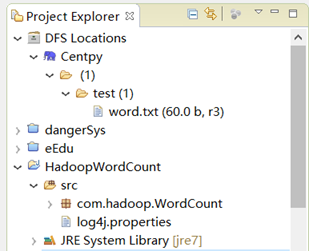

首先看一下我的项目结构和WordCount程序:

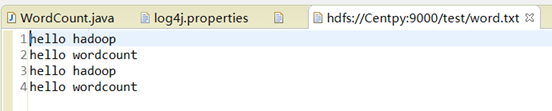

其中word.txt将作为我们测试的输入文件,内容如下:

程序代码如下所示:

1 package com.hadoop.WordCount;

2

3 import java.io.IOException;

4 import java.util.StringTokenizer;

5 import org.apache.hadoop.conf.Configuration;

6 import org.apache.hadoop.fs.FileSystem;

7 import org.apache.hadoop.fs.Path;

8 import org.apache.hadoop.io.IntWritable;

9 import org.apache.hadoop.io.Text;

10 import org.apache.hadoop.mapreduce.Job;

11 import org.apache.hadoop.mapreduce.Mapper;

12 import org.apache.hadoop.mapreduce.Reducer;

13 import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

14 import org.apache.hadoop.mapreduce.lib.input.TextInputFormat;

15 import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

16 import org.apache.hadoop.mapreduce.lib.output.TextOutputFormat;

17

18 @SuppressWarnings("unused")

19 public class WordCount {

20

21 public static class TokenizerMapper extends

22 Mapper<Object, Text, Text, IntWritable>

23 // 为什么这里k1要用Object、Text、IntWritable等,而不是java的string啊、int啊类型,当然,你可以用其他的,这样用的好处是,因为它里面实现了序列化和反序列化。

24 // 可以让在节点间传输和通信效率更高。这就为什么hadoop本身的机制类型的诞生。

25

26

27 //这个Mapper类是一个泛型类型,它有四个形参类型,分别指定map函数的输入键、输入值、输出键、输出值的类型。hadoop没有直接使用Java内嵌的类型,而是自己开发了一套可以优化网络序列化传输的基本类型。

28 //这些类型都在org.apache.hadoop.io包中。

29 //比如这个例子中的Object类型,适用于字段需要使用多种类型的时候,Text类型相当于Java中的String类型,IntWritable类型相当于Java中的Integer类型

30 {

31 //定义两个变量或者说是定义两个对象,叫法都可以

32 private final static IntWritable one = new IntWritable(1);//这个1表示每个单词出现一次,map的输出value就是1.

33 //因为,v1是单词出现次数,直接对one赋值为1

34 private Text word = new Text();

35

36 public void map(Object key, Text value, Context context)

37 //context它是mapper的一个内部类,简单的说顶级接口是为了在map或是reduce任务中跟踪task的状态,很自然的MapContext就是记录了map执行的上下文,在mapper类中,这个context可以存储一些job conf的信息,比如job运行时参数等,

38 //我们可以在map函数中处理这个信息,这也是Hadoop中参数传递中一个很经典的例子,同时context作为了map和reduce执行中各个函数的一个桥梁,这个设计和Java web中的session对象、application对象很相似

39 //简单的说context对象保存了作业运行的上下文信息,比如:作业配置信息、InputSplit信息、任务ID等

40 //我们这里最直观的就是主要用到context的write方法。

41 //说白了,context起到的是连接map和reduce的桥梁。起到上下文的作用!

42

43 throws IOException, InterruptedException {

44 //The tokenizer uses the default delimiter set, which is "

": the space character, the tab character, the newline character, the carriage-return character

45 StringTokenizer itr = new StringTokenizer(value.toString());//将Text类型的value转化成字符串类型

46

47 //使用StringTokenizer类将字符串“hello,java,delphi,asp,PHP”分解为单个单词

48 // 程序的运行结果为:

49 // hello

50 // java

51 // delphi

52 // asp

53 // php

54

55

56 while (itr.hasMoreTokens()) {

57 // 实际上就是java.util.StringTokenizer.hasMoreTokens()

58 // hasMoreTokens() 方法是用来测试是否有此标记生成器的字符串可用更多的标记。

59 word.set(itr.nextToken());

60 context.write(word, one);

61 }

62 }

63 }

64

65 public static class IntSumReducer extends

66 Reducer<Text, IntWritable, Text, IntWritable> {

67 private IntWritable result = new IntWritable();

68 public void reduce(Text key, Iterable<IntWritable> values,

69 Context context) throws IOException, InterruptedException {

70 //我们这里最直观的就是主要用到context的write方法。

71 //说白了,context起到的是连接map和reduce的桥梁。起到上下文的作用!

72

73 int sum = 0;

74 for (IntWritable val : values) {//叫做增强的for循环,也叫for星型循环

75 sum += val.get();

76 }

77 result.set(sum);

78 context.write(key, result);

79 }

80 }

81

82 public static void main(String[] args) throws Exception {

83 Configuration conf = new Configuration();//程序里,只需写这么一句话,就会加载到hadoop的配置文件了

84 //Configuration类代表作业的配置,该类会加载mapred-site.xml、hdfs-site.xml、core-site.xml等配置文件。

85

86 //删除已经存在的输出目录

87 Path mypath = new Path("hdfs://Centpy:9000/test/wordcount-out");//输出路径

88 FileSystem hdfs = mypath.getFileSystem(conf);//程序里,只需写这么一句话,就可以获取到文件系统了。

89 //FileSystem里面包括很多系统,不局限于hdfs,是因为,程序读到conf,哦,原来是hadoop集群啊。这时,才认知到是hdfs

90

91 //如果文件系统中存在这个输出路径,则删除掉,保证输出目录不能提前存在。

92 if (hdfs.isDirectory(mypath)) {

93 hdfs.delete(mypath, true);

94 }

95

96 //job对象指定了作业执行规范,可以用它来控制整个作业的运行。

97 Job job = Job.getInstance();// new Job(conf, "word count");

98 job.setJarByClass(WordCount.class);//我们在hadoop集群上运行作业的时候,要把代码打包成一个jar文件,然后把这个文件

99 //传到集群上,然后通过命令来执行这个作业,但是命令中不必指定JAR文件的名称,在这条命令中通过job对象的setJarByClass()中传递一个主类就行,hadoop会通过这个主类来查找包含它的JAR文件。

100

101 job.setMapperClass(TokenizerMapper.class);

102 //job.setReducerClass(IntSumReducer.class);

103 job.setCombinerClass(IntSumReducer.class);//Combiner最终不能影响reduce输出的结果

104 // 这句话要好好理解!!!

105

106

107

108 job.setOutputKeyClass(Text.class);

109 job.setOutputValueClass(IntWritable.class);

110 //一般情况下mapper和reducer的输出的数据类型是一样的,所以我们用上面两条命令就行,如果不一样,我们就可以用下面两条命令单独指定mapper的输出key、value的数据类型

111 //job.setMapOutputKeyClass(Text.class);

112 //job.setMapOutputValueClass(IntWritable.class);

113 //hadoop默认的是TextInputFormat和TextOutputFormat,所以说我们这里可以不用配置。

114 //job.setInputFormatClass(TextInputFormat.class);

115 //job.setOutputFormatClass(TextOutputFormat.class);

116

117 FileInputFormat.addInputPath(job, new Path(

118 "hdfs://Centpy:9000/test/word.txt"));//FileInputFormat.addInputPath()指定的这个路径可以是单个文件、一个目录或符合特定文件模式的一系列文件。

119 //从方法名称可以看出,可以通过多次调用这个方法来实现多路径的输入。

120 FileOutputFormat.setOutputPath(job, new Path(

121 "hdfs://Centpy:9000/hdfsOutput"));//只能有一个输出路径,该路径指定的就是reduce函数输出文件的写入目录。

122 //特别注意:输出目录不能提前存在,否则hadoop会报错并拒绝执行作业,这样做的目的是防止数据丢失,因为长时间运行的作业如果结果被意外覆盖掉,那肯定不是我们想要的

123 System.exit(job.waitForCompletion(true) ? 0 : 1);

124 //使用job.waitForCompletion()提交作业并等待执行完成,该方法返回一个boolean值,表示执行成功或者失败,这个布尔值被转换成程序退出代码0或1,该布尔参数还是一个详细标识,所以作业会把进度写到控制台。

125 //waitForCompletion()提交作业后,每秒会轮询作业的进度,如果发现和上次报告后有改变,就把进度报告到控制台,作业完成后,如果成功就显示作业计数器,如果失败则把导致作业失败的错误输出到控制台

126 }

127 }

128

129 //TextInputFormat是hadoop默认的输入格式,这个类继承自FileInputFormat,使用这种输入格式,每个文件都会单独作为Map的输入,每行数据都会生成一条记录,每条记录会表示成<key,value>的形式。

130 //key的值是每条数据记录在数据分片中的字节偏移量,数据类型是LongWritable.

131 //value的值为每行的内容,数据类型为Text。

132 //

133 //实际上InputFormat()是用来生成可供Map处理的<key,value>的。

134 //InputSplit是hadoop中用来把输入数据传送给每个单独的Map(也就是我们常说的一个split对应一个Map),

135 //InputSplit存储的并非数据本身,而是一个分片长度和一个记录数据位置的数组。

136 //生成InputSplit的方法可以通过InputFormat()来设置。

137 //当数据传给Map时,Map会将输入分片传送给InputFormat(),InputFormat()则调用getRecordReader()生成RecordReader,RecordReader则再通过creatKey()和creatValue()创建可供Map处理的<key,value>对。

138 //

139 //OutputFormat()

140 //默认的输出格式为TextOutputFormat。它和默认输入格式类似,会将每条记录以一行的形式存入文本文件。它的键和值可以是任意形式的,因为程序内部会调用toString()将键和值转化为String类型再输出。

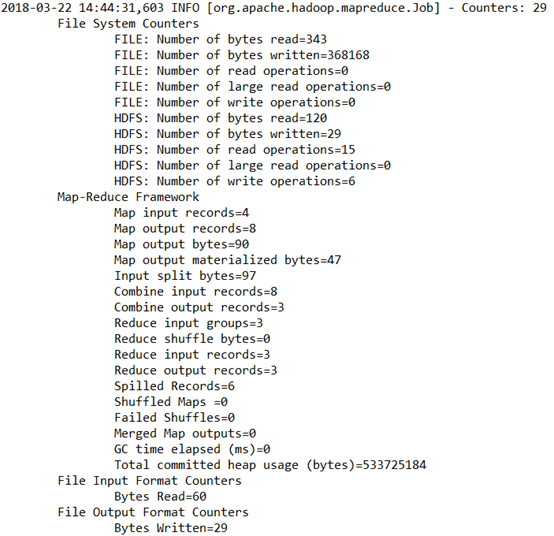

接下来我们右键选择“Run As --> Java Aplication / Run on Hadoop”运行程序,控制台情况如下:

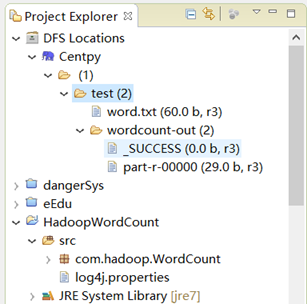

然后,右键我们的DFS Locations,执行刷新命令,此时运行结果也出现在目录里了,如下所示:

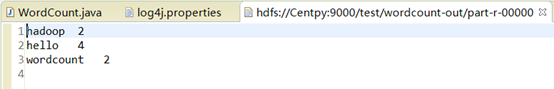

具体内容如下:

显然这是正确的结果。

2. 在Hadoop集群上运行MapReduce程序(WordCount程序)

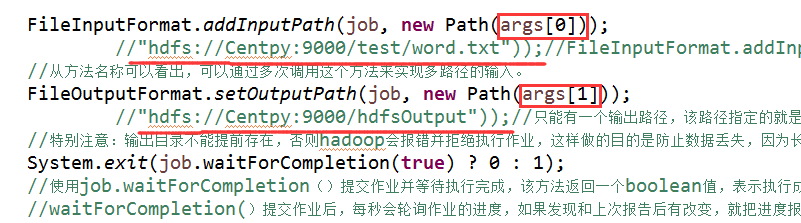

在导出为jar包之前需要对代码进行一点小小的修改。在Eclipse环境下运行时我们需要将输入输出目录写死才能正常执行,但在Hadoop上执行时需要更灵活的方法,所以使用数组(args[])来代替,在执行运行命令时再指定路径!(这一点很重要,否则会报错而无法运行)。

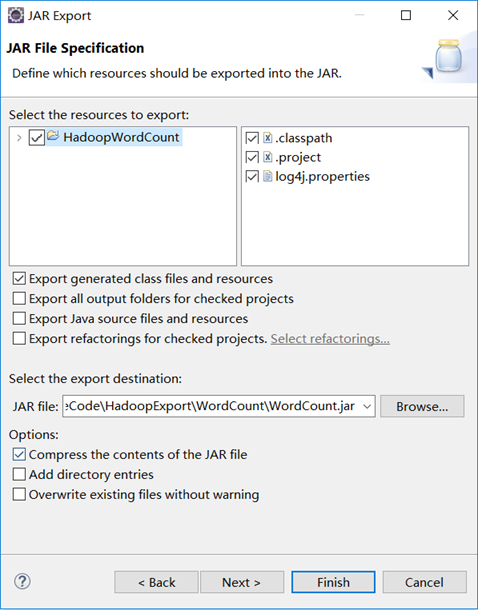

接下来,我们需要将我们的项目导出为Jar包。

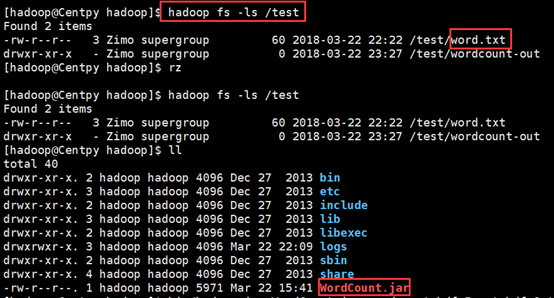

然后使用rz命令(如果没有安装请使用命令进行安装,-y表示直接确认,在后面的安装过程可以不用再等待确认)上传到Hadoop目录下。

yum -y install lrzsz

上传之后我们输入以下命令来运行我们的MapReduce程序。

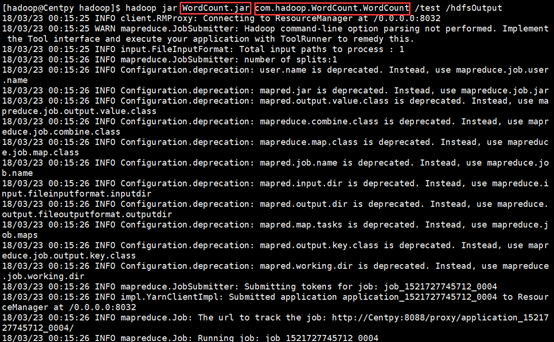

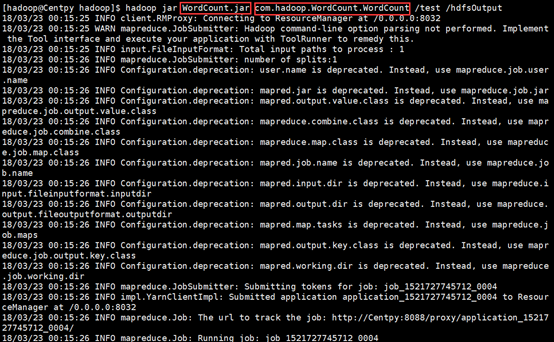

hadoop jar WordCount.jar com.hadoop.WordCount.WordCount /test /hdfsOutput

其中,.jar文件为我们上传的程序,第二个红框里的路径为Eclipse下的类及完整路径(包路径+类名),运行过程如下所示:

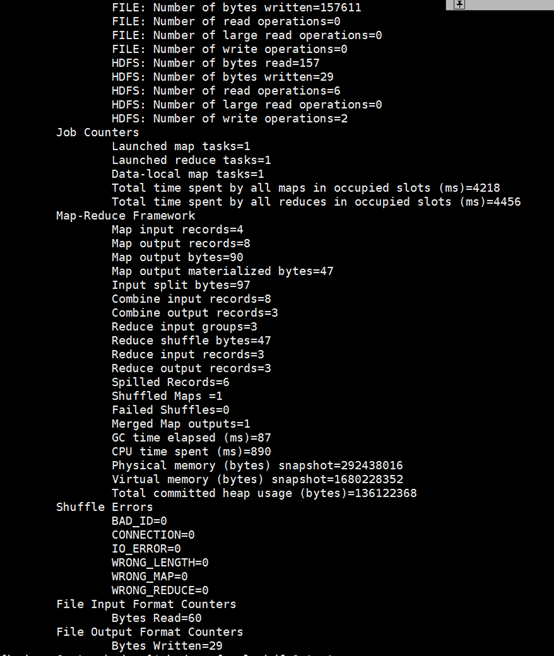

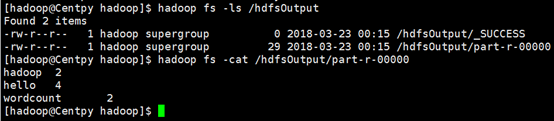

现在输入以下命令以查看输出路径及结果文件:

hadoop fs -ls /hdfsOutput

hadoop fs -cat /hdfsOutput/part-r-00000

显然,结果和在Eclipse环境下的一致。

本文内容就到此结束了,希望大家通过阅读本文之后能够明白在这两个不同环境下运行MapReduce程序的具体流程、区别以及注意事项。

以上就是博主为大家介绍的这一板块的主要内容,这都是博主自己的学习过程,希望能给大家带来一定的指导作用,有用的还望大家点个支持,如果对你没用也望包涵,有错误烦请指出。如有期待可关注博主以第一时间获取更新哦,谢谢!

版权声明:本文为博主原创文章,未经博主允许不得转载。