1.读取

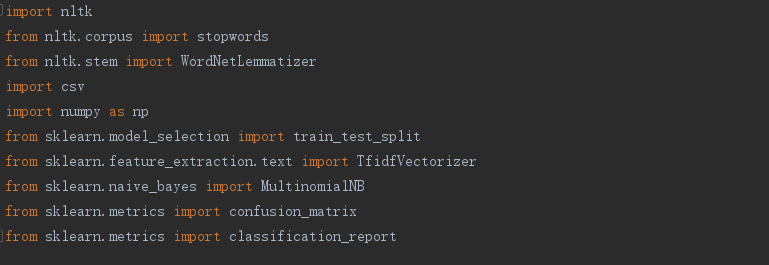

导入实验所需的Python库

2.数据预处理

进行数据的预处理,剔除停用词、还原长度大于3且为大写的单词、还原动词。

3.数据划分—训练集和测试集数据划分

from sklearn.model_selection import train_test_split

按照8:2划分数据集进行训练和测试

x_train,x_test, y_train, y_test = train_test_split(data, target, test_size=0.2, random_state=0, stratify=y_train)

4.文本特征提取

sklearn.feature_extraction.text.CountVectorizer

sklearn.feature_extraction.text.TfidfVectorizer

from sklearn.feature_extraction.text import TfidfVectorizer

tfidf2 = TfidfVectorizer()

观察邮件与向量的关系

向量还原为邮件

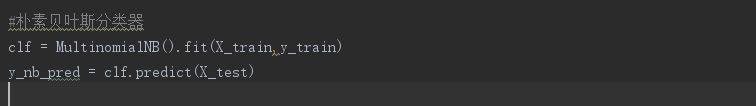

4.模型选择

from sklearn.naive_bayes import GaussianNB

from sklearn.naive_bayes import MultinomialNB

说明为什么选择这个模型?

本次试验是对文本进行统计分析,类似于词袋模型,进行n次独立重复实验,符合多项式分布概率模型,所以选用多项式朴素贝叶斯分类器更适用于具有离散特征的分类。

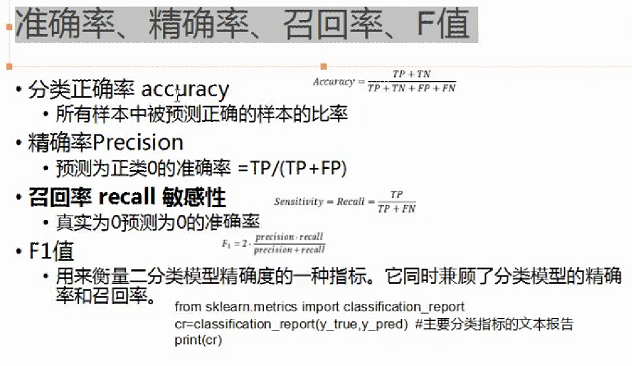

5.模型评价:混淆矩阵,分类报告

from sklearn.metrics import confusion_matrix

confusion_matrix = confusion_matrix(y_test, y_predict)

说明混淆矩阵的含义

混淆矩阵是机器学习中总结分类模型预测结果的情形分析表,以矩阵形式将数据集中的记录按照真实的类别与分类模型预测的类别判断两个标准进行汇总。

from sklearn.metrics import classification_report

说明准确率、精确率、召回率、F值分别代表的意义

![]()

![]()

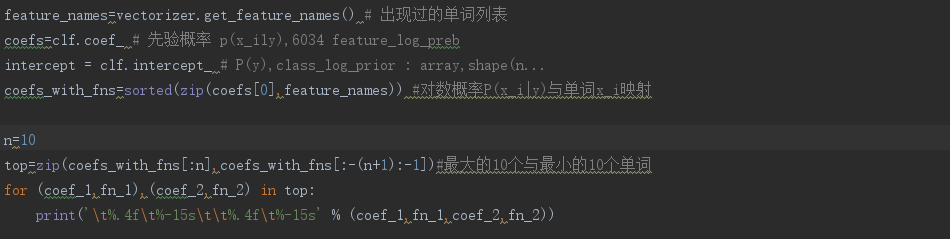

6.比较与总结

如果用CountVectorizer进行文本特征生成,与TfidfVectorizer相比,效果如何?

CountVectorizer是先根据所有训练文本,不考虑其出现顺序,只将训练文本中每个出现过的词汇单独视为一列特征,构成一个词汇表(vocabulary list),此方法也称为词袋法。

TfidfVectorizer是将原始文档集合转换为TF-IDF特征矩阵。等同于TvidfTransformer之后的CountVectorizer。TfidfVectorizer()是基于tf-idf的算法。此算法包括两部分tf和idf,两者相乘得到tf-idf算法。tf算法统计某训练文本中,某个词的出现次数,计算公式如下:

具体对比如下: