一、ConcurrentHashMap类简介

ConcurrentHashMap是一个同步集合工具类,是一个线程安全的HashMap。不同版本的ConcurrentHashMap,内部实现机制千差万别。最大的变化在JDK1.8。 本节讨论的基于JDK1.8。

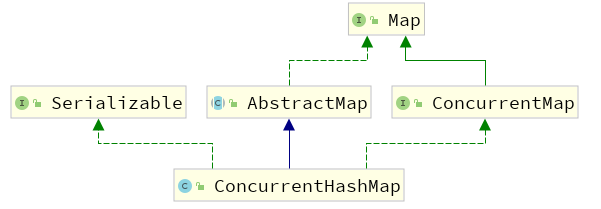

ConcurrentHashMap类的继承关系:

可看到ConcurrentHashMap继承了AbstractMap,提供Map接口的骨干实现,最大限度地减少实现Map这类数据结构时所需的工作量。

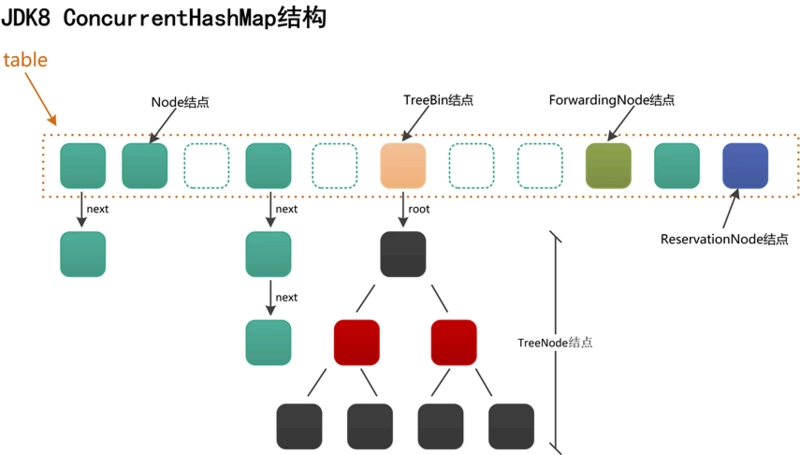

另外,ConcurrentHashMap实现了ConcurrentMap这个接口,它主要提供了一些针对Map的原子操作:

ConcurrentMap 接口提供的功能

default V getOrDefault(Object key, V defaultValue) {} //返回指定key对应的值;如果Map不存在该key,则返回defaultValue

default void forEach(BiConsumer action); //遍历Map的所有Entry,并对其进行指定的aciton操作

V putIfAbsent(K key, V value); //如果Map不存在指定的key,则插入<K,V>;否则,直接返回该key对应的值

boolean remove(Object key, Object value); //删除与<key,value>完全匹配的Entry,并返回true;否则,返回false

boolean replace(K key, V oldValue, V newValue); //如果存在key,且值和oldValue一致,则更新为newValue,并返回true;否则,返回false

V replace(K key, V value); //如果存在key,则更新为value,返回旧value;否则,返回null

default void replaceAll(BiFunction<? super K, ? super V, ? extends V> function) {}; //遍历Map的所有Entry,并对其进行指定的funtion操作

default V computeIfAbsent(K key,Function<? super K, ? extends V> mappingFunction); //如果Map不存在指定的key,则通过mappingFunction计算value并插入

default V computeIfPresent(K key, BiFunction remappingFunction) ; //如果Map存在指定的key,则通过mappingFunction计算value并替换旧值

default V compute(K key, BiFunction remappingFunction); //根据指定的key,查找value;然后根据得到的value和remappingFunction重新计算新值,并替换旧值

default V merge(K key, V value, BiFunction remappingFunction); //如果key不存在,则插入value;否则,根据key对应的值和remappingFunction计算新值,并替换旧值

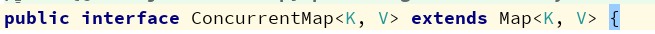

二、ConcurrentHashMap基本结构(JDK1.8)

ConcurrentHashMap对象内部结构

基本结构

ConcurrentHashMap内部维护了一个Node类型的数组,也就是table:transient volatile Node<K, V>[] table;

数组的每个位置table[i]代表一个桶,当插入键值对时,会根据键的hash值映射到不同的桶位置,table一共可以包含4种不同类型的桶:Node,TreeBin,ForwardingNode,ReservationNode。

上图中,不同的桶用的颜色不同。

需要注意的是:TreeBin锁链接的是一颗红黑树,红黑树的节点用TreeNode表示,所以ConcurrentHashMap中实际上一共有五种不同类型的Node节点。

之所以用TreeBin而不是直接用TreeNode,是因为红黑树的操作比较复杂,包括构建,左/右旋,删除,平衡等操作,用一个代理节点TreeBin来包含这些复杂操作,其实是一种 “职责隔离” 的思想。另外TreeBin中包含了一些加/解锁的 操作。

在JDK1.8之前,ConcurrentHashMap采用了分段锁的设计思路,以减少热点域的冲突。JDK1.8时不再延续,转而直接对每个桶加锁,并用“红黑树”链接冲突结点。

节点定义

1. Node节点

Node节点的定义非常简单,也是其中四种类型节点的父类

默认链接到table[i]——桶上的节点就是Node节点

当出现hash冲突,Node节点会首先以链表的形式链接到table上,当节点数量超过一定数目时,链表会转化为红黑树,因为链表查找的平均时间复杂度为O(n),而红黑树是一种平衡二叉树,其平均时间复杂度为O(logn)。

// 普通的Entry结点, 以链表形式保存时才会使用, 存储实际的数据. static class Node<K, V> implements Map.Entry<K, V> { final int hash; final K key; volatile V val; volatile Node<K, V> next; // 链表指针 Node(int hash, K key, V val, Node<K, V> next) { this.hash = hash; this.key = key; this.val = val; this.next = next; } public final K getKey() { return key; } public final V getValue() { return val; } public final int hashCode() { return key.hashCode() ^ val.hashCode(); } public final String toString() { return key + "=" + val; } public final V setValue(V value) { throw new UnsupportedOperationException(); } public final boolean equals(Object o) { Object k, v, u; Map.Entry<?, ?> e; return ((o instanceof Map.Entry) && (k = (e = (Map.Entry<?, ?>) o).getKey()) != null && (v = e.getValue()) != null && (k == key || k.equals(key)) && (v == (u = val) || v.equals(u))); } // 链表查找. Node<K, V> find(int h, Object k) { Node<K, V> e = this; if (k != null) { do { K ek; if (e.hash == h && ((ek = e.key) == k || (ek != null && k.equals(ek)))) return e; } while ((e = e.next) != null); } return null; } }

2、TreeNode结点

TreeNode就是红黑树的节点,TreeNode不会直接链接到table[i]——桶上面,而是由TreeBin链接,TreeBin会指向红黑树的根节点。

//红黑树结点, 存储实际的数据.

static final class TreeNode<K, V> extends Node<K, V> {

boolean red;

TreeNode<K, V> parent;

TreeNode<K, V> left;

TreeNode<K, V> right;

// prev指针是为了方便删除. 删除链表的非头结点时,需要知道它的前驱结点才能删除,所以直接提供一个prev指针

TreeNode<K, V> prev;

TreeNode(int hash, K key, V val, Node<K, V> next,

TreeNode<K, V> parent) {

super(hash, key, val, next);

this.parent = parent;

}

Node<K, V> find(int h, Object k) {

return findTreeNode(h, k, null);

}

// 以当前结点(this)为根结点,开始遍历查找指定key.

final TreeNode<K, V> findTreeNode(int h, Object k, Class<?> kc) {

if (k != null) {

TreeNode<K, V> p = this;

do {

int ph, dir;

K pk;

TreeNode<K, V> q;

TreeNode<K, V> pl = p.left, pr = p.right;

if ((ph = p.hash) > h)

p = pl;

else if (ph < h)

p = pr;

else if ((pk = p.key) == k || (pk != null && k.equals(pk)))

return p;

else if (pl == null)

p = pr;

else if (pr == null)

p = pl;

else if ((kc != null ||

(kc = comparableClassFor(k)) != null) &&

(dir = compareComparables(kc, k, pk)) != 0)

p = (dir < 0) ? pl : pr;

else if ((q = pr.findTreeNode(h, k, kc)) != null)

return q;

else

p = pl;

} while (p != null);

}

return null;

}

}

3、TreeBin结点

TreeBin相当于TreeNode的代理节点。TreeBin会直接链接到table[i]——桶上面,该节点提供了一系列红黑树相关的操作,以及加/解锁操作

/**

* TreeNode的代理结点(相当于封装了TreeNode的容器,提供针对红黑树的转换操作和锁控制)

* hash值固定为-3

*/

static final class TreeBin<K, V> extends Node<K, V> {

TreeNode<K, V> root; // 红黑树结构的根结点

volatile TreeNode<K, V> first; // 链表结构的头结点

volatile Thread waiter; // 最近的一个设置WAITER标识位的线程

volatile int lockState; // 整体的锁状态标识位

static final int WRITER = 1; // 红黑树的写锁状态

static final int WAITER = 2; //红黑树的等待获取写锁状态

static final int READER = 4; // 红黑树的读锁状态,读可以并发,每多一个读线程,lockState都加上一个READER值

// 在hashCode相等并且不是Comparable类型时,用此方法判断大小.

static int tieBreakOrder(Object a, Object b) {

int d;

if (a == null || b == null ||

(d = a.getClass().getName().

compareTo(b.getClass().getName())) == 0)

d = (System.identityHashCode(a) <= System.identityHashCode(b) ?

-1 : 1);

return d;

}

// 将以b为头结点的链表转换为红黑树.

TreeBin(TreeNode<K, V> b) {

super(TREEBIN, null, null, null);

this.first = b;

TreeNode<K, V> r = null;

for (TreeNode<K, V> x = b, next; x != null; x = next) {

next = (TreeNode<K, V>) x.next;

x.left = x.right = null;

if (r == null) {

x.parent = null;

x.red = false;

r = x;

} else {

K k = x.key;

int h = x.hash;

Class<?> kc = null;

for (TreeNode<K, V> p = r; ; ) {

int dir, ph;

K pk = p.key;

if ((ph = p.hash) > h)

dir = -1;

else if (ph < h)

dir = 1;

else if ((kc == null &&

(kc = comparableClassFor(k)) == null) ||

(dir = compareComparables(kc, k, pk)) == 0)

dir = tieBreakOrder(k, pk);

TreeNode<K, V> xp = p;

if ((p = (dir <= 0) ? p.left : p.right) == null) {

x.parent = xp;

if (dir <= 0)

xp.left = x;

else

xp.right = x;

r = balanceInsertion(r, x);

break;

}

}

}

}

this.root = r;

assert checkInvariants(root);

}

// 对红黑树的根结点加写锁.

private final void lockRoot() {

if (!U.compareAndSwapInt(this, LOCKSTATE, 0, WRITER))

contendedLock();

}

// 释放写锁.

private final void unlockRoot() {

lockState = 0;

}

/**

* Possibly blocks awaiting root lock.

*/

private final void contendedLock() {

boolean waiting = false;

for (int s; ; ) {

if (((s = lockState) & ~WAITER) == 0) {

if (U.compareAndSwapInt(this, LOCKSTATE, s, WRITER)) {

if (waiting)

waiter = null;

return;

}

} else if ((s & WAITER) == 0) {

if (U.compareAndSwapInt(this, LOCKSTATE, s, s | WAITER)) {

waiting = true;

waiter = Thread.currentThread();

}

} else if (waiting)

LockSupport.park(this);

}

}

/**

* 从根结点开始遍历查找,找到“相等”的结点就返回它,没找到就返回null

* 当存在写锁时,以链表方式进行查找

*/

final Node<K, V> find(int h, Object k) {

if (k != null) {

for (Node<K, V> e = first; e != null; ) {

int s;

K ek;

/**

* 两种特殊情况下以链表的方式进行查找:

* 1. 有线程正持有写锁,这样做能够不阻塞读线程

* 2. 有线程等待获取写锁,不再继续加读锁,相当于“写优先”模式

*/

if (((s = lockState) & (WAITER | WRITER)) != 0) {

if (e.hash == h &&

((ek = e.key) == k || (ek != null && k.equals(ek))))

return e;

e = e.next;

} else if (U.compareAndSwapInt(this, LOCKSTATE, s,

s + READER)) {

TreeNode<K, V> r, p;

try {

p = ((r = root) == null ? null :

r.findTreeNode(h, k, null));

} finally {

Thread w;

if (U.getAndAddInt(this, LOCKSTATE, -READER) ==

(READER | WAITER) && (w = waiter) != null)

LockSupport.unpark(w);

}

return p;

}

}

}

return null;

}

/**

* 查找指定key对应的结点,如果未找到,则插入.

* @return 插入成功返回null, 否则返回找到的结点

*/

final TreeNode<K, V> putTreeVal(int h, K k, V v) {

Class<?> kc = null;

boolean searched = false;

for (TreeNode<K, V> p = root; ; ) {

int dir, ph;

K pk;

if (p == null) {

first = root = new TreeNode<K, V>(h, k, v, null, null);

break;

} else if ((ph = p.hash) > h)

dir = -1;

else if (ph < h)

dir = 1;

else if ((pk = p.key) == k || (pk != null && k.equals(pk)))

return p;

else if ((kc == null &&

(kc = comparableClassFor(k)) == null) ||

(dir = compareComparables(kc, k, pk)) == 0) {

if (!searched) {

TreeNode<K, V> q, ch;

searched = true;

if (((ch = p.left) != null &&

(q = ch.findTreeNode(h, k, kc)) != null) ||

((ch = p.right) != null &&

(q = ch.findTreeNode(h, k, kc)) != null))

return q;

}

dir = tieBreakOrder(k, pk);

}

TreeNode<K, V> xp = p;

if ((p = (dir <= 0) ? p.left : p.right) == null) {

TreeNode<K, V> x, f = first;

first = x = new TreeNode<K, V>(h, k, v, f, xp);

if (f != null)

f.prev = x;

if (dir <= 0)

xp.left = x;

else

xp.right = x;

if (!xp.red)

x.red = true;

else {

lockRoot();

try {

root = balanceInsertion(root, x);

} finally {

unlockRoot();

}

}

break;

}

}

assert checkInvariants(root);

return null;

}

/**

* 删除红黑树的结点:

* 1. 红黑树规模太小时,返回true,然后进行 树 -> 链表 的转化;

* 2. 红黑树规模足够时,不用变换成链表,但删除结点时需要加写锁.

*/

final boolean removeTreeNode(TreeNode<K, V> p) {

TreeNode<K, V> next = (TreeNode<K, V>) p.next;

TreeNode<K, V> pred = p.prev; // unlink traversal pointers

TreeNode<K, V> r, rl;

if (pred == null)

first = next;

else

pred.next = next;

if (next != null)

next.prev = pred;

if (first == null) {

root = null;

return true;

}

if ((r = root) == null || r.right == null || // too small

(rl = r.left) == null || rl.left == null)

return true;

lockRoot();

try {

TreeNode<K, V> replacement;

TreeNode<K, V> pl = p.left;

TreeNode<K, V> pr = p.right;

if (pl != null && pr != null) {

TreeNode<K, V> s = pr, sl;

while ((sl = s.left) != null) // find successor

s = sl;

boolean c = s.red;

s.red = p.red;

p.red = c; // swap colors

TreeNode<K, V> sr = s.right;

TreeNode<K, V> pp = p.parent;

if (s == pr) { // p was s's direct parent

p.parent = s;

s.right = p;

} else {

TreeNode<K, V> sp = s.parent;

if ((p.parent = sp) != null) {

if (s == sp.left)

sp.left = p;

else

sp.right = p;

}

if ((s.right = pr) != null)

pr.parent = s;

}

p.left = null;

if ((p.right = sr) != null)

sr.parent = p;

if ((s.left = pl) != null)

pl.parent = s;

if ((s.parent = pp) == null)

r = s;

else if (p == pp.left)

pp.left = s;

else

pp.right = s;

if (sr != null)

replacement = sr;

else

replacement = p;

} else if (pl != null)

replacement = pl;

else if (pr != null)

replacement = pr;

else

replacement = p;

if (replacement != p) {

TreeNode<K, V> pp = replacement.parent = p.parent;

if (pp == null)

r = replacement;

else if (p == pp.left)

pp.left = replacement;

else

pp.right = replacement;

p.left = p.right = p.parent = null;

}

root = (p.red) ? r : balanceDeletion(r, replacement);

if (p == replacement) { // detach pointers

TreeNode<K, V> pp;

if ((pp = p.parent) != null) {

if (p == pp.left)

pp.left = null;

else if (p == pp.right)

pp.right = null;

p.parent = null;

}

}

} finally {

unlockRoot();

}

assert checkInvariants(root);

return false;

}

// 左旋

static <K, V> TreeNode<K, V> rotateLeft(TreeNode<K, V> root,

TreeNode<K, V> p) {

TreeNode<K, V> r, pp, rl;

if (p != null && (r = p.right) != null) {

if ((rl = p.right = r.left) != null)

rl.parent = p;

if ((pp = r.parent = p.parent) == null)

(root = r).red = false;

else if (pp.left == p)

pp.left = r;

else

pp.right = r;

r.left = p;

p.parent = r;

}

return root;

}

//右旋

static <K, V> TreeNode<K, V> rotateRight(TreeNode<K, V> root,

TreeNode<K, V> p) {

TreeNode<K, V> l, pp, lr;

if (p != null && (l = p.left) != null) {

if ((lr = p.left = l.right) != null)

lr.parent = p;

if ((pp = l.parent = p.parent) == null)

(root = l).red = false;

else if (pp.right == p)

pp.right = l;

else

pp.left = l;

l.right = p;

p.parent = l;

}

return root;

}

// 添加时平衡红黑树

static <K, V> TreeNode<K, V> balanceInsertion(TreeNode<K, V> root,

TreeNode<K, V> x) {

x.red = true;

for (TreeNode<K, V> xp, xpp, xppl, xppr; ; ) {

if ((xp = x.parent) == null) {

x.red = false;

return x;

} else if (!xp.red || (xpp = xp.parent) == null)

return root;

if (xp == (xppl = xpp.left)) {

if ((xppr = xpp.right) != null && xppr.red) {

xppr.red = false;

xp.red = false;

xpp.red = true;

x = xpp;

} else {

if (x == xp.right) {

root = rotateLeft(root, x = xp);

xpp = (xp = x.parent) == null ? null : xp.parent;

}

if (xp != null) {

xp.red = false;

if (xpp != null) {

xpp.red = true;

root = rotateRight(root, xpp);

}

}

}

} else {

if (xppl != null && xppl.red) {

xppl.red = false;

xp.red = false;

xpp.red = true;

x = xpp;

} else {

if (x == xp.left) {

root = rotateRight(root, x = xp);

xpp = (xp = x.parent) == null ? null : xp.parent;

}

if (xp != null) {

xp.red = false;

if (xpp != null) {

xpp.red = true;

root = rotateLeft(root, xpp);

}

}

}

}

}

}

// 删除时,平衡红黑树

static <K, V> TreeNode<K, V> balanceDeletion(TreeNode<K, V> root,

TreeNode<K, V> x) {

for (TreeNode<K, V> xp, xpl, xpr; ; ) {

if (x == null || x == root)

return root;

else if ((xp = x.parent) == null) {

x.red = false;

return x;

} else if (x.red) {

x.red = false;

return root;

} else if ((xpl = xp.left) == x) {

if ((xpr = xp.right) != null && xpr.red) {

xpr.red = false;

xp.red = true;

root = rotateLeft(root, xp);

xpr = (xp = x.parent) == null ? null : xp.right;

}

if (xpr == null)

x = xp;

else {

TreeNode<K, V> sl = xpr.left, sr = xpr.right;

if ((sr == null || !sr.red) &&

(sl == null || !sl.red)) {

xpr.red = true;

x = xp;

} else {

if (sr == null || !sr.red) {

if (sl != null)

sl.red = false;

xpr.red = true;

root = rotateRight(root, xpr);

xpr = (xp = x.parent) == null ?

null : xp.right;

}

if (xpr != null) {

xpr.red = (xp == null) ? false : xp.red;

if ((sr = xpr.right) != null)

sr.red = false;

}

if (xp != null) {

xp.red = false;

root = rotateLeft(root, xp);

}

x = root;

}

}

} else { // symmetric

if (xpl != null && xpl.red) {

xpl.red = false;

xp.red = true;

root = rotateRight(root, xp);

xpl = (xp = x.parent) == null ? null : xp.left;

}

if (xpl == null)

x = xp;

else {

TreeNode<K, V> sl = xpl.left, sr = xpl.right;

if ((sl == null || !sl.red) &&

(sr == null || !sr.red)) {

xpl.red = true;

x = xp;

} else {

if (sl == null || !sl.red) {

if (sr != null)

sr.red = false;

xpl.red = true;

root = rotateLeft(root, xpl);

xpl = (xp = x.parent) == null ?

null : xp.left;

}

if (xpl != null) {

xpl.red = (xp == null) ? false : xp.red;

if ((sl = xpl.left) != null)

sl.red = false;

}

if (xp != null) {

xp.red = false;

root = rotateRight(root, xp);

}

x = root;

}

}

}

}

}

// 递归检查红黑树的正确性

static <K, V> boolean checkInvariants(TreeNode<K, V> t) {

TreeNode<K, V> tp = t.parent, tl = t.left, tr = t.right,

tb = t.prev, tn = (TreeNode<K, V>) t.next;

if (tb != null && tb.next != t)

return false;

if (tn != null && tn.prev != t)

return false;

if (tp != null && t != tp.left && t != tp.right)

return false;

if (tl != null && (tl.parent != t || tl.hash > t.hash))

return false;

if (tr != null && (tr.parent != t || tr.hash < t.hash))

return false;

if (t.red && tl != null && tl.red && tr != null && tr.red)

return false;

if (tl != null && !checkInvariants(tl))

return false;

if (tr != null && !checkInvariants(tr))

return false;

return true;

}

private static final sun.misc.Unsafe U;

private static final long LOCKSTATE;

static {

try {

U = sun.misc.Unsafe.getUnsafe();

Class<?> k = TreeBin.class;

LOCKSTATE = U.objectFieldOffset

(k.getDeclaredField("lockState"));

} catch (Exception e) {

throw new Error(e);

}

}

}

4、ForwardingNode结点

ForwardingNode节点仅仅在扩容时才会使用

/**

* ForwardingNode是一种临时结点,在扩容进行中才会出现,hash值固定为-1,且不存储实际数据。

* 如果旧table数组的一个hash桶中全部的结点都迁移到了新table中,则在这个桶中放置一个ForwardingNode。

* 读操作碰到ForwardingNode时,将操作转发到扩容后的新table数组上去执行;写操作碰见它时,则尝试帮助扩容。

*/

static final class ForwardingNode<K, V> extends Node<K, V> {

final Node<K, V>[] nextTable;

ForwardingNode(Node<K, V>[] tab) {

super(MOVED, null, null, null);

this.nextTable = tab;

}

// 在新的数组nextTable上进行查找

Node<K, V> find(int h, Object k) {

// loop to avoid arbitrarily deep recursion on forwarding nodes

outer:

for (Node<K, V>[] tab = nextTable; ; ) {

Node<K, V> e;

int n;

if (k == null || tab == null || (n = tab.length) == 0 ||

(e = tabAt(tab, (n - 1) & h)) == null)

return null;

for (; ; ) {

int eh;

K ek;

if ((eh = e.hash) == h &&

((ek = e.key) == k || (ek != null && k.equals(ek))))

return e;

if (eh < 0) {

if (e instanceof ForwardingNode) {

tab = ((ForwardingNode<K, V>) e).nextTable;

continue outer;

} else

return e.find(h, k);

}

if ((e = e.next) == null)

return null;

}

}

}

}

5、ReservationNode结点

保留节点,ConcurrentHashMap中的一些特殊方法会专门用到该节点

/** * 保留结点. * hash值固定为-3, 不保存实际数据 * 只在computeIfAbsent和compute这两个函数式API中充当占位符加锁使用 */ static final class ReservationNode<K, V> extends Node<K, V> { ReservationNode() { super(RESERVED, null, null, null); } Node<K, V> find(int h, Object k) { return null; } }

三、源码

(一)、构造器

ConcurrentHashMap提供了五个构造器,它们最多也只是计算了table的初始容量大小,并没有进行实际的创建table数据的工作。

ConcurrentHashMap,采用了一种 “懒加载” 的模式,只有到首次插入键值对的时候,才会真正的去初始化table数组。

// 空构造器。该构造函数用于创建一个带有默认初始容量 (16)、加载因子 (0.75) 和 concurrencyLevel (16) 的新的空映射。

public ConcurrentHashMap() {};

// 指定table初始容量的构造器。该构造函数用于创建一个带有指定初始容量、默认加载因子 (0.75) 和 concurrencyLevel (16) 的新的空映射。

public ConcurrentHashMap(int initialCapacity) {

if (initialCapacity < 0) //不可以小于0

throw new IllegalArgumentException();

int cap = ((initialCapacity >= (MAXIMUM_CAPACITY >>> 1)) ? MAXIMUM_CAPACITY : tableSizeFor(initialCapacity + (initialCapacity >>> 1) + 1));

this.sizeCtl = cap;

}

// 根据已有的Map构造ConcurrentHashMap。该构造函数用于构造一个与给定映射具有相同映射关系的新映射。

public ConcurrentHashMap(Map<? extends K, ? extends V> m) {

this.sizeCtl = DEFAULT_CAPACITY;

putAll(m);

}

// 指定table初始容量和负载因子的构造器。该构造函数用于创建一个带有指定初始容量、加载因子和默认 concurrencyLevel (1) 的新的空映射。

public ConcurrentHashMap(int initialCapacity, float loadFactor) {

this(initialCapacity, loadFactor, 1);

}

// 指定table初始容量、负载因子、并发级别的构造器。该构造函数用于创建一个带有指定初始容量、加载因子和并发级别的新的空映射。

public ConcurrentHashMap(int initialCapacity,

float loadFactor, int concurrencyLevel) {

if (!(loadFactor > 0.0f) || initialCapacity < 0 || concurrencyLevel <= 0) //合法性判断

throw new IllegalArgumentException();

if (initialCapacity < concurrencyLevel) // Use at least as many bins

initialCapacity = concurrencyLevel; // as estimated threads

long size = (long)(1.0 + (long)initialCapacity / loadFactor);

int cap = (size >= (long)MAXIMUM_CAPACITY) ?

MAXIMUM_CAPACITY : tableSizeFor((int)size);

this.sizeCtl = cap;

}

// 上个构造方法里面最主要的是,初始化sizeCtl。在这里保证sizeCtl必须是2的n次方,所以这里调用tableSizeFor方法的目的就是调整sizeCtl大小为2的n次方。

private static final int tableSizeFor(int c) {

int n = c - 1;

n |= n >>> 1;

n |= n >>> 2;

n |= n >>> 4;

n |= n >>> 8;

n |= n >>> 16;

return (n < 0) ? 1 : (n >= MAXIMUM_CAPACITY) ? MAXIMUM_CAPACITY : n + 1;

}

注意:concurrencyLevel只是为了兼容JDK1.8以前的版本,并不是实际的并发级别,loadFactor也不是实际的负载因子 这两个都失去了原有的意义,仅仅对初始容量有一定的控制作用

对于构造函数而言,会根据输入的initialCapacity的大小来确定一个最小的且大于等于initialCapacity大小的2的n次幂,如initialCapacity为15,则sizeCtl为16,若initialCapacity为16,则sizeCtl为16。

若initialCapacity大小超过了允许的最大值,则sizeCtl为最大值。

值得注意的是,构造函数中的concurrencyLevel参数已经在JDK1.8中的意义发生了很大的变化,其并不代表所允许的并发数,

其只是用来确定sizeCtl大小,在JDK1.8中的并发控制都是针对具体的桶而言,即有多少个桶就可以允许多少个并发数。

(二)、常量/字段

常量:

private static final int MAXIMUM_CAPACITY = 1 << 30; // 数组最大容量

private static final int DEFAULT_CAPACITY = 16; //默认初始容量

static final int MAX_ARRAY_SIZE = Integer.MAX_VALUE - 8; //最大数组数量

private static final float LOAD_FACTOR = 0.75f; //负载因子,为了兼容JDK1.8以前的版本而保留。

private static final int DEFAULT_CONCURRENCY_LEVEL = 16; // 默认并发数

static final int TREEIFY_THRESHOLD = 8; //链表转红黑树的阈值,即链接结点数大于8时, 链表转换为树.

static final int UNTREEIFY_THRESHOLD = 6; //红黑树转链表的阈值,即树结点树小于6时,树转换为链表.

static final int MIN_TREEIFY_CAPACITY = 64; // 转换为红黑树的数组最小容量

private static final int MIN_TRANSFER_STRIDE = 16; // 每次进行转换的最小值

private static int RESIZE_STAMP_BITS = 16; // 用于在扩容时生成唯一的随机数. 生成sizeCtl所使用的bit位数

private static final int MAX_RESIZERS = (1 << (32 - RESIZE_STAMP_BITS)) - 1; // 进行扩容操作的最大线程数.

private static final int RESIZE_STAMP_SHIFT = 32 - RESIZE_STAMP_BITS; // 记录sizeCtl中的大小所需要进行的偏移位数

static final int MOVED = -1; // 标识ForwardingNode结点(在扩容时才会出现,不存储实际数据)

static final int TREEBIN = -2;// 标识红黑树的根结点

static final int RESERVED = -3; // 标识ReservationNode结点()

static final int HASH_BITS = 0x7fffffff;

static final int NCPU = Runtime.getRuntime().availableProcessors(); // 获取可用的CPU个数,扩容时使用

字段:

//Node数组,大小总是2的幂次.

transient volatile Node<K, V>[] table;

// 扩容后的新Node数组,只有在扩容时才非空.

private transient volatile Node<K, V>[] nextTable;

/**

* 控制table的初始化和扩容控制.

* 0 : 初始默认值

* -1 : 有线程正在进行table的初始化

* >0 : table初始化时使用的容量,或初始化/扩容完成后的threshold

* -(1 + nThreads) : 记录正在执行扩容任务的线程数

*/

private transient volatile int sizeCtl;

// 扩容下另一个Node数组的索引

private transient volatile int transferIndex;

// 计数基值,当没有线程竞争时,计数将加到该变量上。类似于LongAdder的base变量

private transient volatile long baseCount;

// 计数数组,出现并发冲突时使用。类似于LongAdder的cells数组

private transient volatile CounterCell[] counterCells;

// 旋转锁

private transient volatile int cellsBusy;

// 视图

private transient KeySetView<K, V> keySet;

private transient ValuesView<K, V> values;

private transient EntrySetView<K, V> entrySet;

// Unsafe mechanics private static final sun.misc.Unsafe U; private static final long SIZECTL; private static final long TRANSFERINDEX; private static final long BASECOUNT; private static final long CELLSBUSY; private static final long CELLVALUE; private static final long ABASE; private static final int ASHIFT;

static {

try {

U = sun.misc.Unsafe.getUnsafe();

Class<?> k = ConcurrentHashMap.class;

SIZECTL = U.objectFieldOffset

(k.getDeclaredField("sizeCtl"));

TRANSFERINDEX = U.objectFieldOffset

(k.getDeclaredField("transferIndex"));

BASECOUNT = U.objectFieldOffset

(k.getDeclaredField("baseCount"));

CELLSBUSY = U.objectFieldOffset

(k.getDeclaredField("cellsBusy"));

Class<?> ck = CounterCell.class;

CELLVALUE = U.objectFieldOffset

(ck.getDeclaredField("value"));

Class<?> ak = Node[].class;

ABASE = U.arrayBaseOffset(ak);

int scale = U.arrayIndexScale(ak);

if ((scale & (scale - 1)) != 0)

throw new Error("data type scale not a power of two");

ASHIFT = 31 - Integer.numberOfLeadingZeros(scale);

} catch (Exception e) {

throw new Error(e);

}

}

(三)put操作方法

//插入键值对,<K,V>均不能为null. public V put(K key, V value) { return putVal(key, value, false); } //实际的插入操作。仅当key不存在时,才插入 final V putVal(K key, V value, boolean onlyIfAbsent) { if (key == null || value == null) throw new NullPointerException(); //键和值为空,抛异常 int hash = spread(key.hashCode()); // 再次计算hash值 /** * 使用链表保存时,binCount记录table[i]这个桶中所保存的结点数; * 使用红黑树保存时,binCount==2,保证put后更改计数值时能够进行扩容检查,同时不触发红黑树化操作 */ int binCount = 0; for (Node<K, V>[] tab = table; ; ) { // 自旋插入结点,直到成功 Node<K, V> f; int n, i, fh; if (tab == null || (n = tab.length) == 0) // 1. 当Node数组为空时,进行第一次初始化 tab = initTable(); // 首次初始化table —— 懒加载 else if ((f = tabAt(tab, i = (n - 1) & hash)) == null) { // 2: table[i]对应的桶为null // 注意下上面table[i]的索引i的计算方式:[ key的hash值 & (table.length-1) ] // 这也是table容量必须为2的幂次的原因,读者可以自己看下当table.length为2的幂次时,(table.length-1)的二进制形式的特点 —— 全是1 // 配合这种索引计算方式可以实现key的均匀分布,减少hash冲突 if (casTabAt(tab, i, null, new Node<K, V>(hash, key, value, null))) // 通过CAS操作,插入一个链表结点 break; } else if ((fh = f.hash) == MOVED) // 3: 发现ForwardingNode结点,说明此时table正在扩容,则尝试协助数据迁移 tab = helpTransfer(tab, f); else { // 4: 出现hash冲突,也就是table[i]桶中已经有了结点 V oldVal = null; synchronized (f) { // 锁住table[i]结点 if (tabAt(tab, i) == f) { // 再判断一下table[i]是不是第一个结点, 防止其它线程的写修改 if (fh >= 0) { // 4.1: table[i]是链表结点 binCount = 1; for (Node<K, V> e = f; ; ++binCount) { K ek; // 找到“相等”的结点,判断是否需要更新value值 if (e.hash == hash && ((ek = e.key) == key || (ek != null && key.equals(ek)))) { oldVal = e.val; //保存该节点的val值 if (!onlyIfAbsent) e.val = value; break; } Node<K, V> pred = e; if ((e = e.next) == null) { // 当前节点的下一个节点为空,则该节点为最后节点 pred.next = new Node<K, V>(hash, key, value, null); //新生一个节点并且赋值给next域 break; //退出循环 } } } else if (f instanceof TreeBin) { // 4.2: table[i]是红黑树结点 Node<K, V> p; binCount = 2; if ((p = ((TreeBin<K, V>) f).putTreeVal(hash, key, value)) != null) { //将hash,key,value放入红黑树 oldVal = p.val; //保存节点的val if (!onlyIfAbsent) p.val = value; } } } } if (binCount != 0) { if (binCount >= TREEIFY_THRESHOLD) //在4.1步骤中循环添加节点,binCount增加,如果大于等于转换为红黑树的临界值 treeifyBin(tab, i); // 转换为红黑树 if (oldVal != null) // 旧值不为空 return oldVal; // 返回旧值 break; } } } addCount(1L, binCount); // 记录table中元素的数量 return null; }

说明: put函数底层调用了putVal进行数据的插入,对于putVal函数的流程如下:

① 判断存储的key、value是否为空,若是,抛异常,否则进入步骤②

② 计算key的hash值,随后进入无限循环,该无限循环可以确保成功插入数据,若table表为空或者长度为0,则初始化table表,否则,进入步骤③

③ 根据key的hash值取出table表中的结点元素,若取出的结点为空(该桶为空),则使用CAS将key,value,hash值生成的节点放入桶中。否则,进入步骤④

④ 若该节点的hash为MOVED,则对该桶中的结点进行转移。否则 进入步骤⑤

⑤ 对桶中的第一个节点(即table表中的节点)进行加锁,对该桶进行遍历,桶中的节点的hash值与key值与给定的hash值和key值相等,则根据标识选择是否进行更新操作(用给定的value值替换该节点的value值),若遍历完桶仍没有找到hash值与key值和指定的hash值与key值相等的结点,则直接新生一个结点并赋值为之前最后一个结点的下一个结点。进入步骤⑥

⑥ 若binCount值达到红黑树转化的阈值,则将桶中的结构转化为红黑树存储,最后,增加binCount的值。

或

- 计算key的hash值,即调用speed()方法计算hash值;

- 获取hash值对应的Node节点位置,此时通过一个循环实现。有以下几种情况:

- 如果table表为空,则首先进行初始化操作,初始化之后再次进入循环获取Node节点的位置;

- 如果table不为空,但没有找到key对应的Node节点,则直接调用casTabAt()方法插入一个新节点,此时不用加锁;

- 如果table不为空,且key对应的Node节点也不为空,但Node头结点的hash值为MOVED(-1),则表示需要扩容,此时调用helpTransfer()方法进行扩容;

- 其他情况下,则直接向Node中插入一个新Node节点,此时需要对这个Node链表或红黑树通过synchronized加锁。

- 插入元素后,判断对应的Node结构是否需要改变结构,如果需要则调用treeifyBin()方法将Node链表升级为红黑树结构;

- 最后,调用addCount()方法记录table中元素的数量。

在putVal一共处理四种情况,这四种情况分别对应如下方法:initTable()、tabAt()/casTabAt()、helpTransfer()、putTreeVal()/treeifyBin()函数。下面对其中涉及到的函数进行分析。

1) initTable()方法: 对于table的大小,会根据sizeCtl的值进行设置,如果没有设置sizeCtl的值,那么默认生成的table大小为16,否则,会根据sizeCtl的大小设置table大小

private final Node<K,V>[] initTable() {

Node<K,V>[] tab; int sc;

while ((tab = table) == null || tab.length == 0) { // 无限循环

if ((sc = sizeCtl) < 0) // sizeCtl小于0,则进行线程让步等待

Thread.yield(); // lost initialization race; just spin

else if (U.compareAndSwapInt(this, SIZECTL, sc, -1)) { // 比较sizeCtl的值与sc是否相等,相等则用-1替换

try {

if ((tab = table) == null || tab.length == 0) { // table表为空或者大小为0

// sc的值是否大于0,若是,则n为sc,否则,n为默认初始容量

int n = (sc > 0) ? sc : DEFAULT_CAPACITY;

@SuppressWarnings("unchecked")

// 新生结点数组

Node<K,V>[] nt = (Node<K,V>[])new Node<?,?>[n];

// 赋值给table

table = tab = nt;

// sc为 n * 3/4

sc = n - (n >>> 2);

}

} finally {

// 设置sizeCtl的值

sizeCtl = sc;

}

break;

}

}

// 返回table表

return tab;

}

2) table[i]对应的桶为空,最简单的情况,直接CAS操作占用桶table[i]即可。

tabAt()方法:此函数返回table数组中下标为 i 的Node节点,可以看到是通过Unsafe对象通过反射获取的,getObjectVolatile的第二项参数为下标为i的偏移地址。

casTabAt() 方法:此函数用于比较table数组下标为i的结点是否为c,若为c,则用v交换操作。否则,不进行交换操作。

static final <K,V> Node<K,V> tabAt(Node<K,V>[] tab, int i) {

return (Node<K,V>)U.getObjectVolatile(tab, ((long)i << ASHIFT) + ABASE);

}

static final <K,V> boolean casTabAt(Node<K,V>[] tab, int i,

Node<K,V> c, Node<K,V> v) {

return U.compareAndSwapObject(tab, ((long)i << ASHIFT) + ABASE, c, v);

}

3) helpTransfer() 方法. 发现ForwardingNode结点,说明此时table正在扩容,则尝试协助进行数据迁移

ForwardingNode结点是ConcurrentHashMap中的五类结点之一,相当于一个占位结点,表示当前table正在进行扩容,当前线程可以尝试协助数据迁移。

final Node<K,V>[] helpTransfer(Node<K,V>[] tab, Node<K,V> f) {

Node<K,V>[] nextTab; int sc;

// table表不为空 && 节点类型是ForwardingNode类型 && 结点的nextTable不为空

if (tab != null && (f instanceof ForwardingNode) && (nextTab = ((ForwardingNode<K,V>)f).nextTable) != null) {

int rs = resizeStamp(tab.length);

while (nextTab == nextTable && table == tab && (sc = sizeCtl) < 0) { // 条件判断

if ((sc >>> RESIZE_STAMP_SHIFT) != rs || sc == rs + 1 ||

sc == rs + MAX_RESIZERS || transferIndex <= 0)

break;

if (U.compareAndSwapInt(this, SIZECTL, sc, sc + 1)) { // 比较并交换

// 将table的结点转移到nextTab中

transfer(tab, nextTab);

break;

}

}

return nextTab;

}

return table;

}

4)出现hash冲突,也就是table[i]桶中已经有了结点

当两个不同key映射到同一个table[i]桶中时,就会出现这种情况:

-

当table[i]的结点类型为Node——链表结点时,就会将新结点以“尾插法”的形式插入链表的尾部。putTreeVal()

-

当table[i]的结点类型为TreeBin——红黑树代理结点时,就会将新结点通过红黑树的插入方式插入。treeifyBin()

//此函数用于将指定的hash、key、value值添加到红黑树中,若已经添加了,则返回null,否则返回该结点。

final TreeNode<K,V> putTreeVal(int h, K k, V v) {

Class<?> kc = null;

boolean searched = false;

for (TreeNode<K,V> p = root;;) {

int dir, ph; K pk;

if (p == null) {

first = root = new TreeNode<K,V>(h, k, v, null, null);

break;

}

else if ((ph = p.hash) > h)

dir = -1;

else if (ph < h)

dir = 1;

else if ((pk = p.key) == k || (pk != null && k.equals(pk)))

return p;

else if ((kc == null &&

(kc = comparableClassFor(k)) == null) ||

(dir = compareComparables(kc, k, pk)) == 0) {

if (!searched) {

TreeNode<K,V> q, ch;

searched = true;

if (((ch = p.left) != null &&

(q = ch.findTreeNode(h, k, kc)) != null) ||

((ch = p.right) != null &&

(q = ch.findTreeNode(h, k, kc)) != null))

return q;

}

dir = tieBreakOrder(k, pk);

}

TreeNode<K,V> xp = p;

if ((p = (dir <= 0) ? p.left : p.right) == null) {

TreeNode<K,V> x, f = first;

first = x = new TreeNode<K,V>(h, k, v, f, xp);

if (f != null)

f.prev = x;

if (dir <= 0)

xp.left = x;

else

xp.right = x;

if (!xp.red)

x.red = true;

else {

lockRoot();

try {

root = balanceInsertion(root, x);

} finally {

unlockRoot();

}

}

break;

}

}

assert checkInvariants(root);

return null;

}

//此函数用于将桶中的数据结构转化为红黑树,其中,值得注意的是,当table的长度未达到阈值时,会进行一次扩容操作,

//该操作会使得触发treeifyBin操作的某个桶中的所有元素进行一次重新分配,这样可以避免某个桶中的结点数量太大。

private final void treeifyBin(Node<K,V>[] tab, int index) {

Node<K,V> b; int n, sc;

if (tab != null) { // 表不为空

if ((n = tab.length) < MIN_TREEIFY_CAPACITY) // table表的长度小于最小的长度

// 进行扩容,调整某个桶中结点数量过多的问题(由于某个桶中结点数量超出了阈值,则触发treeifyBin)

tryPresize(n << 1);

else if ((b = tabAt(tab, index)) != null && b.hash >= 0) { // 桶中存在结点并且结点的hash值大于等于0

synchronized (b) { // 对桶中第一个结点进行加锁

if (tabAt(tab, index) == b) { // 第一个结点没有变化

TreeNode<K,V> hd = null, tl = null;

// 遍历列表,建立红黑树

for (Node<K,V> e = b; e != null; e = e.next) { // 新生一个TreeNode结点

TreeNode<K,V> p =

new TreeNode<K,V>(e.hash, e.key, e.val,

null, null);

if ((p.prev = tl) == null) // 该结点前驱为空

// 设置p为头结点

hd = p;

else

// 尾节点的next域赋值为p

tl.next = p;

// 尾节点赋值为p

tl = p;

}

//以TreeBin类型包装,并链接到table[index]中

setTabAt(tab, index, new TreeBin<K,V>(hd));

}

}

}

}

}

putVal方法的最后,涉及将链表转换为红黑树 —— treeifyBin ,但实际情况并非立即就会转换,当table的容量小于64时,出于性能考虑,只是对table数组扩容1倍——tryPresize。

(四)、get操作方法

public V get(Object key) {

Node<K, V>[] tab;

Node<K, V> e, p;

int n, eh;

K ek;

int h = spread(key.hashCode()); // 重新计算key的hash值

if ((tab = table) != null && (n = tab.length) > 0 && (e = tabAt(tab, (n - 1) & h)) != null) {

if ((eh = e.hash) == h) { // table[i]就是待查找的项,直接返回

if ((ek = e.key) == key || (ek != null && key.equals(ek)))

return e.val;

} else if (eh < 0) // hash值<0, 说明遇到特殊结点(非链表结点), 调用find方法查找

return (p = e.find(h, key)) != null ? p.val : null;

while ((e = e.next) != null) { // 对于节点hash值大于0的情况,按链表方式查找

if (e.hash == h &&

((ek = e.key) == key || (ek != null && key.equals(ek))))

return e.val;

}

}

return null;

}

get方法的逻辑很简单,首先根据key的hash值计算映射到table的哪个桶——table[i]。

- 如果table[i]的key和待查找key相同,那直接返回;

- 如果table[i]对应的结点是特殊结点(hash值小于0),则通过

find方法查找;- 如果table[i]对应的结点是普通链表结点,则按链表方式查找。

不同结点的find查找方式有所不同,我们来具体看下:

Node节点的查找

当槽 table[i] 被普通Node节点占用,说明是链表链接的形式,直接从链表头开始查找:

//链表查找

Node<K, V> find(int h, Object k) {

Node<K, V> e = this;

if (k != null) {

do {

K ek;

if (e.hash == h && ((ek = e.key) == k || (ek != null && k.equals(ek))))

return e;

} while ((e = e.next) != null);

}

return null;

}

TreeBin结点的查找

TreeBin的查找比较特殊,我们知道当槽table[i] 被TreeBin节点占用时,说明链接的是一颗红黑树。由于红黑树的插入,删除会涉及整个结构的调整,所以通常存在读写并发操作的时候,是需要加锁的。

ConcurrentHashMap采用了一种类似读写锁的方式:

当线程持有写锁(修改红黑树)时,如果读线程需要查找,不会像传统的读写锁那样阻塞等待,而是转而以链表的形式进行查找(TreeBin本身时Node类型的子类,所有拥有Node的所有字段)

/**

* 从根结点开始遍历查找,找到“相等”的结点就返回它,没找到就返回null

* 当存在写锁时,以链表方式进行查找

*/

final Node<K, V> find(int h, Object k) {

if (k != null) {

for (Node<K, V> e = first; e != null; ) {

int s;

K ek;

/**

* 两种特殊情况下以链表的方式进行查找:

* 1. 有线程正持有写锁,这样做能够不阻塞读线程

* 2. 有线程等待获取写锁,不再继续加读锁,相当于“写优先”模式

*/

if (((s = lockState) & (WAITER | WRITER)) != 0) {

if (e.hash == h &&

((ek = e.key) == k || (ek != null && k.equals(ek))))

return e;

e = e.next; // 链表形式

}

// 读线程数量加1,读状态进行累加

else if (U.compareAndSwapInt(this, LOCKSTATE, s, s + READER)) {

TreeNode<K, V> r, p;

try {

p = ((r = root) == null ? null :

r.findTreeNode(h, k, null));

} finally {

Thread w;

// 如果当前线程是最后一个读线程,且有写线程因为读锁而阻塞,则写线程,告诉它可以尝试获取写锁了

if (U.getAndAddInt(this, LOCKSTATE, -READER) == (READER | WAITER) && (w = waiter) != null)

LockSupport.unpark(w);

}

return p;

}

}

}

return null;

}

ForwardingNode结点的查找

ForwardingNode是一种临时结点,在扩容进行中才会出现,所以查找也在扩容的table上进行:

// 在新的扩容table——nextTable上进行查找

Node<K, V> find(int h, Object k) {

// loop to avoid arbitrarily deep recursion on forwarding nodes

outer:

for (Node<K, V>[] tab = nextTable; ; ) {

Node<K, V> e;

int n;

if (k == null || tab == null || (n = tab.length) == 0 ||

(e = tabAt(tab, (n - 1) & h)) == null)

return null;

for (; ; ) {

int eh;

K ek;

if ((eh = e.hash) == h &&

((ek = e.key) == k || (ek != null && k.equals(ek))))

return e;

if (eh < 0) {

if (e instanceof ForwardingNode) {

tab = ((ForwardingNode<K, V>) e).nextTable;

continue outer;

} else

return e.find(h, k);

}

if ((e = e.next) == null)

return null;

}

}

}

ReservationNode结点的查找

ReservationNode是保留结点,不保存实际数据,所以直接返回null;Node<K, V> find(int h, Object k) { return null;}

(五)、ConcurrentHashMap的计数

计数原理

我们来看下ConcurrentHashMap是如何计算键值对的数目的:

public int size() {

long n = sumCount();

return ((n < 0L) ? 0 :

(n > (long) Integer.MAX_VALUE) ? Integer.MAX_VALUE :

(int) n);

}

size方法内部实际调用了sumCount方法:

final long sumCount() {

CounterCell[] as = counterCells;

CounterCell a;

long sum = baseCount;

if (as != null) {

for (int i = 0; i < as.length; ++i) {

if ((a = as[i]) != null)

sum += a.value;

}

}

return sum;

}

ConcurrentHashMap的计数其实延用了LongAdder分段计数的思路。

addCount的实现

回顾之前的putval方法的最后,当插入一对键值对后,通过addCount方法将计数值为加1:

//更改计数值。新增元素时,也就是在调用 putVal 方法后,为了通用,增加了个 check 入参,用于指定是否可能会出现扩容的情况 check >= 0 即为可能出现扩容的情况,例如 putVal方法中的调用

private final void addCount(long x, int check) {

CounterCell[] as;

long b, s;

if ((as = counterCells) != null ||

!U.compareAndSwapLong(this, BASECOUNT, b = baseCount, s = b + x)) { // 首先尝试更新baseCount

// 更新失败,说明出现并发冲突,则将计数值累加到Cell槽

CounterCell a;

long v;

int m;

boolean uncontended = true;

if (as == null || (m = as.length - 1) < 0 ||

(a = as[ThreadLocalRandom.getProbe() & m]) == null || // 根据线程hash值计算槽索引

!(uncontended = U.compareAndSwapLong(a, CELLVALUE, v = a.value, v + x))) {

fullAddCount(x, uncontended); // 槽更新也失败, 则会执行fullAddCount

return;

}

if (check <= 1)

return;

s = sumCount();

}

//检查当前集合元素个数 s 是否达到扩容阈值 sizeCtl ,扩容时 sizeCtl 为负数,依旧成立,同时还得满足数组非空且数组长度不能大于允许的数组最大长度这两个条件才能继续

// 下面的while 循环除了判断是否达到阈值从而进行扩容操作之外还有一个作用就是当一条线程完成自己的迁移任务后,如果集合还在扩容,则会继续循环,继续加入扩容大军,申请后面的迁移任务

if (check >= 0) { // 检测是否扩容

Node<K, V>[] tab, nt;

int n, sc;

while (s >= (long) (sc = sizeCtl) && (tab = table) != null && (n = tab.length) < MAXIMUM_CAPACITY) {

int rs = resizeStamp(n);

// sc < 0 说明集合正在扩容当中

if (sc < 0) {

// 判断扩容是否结束或者并发扩容线程数是否为最大值,若是结束循环

if ((sc >>> RESIZE_STAMP_SHIFT) != rs || sc == rs + 1 ||

sc == rs + MAX_RESIZERS || (nt = nextTable) == null ||

transferIndex <= 0)

break;

//扩容还未结束,并且允许扩容线程加入,此时加入扩容大军中

if (U.compareAndSwapInt(this, SIZECTL, sc, sc + 1))

transfer(tab, nt);

} else if (U.compareAndSwapInt(this, SIZECTL, sc, (rs << RESIZE_STAMP_SHIFT) + 2))

transfer(tab, null);

s = sumCount();

}

}

}

(六)删除操作

从源码中,我们看到调用remove() 进行删除节点操作,最后转到replaceNode()方法,所以我们具体来看下此方法。

final V replaceNode(Object key, V value, Object cv) {

// 计算key的hash值

int hash = spread(key.hashCode());

for (Node<K,V>[] tab = table;;) { // 无限循环

Node<K,V> f; int n, i, fh;

if (tab == null || (n = tab.length) == 0 ||

(f = tabAt(tab, i = (n - 1) & hash)) == null) // table表为空或者表长度为0或者key所对应的桶为空

// 跳出循环

break;

else if ((fh = f.hash) == MOVED) // 桶中第一个结点的hash值为MOVED

// 转移

tab = helpTransfer(tab, f);

else {

V oldVal = null;

boolean validated = false;

synchronized (f) { // 加锁同步

if (tabAt(tab, i) == f) { // 桶中的第一个结点没有发生变化

if (fh >= 0) { // 结点hash值大于0

validated = true;

for (Node<K,V> e = f, pred = null;;) { // 无限循环

K ek;

if (e.hash == hash &&

((ek = e.key) == key ||

(ek != null && key.equals(ek)))) { // 结点的hash值与指定的hash值相等,并且key也相等

V ev = e.val;

if (cv == null || cv == ev ||

(ev != null && cv.equals(ev))) { // cv为空或者与结点value相等或者不为空并且相等

// 保存该结点的val值

oldVal = ev;

if (value != null) // value为null

// 设置结点value值

e.val = value;

else if (pred != null) // 前驱不为空

// 前驱的后继为e的后继,即删除了e结点

pred.next = e.next;

else

// 设置table表中下标为index的值为e.next

setTabAt(tab, i, e.next);

}

break;

}

pred = e;

if ((e = e.next) == null)

break;

}

}

else if (f instanceof TreeBin) { // 为红黑树结点类型

validated = true;

// 类型转化

TreeBin<K,V> t = (TreeBin<K,V>)f;

TreeNode<K,V> r, p;

if ((r = t.root) != null &&

(p = r.findTreeNode(hash, key, null)) != null) { // 根节点不为空并且存在与指定hash和key相等的结点

// 保存p结点的value

V pv = p.val;

if (cv == null || cv == pv ||

(pv != null && cv.equals(pv))) { // cv为空或者与结点value相等或者不为空并且相等

oldVal = pv;

if (value != null)

p.val = value;

else if (t.removeTreeNode(p)) // 移除p结点

setTabAt(tab, i, untreeify(t.first));

}

}

}

}

}

if (validated) {

if (oldVal != null) {

if (value == null)

// baseCount值减一

addCount(-1L, -1);

return oldVal;

}

break;

}

}

}

return null;

}

总结

本文较为详细地分析了ConcurrentHashMap的内部结构和典型方法的实现,下一篇将分析ConcurrentHashMap最复杂的部分——扩容/数据转移。

参考:https://segmentfault.com/a/1190000016096542