在通过scrapy框架进行某些网站数据爬取的时候,往往会碰到页面动态数据加载的情况发生,如果直接使用scrapy对其url发请求,是绝对获取不到那部分动态加载出来的数据值。但是通过观察我们会发现,通过浏览器进行url请求发送则会加载出对应的动态加载出的数据。那么如果我们想要在scrapy也获取动态加载出的数据,则必须使用selenium创建浏览器对象,然后通过该浏览器对象进行请求发送,获取动态加载的数据值。

1.案例分析:

- 需求:爬取网易新闻的国内板块下的新闻数据

- 需求分析:当点击国内超链进入国内对应的页面时,会发现当前页面展示的新闻数据是被动态加载出来的,如果直接通过程序对url进行请求,是获取不到动态加载出的新闻数据的。则就需要我们使用selenium实例化一个浏览器对象,在该对象中进行url的请求,获取动态加载的新闻数据。

2.selenium在scrapy中使用的原理分析:

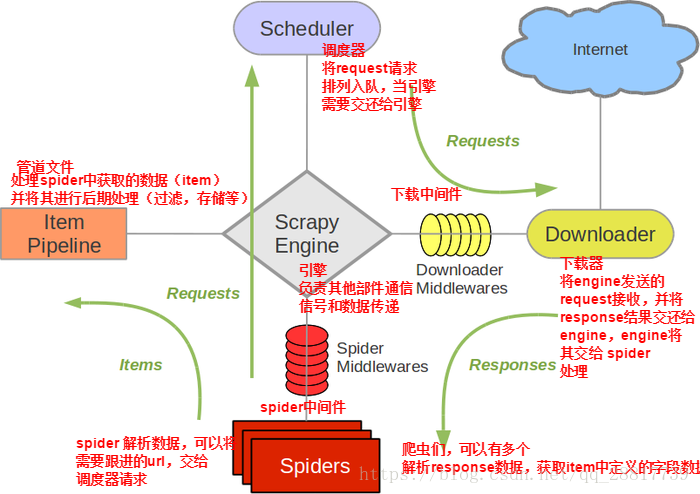

当引擎将国内板块url对应的请求提交给下载器后,下载器进行网页数据的下载,然后将下载到的页面数据,封装到response中,提交给引擎,引擎将response在转交给Spiders。Spiders接受到的response对象中存储的页面数据里是没有动态加载的新闻数据的。要想获取动态加载的新闻数据,则需要在下载中间件中对下载器提交给引擎的response响应对象进行拦截,切对其内部存储的页面数据进行篡改,修改成携带了动态加载出的新闻数据,然后将被篡改的response对象最终交给Spiders进行解析操作。

3.selenium在scrapy中的使用流程:

- 重写爬虫文件的构造方法,在该方法中使用selenium实例化一个浏览器对象(因为浏览器对象只需要被实例化一次)

- 重写爬虫文件的closed(self,spider)方法,在其内部关闭浏览器对象。该方法是在爬虫结束时被调用

- 重写下载中间件的process_response方法,让该方法对响应对象进行拦截,并篡改response中存储的页面数据

- 在配置文件中开启下载中间件

4.代码展示:

- 爬虫文件:

1 class WangyiSpider(RedisSpider): 2 name = 'wangyi' 3 #allowed_domains = ['www.xxxx.com'] 4 start_urls = ['https://news.163.com'] 5 def __init__(self): 6 #实例化一个浏览器对象(实例化一次) 7 self.bro = webdriver.Chrome(executable_path='/Users/bobo/Desktop/chromedriver') 8 9 #必须在整个爬虫结束后,关闭浏览器 10 def closed(self,spider): 11 print('爬虫结束') 12 self.bro.quit()

- 中间件文件:

1 from scrapy.http import HtmlResponse 2 #参数介绍: 3 #拦截到响应对象(下载器传递给Spider的响应对象) 4 #request:响应对象对应的请求对象 5 #response:拦截到的响应对象 6 #spider:爬虫文件中对应的爬虫类的实例 7 def process_response(self, request, response, spider): 8 #响应对象中存储页面数据的篡改 9 if request.url in['http://news.163.com/domestic/','http://news.163.com/world/','http://news.163.com/air/','http://war.163.com/']: 10 spider.bro.get(url=request.url) 11 js = 'window.scrollTo(0,document.body.scrollHeight)' 12 spider.bro.execute_script(js) 13 time.sleep(2) #一定要给与浏览器一定的缓冲加载数据的时间 14 #页面数据就是包含了动态加载出来的新闻数据对应的页面数据 15 page_text = spider.bro.page_source 16 #篡改响应对象 17 return HtmlResponse(url=spider.bro.current_url,body=page_text,encoding='utf-8',request=request) 18 else: 19 return response

- 配置文件:

1 DOWNLOADER_MIDDLEWARES = { 2 'wangyiPro.middlewares.WangyiproDownloaderMiddleware': 543, 3 4 }