1.Hive

1.1 在hadoop生态圈中属于数据仓库的角色。他能够管理hadoop中的数据,同时可以查询hadoop中的数据。

本质上讲,hive是一个SQL解析引擎。Hive可以把SQL查询转换为MapReduce中的job来运行。

hive有一套映射工具,可以把SQL转换为MapReduce中的job,可以把SQL中的表、字段转换为HDFS中的文件(夹)以及文件中的列。

这套映射工具称之为metastore,一般存放在derby、mysql中。

1.2 hive在hdfs中的默认位置是/user/hive/warehouse,是由配置文件hive-site.xml中属性hive.metastore.warehouse.dir决定的(简短点,可以修改为/hive)。

1.3 hive的系统架构

用户接口主要有三个:CLI,JDBC/ODBC和 WebUI

CLI,即Shell命令行

JDBC/ODBC 是 Hive 的Java,与使用传统数据库JDBC的方式类似

WebGUI是通过浏览器访问 Hive

Hive 将元数据存储在数据库中(metastore),目前只支持 mysql、derby。Hive 中的元数据包括表的名字,表的列和分区及其属性,表的属性(是否为外部表等),表的数据所在目录等

解释器、编译器、优化器完成 HQL 查询语句从词法分析、语法分析、编译、优化以及查询计划(plan)的生成。生成的查询计划存储在 HDFS 中,并在随后有 MapReduce 调用执行

Hive 的数据存储在 HDFS 中,大部分的查询由 MapReduce 完成(包含 * 的查询,比如 select * from table 不会生成 MapRedcue 任务)

2.hive的安装(在hadoop0上)

(1)解压缩、重命名、设置环境变量vi /etc/profile

export HIVE_HOME=/usr/local/hive

export PATH=....:$HIVE_HOME/bin...

设置好,执行source /etc/profile

(2)在目录$HIVE_HOME/conf/下,执行命令mv hive-default.xml.template hive-site.xml重命名

在目录$HIVE_HOME/conf/下,执行命令mv hive-env.sh.template hive-env.sh重命名

(3)修改hadoop的配置文件hadoop-env.sh,修改内容如下:

打开修改 export HADOOP_CLASSPATH=.:$CLASSPATH:$HADOOP_CLASSPATH:$HADOOP_HOME/bin

(4)在目录$HIVE_HOME/bin下面,修改文件hive-config.sh,增加以下内容:

export JAVA_HOME=/usr/local/jdk

export HIVE_HOME=/usr/local/hive

export HADOOP_HOME=/usr/local/hadoop

在hadoop0上执行hive命令,就进入到了hive命令行模式下,在这个模式下一些数据库操作跟MySQL的命令行下(cmd-->mysql -uroot -proot)的操作一样!

如: show databases;

use default;

show tables;

create table t1(id string);

show tables;

select * from t1;

通过在浏览器中输入hadoop0:50070,可以查看到hive在HDFS中的相关信息。

3.安装mysql

(1)删除linux上已经安装的mysql相关库信息。rpm -e mysql-libs-xxx --nodeps

执行命令rpm -qa |grep mysql 检查是否删除干净

(2)执行命令 rpm -i mysql-server-******** 安装mysql服务端

(3)启动mysql 服务端,执行命令 mysqld_safe &

(4)执行命令 rpm -i mysql-client-******** 安装mysql客户端

(5)执行命令mysql_secure_installation设置root用户密码( Y admin n n n Y ) 登录:mysql -uroot -padmin

4. 使用mysql作为hive的metastore

metastore是hive元数据的集中存放地。metastore默认使用内嵌的derby数据库作为存储引擎 Derby引擎的缺点:一次只能打开一个会话 使用Mysql作为外置存储引擎,多用户同时访问

(1)把mysql的jdbc驱动放置到hive的lib目录下cp mysql-connector-java-5.1.10.jar /usr/local/hive/lib/

(2)修改hive-site.xml文件,修改内容如下:

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://hadoop0:3306/hive?createDatabaseIfNotExist=true</value>

</property>

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.jdbc.Driver</value>

</property>

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>root</value>

</property>

<property>

<name>javax.jdo.option.ConnectionPassword</name>

<value>admin</value>

</property>

要想用工具远程连接MySQL数据库,先要在MySQL命令行下授权:grant all on hive.* to 'root'@'%' identified by 'admin';

刷新:flush privileges ;

5. 内部表

CREATE TABLE t1(id int);

LOAD DATA LOCAL INPATH '/root/id' INTO TABLE t1; -----先新建一个id文件,cd /root/

vi id 输入一些数据

1

2

3

4

5

注意:如果上面不加LOCAL,就会从HDFS中取找对应文件加载!

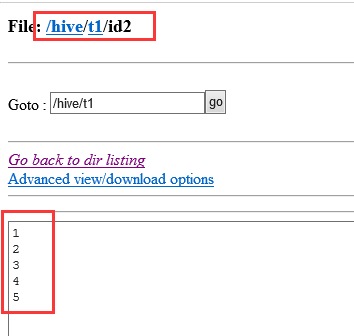

select * from t1;----可以查看到插入的数据,也可在浏览器中查看hadoop0:50070

注意:加载数据,用LOAD DATA..可以,也可以直接使用hadoop fs -put /root/id /hive/t1/id2,这样加载数据的效果跟LOAD DATA一样!

CREATE TABLE t2(id int, name string) ROW FORMAT DELIMITED FIELDS TERMINATED BY ' '; -----列与列之间通过制表符来区分

cp id stu

vi stu 输入数据

1 zhangsan

2 lisi

3 wangwu

4 zhaoliu

5 qian

上传数据到表里面:hadoop fs -put stu /hive/t2

6. 分区表

CREATE TABLE t3(id int) PARTITIONED BY (day int);

LOAD DATA LOCAL INPATH '/root/id' INTO TABLE t3 PARTITION (day=22);

LOAD DATA LOCAL INPATH '/root/id' INTO TABLE t3 PARTITION (day=23);

LOAD DATA LOCAL INPATH '/root/id' INTO TABLE t3 PARTITION (day=24);

在浏览器中查看,在/hive/t3/目录下,会有三个分区day=22,day=23,day=24

根据分区名来查询:select * from t3 where day=22;

7. 桶表

create table t4(id int) clustered by(id) into 4 buckets;

set hive.enforce.bucketing = true; ----默认不使用桶,现在改为使用桶

insert into table t4 select id from t3;

可以在浏览器中观察,/hive/t4表下有四个桶,分别都存储了数据。(数据加载到桶表时,会对字段值取hash值,然后与桶的数量取模。把数据放到对应的文件中)

8. 外部表(外部表不同于上面的表,上面的表都是受控表MANAGED_TABLE)

create external table t5(id int) location '/external';

hadoop fs -put /root/id /external/id

select * from t5;

9.使用Java客户端,查看Hive中表的数据

Hive远程服务启动#hive --service hiveserver >/dev/null 2>/dev/null &

JAVA客户端相关代码 (先导入hive中的Jar包)

1 package hive; 2 3 import java.sql.Connection; 4 import java.sql.DriverManager; 5 import java.sql.ResultSet; 6 import java.sql.Statement; 7 8 public class App { 9 10 public static void main(String[] args) throws Exception { 11 Class.forName("org.apache.hadoop.hive.jdbc.HiveDriver"); 12 Connection con = DriverManager.getConnection("jdbc:hive://hadoop0:10000/default", "", ""); 13 Statement stmt = con.createStatement(); 14 String querySQL="SELECT * FROM default.t1"; 15 16 ResultSet res = stmt.executeQuery(querySQL); 17 18 while (res.next()) { 19 System.out.println(res.getInt(1)); 20 } 21 22 } 23 24 }