Hive简介

Hive是一个基于Hadoop的数据仓库工具,可以将结构化的数据文件映射为一张数据库表,并使用HQL作为查询接口、HDFS作为存储底层、MapReduce作为执行层,将HQL语句转换成MapReduce任务进行运行,从而达到数据统计、数据分析的功能。

Hive有自身的元数据结构描述,可以使用MySQL等关系型数据库来进行存储,但请注意Hive中的所有数据都存储在HDFS中。

优点:与传统的SQL语法非常相近,学习成本低,可以通过HQL语法(类SQL语法)快速实现简单的MapReduce统计,而不必开发专门的MapReduce应用,十分适合数据仓库的统计分析。

缺点:执行速度慢,无法做到实时查询和基于行级的数据更新操作。Hive构建在基于静态批处理的Hadoop之上,Hadoop通常由较高的延迟并且在作业提交和调度的时候需要大量的开销。因此,Hive不适合在大规模数据集上实现低延迟快速的查询,而更适合为海量数据做数据挖掘、离线数据分析。

常见的应用场景:

- 数据分析,比如财务阶段性报表等。

- 用户标签计算:每天查询订单表,计算低频用户,然后推送营销活动。

Hive与关系型数据库的对比

| Hive | 关系型数据库 | |

|---|---|---|

| 查询语言 | HQL | SQL |

| 数据存储 | HDFS | 服务器本地文件系统 |

| 执行 | MapReduce | 关系型数据库自己设计的计算模型 |

| 执行延迟 | 高 | 低 |

| 处理数据规模 | 大 | 小 |

| 扩展性 | 扩展性强。可以方便的扩展存储能力和计算能力 | 差 |

网文关于Hive与关系型数据的深入分析

- 关系数据库里,表的加载模式是在数据加载时候强制确定的(表的加载模式是指数据库存储数据的文件格式),如果加载数据时候发现加载的数据不符合模式,关系数据库则会拒绝加载数据,这个就叫“写时模式”,写时模式会在数据加载时候对数据模式进行检查校验的操作。Hive在加载数据时候和关系数据库不同,hive在加载数据时候不会对数据进行检查,也不会更改被加载的数据文件,而检查数据格式的操作是在查询操作时候执行,这种模式叫“读时模式”。在实际应用中,写时模式在加载数据时候会对列进行索引,对数据进行压缩,因此加载数据的速度很慢,但是当数据加载好了,我们去查询数据的时候,速度很快。但是当我们的数据是非结构化,存储模式也是未知时候,关系数据操作这种场景就麻烦多了,这时候hive就会发挥它的优势。

- 关系数据库一个重要的特点是可以对某一行或某些行的数据进行更新、删除操作,hive不支持对某个具体行的操作,hive对数据的操作只支持覆盖原数据和追加数据。Hive也不支持事务和索引。更新、事务和索引都是关系数据库的特征,这些hive都不支持,也不打算支持,原因是hive的设计是海量数据进行处理,全数据的扫描时常态,针对某些具体数据进行操作的效率是很差的,对于更新操作,hive是通过查询将原表的数据进行转化最后存储在新表里,这和传统数据库的更新操作有很大不同。

- Hive也可以在hadoop做实时查询上做一份自己的贡献,那就是和hbase集成,hbase可以进行快速查询,但是hbase不支持类SQL的语句,那么此时hive可以给hbase提供sql语法解析的外壳,可以用类sql语句操作hbase数据库。

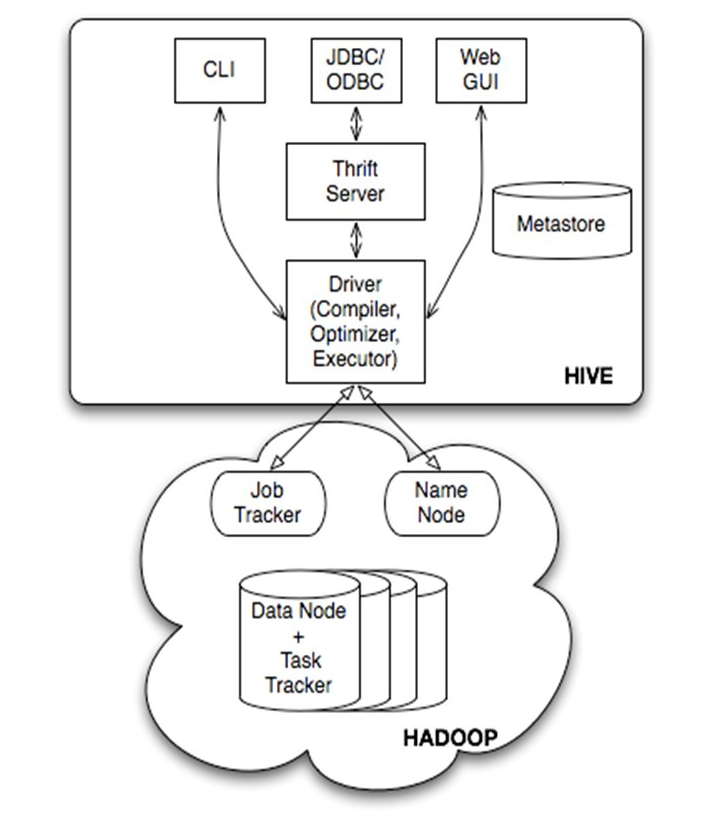

Hive架构图

由上图可知,hadoop和mapreduce是hive架构的根基。Hive架构包括如下组件:CLI(command line interface)、JDBC/ODBC、Thrift Server、WEB GUI、metastore和Driver( Complier、Optimizer和Executor),这些组件我可以分为两大类:服务端组件和客户端组件。

Driver组件:该组件包括Complier、Optimizer和Executor,它的作用是将我们写的HiveQL(类SQL)语句进行解析、编译优化,生成执行计划,然后调用底层的mapreduce计算框架。

Metastore组件:元数据服务组件,这个组件存储hive的元数据,hive的元数据存储在关系数据库里,hive支持的关系数据库有derby、mysql。元数据对于hive十分重要,因此hive支持把metastore服务独立出来,安装到远程的服务器集群里,从而解耦hive服务和metastore服务,保证hive运行的健壮性,这个方面的知识,我会在后面的metastore小节里做详细的讲解。

Thrift服务:thrift是facebook开发的一个软件框架,它用来进行可扩展且跨语言的服务的开发,hive集成了该服务,能让不同的编程语言调用hive的接口。

客户端组件:

CLI:command line interface,命令行接口。

Thrift客户端:上面的架构图里没有写上Thrift客户端,但是hive架构的许多客户端接口是建立在thrift客户端之上,包括JDBC和ODBC接口。

WEBGUI:hive客户端提供了一种通过网页的方式访问hive所提供的服务。这个接口对应hive的hwi组件(hive web interface),使用前要启动hwi服务。

下面着重讲讲metastore组件,具体如下:

Hive的metastore组件是hive元数据集中存放地。Metastore组件包括两个部分:metastore服务和后台数据的存储。后台数据存储的介质就是关系数据库,例如hive默认的嵌入式磁盘数据库derby,还有mysql数据库。Metastore服务是建立在后台数据存储介质之上,并且可以和hive服务进行交互的服务组件,默认情况下,metastore服务和hive服务是安装在一起的,运行在同一个进程当中。我也可以把metastore服务从hive服务里剥离出来,metastore独立安装在一个集群里,hive远程调用metastore服务,这样我们可以把元数据这一层放到防火墙之后,客户端访问hive服务,就可以连接到元数据这一层,从而提供了更好的管理性和安全保障。使用远程的metastore服务,可以让metastore服务和hive服务运行在不同的进程里,这样也保证了hive的稳定性,提升了hive服务的效率

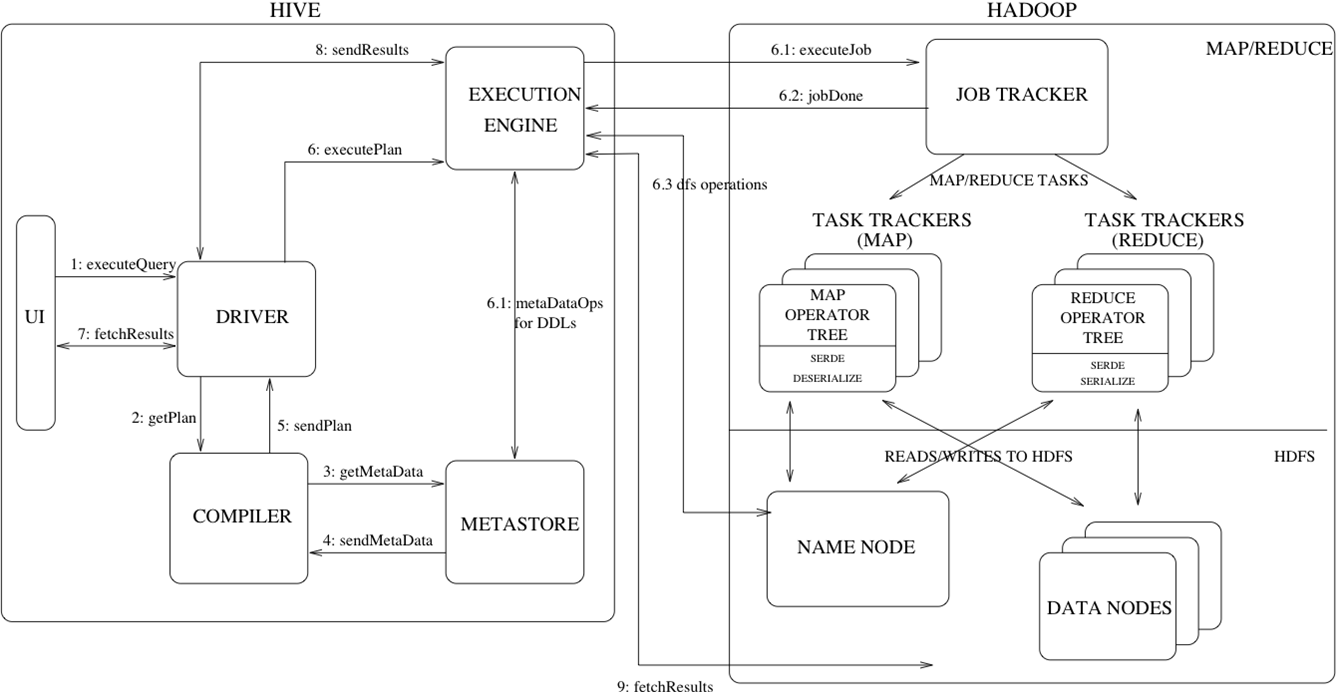

Hive 脚本执行流程

我自己画的简化版:

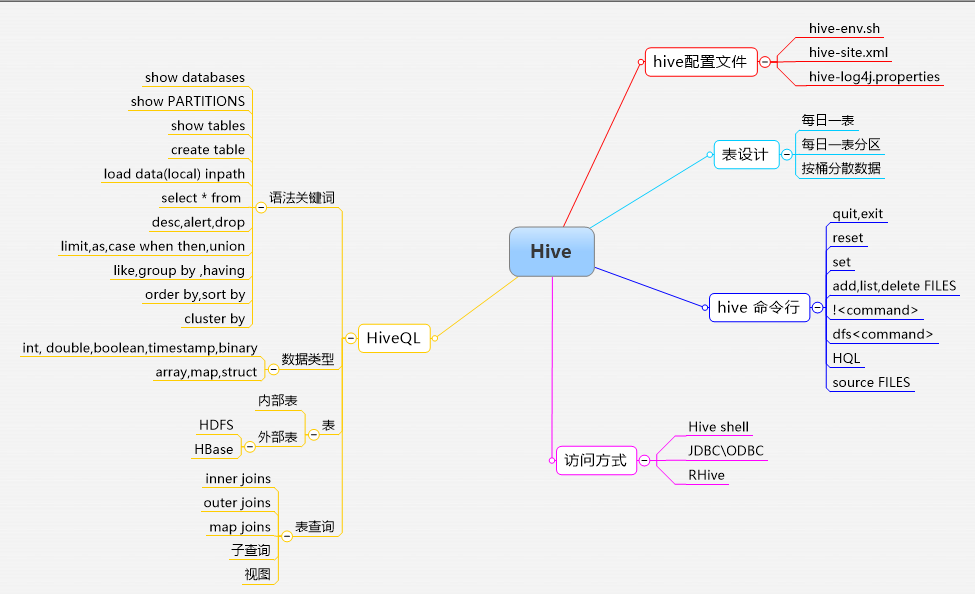

Hive 知识体系

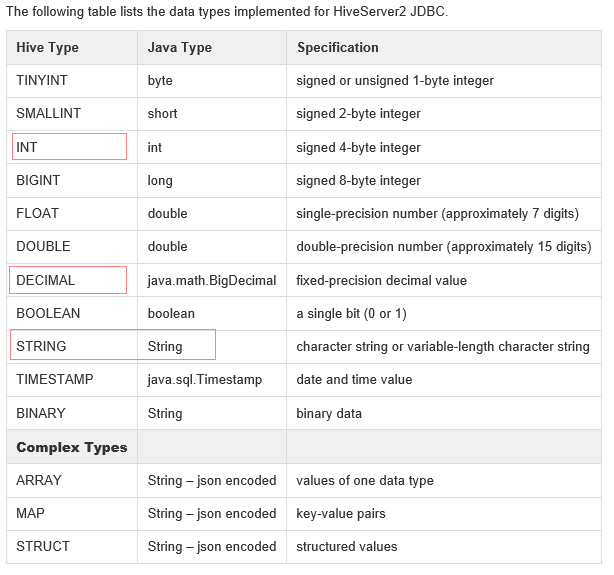

Hive 支持的数据类型

举例

1.首先,我们创建一个普通的文本文件,里面只有一行数据,该行也只存储一个字符串,命令如下:

echo 'zhangsan' > /opt/test/test.txt

2.创建一张Hive表:

hive -e 'create test(value string)'

3.加载数据

hive ;

load data local inpath '/opt/test/test.txtt' overwrite into table test ;

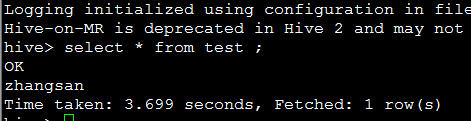

4.最后我们查询下表:

select * from test ;