反向传播算法是一个对于计算代价函数的梯度(即一阶导数)计算有效的技术。代价函数由刻画多层感知器的可调参数(突触权值和偏置)的函数来表示。算法计算能力是由两个明显的性质而导出的:反向传播算法是局部计算简单的;当算法是在线(逐次)学习时它实现权值空间的随机梯度下降。

反向传播算法是依靠局部计算来发现神经网络信息处理能力的一个连接论者范例的例子。计算限制的这种形式称为局部约束,它是指单个神经元实现的计算仅受那些与它有物理接触的神经元的影响。在(人工)神经网络的设计中提倡利用局部计算通常有三个主要理由:1.实现局部计算的神经网络常常被作为生物神经网络的类比来推举。2.由于使用局部计算允许由于硬件错误引起的平稳的性能下降,因此为容错网络设计提供基础。3.局部计算支持作为神经网络实现有效方法的并行体系结构。

通过反向传播算法训练的多层感知器的隐藏神经元作为特征检测器扮演者重要的角色。利用多层感知器的这个重要的性质的一个新方法是使用它作为复制器或者恒等映射。

具有一个隐藏层的作为编码器的复制器网络(恒等映射)

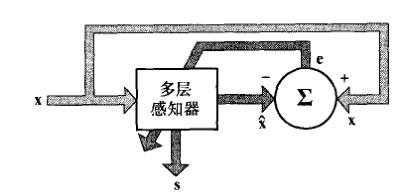

复制器网络监督训练的方框图:

作为解码器的复制器网络部分:

输入和输出层神经元数目具有相同的大小m。

隐藏层的神经元个数M小于m。

网络是完全连接的。

一个给定的模式x同时作为输入层的刺激和输出层的期望相应。输出层的实际相应x^是大锁作用x的“估计”。通过常用的方法使用反向传播算法训练网络,估计误差向量(x-x^)作为误差信号处理。借助多层感知器的设计所建立的特殊结构这一优点,通过它的隐藏层约束网络以实现恒等映射。事实上,完全训练的多层感知器充当了“编码器”的角色。为了重构初始时输入模式x的估计x^(即实现解码),我们将编码信号应用于复制网络隐藏层。事实上,后面的网络扮演了“解码器”的角色。如果我们似的隐藏层的大小M与输入/输出层大小m相比越小,那么该结构作为一个数据压缩系统的作用就越大。