sklearn转化器和预估器

转换器:

想一下之前做的特征工程的步骤?

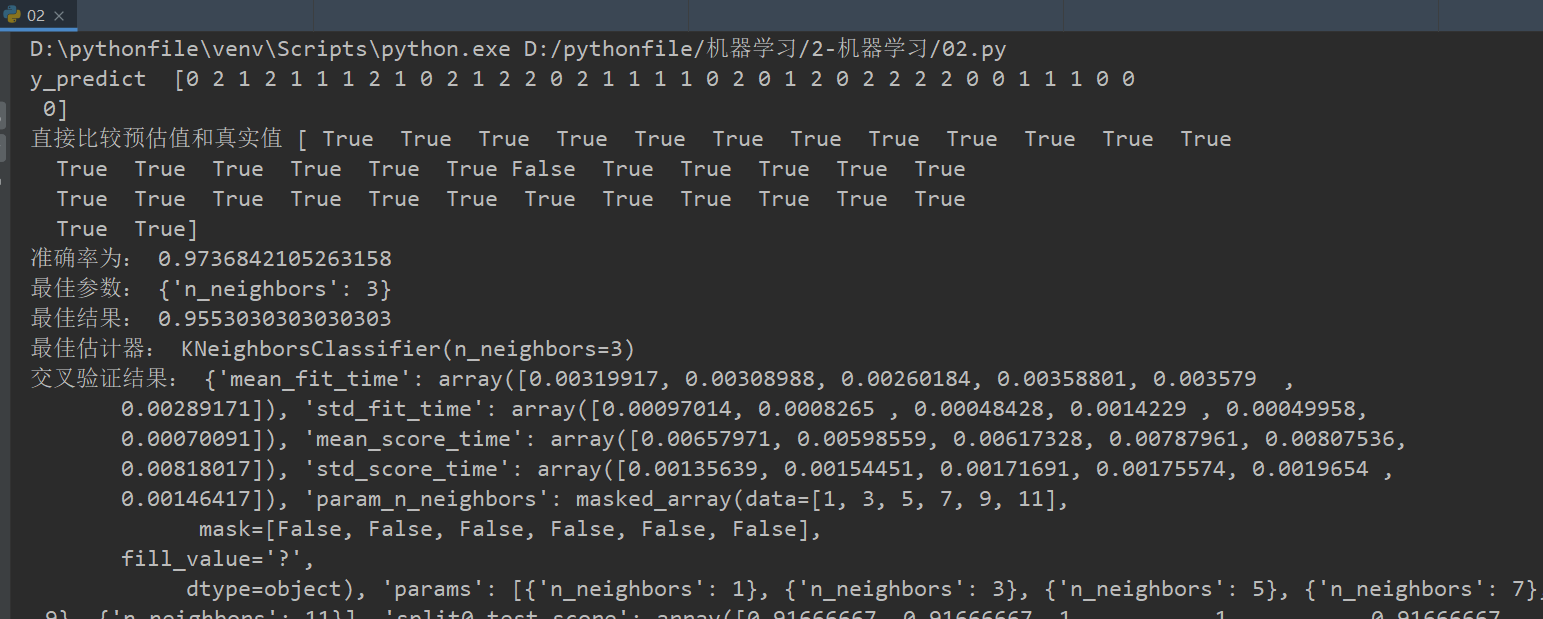

- 1、实例化 (实例化的是一个转换器类(Transformer))

- 2、调用fit_transform(对于文档建立分类词频矩阵,不能同时调用)

我们把特征工程的接口称之为转换器,其中转换器调用有这么几种形式

- fit_transform

- fit

- transform

这几个方法之间的区别是什么呢?我们看以下代码就清楚了

In [1]: from sklearn.preprocessing import StandardScaler In [2]: std1 = StandardScaler() In [3]: a = [[1,2,3], [4,5,6]] In [4]: std1.fit_transform(a) Out[4]: array([[-1., -1., -1.], [ 1., 1., 1.]]) In [5]: std2 = StandardScaler() In [6]: std2.fit(a) Out[6]: StandardScaler(copy=True, with_mean=True, with_std=True) In [7]: std2.transform(a) Out[7]: array([[-1., -1., -1.], [ 1., 1., 1.]])

从中可以看出,fit_transform的作用相当于transform加上fit。但是为什么还要提供单独的fit呢, 我们还是使用原来的std2来进行标准化看看

In [8]: b = [[7,8,9], [10, 11, 12]] In [9]: std2.transform(b) Out[9]: array([[3., 3., 3.], [5., 5., 5.]]) In [10]: std2.fit_transform(b) Out[10]: array([[-1., -1., -1.], [ 1., 1., 1.]])

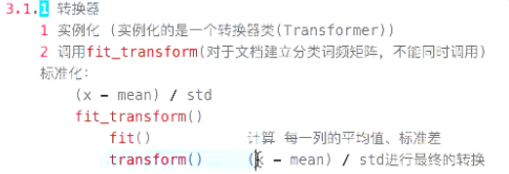

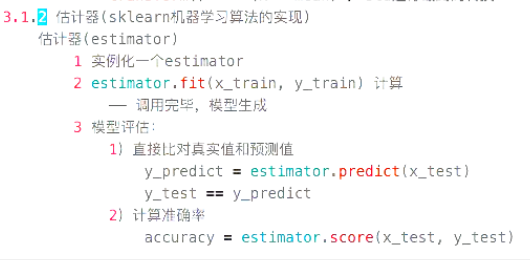

估计器(sklearn机器学习算法的实现):

在sklearn中,估计器(estimator)是一个重要的角色,是一类实现了算法的API

- 1、用于分类的估计器:

- sklearn.neighbors k-近邻算法

- sklearn.naive_bayes 贝叶斯

- sklearn.linear_model.LogisticRegression 逻辑回归

- sklearn.tree 决策树与随机森林

- 2、用于回归的估计器:

- sklearn.linear_model.LinearRegression 线性回归

- sklearn.linear_model.Ridge 岭回归

- 3、用于无监督学习的估计器

- sklearn.cluster.KMeans 聚类

估计器工作流程

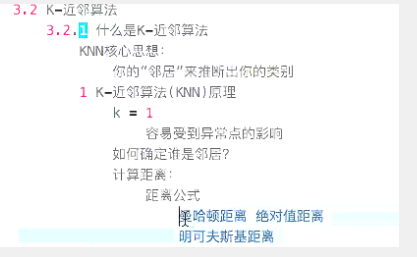

K-近邻算法:

核心思想;根据你的邻居判别你的类别

定义

如果一个样本在特征空间中的k个最相似(即特征空间中最邻近)的样本中的大多数属于某一个类别,则该样本也属于这个类别。

来源:KNN算法最早是由Cover和Hart提出的一种分类算法

距离公式

两个样本的距离可以通过如下公式计算,又叫欧式距离

K-近邻算法API

sklearn.neighbors.KNeighborsClassifier(n_neighbors=5,algorithm='auto') n_neighbors:int,可选(默认= 5),k_neighbors查询默认使用的邻居数 algorithm:{‘auto’,‘ball_tree’,‘kd_tree’,‘brute’},可选用于计算最近邻居的算法:‘ball_tree’将会使用 BallTree,‘kd_tree’将使用 KDTree。‘auto’将尝试根据传递给fit方法的值来决定最合适的算法。 (不同实现方式影响效率)

类型分析案例:

K值取得过大,当样本不均衡的时候容易出错。

K值取得过小,容易受到异常点的影响。在进行K-近邻算法之前需要怎样的处理。

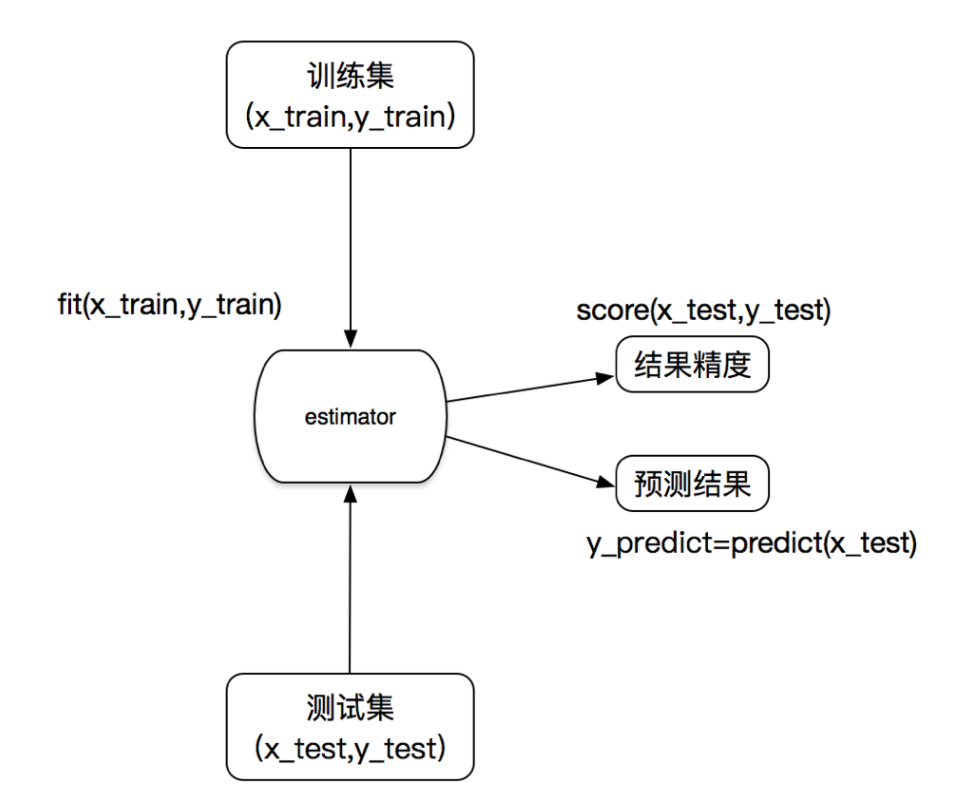

案例一:

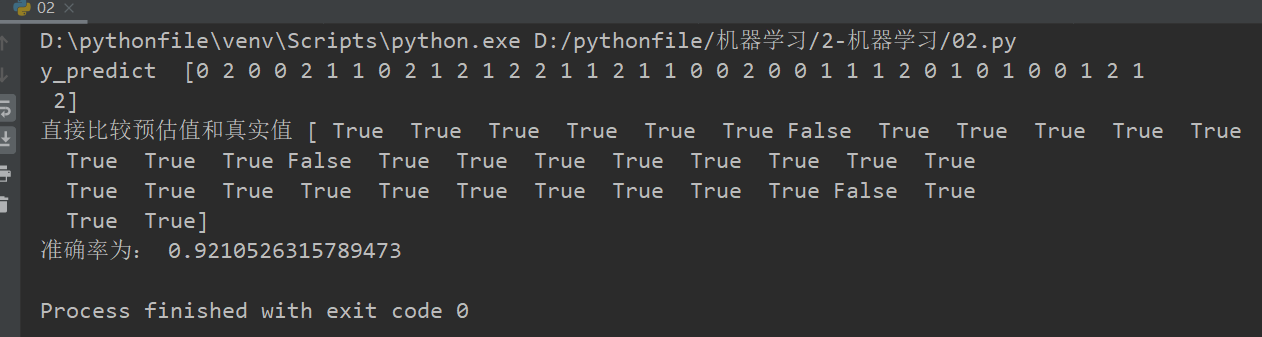

用knn对鸢尾花数据集进行分类

# 用knn对鸢尾花数据集进行分类 def knn_iris(): #获取数据集 iris = load_iris() #进行数据及的划分 x_train,x_test,y_train,y_test=train_test_split(iris.data,iris.target,random_state=22) #test_size默认是0.25,random_state表示随机数种子(前两个参数是特征值和目标值) #进行标准化 transfer=StandardScaler() x_train=transfer.fit_transform(x_train) x_test=transfer.transform(x_test) #KNN算法 estimator=KNeighborsClassifier(n_neighbors=3) estimator.fit(x_train,y_train) #模型的被评估.计算值准确率 #方法一直接比较预估值和真实值 y_predit=estimator.predict(x_test) print("y_predict ",y_predit) print("直接比较预估值和真实值",y_test==y_predit) #方法二计算准确率 score=estimator.score(x_test,y_test) print("准确率为:",score) return None if __name__=="__main__": knn_iris()

大小不一样得到的结果不一样。

大小不一样得到的结果不一样。

模式选择与调优:

为什么需要交叉验证

交叉验证目的:为了让被评估的模型更加准确可信

什么是交叉验证(cross validation)

交叉验证:将拿到的训练数据,分为训练和验证集。以下图为例:将数据分成5份,其中一份作为验证集。然后经过5次(组)的测试,每次都更换不同的验证集。即得到5组模型的结果,取平均值作为最终结果。又称5折交叉验证。

分析

我们之前知道数据分为训练集和测试集,但是为了让从训练得到模型结果更加准确。做以下处理

- 训练集:训练集+验证集

- 测试集:测试集

问题:那么这个只是对于参数得出更好的结果,那么怎么选择或者调优参数呢?

超参数搜索-网格搜索(Grid Search)

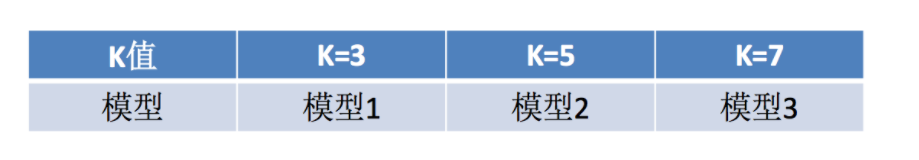

通常情况下,有很多参数是需要手动指定的(如k-近邻算法中的K值),这种叫超参数。但是手动过程繁杂,所以需要对模型预设几种超参数组合。每组超参数都采用交叉验证来进行评估。最后选出最优参数组合建立模型。

模型选择与调优

sklearn.model_selection.GridSearchCV(estimator, param_grid=None,cv=None) 对估计器的指定参数值进行详尽搜索 estimator:估计器对象 param_grid:估计器参数(dict){“n_neighbors”:[1,3,5]} cv:指定几折交叉验证 fit:输入训练数据 score:准确率 结果分析: bestscore:在交叉验证中验证的最好结果_ bestestimator:最好的参数模型 cvresults:每次交叉验证后的验证集准确率结果和训练集准确率结果

案例:鸢尾花案例增加K值调优

# 用knn对鸢尾花数据集进行分类-添加网格搜索和交叉验证 def knn_iris_gscv(): #获取数据集 iris = load_iris() #进行数据及的划分 x_train,x_test,y_train,y_test=train_test_split(iris.data,iris.target,random_state=22) #test_size默认是0.25,random_state表示随机数种子(前两个参数是特征值和目标值) #进行标准化 transfer=StandardScaler() x_train=transfer.fit_transform(x_train) x_test=transfer.transform(x_test) #KNN算法 estimator=KNeighborsClassifier() #加入网格搜索和交叉验证 #参数准备 param_dict={"n_neighbors":[1,3,5,7,9,11]} estimator=GridSearchCV(estimator,param_grid=param_dict,cv=10) estimator.fit(x_train,y_train) #模型的被评估.计算值准确率 #方法一直接比较预估值和真实值 y_predit=estimator.predict(x_test) print("y_predict ",y_predit) print("直接比较预估值和真实值",y_test==y_predit) #方法二计算准确率 score=estimator.score(x_test,y_test) print("准确率为:",score) #最佳参数 print("最佳参数:", estimator.best_params_) #最佳结果 print("最佳结果:", estimator.best_score_) #最佳估计器 print("最佳估计器:", estimator.best_estimator_) #交叉验证结果 print("交叉验证结果:", estimator.cv_results_) return None if __name__=="__main__": knn_iris_gscv()