# MNIST数据集 手写数字 import tensorflow as tf from tensorflow.examples.tutorials.mnist import input_data # 参数概要 def variable_summaries(var): with tf.name_scope('summaries'): mean=tf.reduce_mean(var) tf.summary.scalar('mean',mean)# 平均值 with tf.name_scope('stddev'): stddev=tf.sqrt(tf.reduce_mean(tf.square(var-mean))) tf.summary.scalar('stddev',stddev)# 标准差 tf.summary.scalar('max',tf.reduce_max(var)) # 最大值 tf.summary.scalar('min',tf.reduce_min(var)) # 最小值 tf.summary.histogram('histogram',var) # 直方图 # 载入数据集 mnist=input_data.read_data_sets('MNIST_data',one_hot=True) # 每个批次的大小 batch_size=100 # 计算一共有多少个批次 n_batch=mnist.train.num_examples//batch_size # 命名空间 with tf.name_scope('input'): # 定义两个placeholder x=tf.placeholder(tf.float32,[None,784],name='x-input') y=tf.placeholder(tf.float32,[None,10],name='y-input') with tf.name_scope('layer'): # 创建一个简单的神经网络 with tf.name_scope('wights'): W=tf.Variable(tf.zeros([784,10]),name='W') variable_summaries(W) with tf.name_scope('biases'): b=tf.Variable(tf.zeros([10]),name='b') variable_summaries(b) with tf.name_scope('wx_plus_b'): wx_plus_b=tf.matmul(x,W)+b with tf.name_scope('softmax'): prediction=tf.nn.softmax(wx_plus_b) with tf.name_scope('loss'): # 二次代价函数 loss=tf.reduce_mean(tf.square(y-prediction)) tf.summary.scalar('loss',loss) # 一个值就不用调用函数了 with tf.name_scope('train'): # 使用梯度下降法 train_step=tf.train.GradientDescentOptimizer(0.2).minimize(loss) # 初始化变量 init=tf.global_variables_initializer() with tf.name_scope('accuracy'): with tf.name_scope('correct_prediction'): # 求最大值在哪个位置,结果存放在一个布尔值列表中 correct_prediction=tf.equal(tf.argmax(y,1),tf.argmax(prediction,1))# argmax返回一维张量中最大值所在的位置 with tf.name_scope('accuracy'): # 求准确率 accuracy=tf.reduce_mean(tf.cast(correct_prediction,tf.float32)) # cast作用是将布尔值转换为浮点型。 tf.summary.scalar('accuracy',accuracy) # 一个值就不用调用函数了 # 合并所有的summary merged=tf.summary.merge_all() with tf.Session() as sess: sess.run(init) writer=tf.summary.FileWriter('logs/',sess.graph) # 写入文件 for epoch in range(10): for batch in range(n_batch): batch_xs,batch_ys=mnist.train.next_batch(batch_size) summary,_=sess.run([merged,train_step],feed_dict={x:batch_xs,y:batch_ys}) # 添加样本点 writer.add_summary(summary,epoch) #求准确率 acc=sess.run(accuracy,feed_dict={x:mnist.test.images,y:mnist.test.labels}) print('Iter:'+str(epoch)+',Testing Accuracy:'+str(acc))

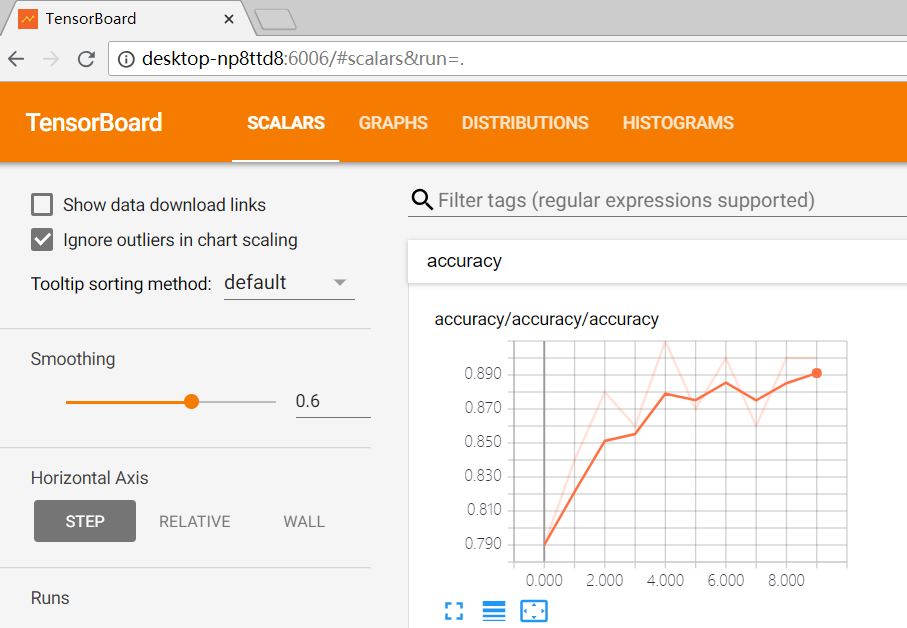

准确率

可以修改代码,增加训练时每个点的样本。