Handler处理器 和 自定义Opener

opener是 urllib.request.OpenerDirector 的实例,之前使用的urlopen,是一个特殊的opener(模块帮我们构建好的)。

但是基本的urlopen()方法不支持代理、cookie等其他的HTTP/HTTPS高级功能。所以要支持这些功能:

- 使用相关的 Handler处理器 来创建特定功能的处理器对象;

- 然后通过 urllib.request.build_opener()方法使用这些处理器对象,创建自定义opener对象;

- 使用自定义的opener对象,调用open()方法发送请求。

如果程序里所有的请求都使用自定义的opener,可以使用urllib.request.install_opener() 将自定义的 opener 对象 定义为 全局opener,表示如果之后凡是调用urlopen,都将使用这个opener(根据自己的需求来选择)

简单的自定义opener()

import urllib.request

# 构建一个HTTPHandler 处理器对象,支持处理HTTP请求

http_handler = urllib.request.HTTPHandler()

# 构建一个HTTPHandler 处理器对象,支持处理HTTPS请求

# http_handler = urllib.request.HTTPSHandler()

# 调用urllib的request下build_opener()方法,创建支持处理HTTP请求的opener对象

opener = urllib.request.build_opener(http_handler)

# 构建 Request请求

request = urllib.request.Request("http://www.baidu.com/")

# 调用自定义opener对象的open()方法,发送request请求

response = opener.open(request)

# 获取服务器响应内容

print response.read()

这种方式发送请求得到的结果,和使用urllib.request.urlopen()发送HTTP/HTTPS请求得到的结果是一样的。

如果在 HTTPHandler()增加 debuglevel=1参数,还会将 Debug Log 打开,这样程序在执行的时候,会把收包和发包的报头在屏幕上自动打印出来,方便调试,有时可以省去抓包的工作。

# 构建一个HTTPHSandler 处理器对象,支持处理HTTPS请求,同时开启Debug Log,debuglevel 值默认 0

http_handler = urllib2.HTTPSHandler(debuglevel=1)

ProxyHandler处理器(代理设置)

使用代理IP,这是爬虫/反爬虫的第二招,通常也是最好用的。

很多网站会检测某一段时间某个IP的访问次数(通过流量统计,系统日志等),如果访问次数多的不像正常人,它会禁止这个IP的访问。

所以我们可以设置一些代理服务器,每隔一段时间换一个代理,就算IP被禁止,依然可以换个IP继续爬取。

urllib.request中通过ProxyHandler来设置使用代理服务器,下面代码说明如何使用自定义opener来使用代理:

import urllib.request

# 构建代理Handler,设置代理IP

httpproxy_handler = urllib.request.ProxyHandler({"http" : "124.88.67.81:80"})

# 通过 build_opener()方法使用这些代理Handler对象,创建自定义opener对象

opener = urllib.request.build_opener(httpproxy_handler)

request = urllib.request.Request("http://www.baidu.com/")

# 1. 只有使用opener.open()方法发送请求才使用自定义的代理,而urlopen()则不使用自定义代理。

response = opener.open(request)

# 2. 将opener应用到全局,之后所有的,不管是opener.open()还是urlopen() 发送请求,都将使用自定义代理。

# urllib.request.install_opener(opener)

# response = urlopen(request)

print(response.read())

免费的开放代理获取基本没有成本,我们可以在一些代理网站上收集这些免费代理,测试后如果可以用,就把它收集起来用在爬虫上面。

免费短期代理网站举例:

如果代理IP足够多,就可以像随机获取User-Agent一样,随机选择一个代理去访问网站。

import urllib.request

import random

proxy_list = [

{"http" : "124.88.67.81:80"},

{"http" : "124.88.67.81:80"},

{"http" : "124.88.67.81:80"},

{"http" : "124.88.67.81:80"},

{"http" : "124.88.67.81:80"}

]

# 随机选择一个代理

proxy = random.choice(proxy_list)

# 使用选择的代理构建代理处理器对象

httpproxy_handler = urllib.request.ProxyHandler(proxy)

opener = urllib.request.build_opener(httpproxy_handler)

request = urllib.request.Request("http://www.baidu.com/")

response = opener.open(request)

print response.read()

但是,这些免费开放代理一般会有很多人都在使用,而且代理有寿命短,速度慢,匿名度不高,HTTP/HTTPS支持不稳定等缺点。

所以,专业爬虫工程师或爬虫公司会使用高品质的私密代理,这些代理通常需要找专门的代理供应商购买,再通过用户名/密码授权使用。

密码管理

HTTPPasswordMgrWithDefaultRealm() 类将创建一个密码管理对象,用来保存HTTP请求相关的用户名和密码,主要应用两个场景:

- 验证代理授权的用户名和密码 (ProxyBasicAuthHandler())

- 验证Web客户端的的用户名和密码 (HTTPBasicAuthHandler())

ProxyBasicAuthHandler(代理授权验证)

如果我们使用私密代理,会报 HTTP 407 错误,表示代理没有通过身份验证:

urllib2.HTTPError: HTTP Error 407: Proxy Authentication Required

所以我们需要改写代码,通过:

- HTTPPasswordMgrWithDefaultRealm():来保存私密代理的用户密码

- ProxyBasicAuthHandler():来处理代理的身份验证。

import urllib

# 私密代理授权的账户

user = "my_user"

# 私密代理授权的密码

passwd = "123456"

# 私密代理 IP

proxyserver = "52.128.132.110:12345"

# 1. 构建一个密码管理对象,用来保存需要处理的用户名和密码

user_manager = urllib.request.HTTPPasswordMgrWithDefaultRealm()

# 2. 添加账户信息,第一个参数realm是与远程服务器相关的域信息,一般都是写None,后面三个参数分别是 代理服务器ip、用户名、密码

user_manager.add_password(None, proxyserver, user, passwd)

# 3. 构建一个代理基础用户名/密码验证的ProxyBasicAuthHandler处理器对象,参数是创建的密码管理对象

# 注意,这里不再使用普通ProxyHandler类了

proxyauth_handler = urllib.request.ProxyBasicAuthHandler(user_manager)

# 4. 通过 build_opener()方法使用这些代理Handler对象,创建自定义opener对象,参数为构建的 proxyauth_handler

opener = urllib.request.build_opener(proxyauth_handler)

# 5. 构造Request 请求

request = urllib.request.Request("http://www.baidu.com/")

# 6. 使用自定义opener发送请求

response = opener.open(request)

# 7. 打印响应内容

print response.read()

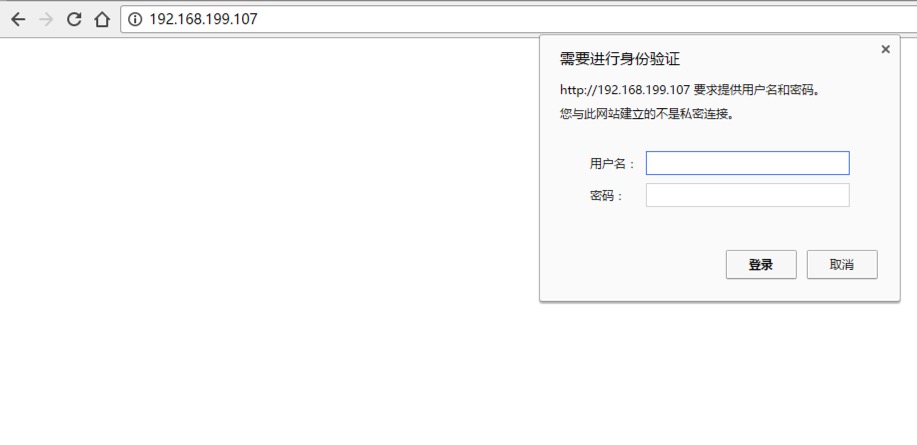

HTTPBasicAuthHandler处理器(Web客户端授权验证)

有些Web服务器(包括HTTP/FTP等)访问时,需要进行用户身份验证

爬虫直接访问会报HTTP 401 错误,表示访问身份未经授权:

urllib2.HTTPError: HTTP Error 401: Unauthorized

如果我们有客户端的用户名和密码,我们可以通过下面的方法去访问爬取:

import urllib

# 用户名

user = "shuai_long"

# 密码

passwd = "123456"

# Web服务器 IP

webserver = "http://192.168.199.107"

# 1. 构建一个密码管理对象,用来保存需要处理的用户名和密码

passwdmgr = urllib.request.HTTPPasswordMgrWithDefaultRealm()

# 2. 添加账户信息,第一个参数realm是与远程服务器相关的域信息,一般都是写None,后面三个参数分别是 Web服务器、用户名、密码

passwdmgr.add_password(None, webserver, user, passwd)

# 3. 构建一个HTTP基础用户名/密码验证的HTTPBasicAuthHandler处理器对象,参数是创建的密码管理对象

httpauth_handler = urllib.request.HTTPBasicAuthHandler(passwdmgr)

# 4. 通过 build_opener()方法使用这些代理Handler对象,创建自定义opener对象,参数包括构建的 proxy_handler

opener = urllib.request.build_opener(httpauth_handler)

# 5. 可以选择通过install_opener()方法定义opener为全局opener

urllib.request.install_opener(opener)

# 6. 构建 Request对象

request = urllib.request.Request("http://192.168.199.107")

# 7. 定义opener为全局opener后,可直接使用urlopen()发送请求

response = urllib.request.urlopen(request)

# 8. 打印响应内容

print response.read()