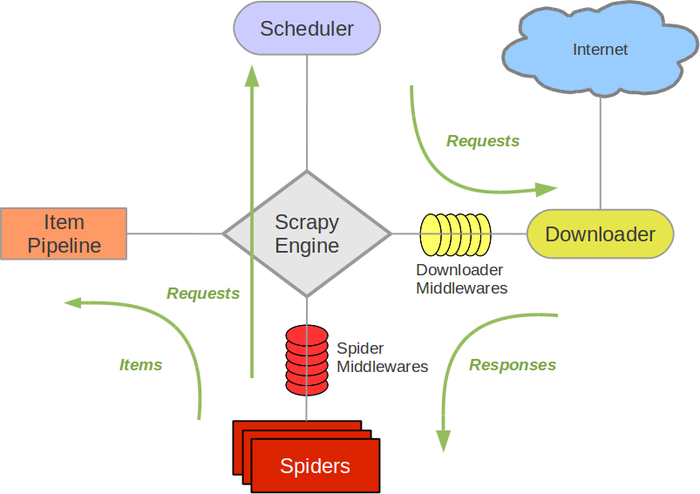

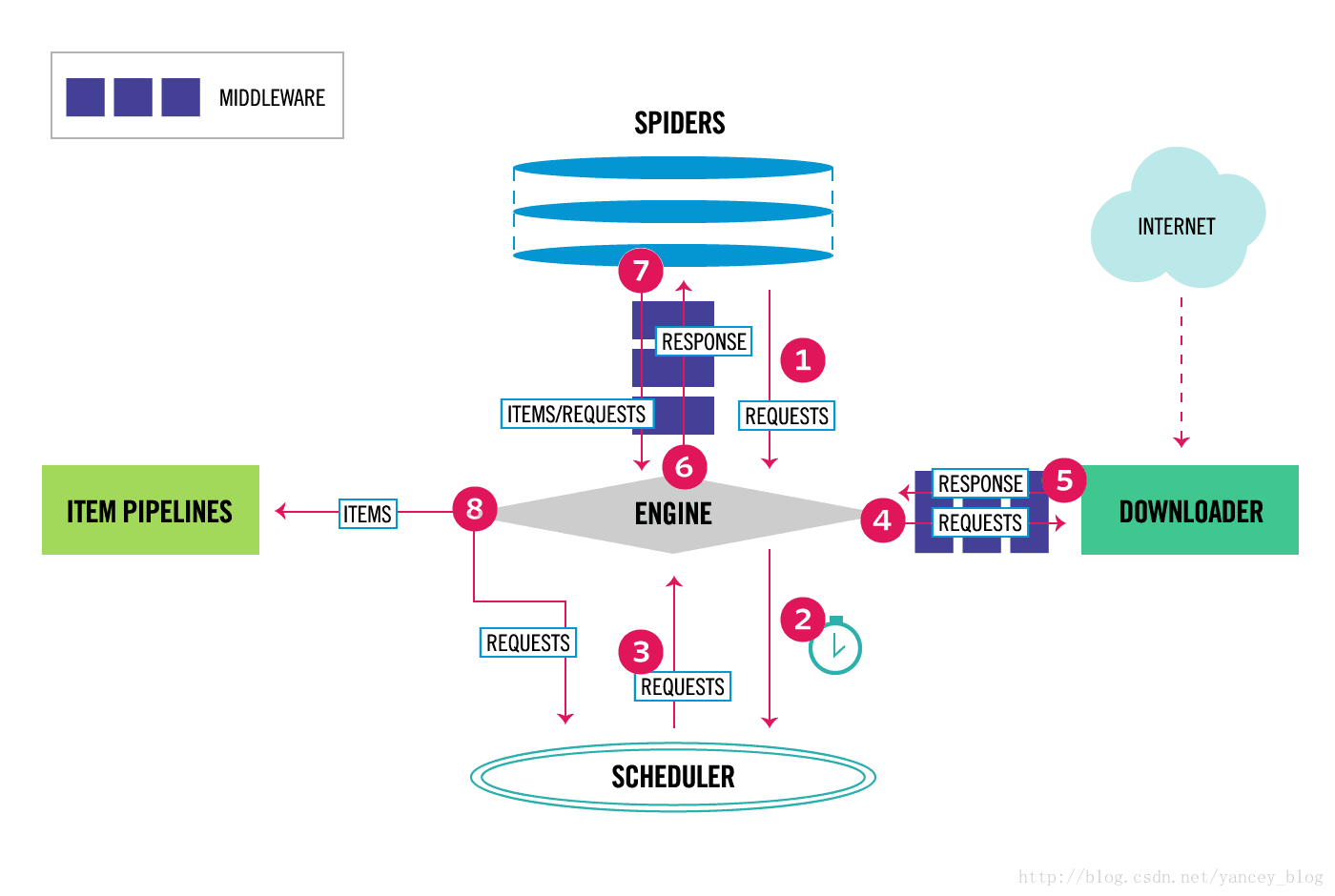

五大核心组件

- 引擎(Scrapy) 用来处理整个系统的数据流处理, 触发事务(框架核心) - 调度器(Scheduler) 用来接受引擎发过来的请求, 压入队列中, 并在引擎再次请求的时候返回. 可以想像成一个URL(抓取网页的网址或者说是链接)的优先队列, 由它来决定下一个要抓取的网址是什么, 同时去除重复的网址 - 下载器(Downloader) 用于下载网页内容, 并将网页内容返回给蜘蛛(Scrapy下载器是建立在twisted这个高效的异步模型上的) - 爬虫(Spiders) 爬虫是主要干活的, 用于从特定的网页中提取自己需要的信息, 即所谓的实体(Item)。用户也可以从中提取出链接,让Scrapy继续抓取下一个页面 - 项目管道(Pipeline) 负责处理爬虫从网页中抽取的实体,主要的功能是持久化实体、验证实体的有效性、清除不需要的信息。当页面被爬虫解析后,将被发送到项目管道,并经过几个特定的次序处理数据。

scrapy工作原理

旧版

新版

如何提升scrapy爬取数据的效率

增加并发: 默认scrapy开启的并发线程为32个,可以适当进行增加。在settings配置文件中修改CONCURRENT_REQUESTS = 100值为100,并发设置成了为100。 降低日志级别: 在运行scrapy时,会有大量日志信息的输出,为了减少CPU的使用率。可以设置log输出信息为INFO或者ERROR即可。在配置文件中编写:LOG_LEVEL = ‘INFO’ 禁止cookie: 如果不是真的需要cookie,则在scrapy爬取数据时可以禁止cookie从而减少CPU的使用率,提升爬取效率。在配置文件中编写:COOKIES_ENABLED = False 禁止重试: 对失败的HTTP进行重新请求(重试)会减慢爬取速度,因此可以禁止重试。在配置文件中编写:RETRY_ENABLED = False 减少下载超时: 如果对一个非常慢的链接进行爬取,减少下载超时可以能让卡住的链接快速被放弃,从而提升效率。在配置文件中进行编写:DOWNLOAD_TIMEOUT = 10 超时时间为10s

全站抓取数据

# get请求 yield scrapy.Request(url,callback) # post请求 yield scrapy.FormRequest(url,formdata,callback)

示例代码

get请求抓取所有页码数据

# -*- coding: utf-8 -*- import scrapy from quanzhanzhuaqu.items import QuanzhanzhuaquItem class QzzqSpider(scrapy.Spider): name = 'qzzq' # allowed_domains = ['www.xxx.com'] start_urls = ['https://www.zhipin.com/job_detail/?query=python&city=101010100&industry=&position='] # 通用url模板 url = "https://www.zhipin.com/c101010100/?query=python&page=%d" page = 1 def parse(self, response): print('正在爬取第{}页的数据'.format(self.page)) job_title = response.xpath('//div[@class="job-title"]/text()').extract() red = response.xpath('//span[@class="red"]/text()').extract() for i in range(len(job_title)): item = QuanzhanzhuaquItem() item["job_title"] = job_title[i] item["red"] = red[i] yield item # 爬取页码 if self.page<5: # 对其他页码进行手动请求 new_url = format(self.url%self.page) self.page+=1 # 手动请求 # callback进行数据解析 yield scrapy.Request(url=new_url,callback=self.parse)

深度抓取

scrapy.Request(url=detail_url,callback=self.parse_detail,meta={'item':item})

# 这里用到meta参数可以将item对象传给回调函数,使其parse和parse_detail共享一个item对象

# -*- coding: utf-8 -*- import scrapy from bossDeepPro.items import BossdeepproItem class BossSpider(scrapy.Spider): name = 'boss' # allowed_domains = ['www.xxx.com'] start_urls = ['https://www.zhipin.com/job_detail/?query=python%E5%BC%80%E5%8F%91&city=101010100&industry=&position='] # 通用的url模板(不可变) url = 'https://www.zhipin.com/c101010100/?query=python开发&page=%d' page = 2 def parse(self, response): print('正在爬取第{}页的数据'.format(self.page)) # 这里的xpath写了两种,因为每页的匹配规则不一样 li_list = response.xpath('//*[@id="main"]/div/div[3]/ul/li | //*[@id="main"]/div/div[2]/ul/li') for li in li_list: job_title = li.xpath('.//div[@class="info-primary"]/h3/a/div[1]/text()').extract_first() salary = li.xpath('.//div[@class="info-primary"]/h3/a/span/text()').extract_first() #实例化item对象:对象必须要让parse和parse_detail共享 item = BossdeepproItem() item['job_title'] = job_title item['salary'] = salary detail_url = 'https://www.zhipin.com'+li.xpath('.//div[@class="info-primary"]/h3/a/@href').extract_first() #对详情页的url发起手动请求,并将item对象传给回调函数 yield scrapy.Request(url=detail_url,callback=self.parse_detail,meta={'item':item}) if self.page <= 5: # 对其他页码进行手动请求的发送 new_url = format(self.url % self.page) print(new_url) self.page += 1 # 手动请求发送 # callback进行数据解析 yield scrapy.Request(url=new_url, callback=self.parse) #解析岗位描述 def parse_detail(self,response): item = response.meta['item'] job_desc = response.xpath('//*[@id="main"]/div[3]/div/div[2]/div[2]/div[1]/div//text()').extract() job_desc = ''.join(job_desc) item['job_desc'] = job_desc yield item