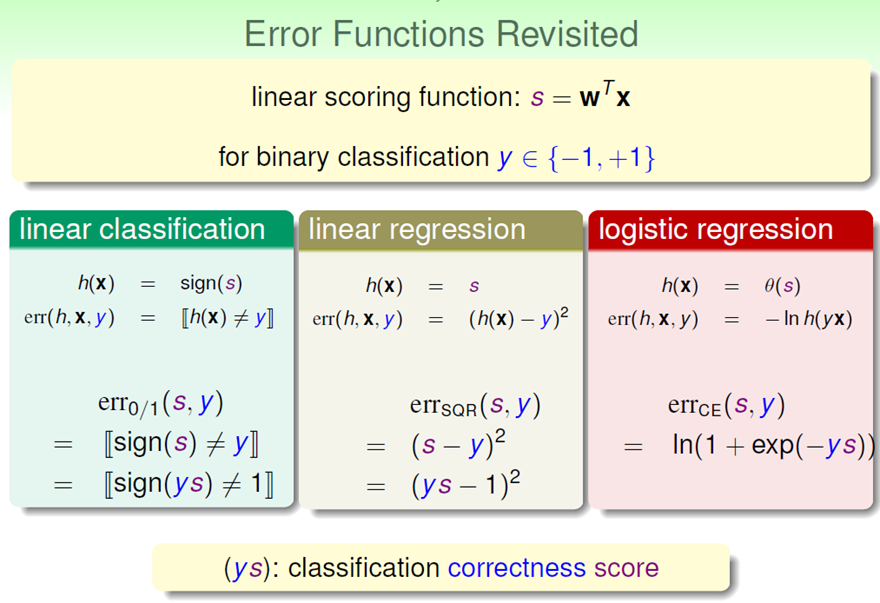

到现在,我们已经学过三种线性方法:linear classification、Linear Regression、logistic Regression。这三种方法的核心都是![]() ,不同点在于:最小化的error不同。linear classification的error是0/1 error;Linear Regression的error是squared error;logistic Regression的error是cross-entropy error。

,不同点在于:最小化的error不同。linear classification的error是0/1 error;Linear Regression的error是squared error;logistic Regression的error是cross-entropy error。

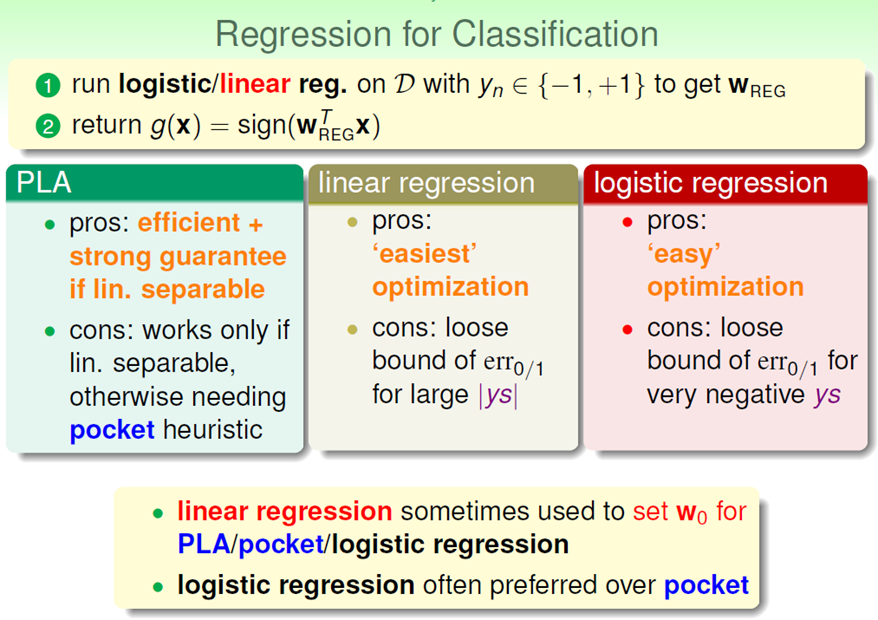

有没有可能使用Linear Regression和logistic Regression来进行分类呢?

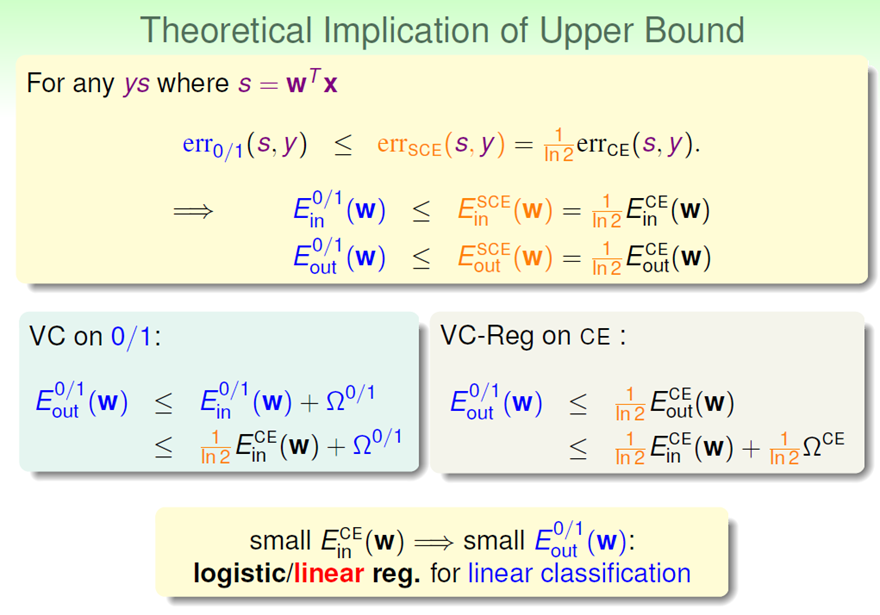

回想《关于Noise and Error主题的一些小知识》中关于err与err’的论述。我们最终的目的是最小化0/1 error,即:分错类的情况很少出现。而我们可以用squared error 或cross-entropy error去训练算法。

err=【0/1 error】

err’= 【squared error】 or 【cross-entropy error】

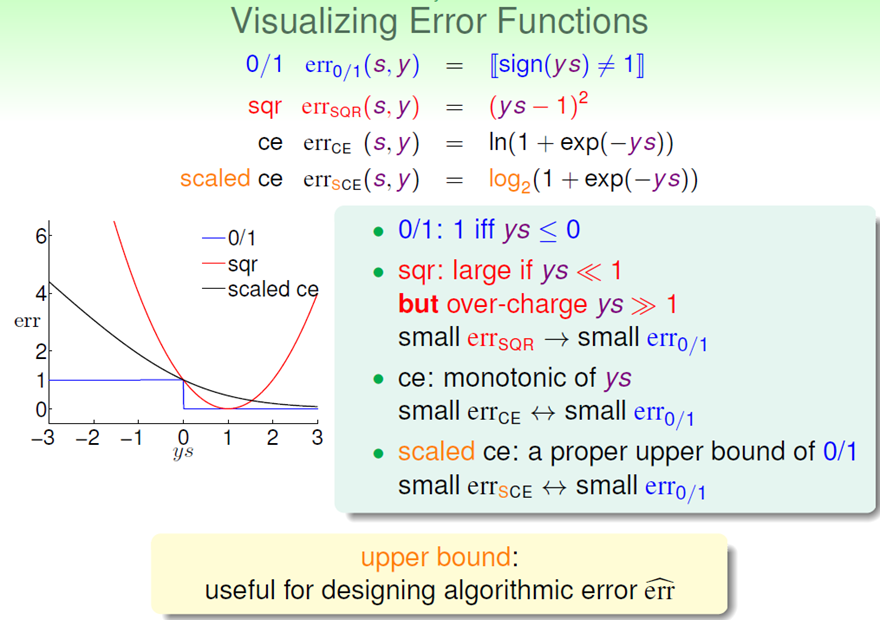

对于某一数据点,err与err’相差多少呢?

可以看出,err'均大于err,但是【cross-entropy error】要小于【squared error】

总结:

在实际中,我们使用logistic Regression进行binary classification的效果要好于pocket algorithm。