起源

数据的积累是一个从量变到质变的过程。当数据积累不够多时,没有人能读懂这些“碎片”背后的故事。可以认为,这一从量变到

质变的临界值是区分数据“大”与“不大”的标准。所以,大数据的“大”是相对的,是与所关注的问题相关的。只有这样理解,才能避

免产生大数据能解决所有问题的误读。

机器学习VS深度学习

1)面向过去(对收集到的历史数据,用作训练),发现潜藏在数据之下的模式,我们称之为描述性分析(Descriptive Analysis);

2)面向未来,基于已经构建的模型,对于新输入数据对象实施预测,我们称之为预测性分析(Predictive Analysis);

综上,寻找一个聪明的"专家"===> 自己 OR 机器 ?

深度学习概述

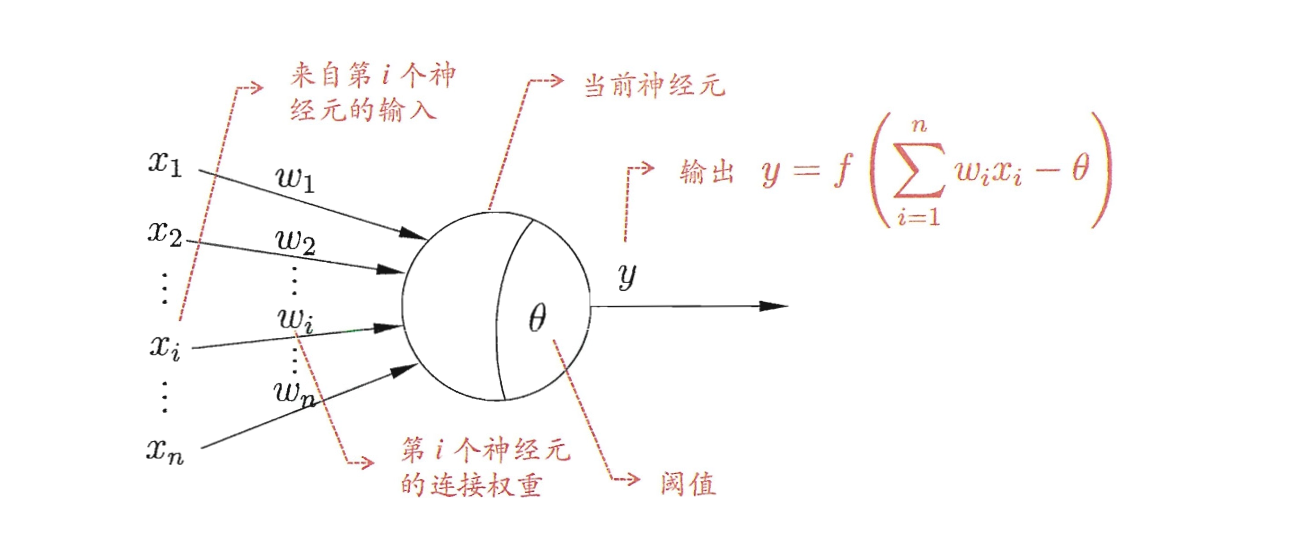

房价预测的例子,已知房屋的大小、卧室数量、家房子的周边、教育资源、交通方不方便等,这都是影响房价的因素,让神

经网络自己学习如何抓取数据的特征,它们存在于机器空间,对人而言,这就是一个黑盒世界,为了让神经网络的学习性能,

表现得更好一些,带来的是人们断地尝试性地进行大量重复的调参。

应用

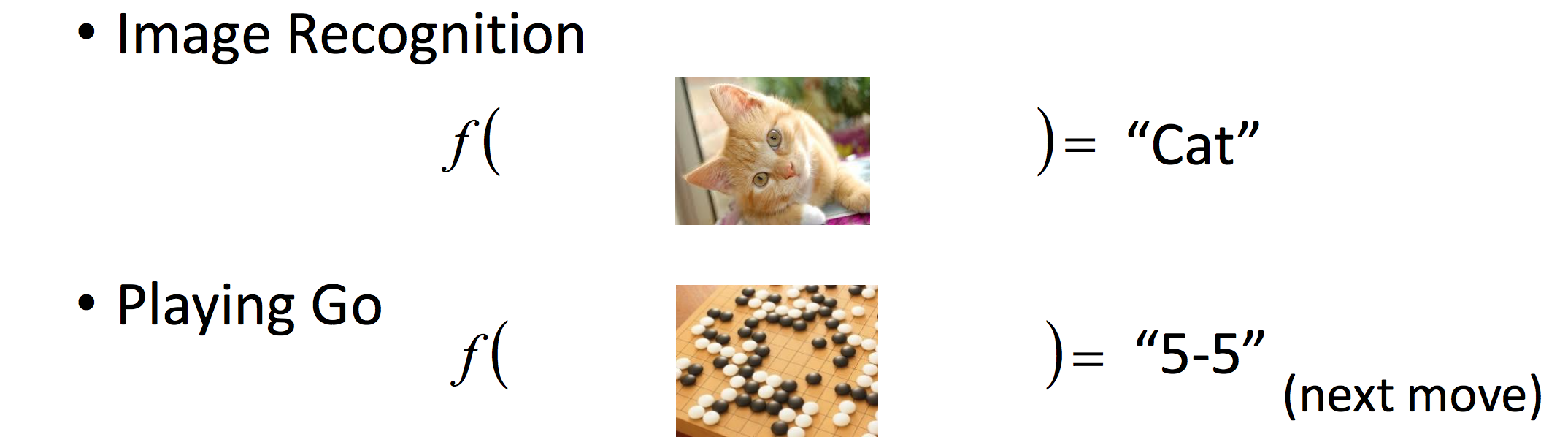

- 疾病判断:病人到医院去做了一大堆肝功、尿检测验,把测验结果送进一个机器里,机器需要判断这个病人是否得病,得的什么病。

- 图像识别:有一大堆猫、狗照片,把每一张照片送进一个机器里,机器需要判断这幅照片里的东西是猫还是狗。

实例1

以王小二卖猪为例,x变量是时间(年),卖出去的猪,不光跟时间有关啊,随着业务的增长,王小二不仅扩大了养猪场,还雇了很多员工一起养猪。

所以方程式又变了:y=f(x)=w1x₁+w2x₂ + w3x₃ +b 这里x₂代表面积,x₃代表员工数,当然x₁还是时间。

实例2

1.初恋期。相当于深度学习的输入层。别人吸引你,肯定是有很多因素,比如:身高,身材,颜值,学历,性格等等,这些都是输入层的参数,对每个人来说权重可能都不一样。

2.热恋期。我们就让它对应于隐层吧。这个期间,双方各种磨合,柴米油盐酱醋茶。

3.稳定期。对应于输出层,是否合适,就看磨合得咋样了。

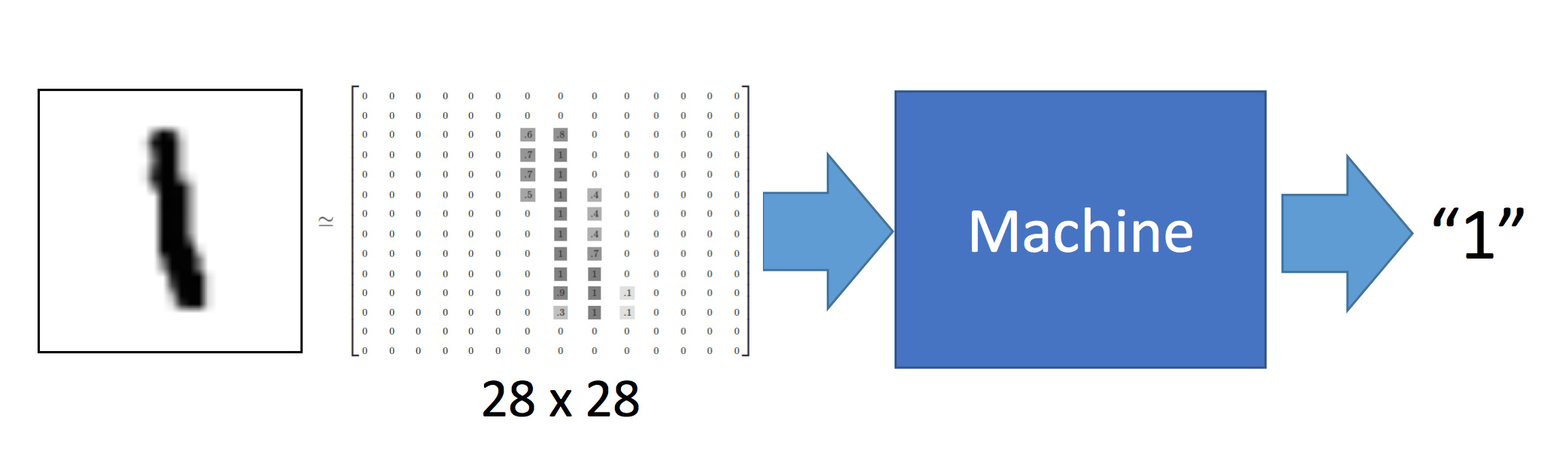

定义

深度学习是一种基于对数据进行表征学习的方法。观测值(例如一幅图像)可以使用多种方式来表示,如每个像素强度值的向量,或者更抽象地表示成一系列边、特定形状的区域等。而使用某些特定的表示方法更容易从实例中学习任务(例如,人脸识别或面部表情识别)。深度学习的好处是用非监督式或半监督式的特征学习和分层特征提取高效算法来替代手工获取特征。深度学习即为多层神经网络,从某种意义上来说,深度学习更像一个黑箱操作。

神经网络在发展过程中,经历了3次起伏,这很重要的原因在于神经网络的优缺点在不同时代得以体现。在理论上讲,只包含单层隐藏层神经网络,可以拟合任何函数,然后这在实际情况中是不常用的。往往采用含多层隐藏层的神经网络来对数据进行拟合。

三个重要的概念

- 激活函数

神经网络中激活函数的主要作用是提供网络的非线性建模能,根据实际的业务需求将回归方程与函数结合使用

- 损失函数

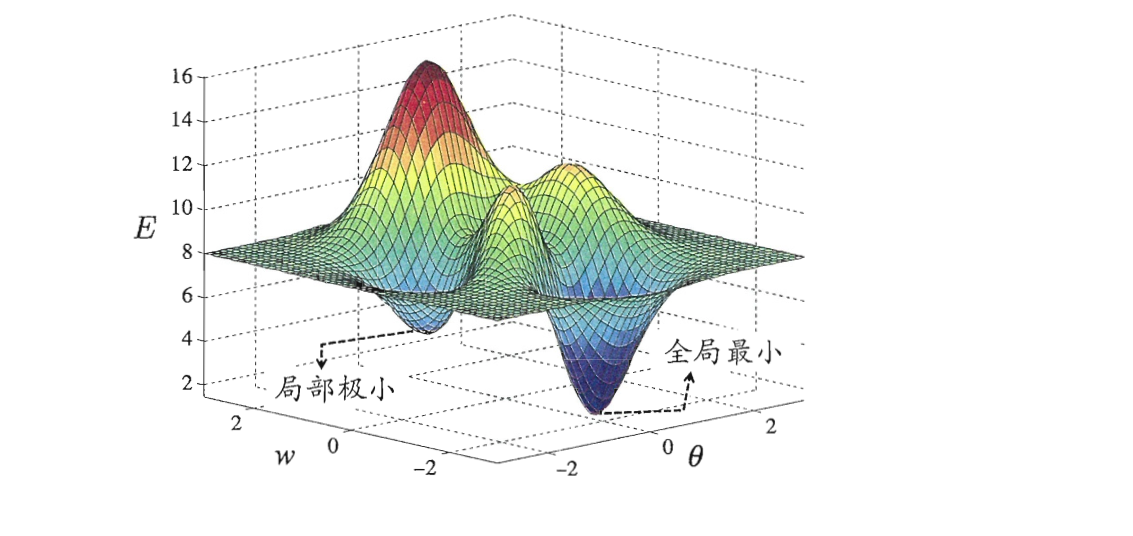

训练集中训练算法的参数(w,b)——最小平方误差准则,损失函数的目的是求得使神经网络预测结果最逼近真实情况的函数的参数值w集和b

- 梯度下降

通过偏导数求得损失函数的最小值

ps:憋了1天就别出来个这,感觉很失败,接下来大家应该也能感觉到了,我会重点介绍下三个重要的概念,会用实例一步步入门,欢迎收看。