很多概率结论或概率问题结果是符合直觉的。

"概率论只不过是把常识用数学公式表达了出来"——拉普拉斯

随机事件间的关系:

互斥(互不相容)、对立:两事件样本点集合间的关系

相互独立、线性相关:事件间的依赖关系

https://www.cnblogs.com/LittleHann/p/7199242.html 概率定义、条件概率、全概率、贝叶斯公式

随机试验(E):对不确定的现象(随机现象)中客观事物进行观察的过程。如抛掷一次色子。

样本空间(Ω):Ω={ ω1, ω2, ... },即随机试验的一切可能结果组成的集合。每个元素为样本点。如抛掷一次色子时出现的点数的样本空间Ω={ 1,2,3,4,5,6 }。

随机事件(A、B...):随机试验的某种观测结果,它是样本空间中的部分样本点组成的集合,是样本空间的子集。如对于随机试验抛一次色子,A={出现的点为奇数}={1, 3, 5}是个随机事件。

典型的随机事件——等可能模型:

古典概型(样本空间为离散有限集、各基本随机事件发生的可能性一样)

几何概型(样本空间是区域如一维二维三维等、各样本点等可能出现)

随机事件间的:

关系:包含、相等、互斥(或称互不相容)。如⊆、=

运算:并、交、差、逆(或称补、对立)等,如∪、∩、-、~。注:A的逆事件表示为~A=Ac=Ω-A,也可表示为A上面加上划线;P(AB)指的是P(A∩B)

运算定律(交换律、结合律、分配律、对偶律)

随机变量:Ω -> R,即样本空间到实数的映射。随机事件通常用随机变量来表示,如抛掷一次色子时出现的点数X为一个随机变量。

概率:概率的公理化定义(柯尔莫哥洛夫定律,1933,苏联):设随机试验E的样本空间为Ω,若对任一随机事件A都有唯一实数P(A)与之对应,且P(A)满足非负(即0≤P(A)≤1)、规范(即P(Ω)=1)、可列可加性(即对两两互不相容事件Ai有P(∪Ai)=ΣP(Ai)),则P(A)为随机事件A的概率。

条件概率:

定义:P(A|B)=P(AB)/P(B),其中P(B)>0,条件概率P(A|B)也符合上述公理化定义的三个性质。

推论(概率乘法公式):P(AB)=P(A)P(B|A)=P(B)P(A|B);P(ABC)=P(A)P(BC|A)=P(A)P(B|A)P(C|AB),依次类推

事件互相独立(事件间没有关系)的定义:P(A|B)=P(A)或P(B|A)=P(B),即P(AB)=P(A)P(B)。注:多个事件两两相互独立并不意味着这些事件互相独立(见链接中的示例)

注:P(A)+P(~A)=1、P(A∩B)+P(A∩~B)=P(A),但P(A|B)+P(A|~B)与P(A)不恒等于P(A)也不恒等于1,没有固定结果

先验概率、后验概率:

事件A的先验概率P(A):即事件A发生的概率。为不考虑结果或其他原因下据以往经验和分析对事件A发生可能性的猜测的数学表示,“先”体现在在事件A发生之前就断言了事件A发生的概率。

后验概率P(A|B):事件B已经发生了,发生的原因有多种,发生时由原因A引起的概率。

全概率:P(B)=ΣP(AiB)=ΣP(Ai)P(B|Ai),i=1,2,...,n,其中Ai互不相容且ΣAi=Ω(称{ Ai }为Ω的一个完备事件组)。

理解:事件结果B有两两无交集的子原因{ Ai },结果B发生的概率由这些子原因累计得到,这是从原因推结果的计算问题,是计算先验概率的问题。

贝叶斯公式:P(Ak|B)=P(AkB)/P(B)=P(Ak)P(B|Ak)/ΣP(Ai)P(B|Ai),k, i=1,2,...,n,其中Ai互不相容且ΣAi=Ω(称{ Ai }为Ω的一个完备事件组)。

理解:事件结果B有两两无交集的子原因{ Ai },根据结果B可以反推任一导致该结果的子原因,其条件概率取决于子原因和结果的联合概率,这是从结果推原因的计算问题,是计算后验概率的问题。

更直觉的理解:已知结果B发生的情况下求由原因Ak导致的概率=原因Ak导致结果B的概率/各原因导致结果B的概率的和,或已知检测呈阳性,则患病的概率=真阳性概率/(真阳性概率+假阳性概率)。后者的一个很好的例子:https://zhuanlan.zhihu.com/p/22467549

应用:贝叶斯分类器。原理:后验概率最大化(即期望风险最小化),故也称为最大后验概率估计;生成式模型。示例请参阅前面的链接。

贝叶斯最优分类器(据样本学习分类器从而用于判断样本点所属分类:结果推原因。问题:先验概率维度灾难)

朴素贝叶斯法(加了个样本点各维独立同分布的前提假设以便于计算先验概率,如垃圾邮件分类应用中假设各单词出现相互独立)

加入平滑因子的朴素贝叶斯法(先验概率可能为0从而导致后验概率为0的问题)

注:

现代统计学两大分支:经典统计学派(知原因推结果)、贝叶斯学派(知结果推原因)。

从数学公式上来讲,贝叶斯公式是全概率公式的逆运算,全概率公式和贝叶斯公式实际上代表了同一个事物的正反两面,有因就有果,有果就有因。

https://www.cnblogs.com/LittleHann/p/11133457.html 再谈线性回归函数分析,从概率论与数理统计角度看线性回归参数估计

EX、DX、Cov(X, Y)、相关系数、分布:伯努利分布、泊松分布(亦称两点分布或0-1分布)、均匀分布、指数分布、正态分布、标准正态分布

随机变量 互相独立 是 不线性相关 的充分不必要条件

https://www.cnblogs.com/LittleHann/p/9569708.html 大数定律、中心极限定理

定律与定理:

伯努利大数定律(1713)(n足够大时,伯努利实验中事件发生频率依概率1收敛于事件期望。收敛意为小幅波动)

条件:特指伯努利实验(伯努利实验中各随机变量独立同分布,且均值、方差存在)

说明了频率具有稳定性

*辛钦大数定律(n足够大时,对于独立同分布的随机变量Xi,若Xi均值存在(方差可不存在),则样本均值趋向于总体均值/期望)

条件:各随机变量独立同分布、均值存在(方差可不存在)

为用样本均值来估计总体均值提供了理论依据

伯努利大数定律是此定律的一个特例

切比雪夫大数定律(当n足够大时,对于互不线性相关的随机变量Xi,若Xi均值和方差存在且方差一致有界,这些随机变量的均值 趋向于 各随机变量的期望的均值)

条件:随机变量两两不线性相关(不要求独立同分布,故条件更弱)、EXi存在、DXi存在且DXi≤c

辛钦大数定律是此定律的一个特例

棣莫弗-拉普拉斯中心极限定理,也称二项分布的正态近似(1733)(n足够大时,伯努利实验中事件发生次数近似于正态分布)

条件:特指伯努利实验(伯努利实验中各随机变量是独立同分布的,且均值、方差存在)

此定理的作用在于很多时候没法直接计算二项分布的分布/概率,若n够大则此时可用正态分布近似计算。实际上,若p≤0.1,则二项分布也近似于泊松分布,即也可用泊松分布近似计算。

*列维-林德伯格中心极限定理(1920)(n足够大时,对于独立同分布的随机变量Xi,若Xi均值和方差存在,则ΣXi近似于正态分布)

条件:各随机变量独立同分布,且均值、方差存在

当n足够大时,对于任意独立同分布可用正态分布近似计算概率。

微观少量样本随机、宏观大数统计意义上的正态有序

棣莫弗-拉普拉斯中心极限定理是本定理的一个特例

总结:大数定律是说样本够多时,样本均值会收敛于总体均值(但样本均值的分布是怎样的不知道);中心极限定理是说样本够多时,样本均值趋近于正态分布(刚好弥补了大数定律不知分布的缺陷)

https://blog.csdn.net/randy_01/article/details/84498713 统计学笔记

期望、方差、概率密度函数、边缘概率密度函数、联合概率密度函数、分布函数、联合分布函数

https://blog.csdn.net/randy_01/article/details/84633530 统计学笔记 不等式

几个概率不等式:

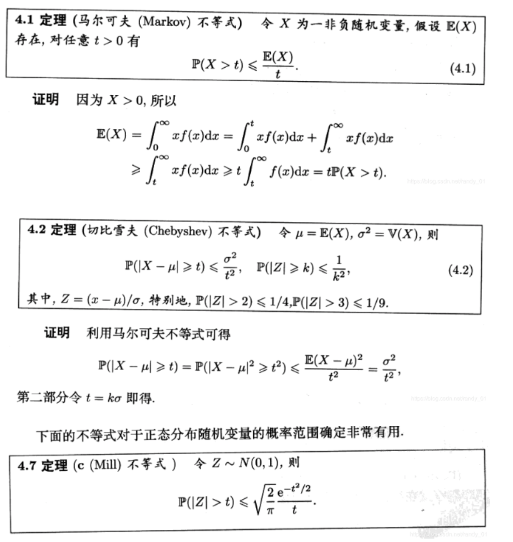

马尔可夫不等式

切比雪夫不等式:用于衡量随机变量与其期望的偏离程度的上限,上限与方差成正比。也说明了方差是随机变量取值与其中心位置的偏离程度的一种衡量指标。

Mill不等式

几个期望不等式: