一、Flume监听端口

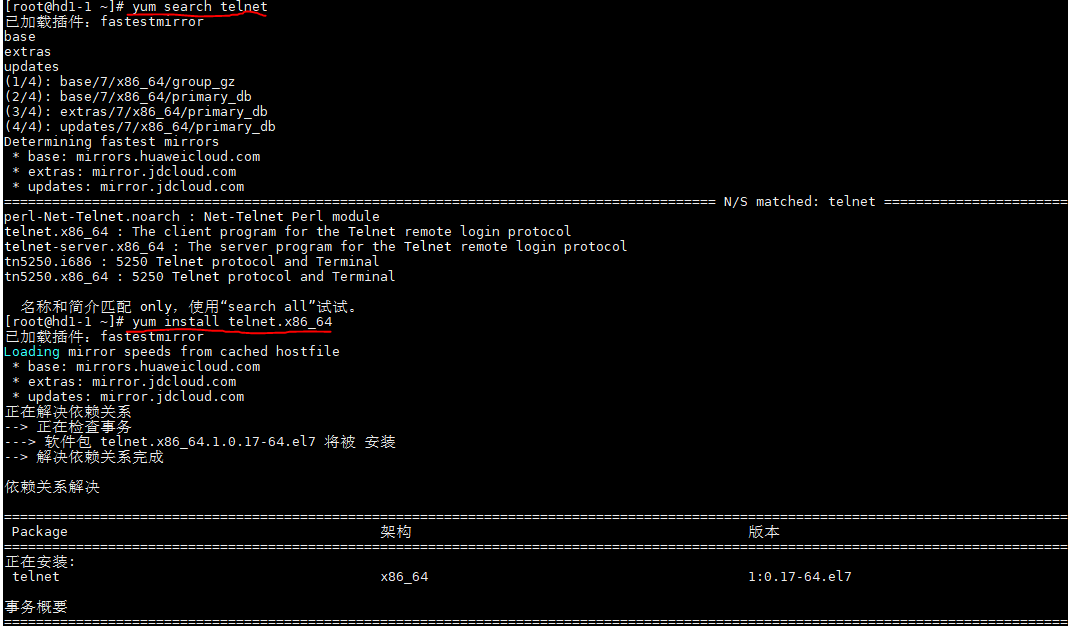

1,在linux机器上下载telnet工具

yum search telnet

yumm install telnet.x86_64

2.编写flume的配置文件,并将文件复制到flume/conf文件夹下

#1.agent a1.sources = r1 a1.sinks = k1 a1.channels = c1 #2.source netcat表示监视端口、localhost监视本机(也可以写本机名如hd1-1) #44444端口号(随便写,注意不要与常用的端口号重复即可) a1.sources.r1.type = netcat a1.sources.r1.bind = localhost a1.sources.r1.port = 44444 #3.sinks Describe the sink 输出日志文件 a1.sinks.k1.type = logger #4. 使用内存、总容量1000、每次传输100 a1.channels.c1.type = memory a1.channels.c1.capacity = 1000 a1.channels.c1.transactionCapacity = 100 #5.Bind the source and sink to the channel 一个source可以绑定多个channel # 一个sinks可以只能绑定一个channel 使用的是图二的模型 a1.sources.r1.channels = c1 a1.sinks.k1.channel = c1

3.启动配置文件

bin/flume-ng agent --conf conf/ --name a1 --conf-file conf/flumejob_telnet.conf -Dflume.root.logger==INFO,console

4.新建一个Linux本机,输入下面命令连接本机

telnet localhost 44444

5.发送数据查看

二、实施采集数据到hdfs(监控文件)

这里有一个无限产生数据的jar包,其产生的数据存放在/opt/jars/calllog.csv下

1.写配置文件 flumejob_hdfs.conf

# 1.agent a1.sources = r1 a1.sinks = k1 a1.channels = c1 # 2.sources # exec 执行一个命令的方式去查看文件 tail -F 实时查看 a1.sources.r1.type = exec # 要执行的脚本command tail -F 默认10行 man tail 查看帮助 a1.sources.r1.command = tail -F /opt/jars/calllog.csv # 执行这个command使用的是哪个脚本 -c 指定使用什么命令 # bash: /usr/bin/bash /usr/share/man/man1/bash.1.gz a1.sources.r1.shell = /usr/bin/bash -c # 3.sinks a1.sinks.k1.type = hdfs a1.sinks.k1.hdfs.path = hdfs://hd1-1:9000/flume/calllog #上传文件的前缀 a1.sinks.k1.hdfs.filePrefix = logs- #是否按照时间滚动文件夹 a1.sinks.k1.hdfs.round = true #多少时间单位创建一个新的文件夹 秒 (默认30s) a1.sinks.k1.hdfs.roundValue = 1 #重新定义时间单位(每小时滚动一个文件夹) a1.sinks.k1.hdfs.roundUnit = minute #是否使用本地时间戳 a1.sinks.k1.hdfs.useLocalTimeStamp = true #积攒多少个 Event 才 flush 到 HDFS 一次 a1.sinks.k1.hdfs.batchSize = 500 #设置文件类型,可支持压缩 a1.sinks.k1.hdfs.fileType = DataStream #多久生成一个新的文件 秒 a1.sinks.k1.hdfs.rollInterval = 30 #设置每个文件的滚动大小 字节(最好128M) a1.sinks.k1.hdfs.rollSize = 134217700 #文件的滚动与 Event 数量无关 a1.sinks.k1.hdfs.rollCount = 0 #最小冗余数(备份数 生成滚动功能则生效roll hadoop本身有此功能 无需配置) 1份 不冗余 a1.sinks.k1.hdfs.minBlockReplicas = 1 # Use a channel which buffers events in memory a1.channels.c1.type = memory a1.channels.c1.capacity = 1000 a1.channels.c1.transactionCapacity = 100 # Bind the source and sink to the channel a1.sources.r1.channels = c1 a1.sinks.k1.channel = c1

2.启动hdfs、yarn,并在hdfs上建立文件中的生成文件目录

hdfs dfs -mkdir -p /flume/calllog

3.启动命令

bin/flume-ng agent --conf conf/ --name a1 --conf-file conf/flumejob_hdfs.conf

4.启动jar包,然后查看hdfs上calllog文件夹下的变化

三、监控文件目录

1.写配置文件 flumejob_dir.conf

# 1.agent a1.sources = r1 a1.sinks = k1 a1.channels = c1 # 2.sources a1.sources.r1.type = spooldir # 监控的文件夹 a1.sources.r1.spoolDir = /root/spooldir # 上传成功后显示后缀名 a1.sources.r1.fileSuffix = .COMPLETED # 如论如何 加绝对路径的文件名 默认false a1.sources.r1.fileHeader = true #忽略所有以.tmp 结尾的文件(正在被写入),不上传 # ^以任何开头 出现无限次 以.tmp结尾的 a1.sources.r1.ignorePattern = ([^ ]*.tmp) # 3.sinks a1.sinks.k1.type = hdfs a1.sinks.k1.hdfs.path = hdfs://hd09-01:9000/flume/spooldir/%Y%m%d/%H #上传文件的前缀 a1.sinks.k1.hdfs.filePrefix = spooldir- #是否按照时间滚动文件夹 a1.sinks.k1.hdfs.round = true #多少时间单位创建一个新的文件夹 a1.sinks.k1.hdfs.roundValue = 1 #重新定义时间单位 a1.sinks.k1.hdfs.roundUnit = hour #是否使用本地时间戳 a1.sinks.k1.hdfs.useLocalTimeStamp = true #积攒多少个 Event 才 flush 到 HDFS 一次 a1.sinks.k1.hdfs.batchSize = 50 #设置文件类型,可支持压缩 a1.sinks.k1.hdfs.fileType = DataStream #多久生成一个新的文件 a1.sinks.k1.hdfs.rollInterval = 600 #设置每个文件的滚动大小大概是 128M a1.sinks.k1.hdfs.rollSize = 134217700 #文件的滚动与 Event 数量无关 a1.sinks.k1.hdfs.rollCount = 0 #最小副本数 a1.sinks.k1.hdfs.minBlockReplicas = 1 # 4.channels a1.channels.c1.type = memory a1.channels.c1.capacity = 1000 a1.channels.c1.transactionCapacity = 100 # 5.bink a1.sources.r1.channels = c1 a1.sinks.k1.channel = c1

2.启动hdfs、yarn,注意,不需要在hdfs上创建

3.启动命令

bin/flume-ng agent --conf conf --name a1 --conf-file conf/flumejob_dir.conf

4.将任意文件复制到spool文件目录中,在hdfs中可看到生成日志文件

四、Flume监听一个文件,然后使用两个channel,一个channle对应的sink存储到hdfs,另一个channel对应的sink存储到本地。

思路:这时应需要三个agent,

第一个agent用来监听文件并将数据源复制为两份发送到其他两个agent,

第二个agent将数据传输到hdfs存储,第三个agent将数据存储在本地。

1.编写三个conf文件(flumejob1.conf、flumejob2.conf、flumejob3.conf)

# name the components on this agent a1.sources = r1 a1.sinks = k1 k2 a1.channels = c1 c2 # 将数据流复制给多个 channel a1.sources.r1.selector.type = replicating # Describe/configure the source a1.sources.r1.type = exec a1.sources.r1.command = tail -F /tmp/root/hive.log a1.sources.r1.shell = /bin/bash -c # Describe the sink # 分两个端口发送数据 a1.sinks.k1.type = avro a1.sinks.k1.hostname = hd09-01 a1.sinks.k1.port = 4141 a1.sinks.k2.type = avro a1.sinks.k2.hostname = hd09-01 a1.sinks.k2.port = 4142 # Describe the channel a1.channels.c1.type = memory a1.channels.c1.capacity = 1000 a1.channels.c1.transactionCapacity = 100 a1.channels.c2.type = memory a1.channels.c2.capacity = 1000 a1.channels.c2.transactionCapacity = 100 # Bind the source and sink to the channel a1.sources.r1.channels = c1 c2 a1.sinks.k1.channel = c1 a1.sinks.k2.channel = c2

# Name the components on this agent a2.sources = r1 a2.sinks = k1 a2.channels = c1 # Describe/configure the source a2.sources.r1.type = avro # 端口抓取数据 a2.sources.r1.bind = hd09-01 a2.sources.r1.port = 4141 # Describe the sink a2.sinks.k1.type = hdfs a2.sinks.k1.hdfs.path = hdfs://hd09-01:9000/flume2/%Y%m%d/%H #上传文件的前缀 a2.sinks.k1.hdfs.filePrefix = flume2- #是否按照时间滚动文件夹 a2.sinks.k1.hdfs.round = true #多少时间单位创建一个新的文件夹 a2.sinks.k1.hdfs.roundValue = 1 #重新定义时间单位 a2.sinks.k1.hdfs.roundUnit = hour #是否使用本地时间戳 a2.sinks.k1.hdfs.useLocalTimeStamp = true #积攒多少个 Event 才 flush 到 HDFS 一次 a2.sinks.k1.hdfs.batchSize = 100 #设置文件类型,可支持压缩 a2.sinks.k1.hdfs.fileType = DataStream #多久生成一个新的文件 a2.sinks.k1.hdfs.rollInterval = 600 #设置每个文件的滚动大小大概是 128M a2.sinks.k1.hdfs.rollSize = 134217700 #文件的滚动与 Event 数量无关 a2.sinks.k1.hdfs.rollCount = 0 #最小副本数 # Describe the channel a2.channels.c1.type = memory a2.channels.c1.capacity = 1000 a2.channels.c1.transactionCapacity = 100 # Bind the source and sink to the channel a2.sources.r1.channels = c1 a2.sinks.k1.channel = c1

# Name the components on this agent a3.sources = r1 a3.sinks = k1 a3.channels = c1 # Describe/configure the source a3.sources.r1.type = avro a3.sources.r1.bind = hd09-01 a3.sources.r1.port = 4142 # Describe the sink a3.sinks.k1.type = file_roll a3.sinks.k1.sink.directory = /root/flume2 # Describe the channel a3.channels.c1.type = memory a3.channels.c1.capacity = 1000 a3.channels.c1.transactionCapacity = 100 # Bind the source and sink to the channel a3.sources.r1.channels = c1 a3.sinks.k1.channel = c1

2.在本地创建文件中本地存放的文件夹,本地不会自动创建,而hdfs会

mkdir /root/flume2

3.打开jar包测试。