1.Hive基本操作:

1.1.Hive的建表语句:

CREATE [EXTERNAL] TABLE [IF NOT EXISTS] table_name [(col_name data_type [COMMENT col_comment], ...)] [COMMENT table_comment] [PARTITIONED BY (col_name data_type [COMMENT col_comment], ...)] [CLUSTERED BY (col_name, col_name, ...) [SORTED BY (col_name [ASC|DESC], ...)] INTO num_buckets BUCKETS] [ROW FORMAT row_format] [STORED AS file_format] [LOCATION hdfs_path]

参数说明:

CREATE TABLE:创建一个指定名字的表。如果相同名字的表已经存在,则抛出异常;用户可以用 IF NOT EXISTS

选项来忽略这个异常

EXTERNAL:关键字可以让用户创建一个外部表,在建表的同时指定一个指向实际数据的路径(LOCATION),Hive

创建内部表时,会将数据移动到数据仓库指向的路径;若创建外部表,仅记录数据所在的路径,不对数据的位置做任何

改变。在删除表的时候,内部表的元数据和数据会被一起删除,而外部表只删除元数据,不删除数据

LIKE:允许用户复制现有的表结构,但是不复制数据

ROW FORMAT:用户在建表的时候可以自定义 SerDe 或者使用自带的 SerDe。如果没有指定 ROW FORMAT 或者 ROW

FORMAT DELIMITED,将会使用自带的 SerDe。在建表的时候,用户还需要为表指定列,用户在指定表的列的同时也会指

定自定义的 SerDe,Hive通过 SerDe 确定表的具体的列的数据

DELIMITED [FIELDS TERMINATED BY char] [COLLECTION ITEMS TERMINATED BY char] [MAP KEYS TERMINATED BY char] [LINES TERMINATED BY char] | SERDE serde_name [WITH SERDEPROPERTIES (property_name=property_value, property_name=property_value, ...)]

STORED AS:SEQUENCEFILE|TEXTFILE|RCFILE,如果文件数据是纯文本,可以使用 STORED AS TEXTFILE。如果数据

需要压缩,使用 STORED AS SEQUENCEFILE

CLUSTERED BY:对于每一个表(table)或者分区, Hive可以进一步组织成桶,也就是说桶是更为细粒度的数据范围

划分。Hive也是针对某一列进行桶的组织。Hive采用对列值哈希,然后除以桶的个数求余的方式决定该条记录存放在哪个

桶当中。

把表(或者分区)组织成桶(Bucket)有两个理由:

(1)获得更高的查询处理效率。桶为表加上了额外的结构,Hive在处理有些查询时能利用这个结构。具体而言,连接

两个在(包含连接列的)相同列上划分了桶的表,可以使用 Map端连接(Map-side join)高效的实现,比如JOIN操作。对

于JOIN操作两个表有一个相同的列,如果对这两个表都进行了桶操作。那么将保存相同列值的桶进行JOIN操作就可以,可以

大大较少JOIN的数据量

(2)使取样(sampling)更高效。在处理大规模数据集时,在开发和修改查询的阶段,如果能在数据集的一小部分数

据上试运行查询,会带来很多方便

1.2.具体实例:

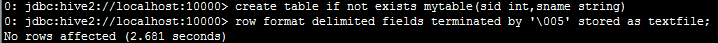

1、创建内部表mytable:

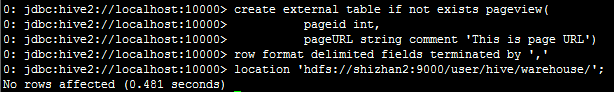

2、创建外部表pageview:

3.可以使用下面的命令来查看表的详细信息:

show tables

show databases

show partitions

show functions

desc extended t_name;

desc formatted table_name;

2.2.Hive中上传数据:

之前我们直接将数据文件上传到了Hive表所在的数据目录,其实Hive还提供了一个Load命令供我们将数据进行上传

语法结构:Load

LOAD DATA [LOCAL] INPATH 'filepath' [OVERWRITE] INTO

TABLE tablename [PARTITION (partcol1=val1, partcol2=val2 ...)]

参数说明:

- Load 操作只是单纯的复制/移动操作,将数据文件移动到 Hive 表对应的位置。

- filepath:

相对路径,例如:project/data1

绝对路径,例如:/user/hive/project/data1

包含模式的完整 URI,列如:hdfs://namenode:9000/user/hive/project/data1 - LOCAL关键字

如果指定了 LOCAL, load 命令会去查找本地文件系统中的 filepath。

如果没有指定 LOCAL关键字,则根据inpath中的uri查找文件 - OVERWRITE 关键字

若使用了 OVERWRITE 关键字,则目标表(或者分区)中的内容会被删除,然后再将 filepath 指向的文件/目录中的内容添加到表/分区中

如果目标表(分区)已经有一个文件,并且文件名和 filepath 中的文件名冲突,那么现有的文件会被新文件所替代。

2.2.Hive分区表:

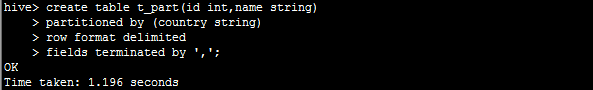

使用下面的命令来创建一个带分区的表

partitioned by里面不能加create table时存在的字段。此时只能说指定了这个表会分区,但是具体数据有哪些分区则会在导入数据时产生

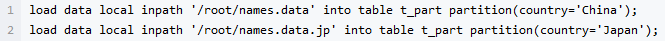

使用下面的命令来指定具体导入到哪个分区:

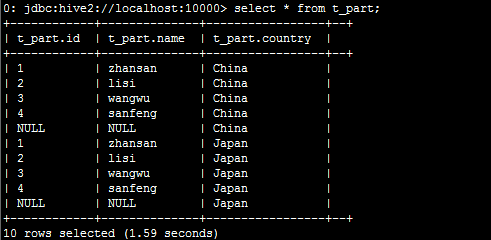

查询该分区表:select * from t_part;

此时分区字段已经变成一个伪字段了。如果要分区查询,可以使用Where或者Group by来进行限定;

2.3.Hive修改表_增加/删除分区:

语法结构 ALTER TABLE table_name ADD [IF NOT EXISTS] partition_spec [ LOCATION 'location1' ]

partition_spec [ LOCATION 'location2' ] ... partition_spec: : PARTITION (partition_col = partition_col_value, partition_col = partiton_col_value, ...) ALTER TABLE table_name DROP partition_spec, partition_spec,...

增加分区:alter table t_part add partition (country='American');

删除分区:alter table t_part drop partition (country='American');

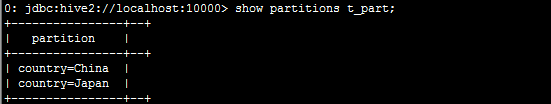

查看分区:show partitions t_part;