1、常见的降维的方法有:主成分分析,线性判别分析,等距映射,局部线性插入,拉不拉斯特征映射,局部保留投影。

一、PCA:

2、:主成分分析法,最经典的降维的方法,是一种线性,非监督,全局的降维方法。

最大方差理论:

3、PCA旨在找到数据中的主成分,用这些主成分表征原始数据,达到降维的目的。信号具有较大的方差,噪声具有较小的方差,信噪比越大意味着数据的质量越好,信噪比越小图像质量越差,PCA的目标为最大化投影方差。

PCA的求解的方法:

(1)、对样本进行中心化处理

(2)、求样本的协方差矩阵

(3)、对协方差矩阵进行特征值分解,将特征值从大到小排列

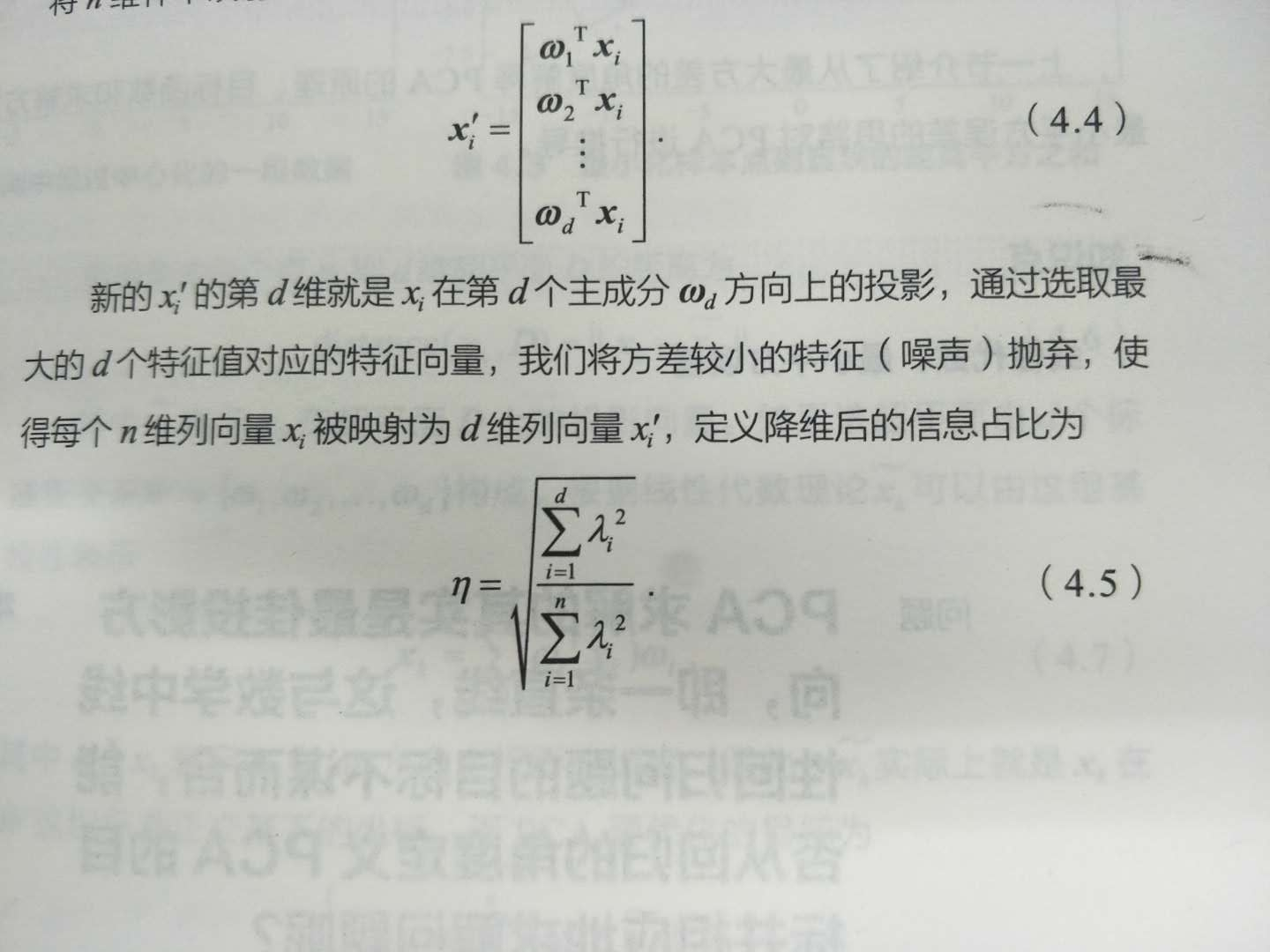

(4)、取特征值前d大对应的特征向量,w1,w2....wd,通过以下映射将n维样本映射到d维。

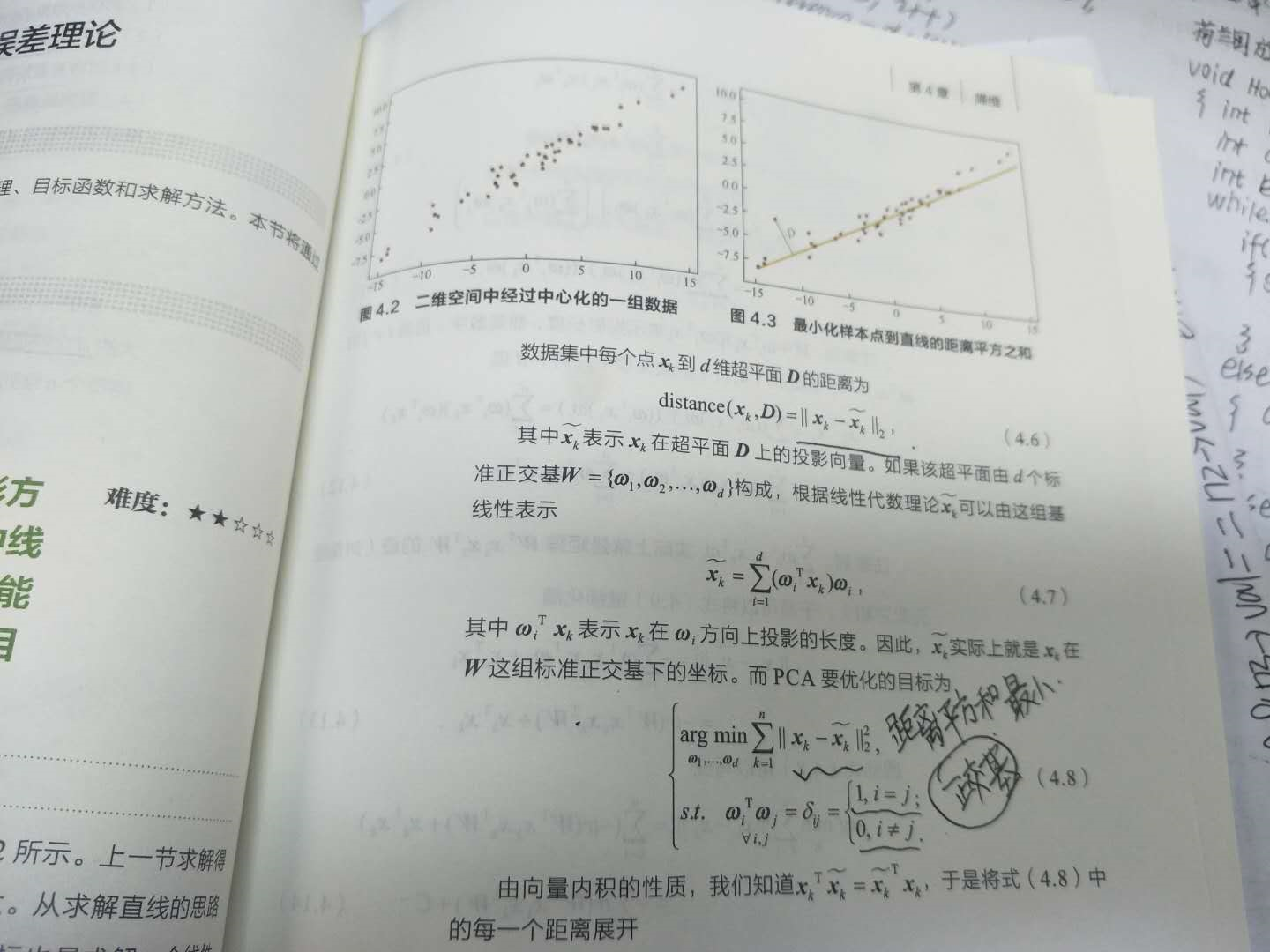

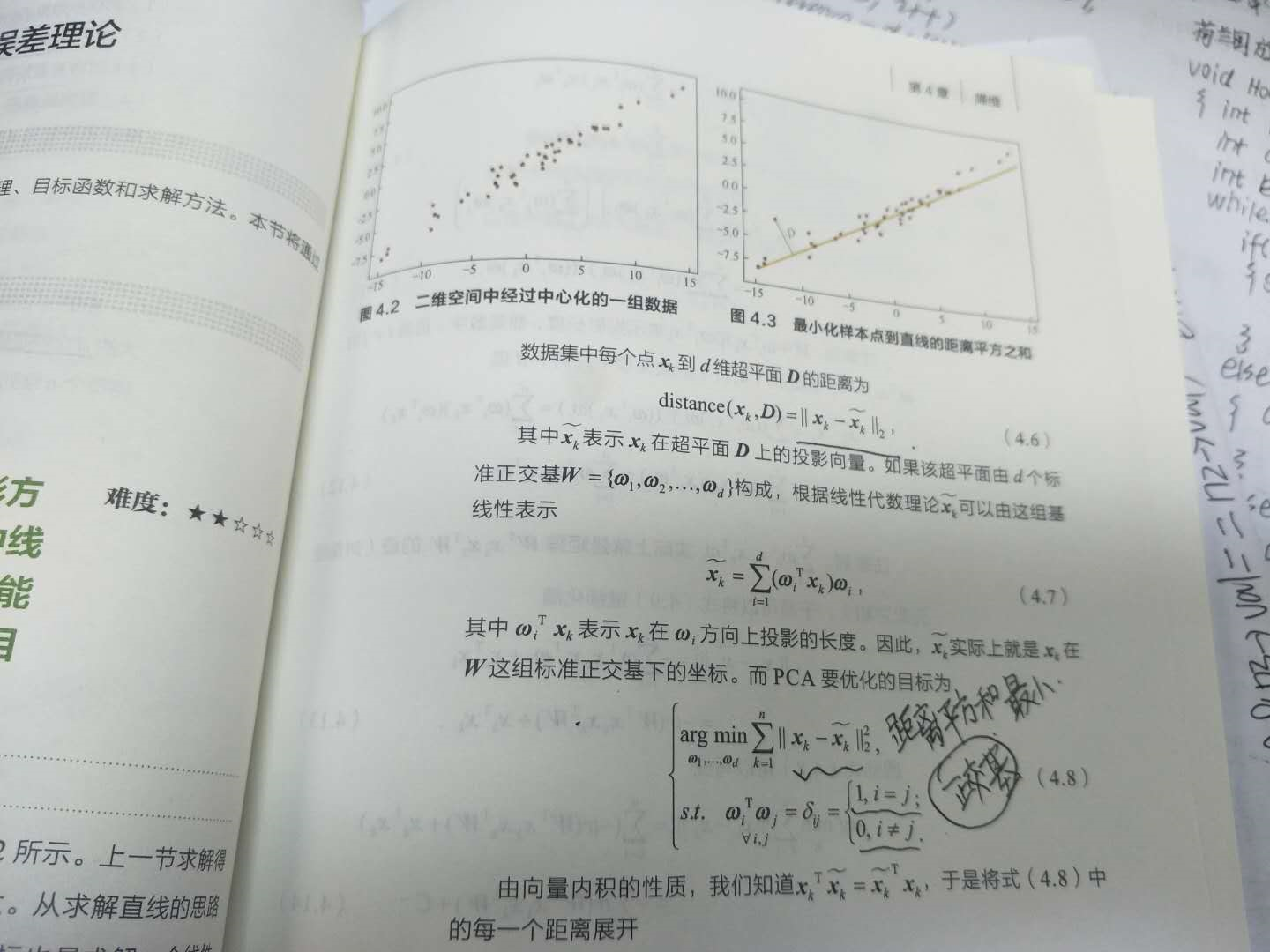

最小平方误差理论:

一、线性判别分析:(LDA)(有监督的降维方法)

针对的是有标签的数据,使用此不会损失类别信息。(最大化类间距离,最小化类内距离)

无监督的任务选用PCA,有监督的任务采用LDA。(PCA假设方差越大,信息量越大,用主成分来表示原始数据可以去除冗余的维度,达到降维的效果,然而LDA选择的是投影后类内方差最小,类间方差最大的方向)