2019年6月,谷歌更强 NLP 模型 XLNet并开源。 XLNet 则是基于 BERT 的优缺点,提出的一种泛化自回归预训练方法。它通过最大化因子分解顺序所有排列的期望似然来实现双向上下文的学习;通过自回归公式克服了BERT问缺点。

视频选集

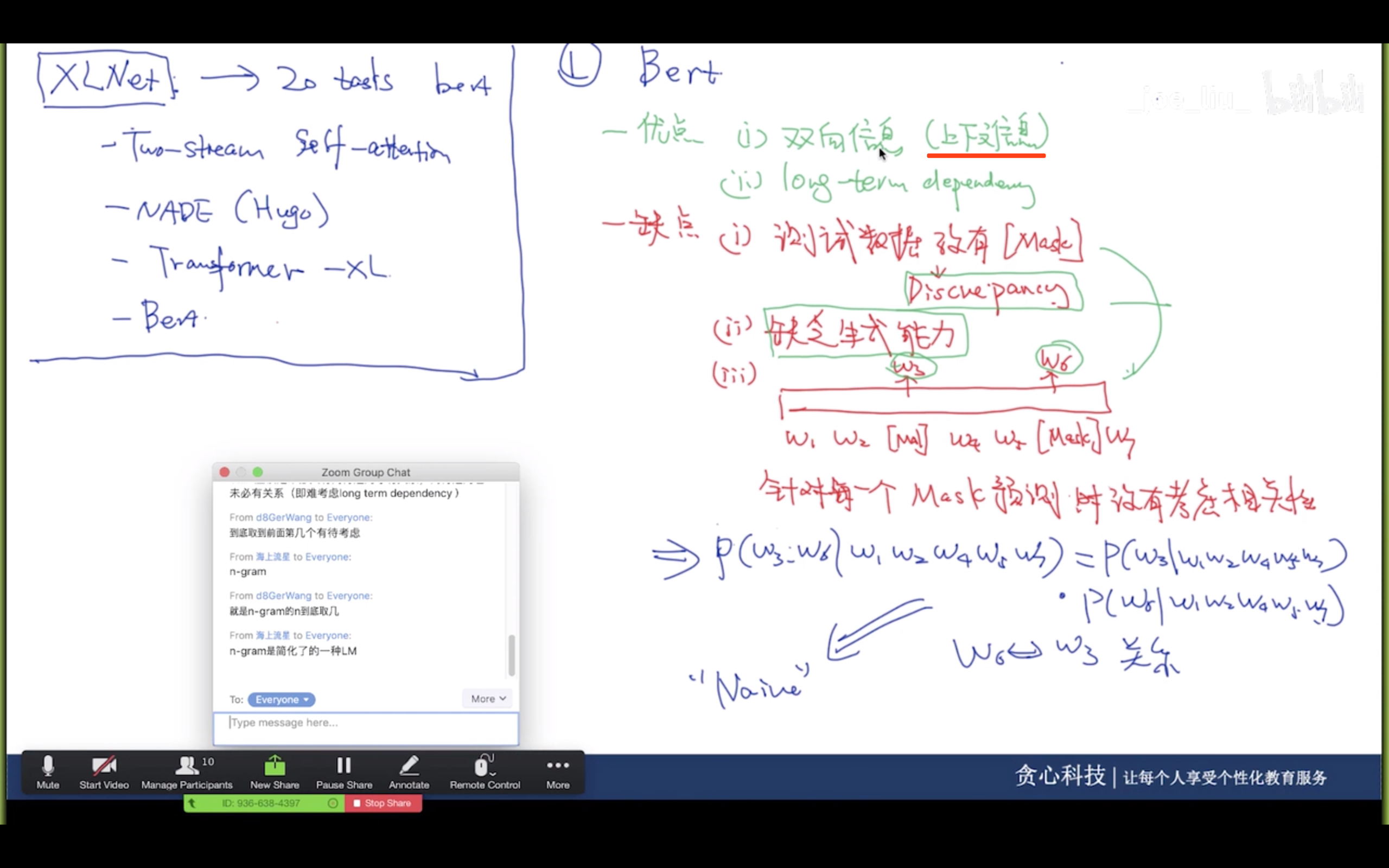

- P22.XLNet的改进思路

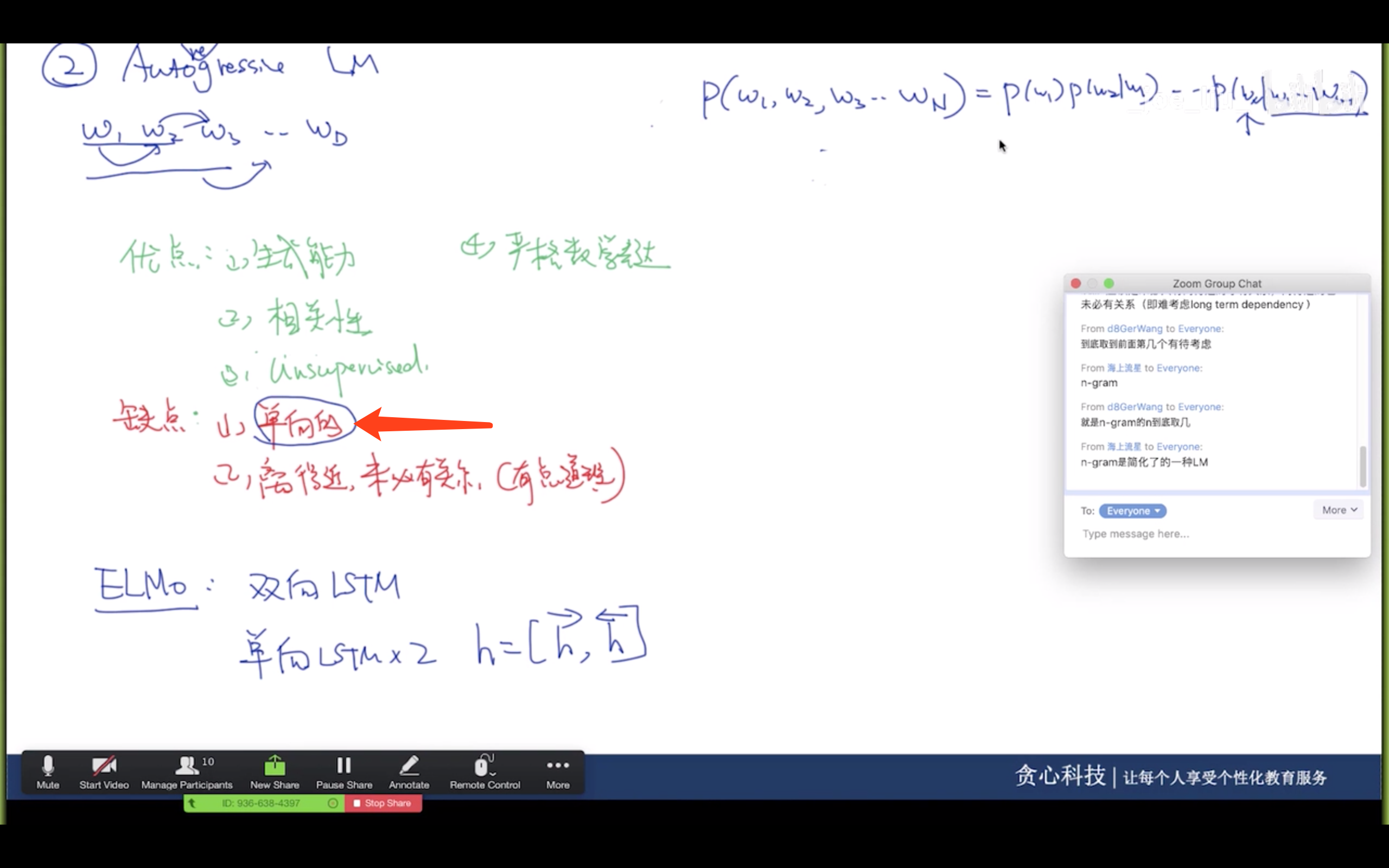

- P33.BERT的目标函数

- P44.Permutation LM

- P55.Permutation LM及XLNet论文

- P66.TransformerXL

- P77.TransformerXL_2

- P88.实现及XLNet总结讨论

w3, w6 条件独立

HuggingFace github